Clear Sky Science · pt

A explicabilidade de modelos de aprendizado de máquina baseados em radiômica para graduação de gliomas cerebrais em imagens ponderadas por transferência de prótons amida

Por que esta pesquisa é importante

Os tumores cerebrais chamados gliomas podem variar de crescimento relativamente lento a altamente agressivos. Tradicionalmente, os médicos determinam quão perigoso é um glioma retirando um fragmento do tumor durante cirurgia ou biópsia e examinando-o ao microscópio. Essa abordagem é invasiva, envolve riscos médicos e pode deixar de capturar as partes mais agressivas de um tumor altamente heterogêneo. Este estudo investiga se exames avançados de ressonância magnética combinados com inteligência artificial podem graduar gliomas de forma não invasiva — e, crucialmente, explica como os modelos computacionais chegam às suas decisões para que os médicos possam confiar e interpretar os resultados.

Olhar dentro do cérebro sem cirurgia

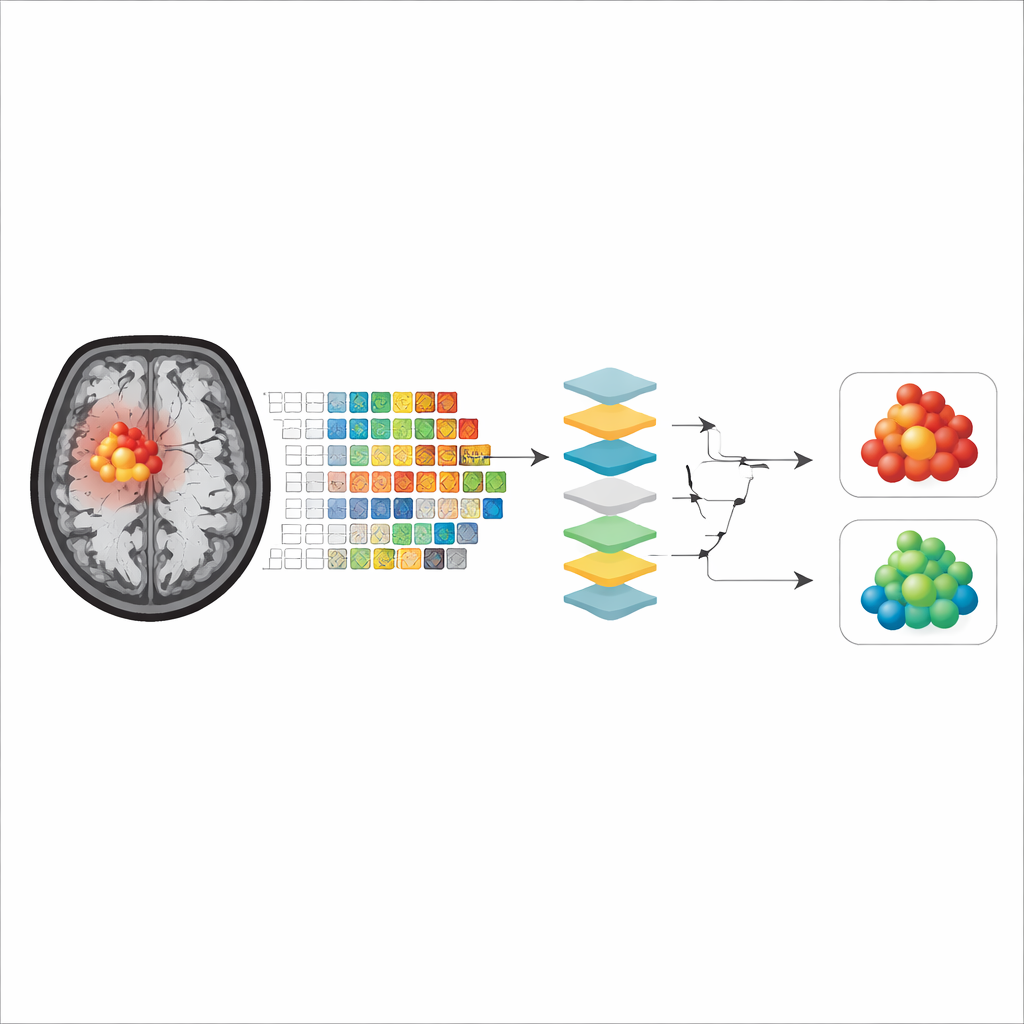

Os pesquisadores concentraram-se em um método especial de RM chamado imagens ponderadas por transferência de prótons amida (APTw), sensível ao ambiente químico do tecido cerebral. Trabalhos anteriores mostraram que imagens APTw podem distinguir gliomas de alto e baixo grau, mas as razões desse sucesso não eram totalmente compreendidas. Neste estudo, 102 pacientes com gliomas cerebrais não tratados foram submetidos a exames de RM, incluindo imagens APTw, antes da remoção cirúrgica e da graduação dos tumores por patologistas. A equipe então usou esses exames para treinar modelos computacionais a separar os tumores mais agressivos (grau 4) de todos os demais, visando imitar o julgamento do patologista usando apenas dados de imagem.

Transformando imagens em padrões mensuráveis

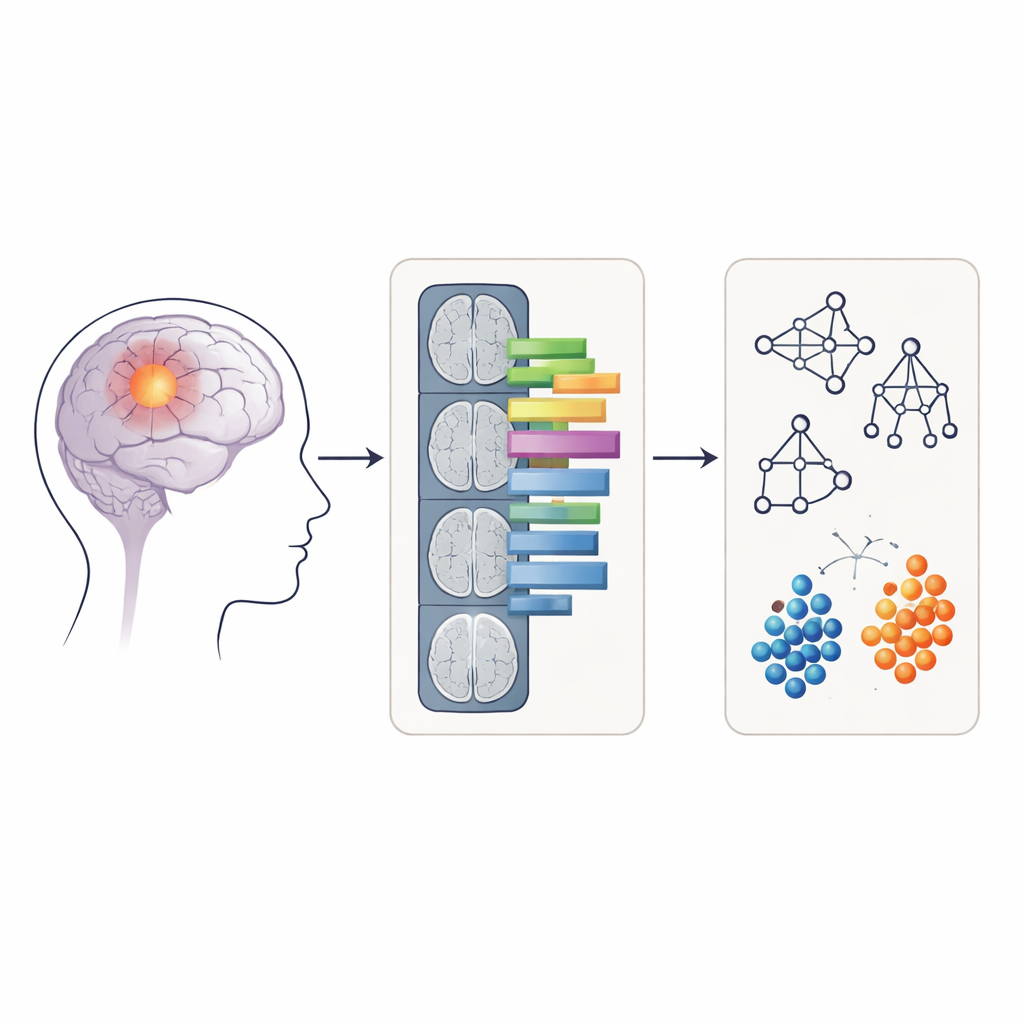

Em vez de alimentar diretamente as imagens de RM brutas no computador, os pesquisadores usaram uma técnica chamada radiômica, que converte imagens médicas em centenas de características numéricas. Essas características descrevem aspectos como quão arredondado ou irregular o tumor parece e quão uniformemente ou desigualmente a intensidade do sinal está distribuída dentro dele. Para cada paciente, características radiômicas foram extraídas de dois tipos de regiões nas imagens APTw: apenas o núcleo do tumor com realce por contraste e uma área maior que inclui tanto o núcleo realçado quanto o tecido circundante inchado (edema). Quatro métodos comuns de aprendizado de máquina — random forest, máquina de vetores de suporte, naïve Bayes e regressão logística — foram treinados e testados nessas características para avaliar quão precisamente podiam classificar tumores como grau 4 ou não.

Abrindo a caixa‑preta da inteligência artificial

Muitos modelos poderosos de aprendizado de máquina funcionam como “caixas‑pretas”, fazendo previsões corretas sem revelar como chegaram a elas. Para enfrentar isso, os autores aplicaram três ferramentas de explicabilidade. Valores de Shapley estimam quanto cada característica contribui para uma previsão dada, importância por permutação mede quanto o desempenho cai quando uma característica é embaralhada, e um método chamado anchors encontra combinações simples, semelhantes a regras, de características que são suficientes para sustentar a decisão do modelo. Em conjunto, essas ferramentas permitiram à equipe identificar quais aspectos da aparência do tumor em imagens APTw os modelos mais utilizaram ao graduar os gliomas.

O que os modelos realmente observam

Em todos os modelos e métodos de explicabilidade, emergiram dois grupos principais de características como os mais importantes. O primeiro descrevia a forma do tumor, especialmente quão próxima a contorno do tumor estava de uma forma lisa e regular versus ser irregular e desigual. O segundo capturava quão manchado ou uniforme era o sinal APTw dentro do tumor, refletindo a mistura interna de tipos de tecido. Curiosamente, quando os modelos foram treinados apenas no núcleo realçado pelo contraste, características de forma frequentemente dominaram para alguns algoritmos, enquanto quando o tecido inchado circundante foi incluído, medidas de desigualdade interna do sinal tornaram‑se mais influentes, ou vice‑versa dependendo do modelo. No geral, modelos que focaram no núcleo tumoral realçado mostraram acurácia ligeiramente melhor, sugerindo que essa região representa melhor o tecido tumoral verdadeiro, com menos efeitos de confusão de necrose ou edema.

Limites e direções futuras

O estudo tem várias limitações práticas. O grupo de pacientes incluiu relativamente poucos tumores de baixo grau, de modo que os modelos foram projetados para distinguir tumores de grau 4 de todos os demais combinados em vez de separar cada grau individualmente. Os dados também vieram de um único hospital, e as imagens APTw tinham fatias relativamente espessas, o que pode limitar a precisão da medição de algumas características de forma. Apesar dessas limitações, os achados foram consistentes entre os diferentes métodos de explicabilidade, sustentando a ideia de que contornos tumorais irregulares e padrões internos desiguais de sinal são pistas imagiológicas chave que os modelos usam para reconhecer gliomas altamente agressivos.

O que isso significa para pacientes e médicos

Em termos simples, este trabalho mostra que modelos computacionais podem usar padrões detalhados ocultos em exames avançados de RM para distinguir tumores cerebrais agressivos de menos perigosos, e esclarece quais pistas visuais nas imagens impulsionam essas decisões. Ao destacar a importância da forma do tumor e da heterogeneidade interna nas imagens APTw, e ao demonstrar que essas pistas podem ser explicadas de forma transparente, o estudo aproxima a graduação não invasiva de tumores da realidade clínica. Se validadas em estudos maiores e multicêntricos, tais ferramentas de IA explicável poderiam ajudar médicos a planejar tratamentos de forma mais segura e rápida, às vezes reduzindo a necessidade de biópsias arriscadas e fornecendo aos pacientes informações mais claras baseadas apenas em exames.

Citação: Gao, X., Wang, J. The explainability of radiomic-based machine learning models for brain glioma grading on amide proton transfer-weighted images. Sci Rep 16, 14539 (2026). https://doi.org/10.1038/s41598-026-44963-x

Palavras-chave: imagem de glioma cerebral, radiômica, IA explicável, biomarcadores em RM, graduação de tumor