Clear Sky Science · es

La explicabilidad de modelos de aprendizaje automático basados en radiómica para la gradación de gliomas cerebrales en imágenes ponderadas por transferencia de protones amida

Por qué esta investigación importa

Los tumores cerebrales llamados gliomas pueden variar desde de crecimiento relativamente lento hasta muy agresivos. Tradicionalmente, los médicos determinan cuán peligroso es un glioma tomando un fragmento del tumor durante una cirugía o biopsia y examinándolo al microscopio. Ese enfoque es invasivo, conlleva riesgos médicos y puede pasar por alto las zonas más agresivas de un tumor heterogéneo. Este estudio explora si exploraciones avanzadas por resonancia magnética combinadas con inteligencia artificial pueden graduar los gliomas de forma no invasiva y, lo que es crucial, explica cómo los modelos informáticos toman sus decisiones para que los médicos puedan confiar e interpretar los resultados.

Mirar dentro del cerebro sin cirugía

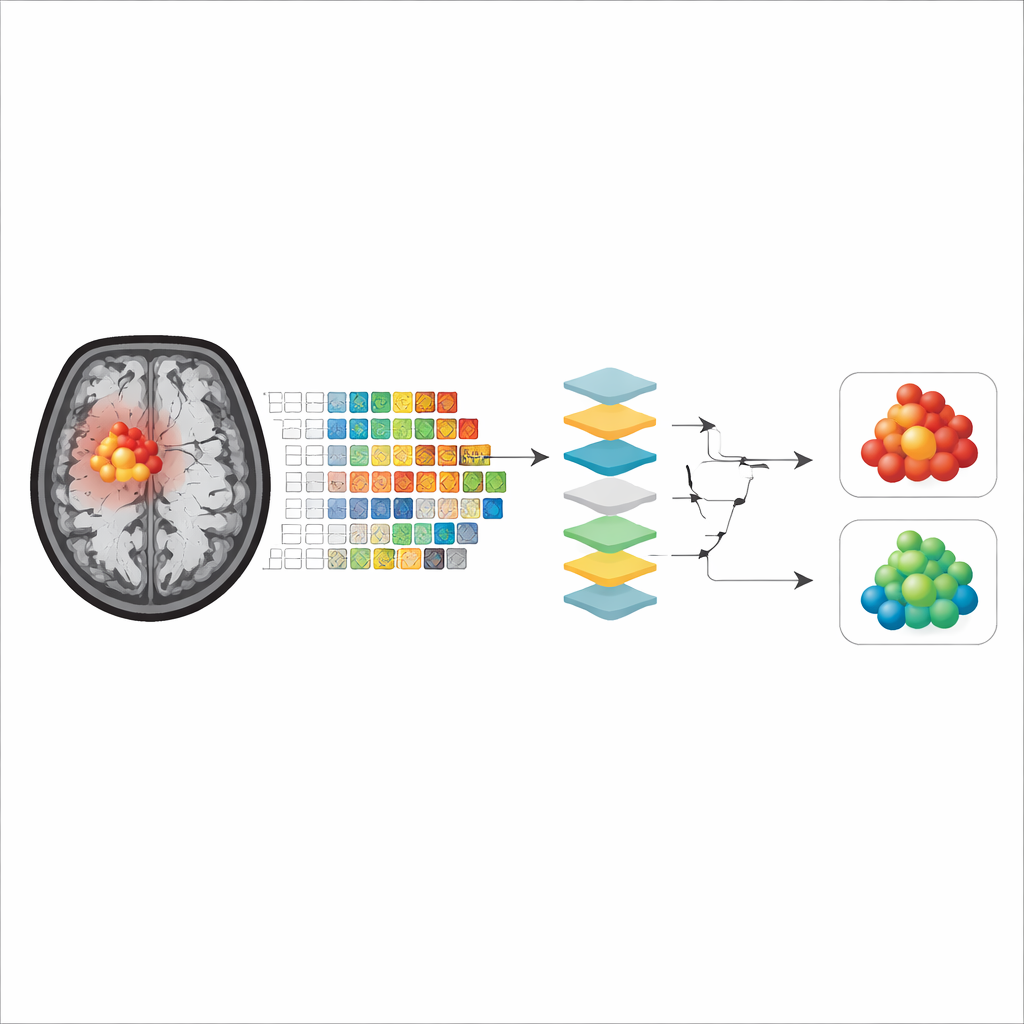

Los investigadores se centraron en un método especial de RM llamado imágenes ponderadas por transferencia de protones amida (APTw), que es sensible al entorno químico del tejido cerebral. Trabajos previos habían mostrado que las imágenes APTw pueden distinguir entre gliomas de alto y bajo grado, pero las razones de este éxito no estaban completamente claras. En este estudio, 102 pacientes con gliomas cerebrales no tratados se sometieron a exploraciones por RM, incluidas imágenes APTw, antes de que sus tumores fueran extirpados quirúrgicamente y graduados por patólogos. El equipo utilizó entonces estas exploraciones para entrenar modelos informáticos que separaran los tumores más agresivos (grado 4) de los demás, con el objetivo de imitar el juicio del patólogo usando solo datos de imagen.

Convertir imágenes en patrones medibles

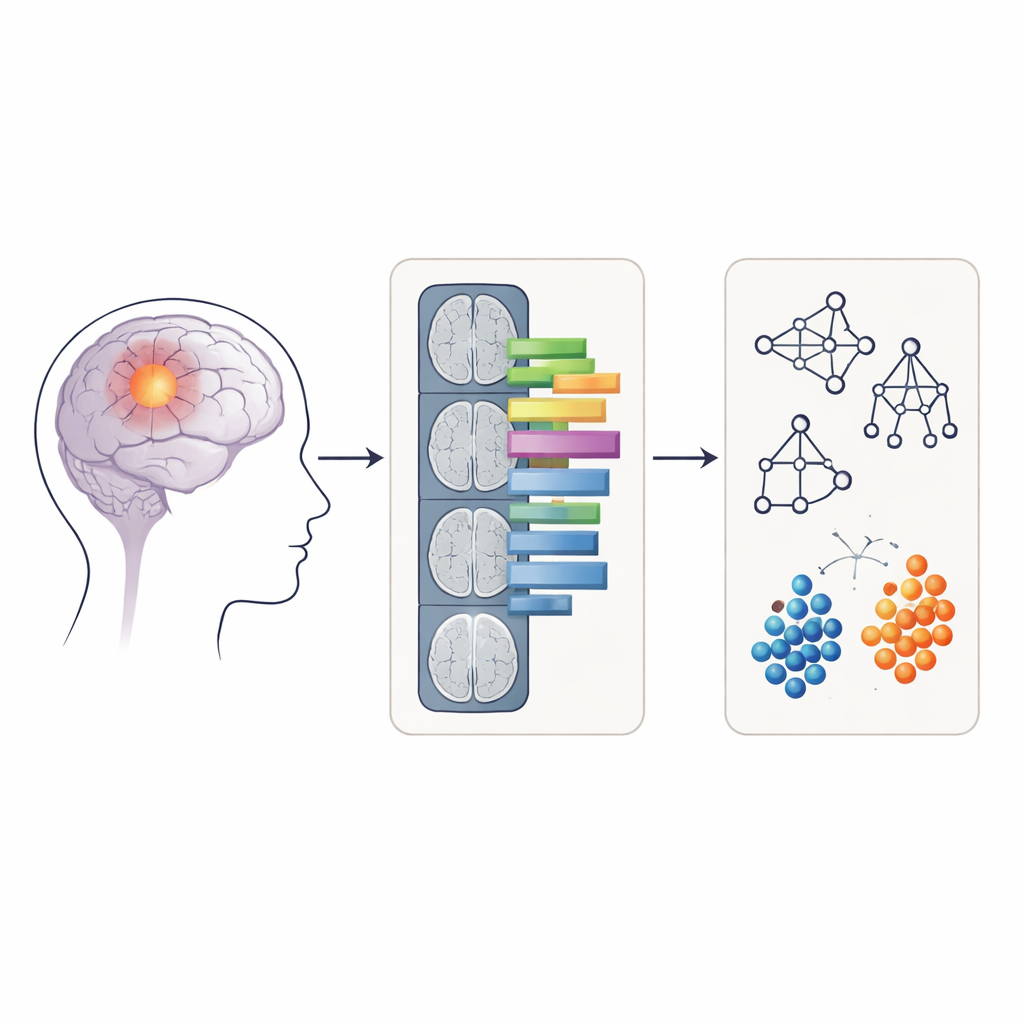

En lugar de introducir las imágenes RM crudas directamente en el ordenador, los investigadores usaron una técnica llamada radiómica, que convierte las imágenes médicas en cientos de características numéricas. Estas características describen elementos como cuán redondeado o irregular parece el tumor y cuán homogénea o heterogénea es la distribución de la intensidad de la señal en su interior. Para cada paciente, se extrajeron características radiómicas de dos tipos de regiones en las imágenes APTw: solo el núcleo que realza con contraste del tumor, y un área mayor que incluye tanto el núcleo que realza como el tejido circundante con edema. Cuatro métodos comunes de aprendizaje automático—bosque aleatorio, máquina de vectores de soporte, Bayes ingenuo y regresión logística—fueron entrenados y probados con estas características para ver qué tan bien podían clasificar los tumores como grado 4 o no.

Abrir la caja negra de la inteligencia artificial

Muchos modelos potentes de aprendizaje automático actúan como “cajas negras”, haciendo predicciones correctas sin revelar cómo llegaron a ellas. Para abordar esto, los autores aplicaron tres herramientas de explicabilidad. Los valores de Shapley estiman cuánto contribuye cada característica a una predicción dada; la importancia por permutación mide cuánto cae el rendimiento cuando se desordena una característica; y un método llamado anchors encuentra combinaciones simples, tipo regla, de características que son suficientes para sostener la decisión de un modelo. En conjunto, estas herramientas permitieron al equipo identificar qué aspectos de la apariencia tumoral en las imágenes APTw eran los que más utilizaban los modelos para graduar los gliomas.

En qué se fijan realmente los modelos

A través de todos los modelos y métodos de explicabilidad, surgieron dos grupos principales de características como las más importantes. El primero describe la forma del tumor, especialmente cuán cercana está la silueta tumoral a una forma suave y regular frente a una forma irregular y desigual. El segundo capta cuán parcheada o uniforme es la señal APTw dentro del tumor, reflejando la mezcla interna de tipos de tejido. Curiosamente, cuando los modelos se entrenaron solo con el núcleo que realza con contraste, las características de forma dominaron a menudo en algunos algoritmos, mientras que al incluir el tejido circundante edematoso, las medidas de heterogeneidad interna de la señal se volvieron más influyentes, o viceversa dependiendo del modelo. En conjunto, los modelos que se centraron en el núcleo tumoral que realza mostraron una precisión ligeramente mejor, lo que sugiere que esta región representa mejor el tejido tumoral verdadero con menos efectos de confusión por necrosis o edema.

Límites y direcciones futuras

El estudio tiene varias limitaciones prácticas. El grupo de pacientes contenía relativamente pocos tumores de bajo grado, por lo que los modelos se diseñaron para distinguir tumores de grado 4 de todos los demás combinados en lugar de separar cada grado individualmente. Los datos también provinieron de un único hospital, y las imágenes APTw tenían cortes relativamente gruesos, lo que puede limitar la precisión con la que se miden algunas características de forma. A pesar de estas limitaciones, los hallazgos fueron consistentes entre diferentes métodos de explicabilidad, lo que respalda la idea de que los contornos tumorales irregulares y los patrones internos de señal desiguales son pistas clave en las imágenes que los modelos usan para reconocer gliomas altamente agresivos.

Qué significa esto para pacientes y médicos

En términos sencillos, este trabajo muestra que los modelos informáticos pueden usar patrones detallados ocultos en exploraciones avanzadas por RM para distinguir tumores cerebrales agresivos de otros menos peligrosos, y aclara qué señales visuales en las imágenes impulsan esas decisiones. Al destacar la importancia de la forma tumoral y la heterogeneidad interna en las imágenes APTw, y al demostrar que estas pistas pueden explicarse de forma transparente, el estudio acerca la gradación tumoral no invasiva a la práctica clínica. Si se valida en estudios más amplios y multicéntricos, tales herramientas de IA explicable podrían ayudar a los médicos a planificar el tratamiento de forma más segura y rápida, a veces reduciendo la necesidad de biopsias arriesgadas y proporcionando a los pacientes información más clara basada solo en las exploraciones.

Cita: Gao, X., Wang, J. The explainability of radiomic-based machine learning models for brain glioma grading on amide proton transfer-weighted images. Sci Rep 16, 14539 (2026). https://doi.org/10.1038/s41598-026-44963-x

Palabras clave: imagenología de glioma cerebral, radiómica, IA explicable, biomarcadores por RM, gradación tumoral