Clear Sky Science · pl

Walidacja predykcji konformalnej w klasyfikacji atypii szyjkowej

Dlaczego inteligentniejsze badania przesiewowe w kierunku raka szyjki są ważne

Rak szyjki macicy nadal zabija setki tysięcy kobiet rocznie, zwłaszcza w krajach, gdzie brakuje lekarzy i specjalistów laboratoryjnych. Systemy sztucznej inteligencji (SI), które analizują próbki komórek szyjkowych pod mikroskopem, mogłyby pomóc wypełnić tę lukę, ale obecne systemy często wyrażają nadmierną pewność siebie. Zwykle podają pojedynczą etykietę „najlepszego przypuszczenia”, nawet gdy obraz jest rzeczywiście trudny do sklasyfikowania. W tym badaniu postawiono proste, lecz kluczowe pytanie: gdy SI mówi, że jest niepewna, czy ta niepewność rzeczywiście zgadza się z oceną ekspertów?

Od pojedynczych odpowiedzi do krótkich list możliwości

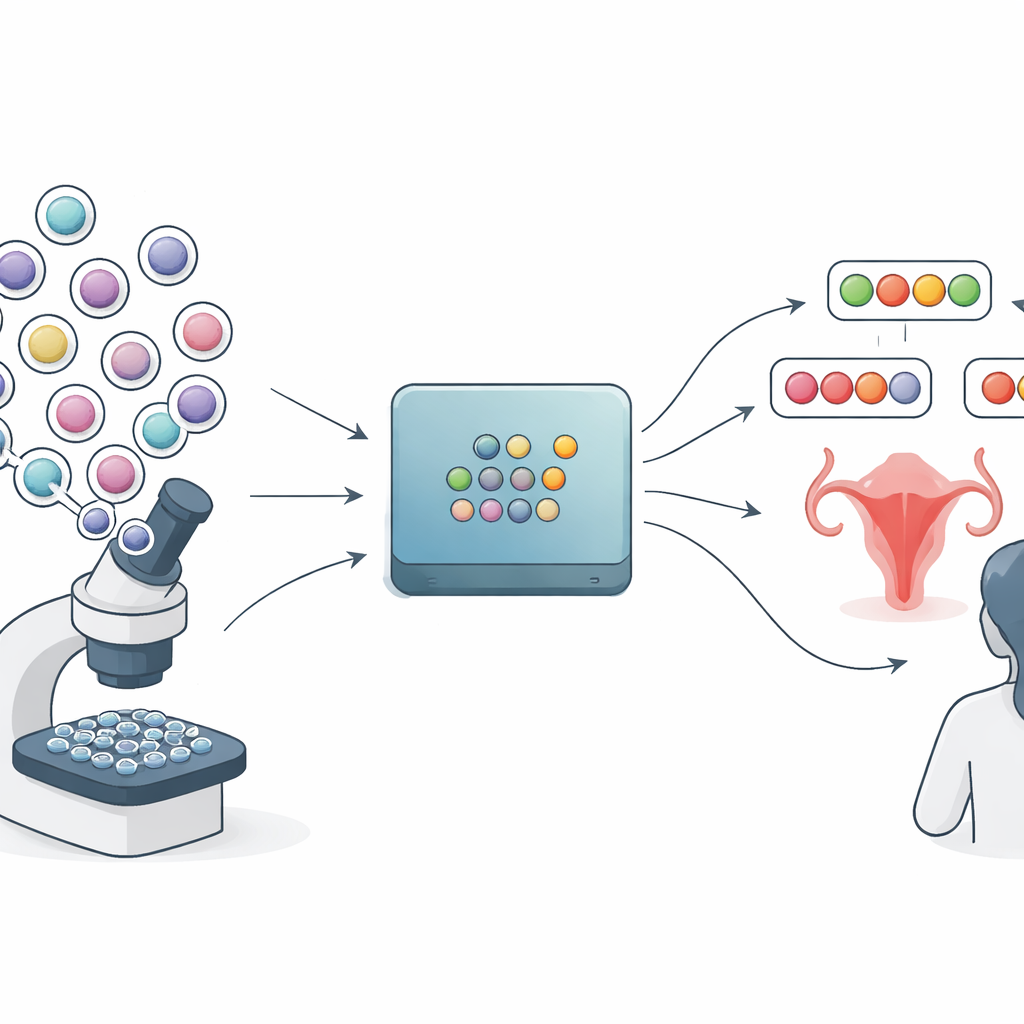

Większość medycznych narzędzi SI do analizy rozmazów Pap odzwierciedla sposób, w jaki sporządzane są standardowe raporty laboratoryjne: wybierają jedną kategorię, taką jak „prawidłowe”, „zmiany niskiego stopnia” lub „zmiany wysokiego stopnia”, i przypisują do niej prawdopodobieństwo. Te wartości prawdopodobieństwa mogą jednak myląco sugerować zbytnią pewność. Metoda opisana w artykule, zwana predykcją konformalną, idzie inną drogą. Zamiast jednej ostatecznej odpowiedzi, generuje dla każdego kafelka obrazu z preparatu mały zbiór prawdopodobnych etykiet. Bardzo pewne przypadki mogą otrzymać jedną etykietę, natomiast trudniejsze — kilka. W teorii daje to klinicystom uczciwszy obraz tego, co model wie, a czego nie wie.

Budowanie bogatego obrazu rozbieżności wśród ekspertów

Aby sprawdzić, jak ta koncepcja działa w praktyce, badacze zebrali szczegółowy zbiór danych z ponad 300 rozmazów Pap pochodzących ze szpitala wiejskiego w Kenii. Istniejący system SI najpierw wskazał obszary, w których prawdopodobnie występują komórki nieprawidłowe, a te regiony pocięto na małe kafelki. Sześciu doświadczonych cytologów użyło dedykowanej platformy internetowej, aby oznakować tysiące takich kafelków. Dla głównego zestawu testowego czterech ekspertów niezależnie oznakowało te same kafelki. W ten sposób nie powstała jedynie pojedyncza „prawda ziemi” dla każdego kafelka, lecz pełny wzorzec zgody i niezgody między ekspertami, odzwierciedlający, które obrazy były jednoznaczne, a które naturalnie dwuznaczne.

Testowanie różnych sposobów wyrażania niepewności

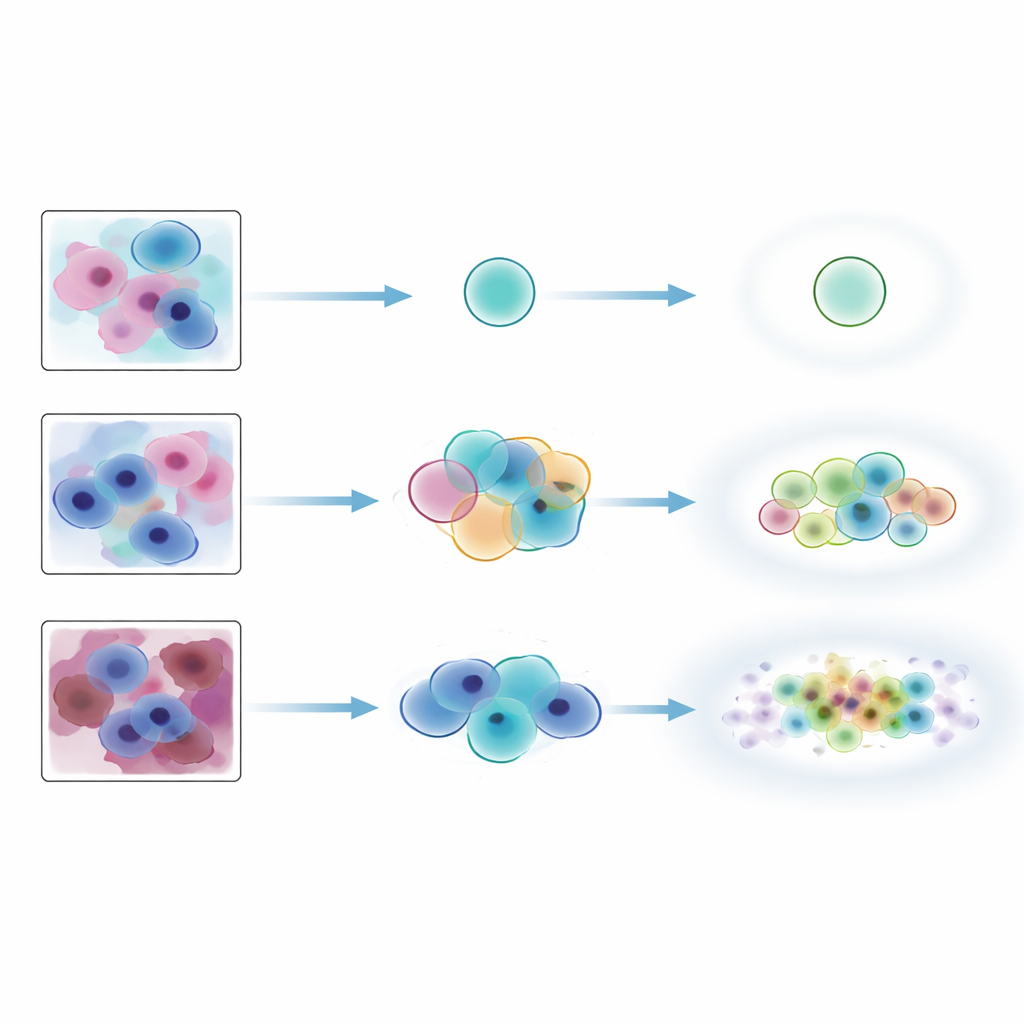

Zespół wytrenował trzy popularne modele głębokiego uczenia do rozpoznawania czterech kategorii: prawidłowe, zmiany niskiego stopnia, zmiany wysokiego stopnia oraz artefakty. Na każdym z modeli zastosowano trzy warianty predykcji konformalnej, różniące się tym, jak szerokie mają tendencję być ich zbiory etykiet. Następnie oceniono wyniki na dwa komplementarne sposoby. Po pierwsze, użyto standardowych miar pokrycia, które pytają: czy zestaw przewidywanych etykiet zawiera etykietę konsensusu ekspertów przynajmniej w wybranym odsetku przypadków? Po drugie, wprowadzono miary porównujące zgodność, które zestawiają każdy przewidywany zbiór z pełną listą etykiet przypisanych przez wszystkich ekspertów dla danego kafelka, nagradzając przypadki, w których krótka lista SI odpowiada zakresowi opinii ekspertów.

Gdy standardowe metryki malują zbyt różowy obraz

Według konwencjonalnych miar pokrycia metody konformalnej wypadały imponująco: niemal zawsze obejmowały etykietę konsensusu ekspertów, szczególnie gdy pozwolono im zwracać nieco większe zbiory. Jednak surowsze testy zgodności pokazały inną historię. Dokładne dopasowania między zbiorami etykiet SI a złączonymi etykietami ekspertów występowały tylko w około jednej trzeciej przypadków, niezależnie od metody. Niektóre podejścia preferowały małe, precyzyjne zbiory, które pomijały etykiety uznawane przez ekspertów za możliwe, podczas gdy inne generowały większe zbiory, które obejmowały obok poprawnej również mało prawdopodobne etykiety. Metody dobrze radziły sobie z odwzorowywaniem wbudowanej niejednoznaczności: gdy eksperci częściej się nie zgadzali, zbiory konformalnej predykcji miały tendencję do powiększania się. Były jednak znacznie mniej niezawodne w sygnalizowaniu obrazów, które faktycznie nie należały do rozkładu treningowego, takich jak silnie zaszumione rozmazy Pap czy preparaty z szpiku kostnego z innego typu tkanki, a to zachowanie zależało w dużym stopniu od używanego modelu bazowego.

Co to oznacza dla zastosowań w praktyce

Dla klinicystów rozważających narzędzia wspierane przez SI główny wniosek brzmi: estymaty niepewności nie są automatycznie godne zaufania tylko dlatego, że towarzyszą im matematyczne gwarancje. Predykcja konformalna może zapewnić, że prawdziwa etykieta bardzo często znajduje się gdzieś w przewidywanym zbiorze, ale to badanie pokazuje, że dodatkowe etykiety w tym zbiorze mogą nie odpowiadać oczekiwaniom ludzi, a nawet odwracać uwagę od najbardziej istotnych możliwości. Autorzy argumentują, że w obszarach o dużym znaczeniu, takich jak badania przesiewowe w kierunku raka, wyniki SI powinny być oceniane nie tylko pod kątem technicznej „poprawności”, ale także pod kątem tego, czy prezentują informacje w skupiony i klinicznie sensowny sposób. Przyszłe prace będą musiały dopracować zarówno modele, jak i narzędzia niepewności, aby ich krótkie listy diagnoz były równie sensowne dla ekspertów, co zadowalające dla równań.

Cytowanie: Hagos, M.T., Suutala, A., Bychkov, D. et al. Validation of conformal prediction in cervical atypia classification. Sci Rep 16, 9649 (2026). https://doi.org/10.1038/s41598-026-44850-5

Słowa kluczowe: badania przesiewowe w kierunku raka szyjki macicy, niepewność w medycznej sztucznej inteligencji, predykcja konformalna, cytologia cyfrowa, wykrywanie danych spoza rozkładu