Clear Sky Science · fr

Validation de la prédiction conforme dans la classification des atypies cervicales

Pourquoi un dépistage du cancer du col plus intelligent est important

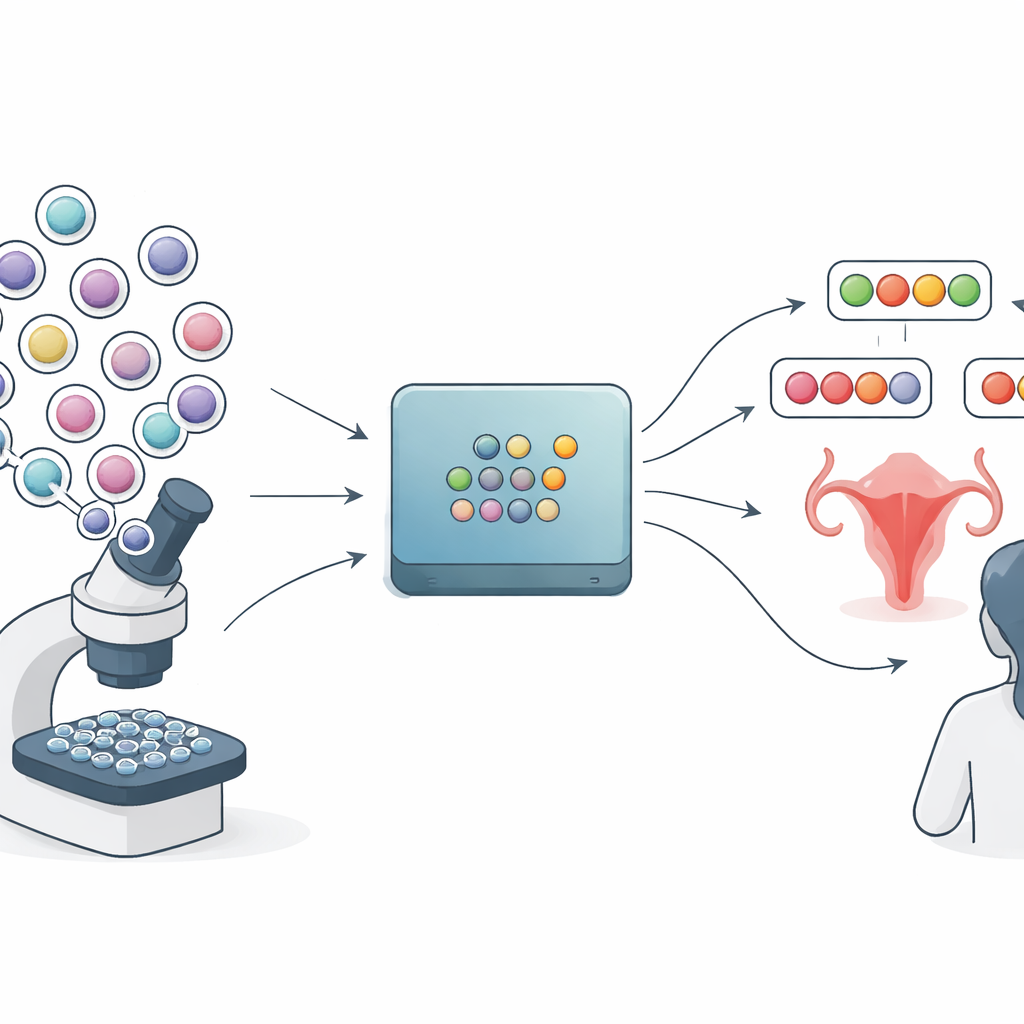

Le cancer du col de l'utérus continue de tuer des centaines de milliers de femmes chaque année, en particulier dans les pays où médecins et techniciens de laboratoire sont peu nombreux. Les systèmes d'intelligence artificielle (IA) qui examinent des prélèvements de cellules cervicales au microscope pourraient contribuer à combler ce déficit, mais les systèmes actuels affichent souvent une confiance excessive. Ils fournissent généralement une seule étiquette « meilleure estimation », même lorsque l'image est réellement difficile à classer. Cette étude pose une question simple mais cruciale : quand une IA dit qu'elle est incertaine, cette incertitude correspond-elle réellement à ce que pensent les experts humains ?

Passer d'une réponse unique à des listes courtes de possibilités

La plupart des outils d'IA médicale pour les frottis Pap reproduisent la façon dont les rapports de laboratoire standard sont rédigés : ils choisissent une catégorie unique comme « normal », « lésions de bas grade » ou « lésions de haut grade » et lui associent une probabilité. Mais ces scores de probabilité peuvent donner une impression de certitude trompeuse. La méthode étudiée dans cet article, appelée prédiction conforme, emprunte une voie différente. Plutôt qu'une réponse finale, elle produit un petit ensemble d'étiquettes plausibles pour chaque tuile d'image issue d'une lame. Un cas très sûr pourra recevoir une seule étiquette, tandis qu'un cas délicat en recevra plusieurs. En principe, cela devrait donner aux cliniciens une vision plus honnête de ce que le modèle sait ou ignore.

Construire un portrait riche des désaccords entre experts

Pour tester l'efficacité de cette idée dans le monde réel, les chercheurs ont constitué un jeu de données détaillé à partir de plus de 300 lames de frottis Pap collectées dans un hôpital rural du Kenya. Un système d'IA existant a d'abord mis en évidence les régions susceptibles de contenir des cellules anormales, et ces régions ont été découpées en petites tuiles. Six experts expérimentés en cytologie ont ensuite utilisé une plateforme web dédiée pour annoter des milliers de ces tuiles. Pour un jeu de test principal, quatre experts ont chacun annoté les mêmes tuiles de façon indépendante. Cela a produit non pas une unique « vérité terrain » par tuile, mais un schéma complet d'accords et de désaccords entre experts, capturant quelles images étaient évidentes et lesquelles étaient naturellement ambiguës.

Tester différentes façons d'exprimer l'incertitude

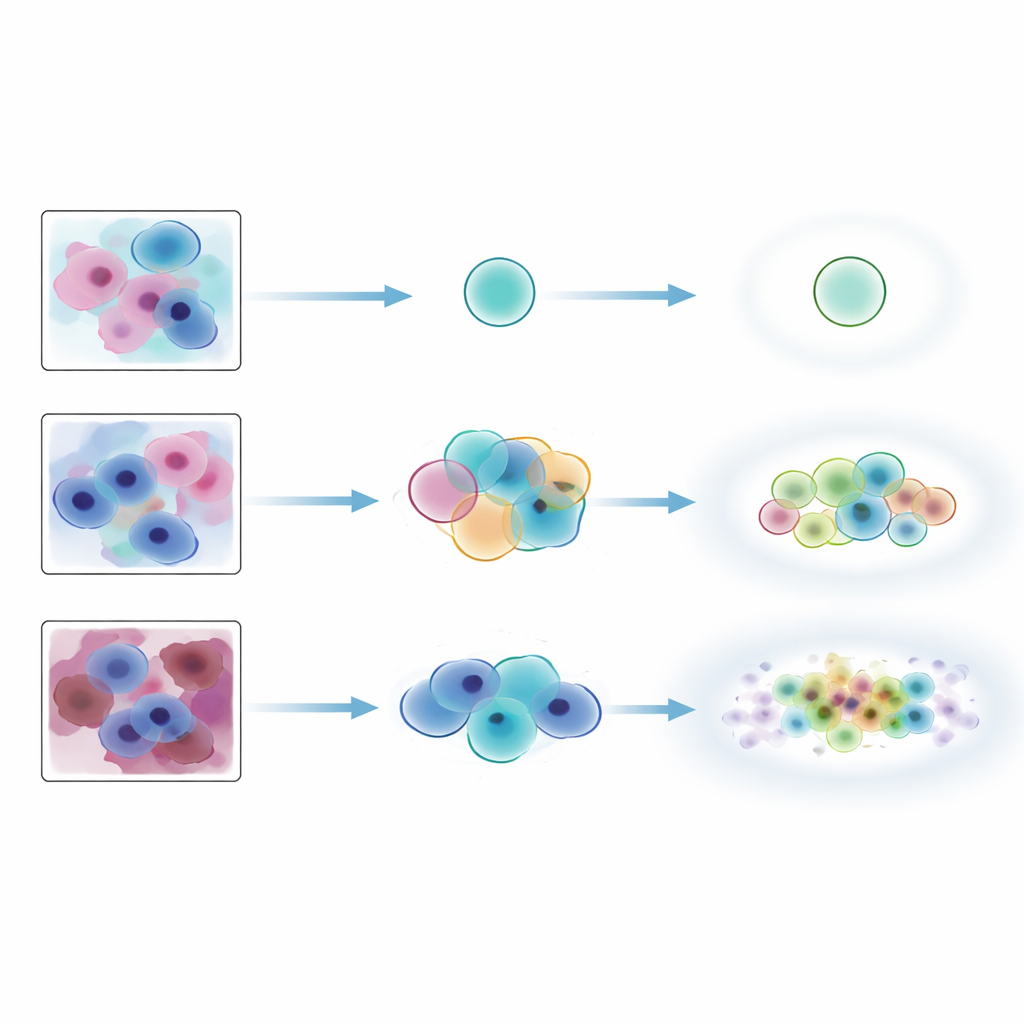

L'équipe a entraîné trois modèles d'apprentissage profond populaires pour reconnaître quatre catégories : normal, lésions de bas grade, lésions de haut grade et artefacts. Au-dessus de chaque modèle, ils ont appliqué trois variantes de prédiction conforme qui diffèrent par la largeur typique de leurs ensembles d'étiquettes. Ils ont ensuite évalué la performance de deux manières complémentaires. D'abord, ils ont utilisé des mesures classiques de couverture qui posent simplement la question : l'ensemble d'étiquettes prédit inclut-il l'étiquette consensuelle des experts au moins un pourcentage de fois choisi ? Ensuite, ils ont introduit des mesures de type accord qui comparent chaque ensemble de prédiction à la liste complète des étiquettes attribuées par tous les experts pour cette tuile, récompensant les cas où la liste restreinte de l'IA correspond à l'éventail d'opinions des experts.

Quand les métriques standard donnent un tableau trop optimiste

Selon les mesures conventionnelles de couverture, les méthodes conformes semblaient impressionnantes : elles incluaient presque toujours l'étiquette consensuelle des experts, surtout lorsqu'on leur permettait de produire des ensembles légèrement plus grands. Mais les tests d'accord plus stricts livrent un autre constat. Les correspondances exactes entre les ensembles d'étiquettes de l'IA et les étiquettes combinées des experts ne représentaient qu'environ un tiers des cas, quelle que soit la méthode. Certaines approches privilégiaient des ensembles petits et précis qui omettaient des étiquettes que les experts jugeaient plausibles, tandis que d'autres produisaient des ensembles plus larges qui englobaient des étiquettes improbables aux côtés de la bonne. Les méthodes ont bien suivi l'ambiguïté intrinsèque : lorsque les experts humains étaient davantage en désaccord, les ensembles conformes avaient tendance à s'élargir. Cependant, elles étaient beaucoup moins fiables pour signaler des images qui n'appartenaient vraiment pas à la distribution d'entraînement, comme des frottis Pap fortement bruités ou des cellules de moelle osseuse provenant d'un autre type de tissu, et ce comportement dépendait fortement du modèle sous-jacent utilisé.

Ce que cela implique pour l'utilisation en conditions réelles

Pour les cliniciens qui envisagent des outils d'aide basés sur l'IA, le principal enseignement est que les estimations d'incertitude ne sont pas automatiquement dignes de confiance simplement parce qu'elles s'accompagnent de garanties mathématiques. La prédiction conforme peut garantir que l'étiquette vraie se trouve très souvent quelque part dans l'ensemble prédit, mais cette étude montre que les étiquettes supplémentaires de cet ensemble peuvent ne pas correspondre aux attentes humaines et peuvent même détourner l'attention des possibilités les plus pertinentes. Les auteurs soutiennent que dans des domaines à enjeux élevés comme le dépistage du cancer, les sorties de l'IA doivent être jugées non seulement sur leur « correction » technique, mais aussi sur leur capacité à présenter l'information de manière ciblée et cliniquement significative. Les travaux futurs devront affiner à la fois les modèles et les outils d'incertitude afin que leurs listes restreintes de diagnostics paraissent aussi sensées aux experts qu'elles sont satisfaisantes pour les équations.

Citation: Hagos, M.T., Suutala, A., Bychkov, D. et al. Validation of conformal prediction in cervical atypia classification. Sci Rep 16, 9649 (2026). https://doi.org/10.1038/s41598-026-44850-5

Mots-clés: dépistage du cancer du col de l'utérus, incertitude de l'IA médicale, prédiction conforme, cytologie numérique, détection hors distribution