Clear Sky Science · de

Validierung der konformen Vorhersage bei der Klassifikation zervikaler Atypien

Warum intelligentere Screenings beim Gebärmutterhalskrebs wichtig sind

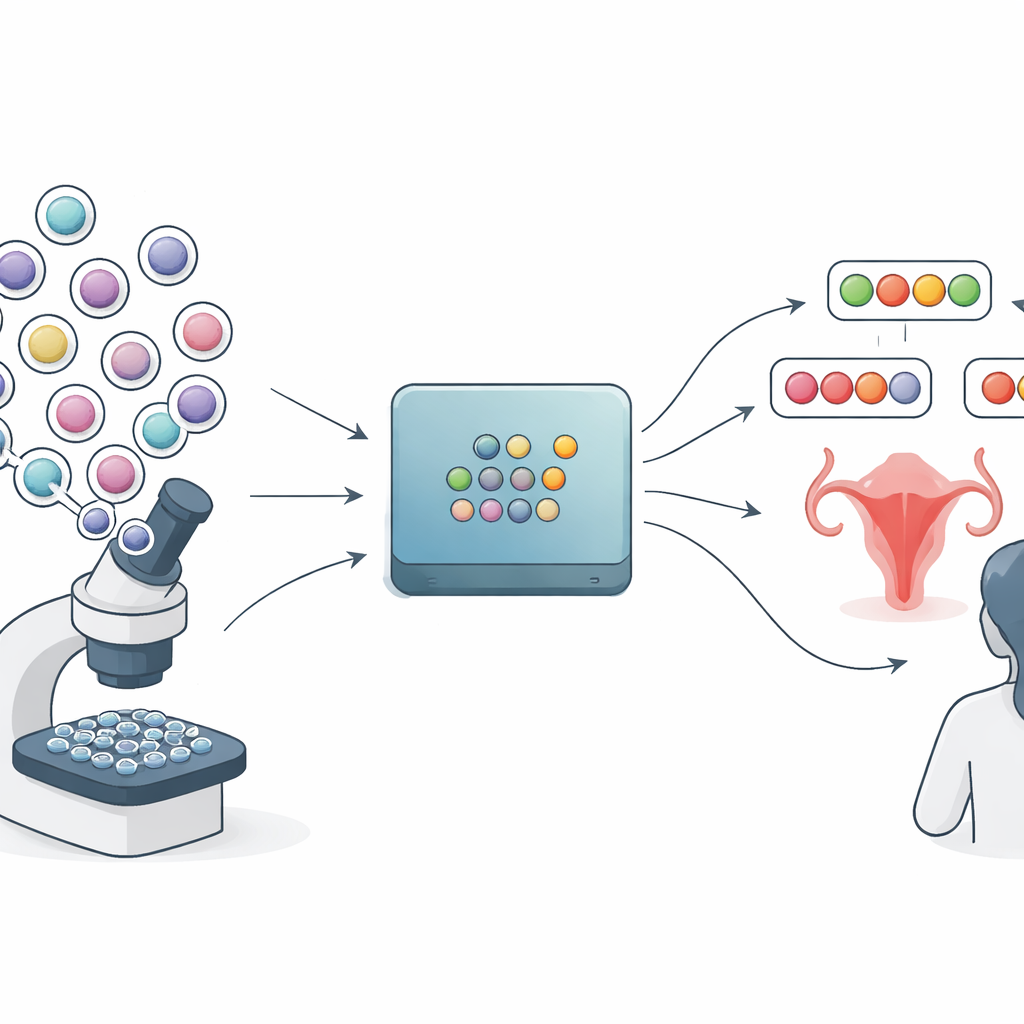

Gebärmutterhalskrebs fordert noch immer Hunderttausende von Frauenleben pro Jahr, insbesondere in Ländern, in denen Ärztinnen, Ärzte und Laborspezialistinnen knapp sind. Künstliche Intelligenz (KI)-Systeme, die zervikale Zellproben im Mikroskop analysieren, könnten helfen, diese Lücke zu schließen. Heutige Systeme treten jedoch oft zu sicher auf: sie liefern meist ein einzelnes „bestes“ Etikett, selbst wenn das Bild tatsächlich schwer zu klassifizieren ist. Diese Studie stellt eine einfache, aber entscheidende Frage: Wenn eine KI Unsicherheit signalisiert, entspricht diese Unsicherheit tatsächlich der Einschätzung menschlicher Expertinnen und Experten?

Von Einzelantworten zu kurzen Listen möglicher Diagnosen

Die meisten medizinischen KI-Werkzeuge für Pap-Abstrich-Bilder orientieren sich an der Form standardisierter Laborbefunde: sie wählen eine Kategorie wie „normal“, „niedrigrangige Veränderungen“ oder „hochgradige Veränderungen“ und geben eine Wahrscheinlichkeit an. Solche Wahrscheinlichkeitsscores können jedoch irreführend scharf wirken. Die in diesem Papier untersuchte Methode, konforme Vorhersage genannt, geht einen anderen Weg. Statt einer endgültigen Antwort erzeugt sie für jedes Bildkachel eines Präparats eine kleine Menge plausibler Labels. Ein sehr sicherer Fall bekommt vielleicht ein einzelnes Label, ein kniffliger Fall mehrere. Grundsätzlich sollte das den Klinikerinnen und Klinikern ein ehrlicheres Bild davon geben, was das Modell weiß und was nicht.

Ein vielschichtiges Bild der Expertenstreuung erstellen

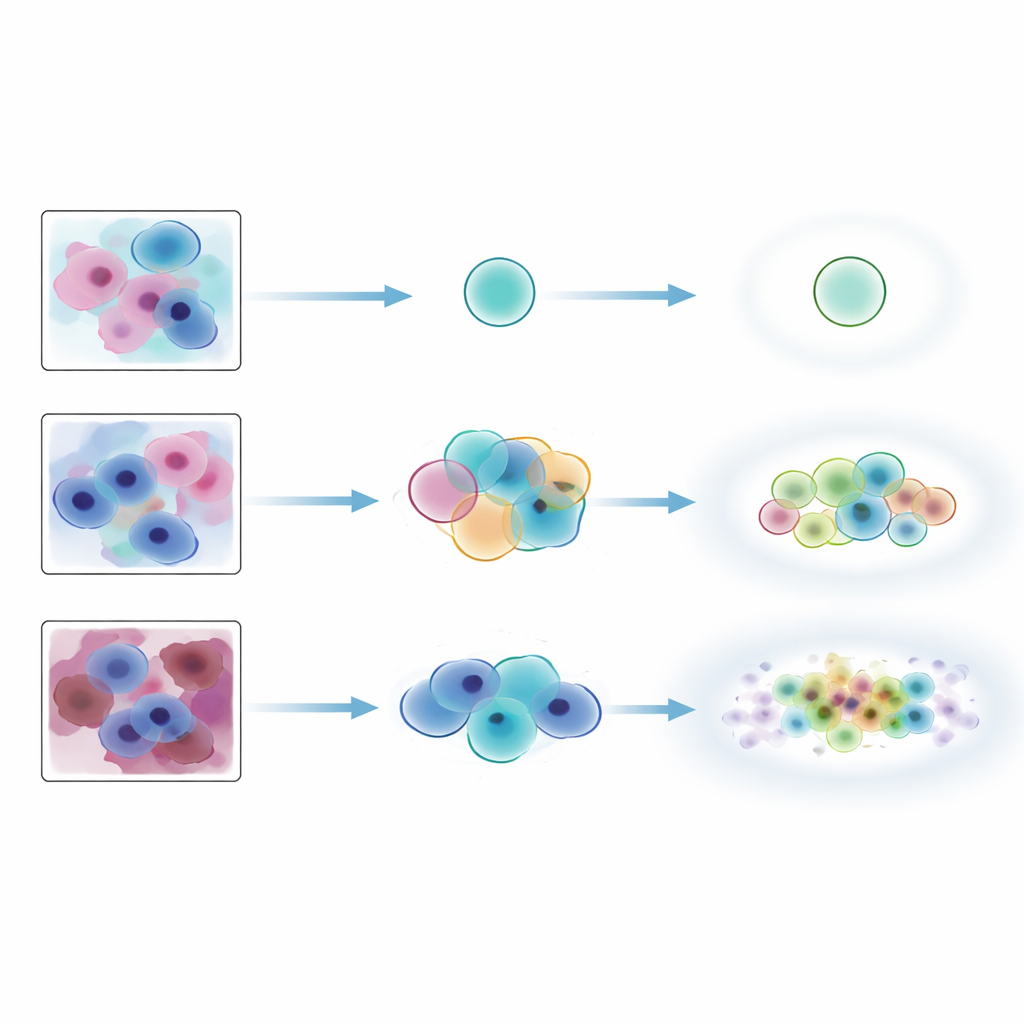

Um zu prüfen, wie gut die Idee in der Praxis funktioniert, stellten die Forschenden einen detaillierten Datensatz aus mehr als 300 Pap-Abstrich-Präparaten zusammen, die an einem ländlichen Krankenhaus in Kenia gewonnen wurden. Ein vorhandenes KI-System markierte zunächst Regionen, die wahrscheinlich abnorme Zellen enthielten; diese Regionen wurden zu kleinen Kacheln ausgeschnitten. Sechs erfahrene Zytologinnen und Zytologen nutzten dann eine maßgeschneiderte Webplattform, um Tausende dieser Kacheln zu labeln. Für einen Kern-Testdatensatz bezeichneten vier Expertinnen bzw. Experten dieselben Kacheln unabhängig voneinander. So entstand nicht nur eine einzelne „Ground Truth“ pro Kachel, sondern ein vollständiges Muster von Übereinstimmungen und Meinungsverschiedenheiten unter den Expertinnen und Experten, das abbildet, welche Bilder eindeutig sind und welche natürlicherweise mehrdeutig.

Unterschiedliche Wege, Unsicherheit auszudrücken, testen

Das Team trainierte drei verbreitete Deep-Learning-Modelle zur Erkennung von vier Kategorien: normal, niedrigrangige Veränderungen, hochgradige Veränderungen und Artefakte. Auf jedes Modell wurden drei Varianten der konformen Vorhersage angewendet, die sich darin unterscheiden, wie groß ihre Labelmengen tendenziell ausfallen. Die Leistung wurde dann auf zwei komplementäre Weisen bewertet. Erstens nutzten sie klassische Coverage-Maße, die schlicht fragen: Enthält die vorhergesagte Labelmenge das Konsenslabel der Expertinnen und Experten mindestens zu einem gewählten Prozentsatz der Fälle? Zweitens führten sie Übereinstimmungsmaße ein, die jede prognostizierte Menge mit der vollständigen Liste der Labels vergleichen, die alle Expertinnen und Experten für diese Kachel angegeben haben, und Fälle belohnen, in denen die Kurzliste der KI dem von den Experten gezeigten Meinungsumfang entspricht.

Wenn Standardmetriken ein zu rosiges Bild zeichnen

Nach konventionellen Coverage-Maßen wirkten die konformen Methoden beeindruckend: sie enthielten fast immer das Konsenslabel der Expertinnen und Experten, insbesondere wenn sie etwas größere Mengen ausgeben durften. Strengere Übereinstimmungstests zeigten jedoch ein anderes Bild. Exakte Übereinstimmungen zwischen den Labelmengen der KI und den kombinierten Labels der Experten traten nur in etwa einem Drittel der Fälle auf, unabhängig von der Methode. Einige Ansätze favorisierten kleine, präzise Mengen, die Labels verfehlten, die Experten für plausibel hielten, während andere größere Mengen erzeugten, die neben dem korrekten Label auch unwahrscheinliche Labels aufnahmen. Die Methoden konnten Mehrdeutigkeit gut abbilden: wenn menschliche Expertinnen und Experten stärker uneins waren, wuchsen die konformen Mengen tendenziell an. Sie waren jedoch deutlich weniger zuverlässig darin, Bilder zu kennzeichnen, die tatsächlich nicht zur Trainingsverteilung gehörten — etwa stark verrauschte Pap-Abstriche oder Knochenmarkszellen eines anderen Gewebetyps — und dieses Verhalten hing stark vom zugrunde liegenden Modell ab.

Was das für den praktischen Einsatz bedeutet

Für Klinikerinnen und Kliniker, die KI-gestützte Werkzeuge in Betracht ziehen, lautet die zentrale Erkenntnis: Unsicherheitsschätzungen sind nicht automatisch vertrauenswürdig, nur weil sie mathematische Garantien mitbringen. Konforme Vorhersage kann sicherstellen, dass das wahre Label sehr oft irgendwo in der prognostizierten Menge enthalten ist, doch diese Studie zeigt, dass die zusätzlichen Labels in dieser Menge möglicherweise nicht den Erwartungen von Menschen entsprechen und sogar von den relevantesten Möglichkeiten ablenken können. Die Autorinnen und Autoren argumentieren, dass in sensiblen Bereichen wie der Krebsfrüherkennung KI-Ergebnisse nicht nur danach bewertet werden dürfen, ob sie technisch „korrekt“ sind, sondern auch danach, ob sie Informationen fokussiert und klinisch sinnvoll präsentieren. Zukünftige Arbeit muss sowohl Modelle als auch Unsicherheitswerkzeuge verfeinern, damit deren Diagnosenkurzlisten für Expertinnen und Experten ebenso plausibel wirken wie sie mathematisch befriedigend sind.

Zitation: Hagos, M.T., Suutala, A., Bychkov, D. et al. Validation of conformal prediction in cervical atypia classification. Sci Rep 16, 9649 (2026). https://doi.org/10.1038/s41598-026-44850-5

Schlüsselwörter: Gebärmutterhalskrebs-Screening, Unsicherheit medizinischer KI, konforme Vorhersage, digitale Zytologie, Erkennung von Ausreißern (Out-of-Distribution)