Clear Sky Science · nl

Ontwerp van een in‑buis inspectierobotsysteem (IPIRS) met YOLOv8–LSTM‑integratie voor realtime navigatie in leidingen

Robots in de leidingen

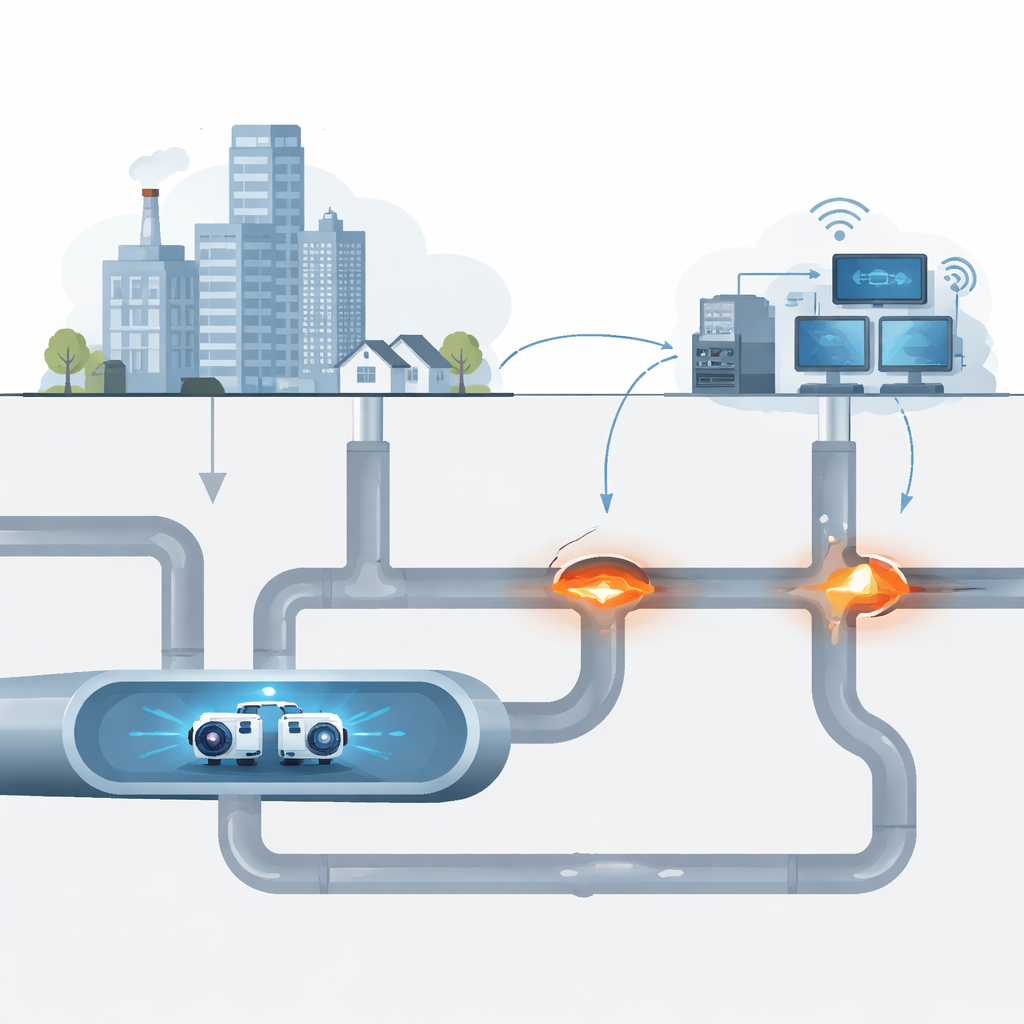

Dagelijks leveren uitgebreide netwerken van ondergrondse leidingen stilletjes de olie, gas en het water die het moderne leven mogelijk maken. Veel van deze pijpleidingen verouderen, zijn moeilijk bereikbaar en vormen een gevaar om handmatig te inspecteren. Deze studie introduceert een nieuw type robot — klein genoeg om in leidingen te kruipen — die geavanceerde camerazicht en voorspellende software gebruikt om zichzelf door bochten, knikken en kruisingen te loodsen en problemen te signaleren voordat ze tot een ramp leiden.

Waarom in leidingen kijken zo moeilijk is

Verborgen leidingen strekken zich honderden kilometers uit onder straten, velden en fabrieken. Na verloop van tijd kunnen ze corroderen, barsten of verstopt raken, wat kan leiden tot lekkages, breuken of blokkades. Traditionele controles vertrouwen op mensen die camera’s of apparaten in putten laten zakken — een traag en risicovol karwei dat toch veel gebreken mist. Vroegere buisrobots verbeterden de veiligheid maar hadden moeite met krappe krommingen en veranderende buisdiameters. Hun wielen konden slippen, ze bleven vastlopen bij kruisingen en hun eenvoudige camera’s konden niet goed genoeg interpreteren wat ze zagen om zichzelf te sturen of operators vroegtijdig te waarschuwen voor opkomende problemen.

Een flexibele robot voor krappe ruimtes

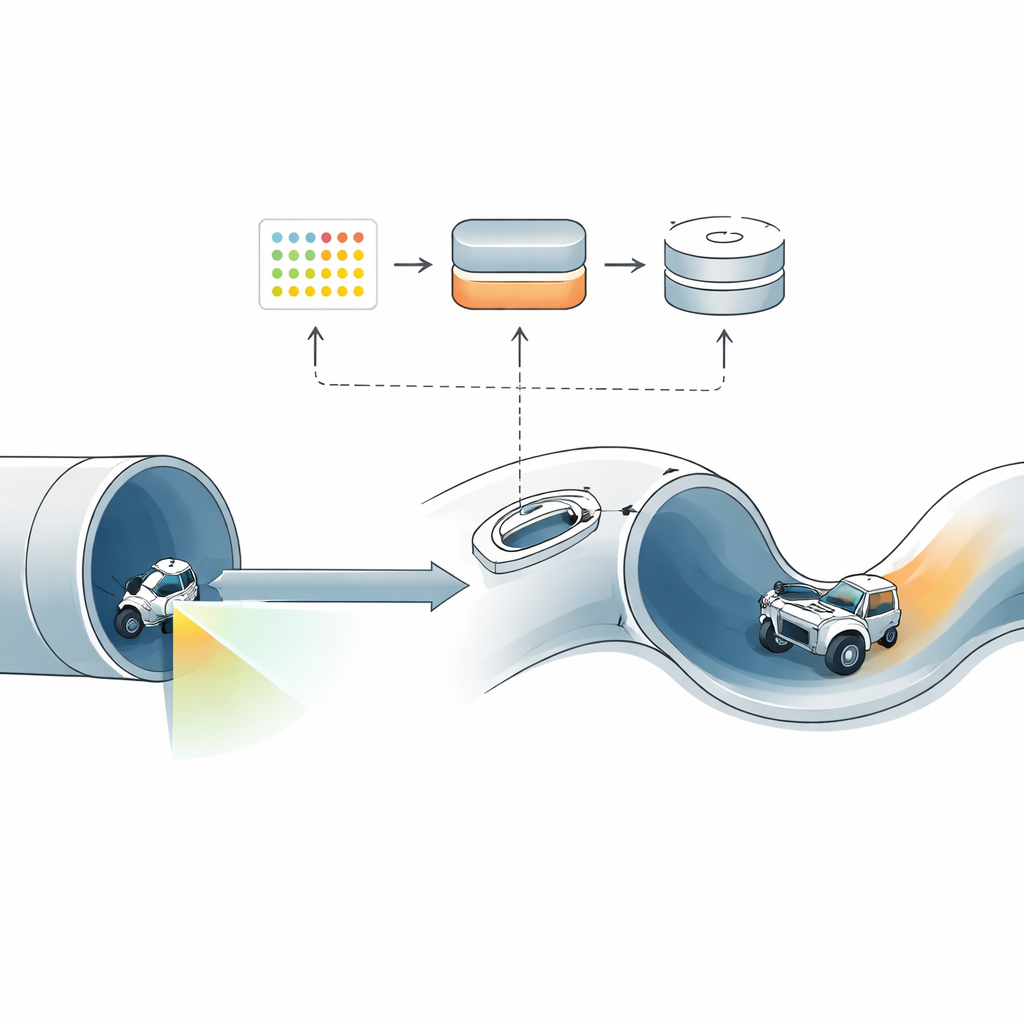

De onderzoekers ontwierpen een in‑buis inspectierobotsysteem, of IPIRS, dat specifiek is gebouwd voor smalle leidingen met een diameter tussen 10 en 15 centimeter. De robotkop bestaat uit vier korte modules die met veerbelaste scharnieren zijn verbonden. Deze scharnieren drukken de wielen zachtjes tegen de buiswand, wat de grip verbetert wanneer de buis buigt of de diameter verandert. Voor‑ en achtermodules bevatten kleine motoren die sturen en de houding van de robot aanpassen, waardoor hij scherpe hoeken en T‑kruisingen kan nemen. Aan boord kijkt een dieptesensorcamera vooruit terwijl een bewegingssensor bijhoudt hoe de robot helt, draait en accelereert; deze ruwe gegevens voeden het ‘digitale brein’ van het systeem.

De robot leren zien en vooruitdenken

Om ruwe camerabeelden om te zetten in bruikbare informatie gebruikte het team een moderne visiemethode bekend als YOLOv8. Getraind op duizenden gelabelde beelden uit realistische computersimulaties kan deze software onmiddellijk belangrijke buiseigenschappen herkennen, zoals eindes, uitgangen en verschillende kruisingstypen terwijl de robot voortbeweegt. In tests identificeerde het systeem deze structuren met zeer hoge nauwkeurigheid: ongeveer 98% op een standaard maat voor detectiekwaliteit en een F1‑score van 0,95 voor het totaalbeeld van treffers en missers. Dit betekent dat de robot in de meeste gevallen precies weet welk type buisfunctie zich voor hem bevindt en waar deze in het beeld staat.

Voorspellen van de inspanning om stabiel te blijven

Zien alleen is niet genoeg: wanneer de robot een bocht of een vertakking binnengaat veranderen de krachten op zijn scharnieren en wielen snel. Reageren de motoren te laat, dan kan de robot wiebelen, slippen of vastlopen. Om dit aan te pakken voegden de onderzoekers een tweede leermethode toe, een LSTM‑netwerk, dat korte geschiedenissen van bewegingssensorlezingen en motorinspanningen analyseert om te voorspellen hoeveel kracht in het volgende ogenblik nodig zal zijn. Deze voorspelde inspanning wordt vervolgens gecombineerd met een standaard regelkring die de scharnieren positioneert, waardoor de robot het koppel subtiel kan aanpassen voordat problemen ontstaan. In simulaties waren de voorspellingsfouten extreem klein, wat erop wijst dat het model kon anticiperen hoe hard de motoren moeten duwen om de beweging soepel te houden.

Het systeem testen in virtuele leidingen

Voordat er hardware werd gebouwd creëerde het team een gedetailleerde digitale tweeling van een buisnetwerk met behulp van het Robot Operating System en fysica‑gebaseerde simulators. De virtuele omgeving bevatte rechte stukken, bochten, verticale klimmen en meerdere soorten kruisingen. Hier konden ze veilig camera‑ en sensorgegevens verzamelen, hun modellen trainen en volledige systeemproeven uitvoeren. De gecombineerde waarnemings‑ en voorspellingsopzet stelde de robot in staat aankomende structuren te herkennen, te plannen hoe deze te passeren en zijn houding en motorinspanning in realtime aan te passen, daarbij rekening houdend met limieten voor wielsnelheid en koppel. Statistische controles toonden aan dat zowel de visie‑ als voorspellingscomponenten betrouwbaar presteerden over vele testruns, ondanks enige voorspelbare verwarring bij de visueel meest vergelijkbare kruisingstypen.

Wat dit betekent voor veiligere leidingen

De studie toont aan dat het combineren van een flexibele mechanische opbouw met slimme visie en voorspellende besturing in‑buisrobots veel capabeler kan maken dan eerdere ontwerpen. In simulatie navigeerde IPIRS door complexe buislay‑outs, herkende structurele kenmerken nauwkeurig en voorspelde hoe hard de motoren moesten werken — een combinatie die de stabiliteit verbetert en de weg vrijmaakt voor echte autonomie. Hoewel het werk tot nu toe virtueel is en echte leidingen extra uitdagingen toevoegen zoals roest, water en vuil, wijzen de resultaten op een duidelijke route naar compacte inspectierobots die niet alleen problemen in ondergrondse leidingen zien, maar ook vooruitdenken om vastlopen te voorkomen en zo vitale infrastructuur veiliger te houden.

Bronvermelding: Elkholy, H., Meligy, R., Bassiuny, A.M. et al. Design of an in-pipe inspection robotic system (IPIRS) with YOLOv8–LSTM integration for real-time in-pipe navigation. Sci Rep 16, 9658 (2026). https://doi.org/10.1038/s41598-026-42181-z

Trefwoorden: leidinginspectie, in‑buis robot, autonome navigatie, computerzicht, voorspellende besturing