Clear Sky Science · de

Entwurf eines In-Rohr-Inspektionsrobotersystems (IPIRS) mit YOLOv8–LSTM-Integration für die Echtzeitnavigation in Rohrleitungen

Roboter im Inneren der Rohrleitungen

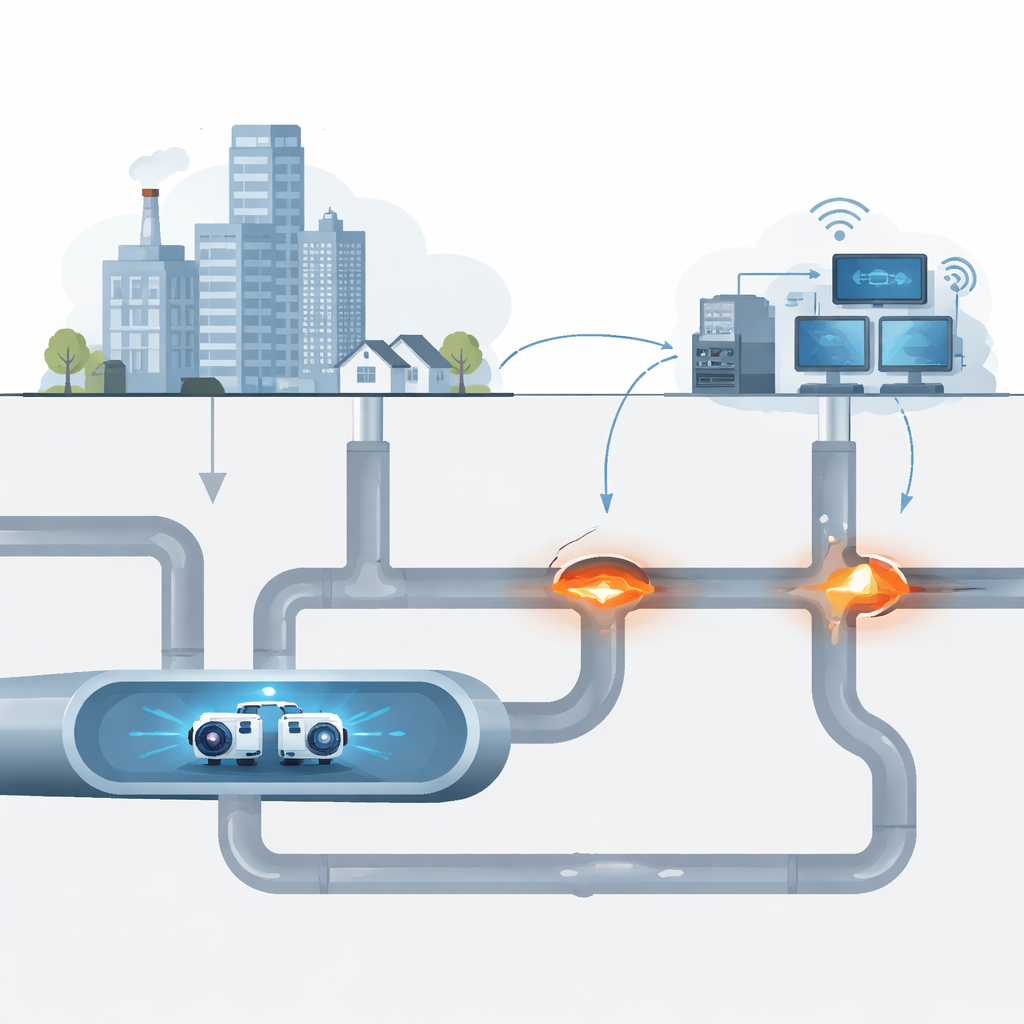

Tagtäglich liefern weiträumige unterirdische Rohrnetze stillschweigend das Öl, Gas und Wasser, von dem das moderne Leben abhängt. Viele dieser Leitungen sind in die Jahre gekommen, schwer zugänglich und gefährlich von Hand zu inspizieren. Diese Studie stellt eine neue Art von Roboter vor – klein genug, um im Inneren von Rohren zu kriechen – der fortschrittliche Kamerasehen und prädiktive Software nutzt, um sich durch Windungen, Bögen und Verzweigungen zu führen und Probleme zu erkennen, bevor sie zur Katastrophe werden.

Warum die Inspektion von Rohrleitungen so schwierig ist

Versteckte Rohrleitungen erstrecken sich Hunderte Kilometer unter Straßen, Feldern und Fabriken. Mit der Zeit können sie korrodieren, Risse bekommen oder verstopfen, was zu Lecks, Brüchen oder Blockaden führt. Traditionelle Kontrollen beruhen darauf, Kameras oder Geräte in Schächte herabzulassen – eine langsame und riskante Arbeit, die trotzdem viele Fehler übersieht. Frühere Rohrroboter verbesserten die Sicherheit, hatten aber Probleme mit engen Kurven und wechselnden Rohrdurchmessern. Ihre Räder konnten durchdrehen, sie blockierten an Verzweigungen, und ihre einfachen Kameras konnten das Gesehene nicht ausreichend gut interpretieren, um sich selbst zu steuern oder Betreiber rechtzeitig vor aufkommenden Problemen zu warnen.

Ein flexibler Roboter für enge Räume

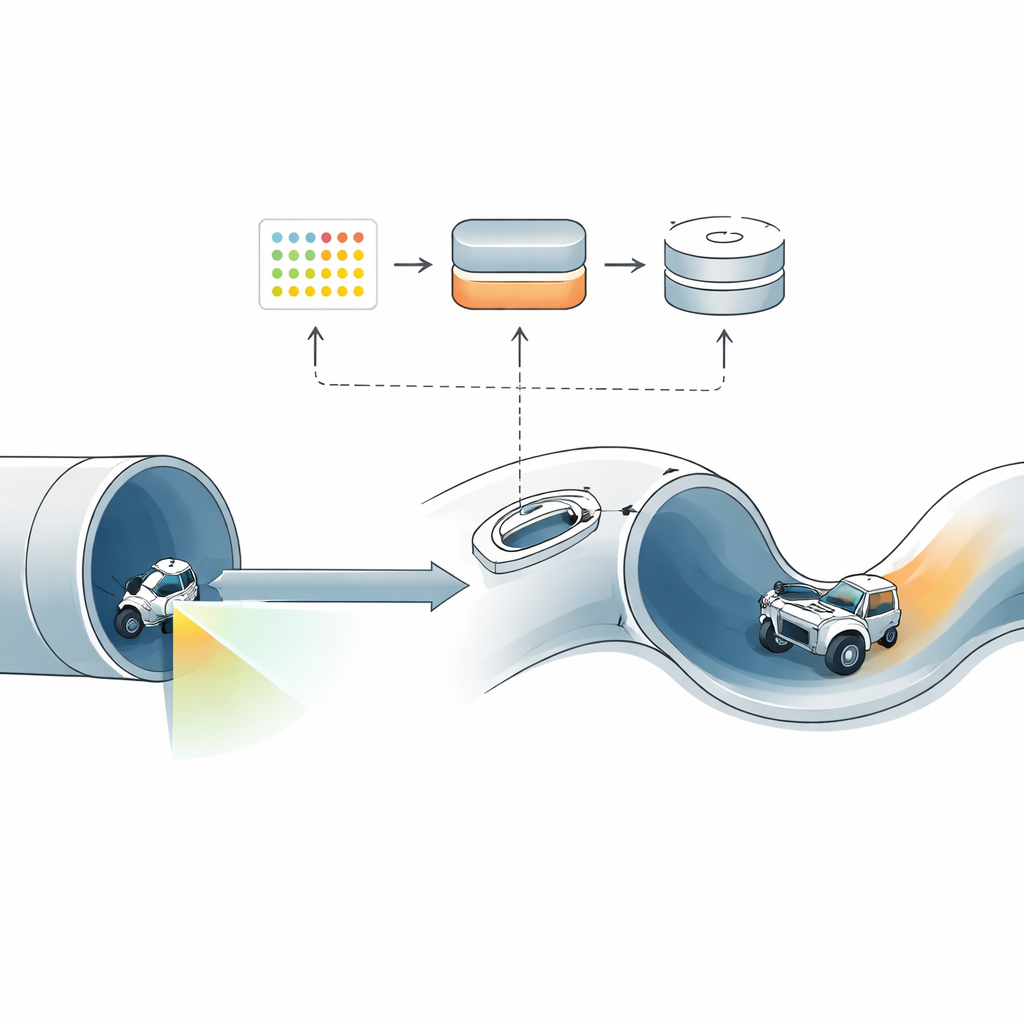

Die Forschenden entwarfen ein In‑Rohr-Inspektionsrobotersystem, kurz IPIRS, das speziell für schmale Rohre mit einem Durchmesser von 10 bis 15 Zentimetern ausgelegt ist. Der Roboterkörper besteht aus vier kurzen Modulen, die durch federbelastete Gelenke verbunden sind. Diese Gelenke drücken die Räder sanft gegen die Rohrwand und helfen dem Roboter, Griff zu behalten, wenn das Rohr sich krümmt oder der Durchmesser wechselt. Vorder- und Hintermodule enthalten kleine Motoren, die lenken und die Haltung des Roboters anpassen, sodass er scharfe Kurven und T‑Verzweigungen bewältigen kann. An Bord erfasst eine Tiefenkamera den Blick nach vorn, während ein Bewegungssensor die Neigung, Drehung und Beschleunigung des Roboters verfolgt und die Rohdaten für sein „digitales Gehirn“ liefert.

Den Roboter lehren, zu sehen und vorauszudenken

Um rohe Kamerabilder in nützliche Erkenntnisse zu verwandeln, nutzte das Team eine moderne Sehmethode namens YOLOv8. Auf Tausenden von beschrifteten Bildern aus realistischen Computersimulationen trainiert, kann diese Software sofort wichtige Rohrmerkmale wie Enden, Ausgänge und verschiedene Verzweigungsformen erkennen, während sich der Roboter bewegt. In Tests identifizierte sie diese Strukturen mit sehr hoher Genauigkeit, erreichte rund 98 % auf einer Standardmetrik für Erkennungsqualität und einen ausgewogenen Treffer‑/Fehlerrate (F1‑Score) von 0,95. Das bedeutet, dass der Roboter in den meisten Fällen genau weiß, um welches Rohrmerkmal es sich vor ihm handelt und wo es im Bild liegt.

Vorhersage des Aufwands für stabile Bewegung

Sehen allein reicht nicht: Wenn der Roboter in eine Kurve oder eine Verzweigung einfährt, ändern sich die Kräfte an Gelenken und Rädern schnell. Reagieren die Motoren zu spät, kann der Roboter schwanken, durchrutschen oder stehen bleiben. Um dem entgegenzuwirken, ergänzten die Forschenden ein zweites Lernwerkzeug, ein LSTM‑Netzwerk, das kurze Verlaufsdaten von Bewegungssensoren und Motorbelastungen betrachtet, um vorherzusagen, wie viel Kraft im nächsten Moment benötigt wird. Diese vorhergesagte Anstrengung wird dann mit einer Standardregelschleife kombiniert, die die Gelenkstellungen steuert, sodass der Roboter das Drehmoment subtil anpassen kann, bevor Probleme auftreten. In Simulationen waren die Vorhersagefehler äußerst gering, was darauf hindeutet, dass das Modell abschätzen kann, wie stark die Motoren arbeiten sollten, um eine gleichmäßige Bewegung zu gewährleisten.

Das System in virtuellen Rohren testen

Bevor Hardware gebaut wurde, erstellte das Team einen detaillierten digitalen Zwilling eines Rohrnetzes mithilfe des Robot Operating System und physikbasierter Simulatoren. Die virtuelle Umgebung umfasste gerade Abschnitte, Bögen, vertikale Steigungen und mehrere Arten von Verzweigungen. Hier konnten sie gefahrlos Kamera‑ und Sensordaten sammeln, ihre Modelle trainieren und dann Tests mit dem kompletten System durchführen. Die kombinierte Wahrnehmungs‑ und Vorhersagearchitektur ermöglichte es dem Roboter, bevorstehende Strukturen zu erkennen, zu planen, wie er sie passieren soll, und seine Haltung sowie Motorleistung in Echtzeit anzupassen – dabei wurden Grenzen für Radgeschwindigkeit und Drehmoment eingehalten. Statistische Prüfungen zeigten, dass sowohl die Vision‑ als auch die Vorhersagekomponenten über viele Testläufe hinweg zuverlässig arbeiteten, obwohl es bei den optisch ähnlichsten Verzweigungstypen zu erwartbaren Verwechslungen kam.

Was das für sicherere Rohrleitungen bedeutet

Die Studie zeigt, dass die Kombination aus einem flexiblen mechanischen Design mit smarter Sicht und prädiktiver Steuerung In‑Rohr‑Roboter deutlich leistungsfähiger machen kann als frühere Entwürfe. In Simulation navigierte IPIRS komplexe Rohrlayouts, erkannte strukturelle Merkmale zuverlässig und sagte voraus, wie hart seine Motoren arbeiten sollten – eine Kombination, die die Stabilität verbessert und den Weg zu echter Autonomie ebnet. Obwohl die bisherigen Ergebnisse virtuell sind und reale Rohre zusätzliche Herausforderungen wie Rost, Wasser und Ablagerungen mitbringen, deuten die Resultate auf einen klaren Pfad hin hin zu kompakten Inspektionsrobotern, die nicht nur Probleme in vergrabenen Leitungen sehen, sondern auch vorausschauend handeln, um ein Feststecken zu vermeiden und kritische Infrastrukturen sicherer zu machen.

Zitation: Elkholy, H., Meligy, R., Bassiuny, A.M. et al. Design of an in-pipe inspection robotic system (IPIRS) with YOLOv8–LSTM integration for real-time in-pipe navigation. Sci Rep 16, 9658 (2026). https://doi.org/10.1038/s41598-026-42181-z

Schlüsselwörter: Pipeline-Inspektion, In-Rohr-Roboter, autonome Navigation, Computer Vision, vorausschauende Steuerung