Clear Sky Science · fr

Conception d’un système robotique d’inspection dans les conduites (IPIRS) avec intégration YOLOv8–LSTM pour la navigation en temps réel à l’intérieur des tuyaux

Des robots à l’intérieur des conduites

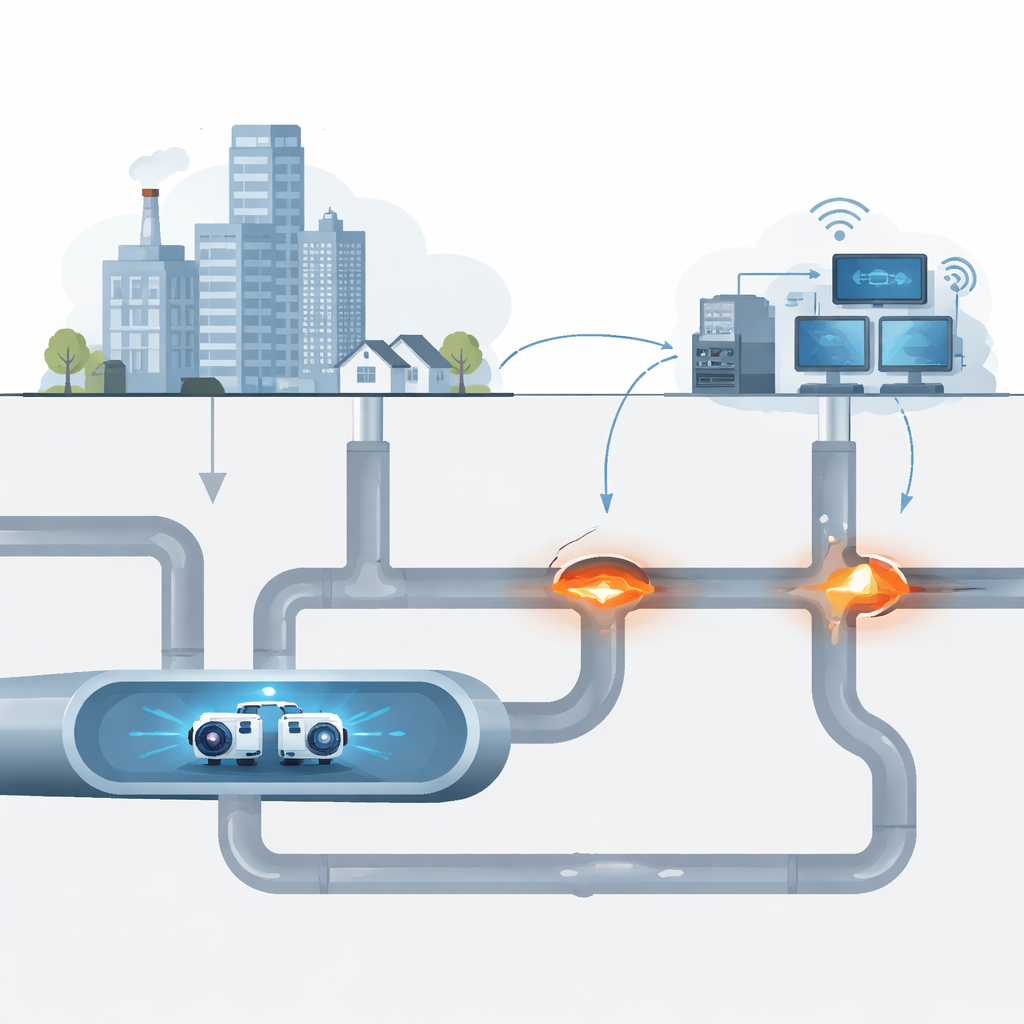

Chaque jour, d’immenses réseaux de conduites enfouies acheminent discrètement le pétrole, le gaz et l’eau dont dépend la vie moderne. Beaucoup de ces pipelines vieillissent, sont difficiles d’accès et dangereux à inspecter manuellement. Cette étude présente un nouveau type de robot — suffisamment petit pour se faufiler à l’intérieur des tuyaux — qui utilise une vision par caméra avancée et des logiciels prédictifs pour se guider à travers coudes, courbes et jonctions tout en détectant les problèmes avant qu’ils ne deviennent catastrophiques.

Pourquoi il est si difficile d’examiner l’intérieur des tuyaux

Des réseaux de conduites cachés s’étendent sur des centaines de kilomètres sous des rues, des champs et des usines. Avec le temps, ils peuvent corroder, se fissurer ou s’encrasser, provoquant fuites, ruptures ou obstructions. Les contrôles traditionnels reposent sur des personnes descendant des caméras ou des appareils dans des regards, un travail lent et risqué qui manque encore de nombreux défauts. Les premiers robots pour conduites ont amélioré la sécurité mais peinaient dans les courbes serrées et face aux diamètres variables. Leurs roues pouvaient patiner, ils se coinçaient aux jonctions, et leurs caméras basiques n’interprétaient pas assez bien ce qu’elles voyaient pour se guider ou alerter précocement les opérateurs sur des problèmes naissants.

Un robot flexible conçu pour les espaces étroits

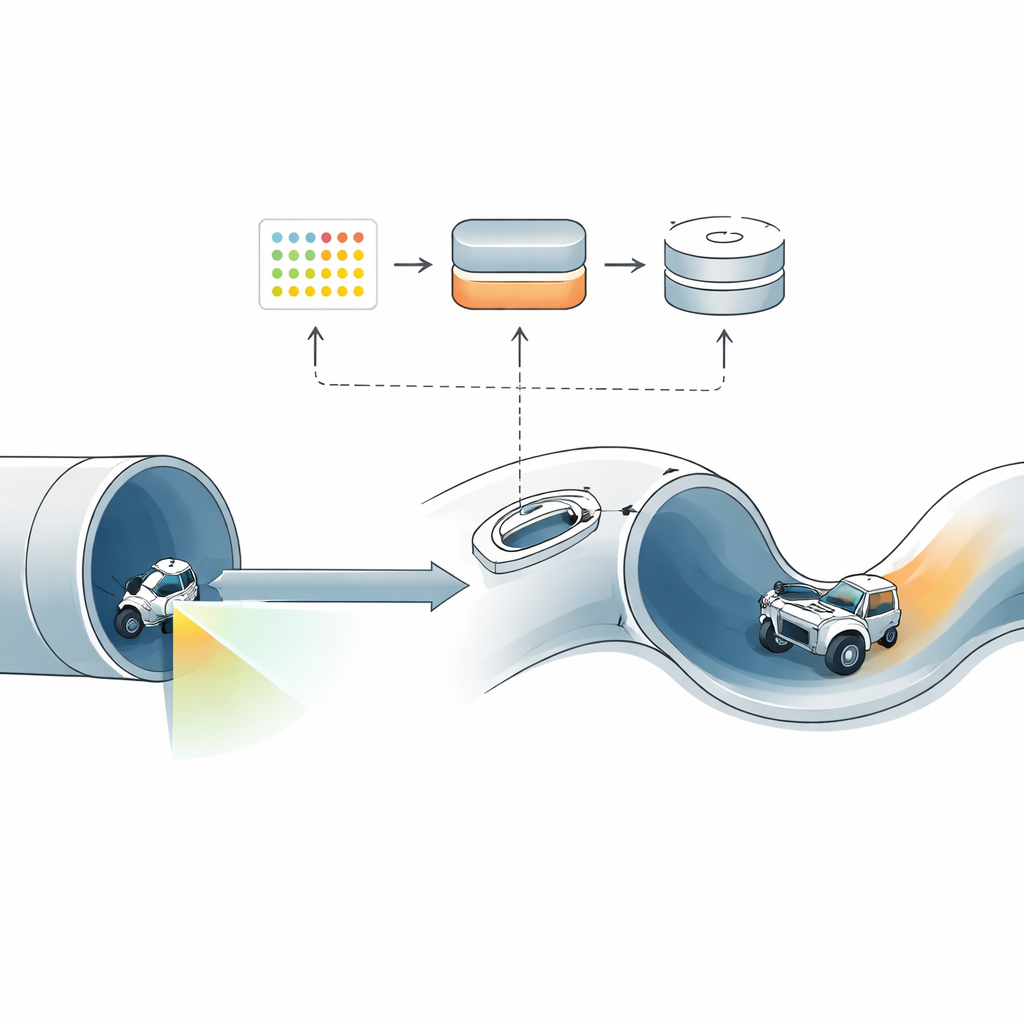

Les chercheurs ont conçu un système robotique d’inspection dans les conduites, ou IPIRS, spécialement adapté aux tuyaux étroits de 10 à 15 centimètres de diamètre. Le corps du robot est composé de quatre modules courts reliés par des articulations à ressort. Ces articulations pressent les roues contre les parois du tuyau, aidant le robot à s’agripper lorsque la conduite se courbe ou que son diamètre change. Les modules avant et arrière contiennent de petits moteurs qui orientent et ajustent la posture du robot, lui permettant de négocier des virages serrés et des jonctions en T. À bord, une caméra à détection de profondeur regarde devant tandis qu’un capteur de mouvement suit l’inclinaison, la rotation et l’accélération du robot, fournissant les données brutes pour son « cerveau numérique ».

Apprendre au robot à voir et à anticiper

Pour transformer des images brutes en compréhension utile, l’équipe a utilisé une méthode de vision moderne connue sous le nom de YOLOv8. Entraîné sur des milliers d’images annotées issues de simulations informatiques réalistes, ce logiciel peut repérer instantanément des caractéristiques clés des conduites, telles que les terminaisons, les sorties et les différentes formes de jonction au fur et à mesure que le robot avance. Lors des tests, il a identifié correctement ces structures avec une très grande précision, obtenant environ 98 % sur une mesure standard de qualité de détection et un score F1 global de 0,95. Cela signifie que la plupart du temps, le robot sait exactement quel type de caractéristique de conduite se trouve devant lui et où elle apparaît dans l’image.

Prédire l’effort nécessaire pour rester stable

Voir ne suffit pas : lorsque le robot entre dans une courbe ou une section branchée, les forces sur ses articulations et ses roues changent rapidement. Si les moteurs réagissent trop tard, le robot peut osciller, patiner ou caler. Pour y remédier, les chercheurs ont ajouté un deuxième outil d’apprentissage appelé réseau LSTM, qui examine de courtes séries d’enregistrements des capteurs de mouvement et des efforts moteurs pour prédire combien de force sera nécessaire à l’instant suivant. Cet effort prédit est ensuite combiné à une boucle de commande standard qui positionne les articulations, permettant au robot d’ajuster subtilement le couple avant que les problèmes n’apparaissent. Dans les simulations, les erreurs de prédiction étaient extrêmement faibles, indiquant que le modèle pouvait anticiper la puissance nécessaire aux moteurs pour maintenir un mouvement fluide.

Mettre le système à l’épreuve dans des conduites virtuelles

Avant de construire le matériel, l’équipe a créé un jumeau numérique détaillé d’un réseau de conduites en utilisant le Robot Operating System et des simulateurs basés sur la physique. L’environnement virtuel comprenait des sections droites, des coudes, des montées verticales et plusieurs types de jonctions. Là, ils ont pu collecter en toute sécurité des données de caméra et de capteurs, entraîner leurs modèles, puis exécuter des essais du système complet. L’ensemble perception–prédiction a permis au robot de reconnaître les structures à venir, de planifier comment les franchir et d’ajuster sa posture et l’effort moteur en temps réel, tout en respectant les limites de vitesse de roue et de couple. Les contrôles statistiques ont montré que les composants de vision et de prédiction se comportaient de manière fiable sur de nombreuses exécutions, malgré une certaine confusion prévisible sur les types de jonctions les plus visuellement similaires.

Ce que cela signifie pour des pipelines plus sûrs

Cette étude montre que l’association d’une conception mécanique flexible avec une vision intelligente et une commande prédictive peut rendre les robots d’inspection dans les conduites bien plus performants que les conceptions antérieures. En simulation, l’IPIRS a navigué dans des configurations de tuyauterie complexes tout en reconnaissant avec précision les caractéristiques structurelles et en prévoyant l’effort requis des moteurs, une combinaison qui améliore la stabilité et prépare le terrain pour une véritable autonomie. Bien que le travail soit pour l’instant virtuel et que les conduites réelles apporteront des défis supplémentaires comme la rouille, l’eau et les débris, les résultats suggèrent une voie claire vers des robots d’inspection compacts qui non seulement détectent les problèmes à l’intérieur des pipelines enfouis, mais anticipent aussi pour éviter de se coincer tout en rendant les infrastructures critiques plus sûres.

Citation: Elkholy, H., Meligy, R., Bassiuny, A.M. et al. Design of an in-pipe inspection robotic system (IPIRS) with YOLOv8–LSTM integration for real-time in-pipe navigation. Sci Rep 16, 9658 (2026). https://doi.org/10.1038/s41598-026-42181-z

Mots-clés: inspection de pipeline, robot d’intérieur de conduite, navigation autonome, vision par ordinateur, commande prédictive