Clear Sky Science · it

Inferenza basata su simulazioni al limite teorico per MRI microstrutturale rapida e robusta con dati di diffusione minimi

Perché le scansioni cerebrali più rapide sono importanti

La risonanza magnetica (MRI) può rivelare dettagli fini del tessuto cerebrale, ma le scansioni più informative sono spesso lente e rumorose. Tempi di acquisizione lunghi sono scomodi per i pazienti, difficili da inserire in ospedali affollati e quasi impossibili per bambini o persone molto malate. Questo studio pone una domanda semplice dalle grandi conseguenze: è possibile usare simulazioni informatiche intelligenti e intelligenza artificiale per ottenere le stesse informazioni ricche da scansioni di diffusion MRI molto più brevi e più rumorose, senza sacrificare l’affidabilità?

Guardare dentro il cervello con l’acqua in movimento

La diffusion MRI traccia come le molecole d’acqua oscillano e si spostano all’interno del tessuto cerebrale. Poiché l’acqua si muove in modo diverso lungo le fibre nervose, attraverso i corpi cellulari o intorno a aree danneggiate, questi schemi possono funzionare come un’impronta della microstruttura cerebrale. Nel tempo, gli scienziati hanno sviluppato diverse famiglie di modelli per trasformare i segnali di diffusione in mappe delle proprietà tissutali. Approcci più semplici, come la diffusion tensor imaging, riassumono quanto facilmente l’acqua si muove e quanto è direzionale quel movimento. Metodi più avanzati, come la diffusion kurtosis imaging e modelli biofisici come CHARMED e AxCaliber, mirano a catturare dettagli come la densità delle fibre e persino i diametri tipici degli assoni. Queste mappe potrebbero fungere da “biopsie virtuali”, offrendo indizi sulla malattia senza chirurgia—ma di solito richiedono molte misurazioni ripetute e scansioni lunghe.

Il collo di bottiglia dell’adattamento tradizionale

Trasformare misure grezze di diffusione in mappe significative è un problema di ottimizzazione matematica: i parametri del modello vengono regolati finché il segnale predetto non corrisponde a quello rilevato dallo scanner. Gli strumenti più comuni oggi, come i minimi quadrati non lineari, lo fanno minimizzando la differenza al quadrato tra modello e dati. Pur essendo semplici e ampiamente disponibili, questi metodi funzionano meglio quando ci sono molte più misurazioni di quelle strettamente necessarie—l’equivalente, in termini di tempo di scansione, di scattare dieci volte più foto per stare sul sicuro. Inoltre faticano quando il rumore è elevato o quando le stime iniziali sono scarse, cosa comune nei dati clinici reali. Approcci statistici più recenti possono aiutare ma sono spesso lenti, sensibili alle assunzioni sul rumore e raramente usati al di fuori dei centri di ricerca.

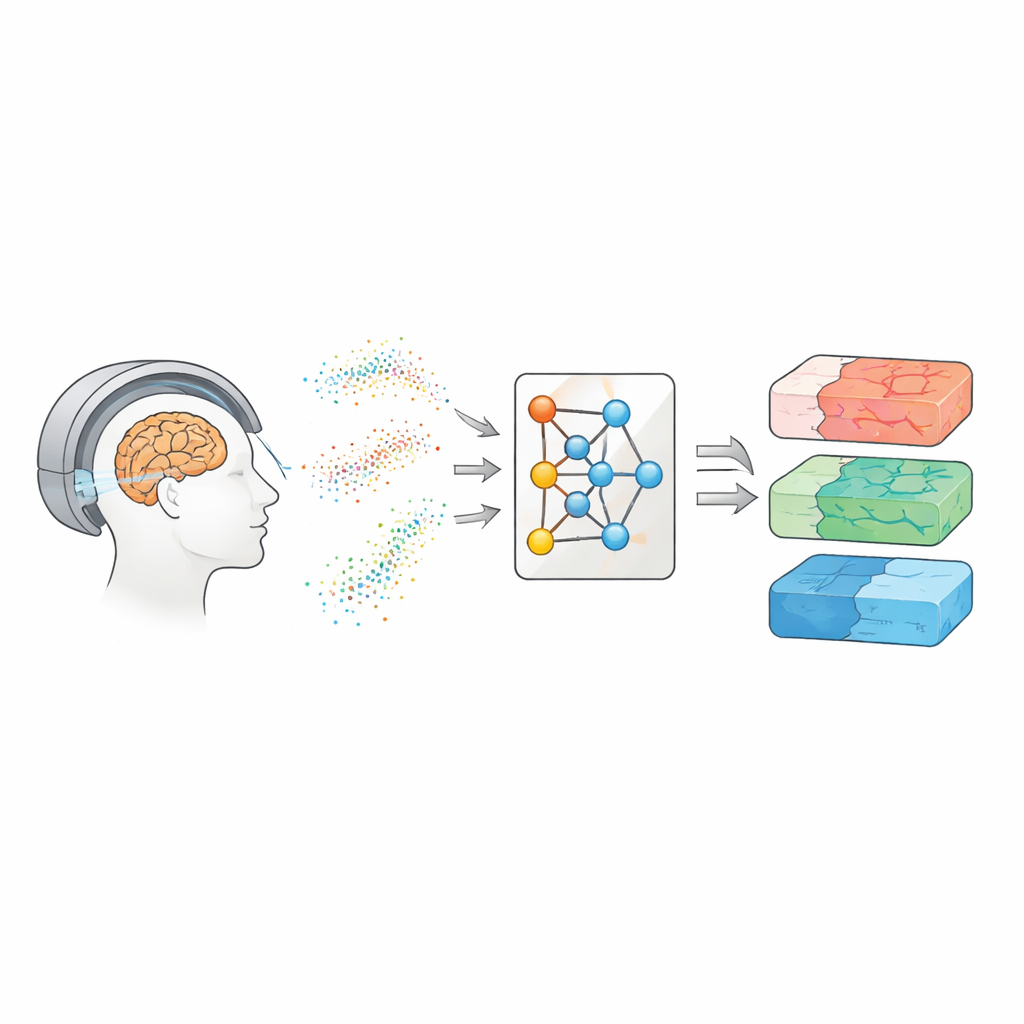

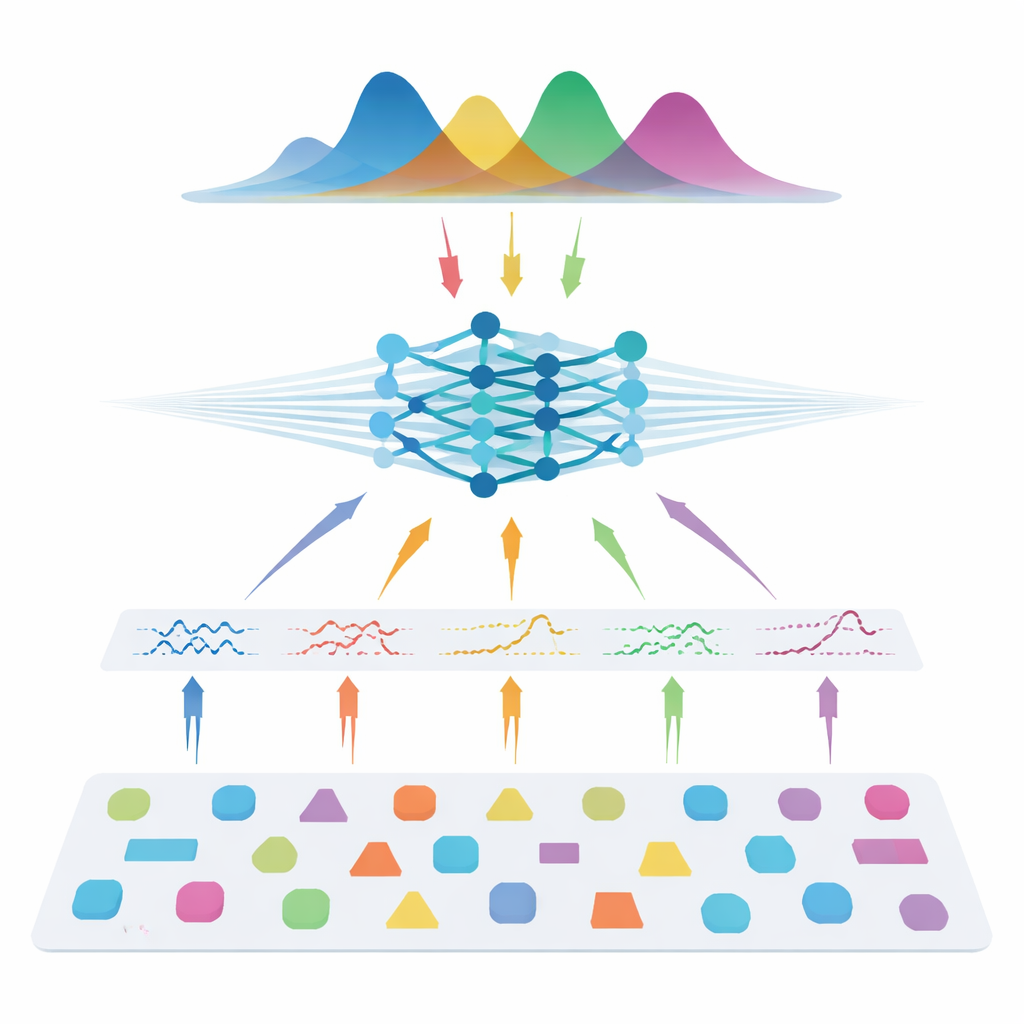

Imparare dalle simulazioni invece che dai pazienti

Gli autori seguono una strada diversa: invece di imparare direttamente dalle scansioni dei pazienti, addestrano una rete neurale usando interamente dati simulati. Estraggono molte possibili combinazioni di parametri del modello, utilizzano la fisica nota della diffusione per generare segnali sintetici, aggiungono rumore realistico e poi addestrano un cosiddetto stimatore posteriore neurale. Questa rete impara a produrre una distribuzione di probabilità completa sui parametri che potrebbero aver generato un dato segnale, fornendo naturalmente sia una stima migliore sia una misura di incertezza. Per rendere il metodo flessibile rispetto a diverse impostazioni di scanner, il team non usa le misure grezze. Invece comprimono ogni segnale in caratteristiche compatte e informate dalla fisica che riassumono come varia con l’intensità del gradiente, la direzione e il tempo di diffusione. Queste caratteristiche catturano l’essenza del segnale pur rimanendo in gran parte indipendenti dallo schema di acquisizione esatto.

Pari ai migliori con una frazione dei dati

Una volta addestrato, il sistema viene testato sia su dati sintetici con “verità di riferimento” nota sia su diversi dataset umani, compresi volontari sani e persone con sclerosi multipla. In tutte e tre le famiglie di modelli—diffusion tensor imaging, diffusion kurtosis imaging e AxCaliber—l’approccio basato su simulazioni recupera metriche microstrutturali chiave con precisione anche quando si utilizzano appena 7–22 misurazioni invece di protocolli completi con 69–271 misurazioni. Questo può significare fino al 90% in meno di scansioni. In condizioni rumorose o quando il numero di misurazioni è fortemente ridotto, il nuovo metodo supera costantemente l’adattamento standard, producendo mappe più pulite che preservano strutture importanti. Inoltre rileva i cambiamenti attesi all’interno delle lesioni da sclerosi multipla e recupera i pattern noti delle dimensioni degli assoni nel corpo calloso, suggerendo che si generalizza bene sia su tessuto sano sia malato.

Cosa significa per pazienti e cliniche

Per i non specialisti, la conclusione è che gli autori dimostrano come ottenere una vista quasi equivalente della microstruttura cerebrale a partire da scansioni di diffusion MRI molto più brevi e potenzialmente di qualità inferiore facendo grande affidamento su simulazioni e inferenza avanzata. Invece di chiedere allo scanner più dati, chiedono ai computer di usare meglio meno dati. Ciò potrebbe ridurre i tempi degli esami, ampliare l’accesso a imaging avanzato negli ospedali di routine e persino recuperare studi più vecchi acquisiti con impostazioni subottimali. Poiché il metodo è addestrato interamente su segnali simulati, è anche rispettoso della privacy e più facile da condividere e scalare. Se adottato su larga scala, questo stile di inferenza basata su simulazioni potrebbe contribuire a colmare il divario tra protocolli di ricerca all’avanguardia e la MRI clinica quotidiana, avvicinando le biopsie tissutali virtuali alla pratica standard.

Citazione: Eggl, M.F., De Santis, S. Simulation-based inference at the theoretical limit for fast, robust microstructural MRI with minimal diffusion data. Commun Med 6, 275 (2026). https://doi.org/10.1038/s43856-026-01614-6

Parole chiave: diffusione MRI, microstruttura cerebrale, inferenza basata su simulazioni, reti neurali, riduzione del tempo di scansione