Clear Sky Science · it

MSF-VMDNet per la segmentazione multiclass delle immagini a intera vetrino del cancro della pelle tramite una rete a doppio codificatore multifrequenza

Perché mappare il cancro della pelle è importante

Quando i medici diagnosticano il cancro della pelle, spesso esaminano immagini microscopiche ultra‑dettagliate di fette di tessuto colorate. Queste immagini mostrano non solo il tumore, ma anche molti tipi di strutture cutanee normali strettamente intrecciate. Tracciare manualmente confini precisi intorno a ciascuna regione è lento e può variare da uno specialista all'altro. Questo studio presenta un nuovo metodo informatico progettato per separare automaticamente questi tessuti intrecciati con elevata accuratezza, risparmiando tempo e rendendo le diagnosi più coerenti.

Da semplici macchie a tessuti intricati

Il cancro della pelle è tra i tumori più comuni al mondo, favorito in parte dall'aumento dell'esposizione ai raggi ultravioletti. La diagnosi moderna di solito inizia con la dermoscopia, un tipo speciale di fotografia cutanea ingrandita, e spesso prosegue con una biopsia: un piccolo frammento di pelle viene asportato, colorato ed esaminato al microscopio. In queste immagini a intera vetrino, i tumori si snodano attraverso strati come l'epidermide, tessuto connettivo profondo, follicoli piliferi, ghiandole sudoripare e tessuto adiposo. Molte di queste regioni appaiono simili per colore e texture, e i loro confini possono essere sfumati, rendendo difficile anche per gli esperti separare chiaramente tumore e tessuto sano.

Un nuovo modo di leggere immagini complesse

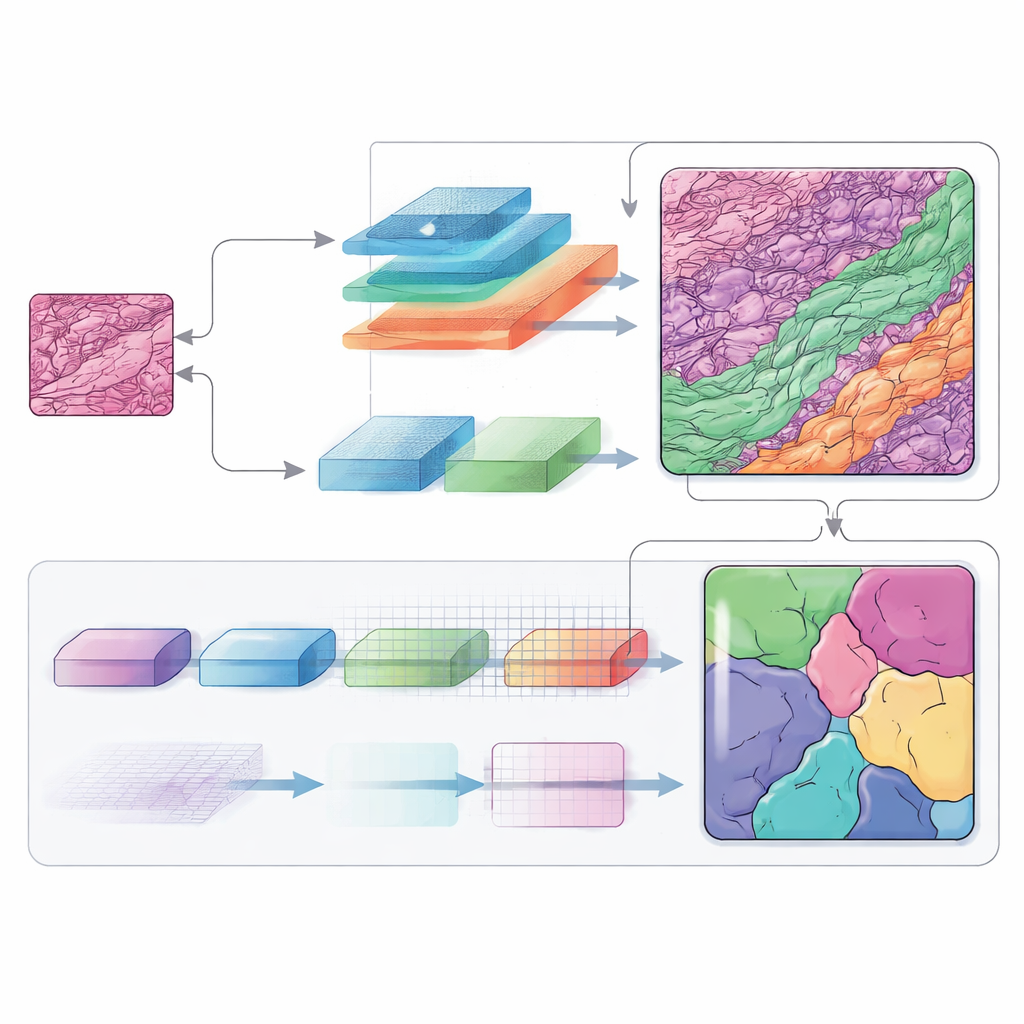

La maggior parte degli strumenti informatici precedenti ha trattato il problema come il colorare un'immagine con solo due matite: “lesione” e “non lesione”. Questo può funzionare per foto di superficie più semplici, ma fallisce quando è necessario dividere una vetrino in molti tipi tissutali contemporaneamente. Gli autori si concentrano su un set di dati impegnativo di tumori cutanei non‑melanoma in cui ogni immagine deve essere suddivisa in fino a dieci classi tissutali distinte. Il loro obiettivo è costruire un sistema in grado di comprendere la disposizione globale del tessuto catturando al contempo dettagli minuti lungo i bordi — qualcosa che le reti neurali tradizionali faticano spesso a bilanciare.

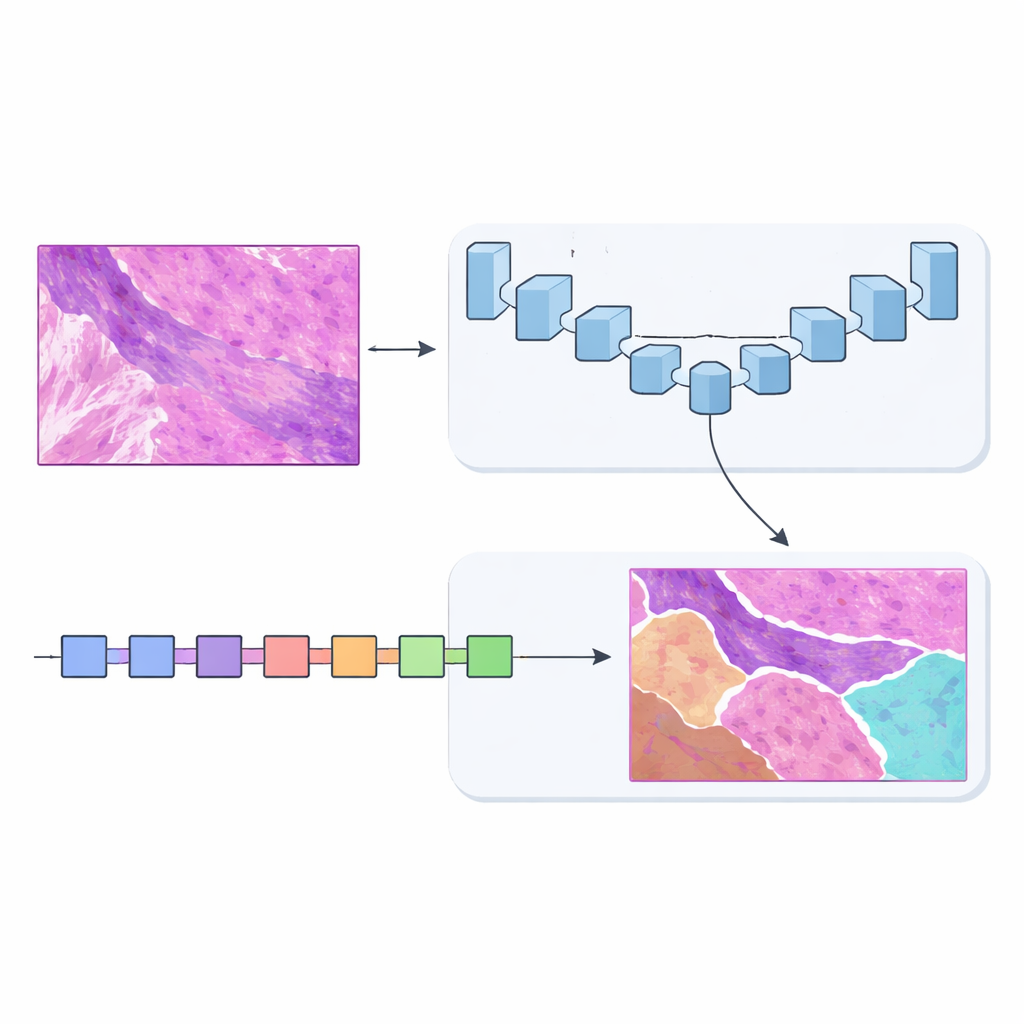

Due cervelli valgono meglio di uno

Per risolvere questo problema, il team ha progettato MSF‑VMDNet, una rete a doppio codificatore che può essere vista come due “cervelli” complementari che esaminano la stessa vetrino in parallelo. Un ramo si basa su U‑Net, un modello popolare per l'imaging medico che eccelle nel catturare dettagli locali fini. Gli autori lo potenziano con un modulo spettrale che converte l'immagine in una collezione di frequenze — alcune descrivono variazioni lente e uniformi, altre catturano bordi netti e texture — quindi le ricombina per rafforzare i confini delle classi. Contemporaneamente, un secondo ramo costruito su un approccio più recente chiamato Vision Mamba scansiona la vetrino in modo più efficiente, modellando relazioni a lungo raggio così che regioni distanti ma correlate possano informarsi a vicenda.

Ascoltare molte frequenze contemporaneamente

L'informazione in frequenza gioca un ruolo centrale in questa architettura. Muovendosi tra lo spazio immagine ordinario e una visione basata sulle frequenze, la rete può trattare in modo diverso forme ampie e strutture minute. I componenti a bassa frequenza le consentono di comprendere la disposizione complessiva del tumore e degli strati cutanei circostanti, mentre i componenti ad alta frequenza affilano i bordi dove un tipo di tessuto termina e un altro inizia. Moduli progettati con cura fondono nuovamente queste viste in una mappa spaziale, e un blocco di decodifica aggiuntivo (chiamato SCConv) filtra i segnali ridondanti potenziando i pattern veramente informativi. Il risultato è una mappa di ciascuna regione tissutale più pulita e più sicura.

Quanto funziona bene nella pratica?

I ricercatori hanno testato MSF‑VMDNet sul dataset di tumori cutanei non‑melanoma e lo hanno confrontato con una vasta gamma di modelli di segmentazione leader, inclusi U‑Net classico, metodi basati su Transformer e altri ibridi Vision Mamba. Il loro sistema ha prodotto contorni tumorali più chiari e meno errori in aree delicate dove tumore, follicoli piliferi e tessuto infiammato si intrecciano. Su misure di sovrapposizione standard, ha superato tutti i concorrenti, raggiungendo circa il 95 percento di concordanza con le maschere disegnate dagli esperti. Per verificare se il metodo generalizza oltre un singolo laboratorio e un tipo di tumore, il team lo ha valutato anche su tre raccolte aggiuntive: foto dermoscopiche di lesioni cutanee, immagini microscopiche di diversi tipi di nuclei cellulari e scansioni TC di organi addominali. In tutti i casi il metodo è rimasto altamente preciso e ha superato statisticamente baseline robuste.

Cosa significa per pazienti e medici

In termini semplici, MSF‑VMDNet è un cartografo automatizzato per immagini mediche in grado di separare i tumori dal paesaggio affollato del tessuto normale con precisione insolita. Pur non sostituendo il giudizio dei patologi, può fornire un punto di partenza rapido e dettagliato, riducendo lo sforzo manuale richiesto e aiutando a garantire che zone tumorali sottili non vengano trascurate. Poiché lo stesso approccio funziona bene su tipi molto diversi di immagini mediche, potrebbe diventare uno strumento versatile per molti compiti diagnostici. Con ulteriori sviluppi e l'integrazione di informazioni cliniche, sistemi come questo potrebbero supportare una stadiazione del cancro cutaneo più affidabile e, in ultima analisi, scelte terapeutiche meglio informate.

Citazione: Zhang, J., Pu, Q., Tian, J. et al. MSF-VMDNet for multi class segmentation of skin cancer whole slide images using a multi frequency dual encoder network. Sci Rep 16, 11722 (2026). https://doi.org/10.1038/s41598-026-40044-1

Parole chiave: imaging del cancro della pelle, segmentazione di immagini mediche, deep learning in patologia, analisi istopatologica, diagnostica AI