Clear Sky Science · de

MSF-VMDNet für die Mehrklassen-Segmentierung von Ganzschnittbildern bei Hautkrebs mithilfe eines Multi-Frequenz-Dual-Encoder-Netzwerks

Warum die Kartierung von Hautkrebs wichtig ist

Wenn Ärzte Hautkrebs diagnostizieren, betrachten sie häufig ultradetaillierte Mikroskopbilder gefärbter Gewebeschnitte. Diese Bilder zeigen nicht nur den Tumor, sondern auch viele Arten normaler Hautstrukturen, die eng miteinander verwoben sind. Präzise Grenzen um jede Region von Hand zu ziehen ist zeitaufwändig und kann zwischen Spezialisten variieren. Diese Studie stellt eine neue Computermethode vor, die darauf ausgelegt ist, diese vernetzten Gewebe automatisch mit sehr hoher Genauigkeit zu trennen — was Zeit sparen und Diagnosen konsistenter machen könnte.

Von einfachen Flecken zu verflochtenem Gewebe

Hautkrebs gehört weltweit zu den häufigsten Krebserkrankungen, teilweise bedingt durch vermehrte UV-Exposition. Die moderne Diagnose beginnt meist mit der Dermoskopie, einer vergrößerten Hautaufnahme, und führt häufig zu einer Biopsie: Ein kleines Hautstück wird entnommen, gefärbt und unter dem Mikroskop untersucht. In diesen Ganzschnittbildern durchziehen Tumoren Schichten wie die oberste Hautschicht, tieferes Bindegewebe, Haarfollikel, Schweißdrüsen und Fett. Viele dieser Bereiche ähneln sich in Farbe und Textur, und ihre Grenzen können unscharf sein, sodass es selbst Experten schwerfällt, Tumor und gesundes Gewebe klar zu trennen.

Eine neue Art, komplexe Bilder zu lesen

Die meisten früheren Computerwerkzeuge behandelten das Problem wie das Ausmalen eines Bildes mit nur zwei Farben: „Pathologie“ und „keine Pathologie“. Das mag bei einfacheren Oberflächenfotos funktionieren, versagt jedoch, wenn ein Schnitt gleichzeitig in viele Gewebetypen unterteilt werden muss. Die Autorinnen und Autoren konzentrieren sich auf einen anspruchsvollen Datensatz zu Nicht‑Melanom‑Hautkrebs, in dem jedes Bild in bis zu zehn verschiedene Gewebeklassen aufgeteilt werden muss. Ihr Ziel ist es, ein System zu entwickeln, das das Gesamtgefüge des Gewebes versteht und zugleich winzige Details an den Grenzen erfasst — eine Balance, die traditionelle neuronale Netze oft schwerfällt.

Zwei Gehirne sind besser als eins

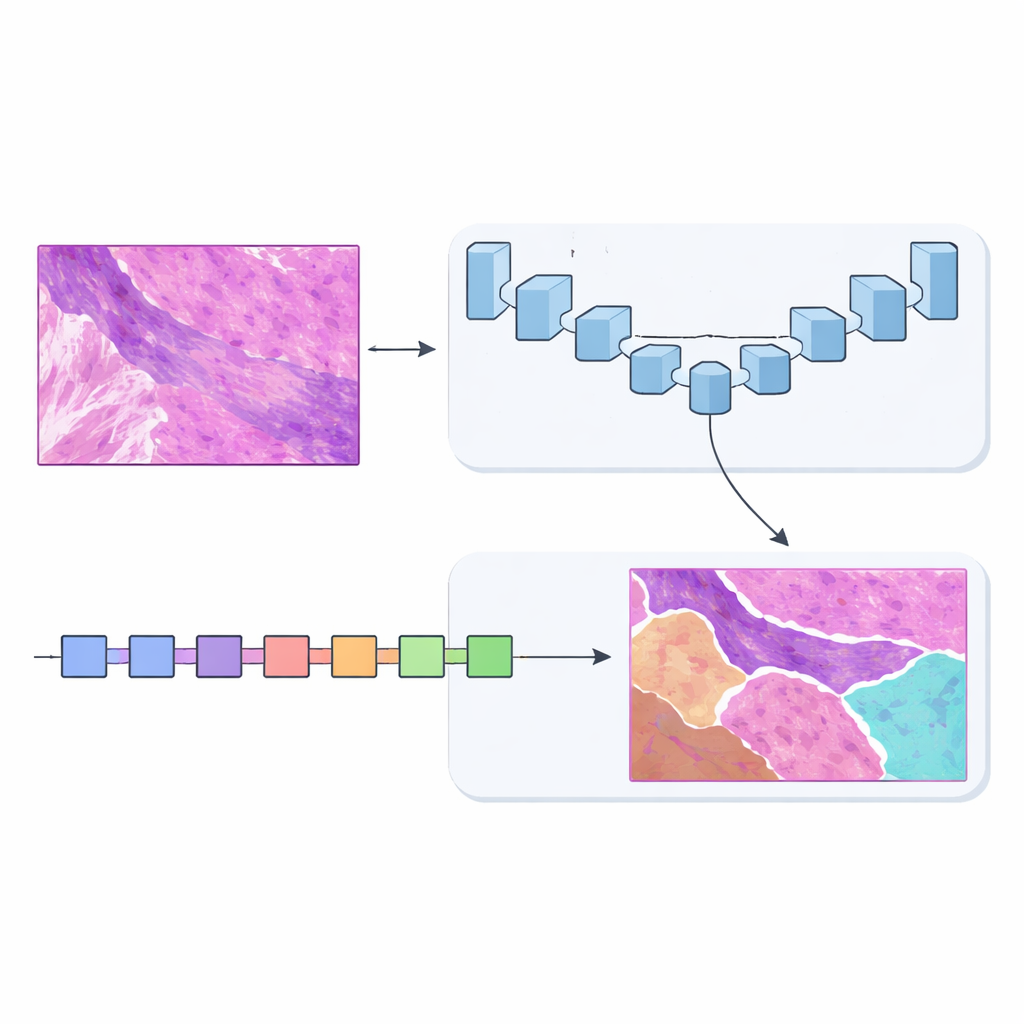

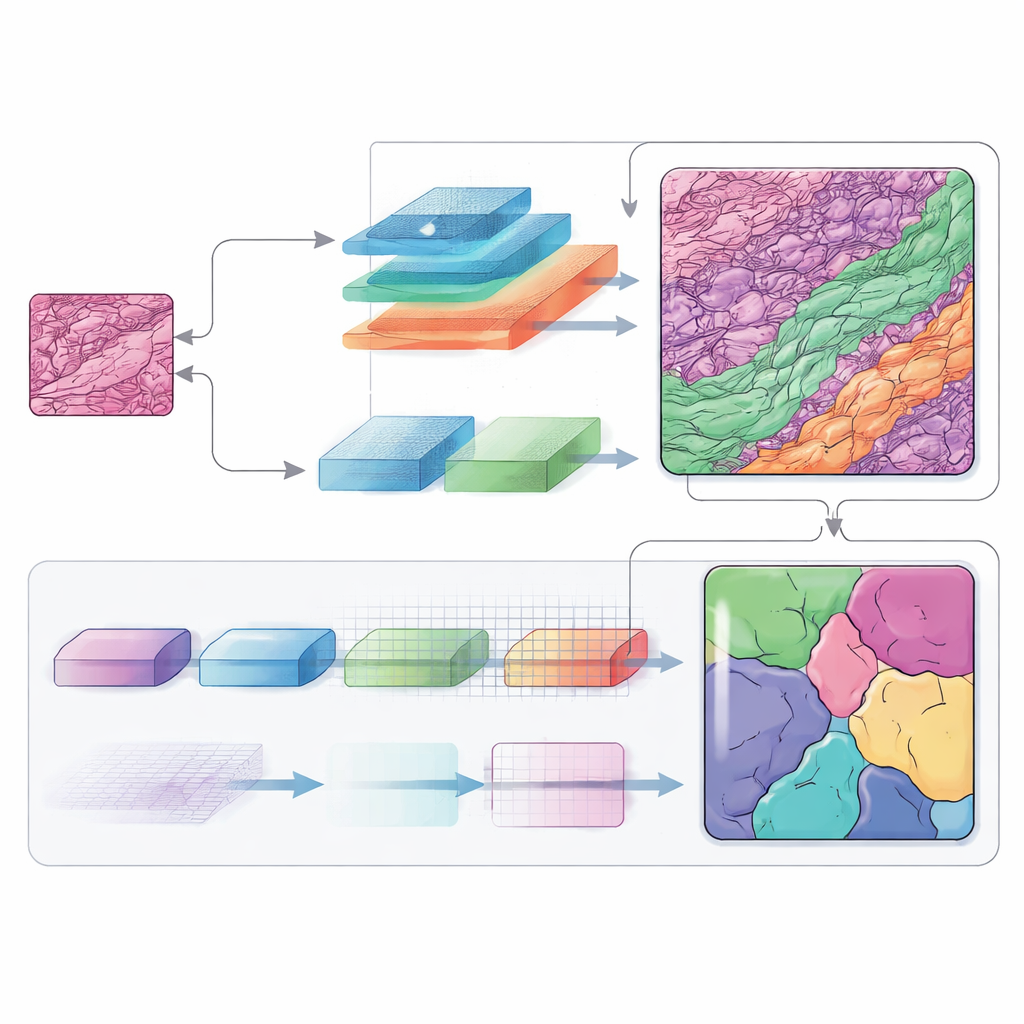

Um dieses Problem zu lösen, entwarf das Team MSF‑VMDNet, ein Dual‑Encoder‑Netzwerk, das man sich als zwei komplementäre „Gehirne“ vorstellen kann, die dieselbe Probe parallel untersuchen. Ein Zweig basiert auf U‑Net, einem in der medizinischen Bildgebung beliebten Modell, das feinste lokale Details gut erfasst. Die Autorinnen und Autoren ergänzen es um ein spektrales Modul, das das Bild in eine Sammlung von Frequenzen überführt — einige beschreiben langsame, glatte Veränderungen, andere erfassen scharfe Kanten und Texturen — und diese dann wieder zusammenführt, um Klassengrenzen zu verstärken. Zur gleichen Zeit durchläuft ein zweiter Zweig, der auf einem neueren Ansatz namens Vision Mamba beruht, das Bild in einer effizienteren Weise und modelliert langreichweitige Beziehungen, sodass entfernte, aber zusammenhängende Bereiche sich gegenseitig informieren können.

Viele Frequenzen gleichzeitig hören

Frequenzinformationen spielen in dieser Architektur eine zentrale Rolle. Durch das Wechseln zwischen dem gewöhnlichen Bildraum und einer frequenzbasierten Sicht kann das Netzwerk breite Formen und feine Strukturen unterschiedlich behandeln. Niedrigfrequente Komponenten helfen ihm, die Gesamtstruktur des Tumors und der umgebenden Hautschichten zu verstehen, während hochfrequente Komponenten die Kanten schärfen, an denen ein Gewebetyp endet und ein anderer beginnt. Sorgfältig gestaltete Module verschmelzen diese Sichten zurück zu einer räumlichen Karte, und ein zusätzliches Decodier‑Modul (genannt SCConv) filtert redundante Signale heraus, während es wirklich informative Muster verstärkt. Das Ergebnis ist eine sauberere, selbstsicherere Karte jeder Gewebezone.

Wie gut funktioniert es in der Praxis?

Die Forschenden testeten MSF‑VMDNet am Datensatz für Nicht‑Melanom‑Hautkrebs und verglichen es mit einer Vielzahl führender Segmentierungsmodelle, darunter klassisches U‑Net, Transformer‑basierte Methoden und andere Vision‑Mamba‑Hybride. Ihr System lieferte klarere Tumorumrisse und weniger Fehler in schwierigen Bereichen, in denen Tumor, Haarfollikel und entzündetes Gewebe ineinander greifen. Bei standardisierten Überlappungsmaßen übertraf es alle Konkurrenten und erreichte circa 95 Prozent Übereinstimmung mit von Expertinnen und Experten gezeichneten Masken. Um zu prüfen, ob die Methode über ein Labor und einen Krebstyp hinaus generalisiert, evaluierten die Autorinnen und Autoren sie außerdem an drei zusätzlichen Sammlungen: dermoskopische Fotos von Hautläsionen, Mikroskopbildern unterschiedlicher Zellkerne und CT-Aufnahmen von Bauchorganen. In allen Fällen blieb die Methode hochgenau und schnitt statistisch besser ab als starke Baselines.

Was das für Patientinnen, Patienten und Ärztinnen, Ärzte bedeutet

Vereinfacht gesagt ist MSF‑VMDNet ein automatischer Kartograph für medizinische Bilder, der Tumoren aus der überfüllten Landschaft normalen Gewebes mit ungewöhnlicher Präzision trennen kann. Es ersetzt nicht das Urteil von Pathologinnen und Pathologen, kann aber einen schnellen, detaillierten Ausgangspunkt liefern, den manuellen Aufwand reduzieren und dazu beitragen, dass subtile Tumorbereiche nicht übersehen werden. Da derselbe Ansatz bei sehr unterschiedlichen Arten medizinischer Bilder gut funktioniert, könnte er zu einem vielseitigen Werkzeug für viele diagnostische Aufgaben werden. Mit weiterer Entwicklung und Integration klinischer Informationen könnten Systeme wie dieses eine zuverlässigere Einstufung von Hautkrebs unterstützen und letztlich zu besser informierten Behandlungsentscheidungen beitragen.

Zitation: Zhang, J., Pu, Q., Tian, J. et al. MSF-VMDNet for multi class segmentation of skin cancer whole slide images using a multi frequency dual encoder network. Sci Rep 16, 11722 (2026). https://doi.org/10.1038/s41598-026-40044-1

Schlüsselwörter: Hautkrebs-Bildgebung, medizinische Bildsegmentierung, Deep Learning in der Pathologie, histopathologische Analyse, KI-Diagnostik