Clear Sky Science · es

MSF-VMDNet para la segmentación multiclase de muestras completas de piel con cáncer mediante una red de doble codificador y multi‑frecuencia

Por qué importa cartografiar el cáncer de piel

Cuando los médicos diagnostican cáncer de piel, a menudo examinan imágenes de microscopio de altísima resolución de láminas de tejido teñidas. Estas imágenes muestran no solo el tumor, sino también muchos tipos de estructuras cutáneas normales entrelazadas. Dibujar límites precisos alrededor de cada región a mano es lento y puede variar entre especialistas. Este estudio presenta un nuevo método computacional diseñado para separar automáticamente estos tejidos enmarañados con gran precisión, lo que podría ahorrar tiempo y hacer los diagnósticos más coherentes.

De manchas simples a tejidos enredados

El cáncer de piel está entre los más comunes del mundo, impulsado en parte por una mayor exposición a la radiación ultravioleta. El diagnóstico moderno suele comenzar con la dermatoscopia, una fotografía ampliada de la piel, y a menudo continúa con una biopsia: se extrae una pequeña porción de piel, se tiñe y se examina al microscopio. En estas imágenes de portaobjetos completos, los tumores atraviesan capas como la epidermis, el tejido conectivo más profundo, folículos pilosos, glándulas sudoríparas y tejido graso. Muchas de estas regiones se parecen en color y textura, y sus fronteras pueden ser difusas, lo que dificulta incluso a los expertos separar claramente tumor y tejido sano.

Una nueva forma de interpretar imágenes complejas

La mayoría de las herramientas informáticas previas trataban el problema como colorear una imagen con solo dos crayones: “lesión” y “no lesión”. Eso puede funcionar en fotos superficiales más sencillas, pero falla cuando una diapositiva debe dividirse en muchos tipos de tejido a la vez. Los autores se centran en un conjunto de datos desafiante de cánceres de piel no melanómicos en el que cada imagen debe segmentarse en hasta diez clases de tejido distintas. Su objetivo es construir un sistema que entienda la disposición global del tejido y, al mismo tiempo, capture pequeños detalles en los bordes, algo que las redes neuronales tradicionales a menudo luchan por equilibrar.

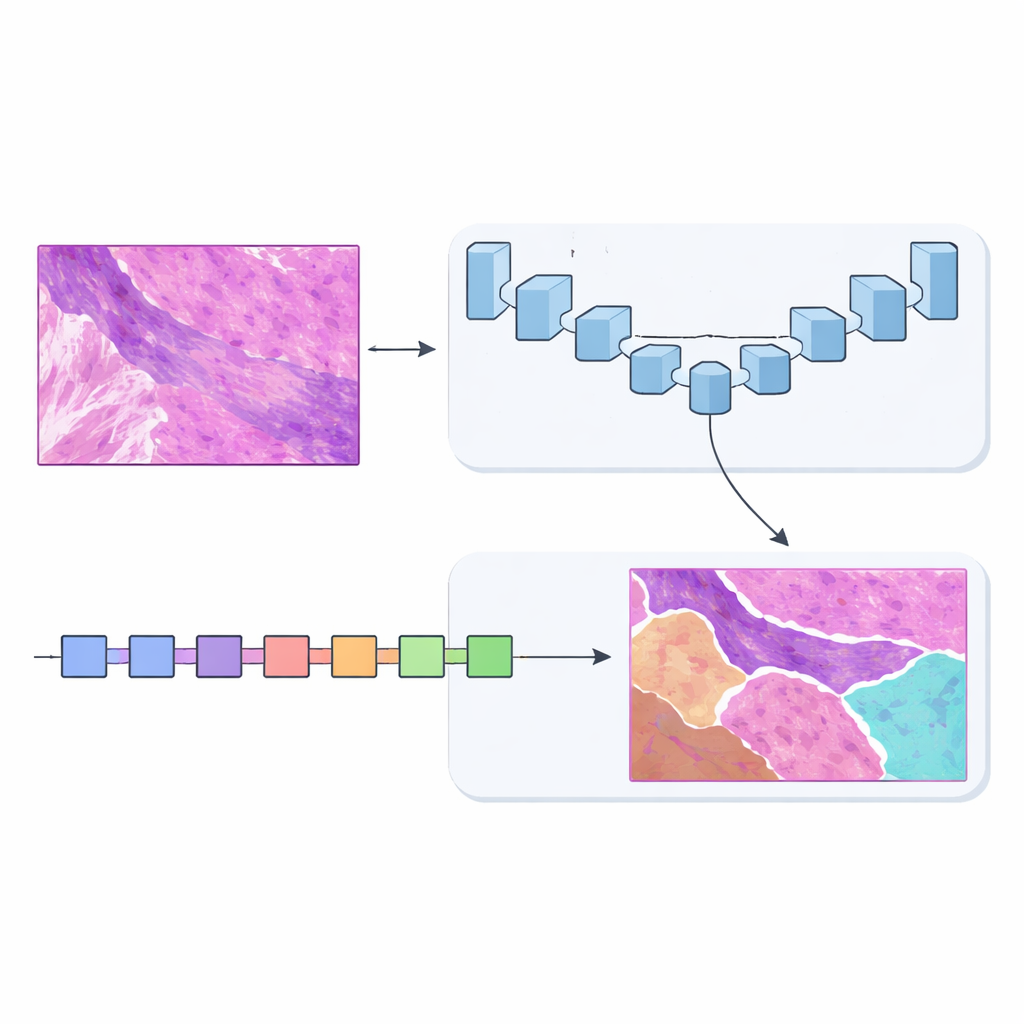

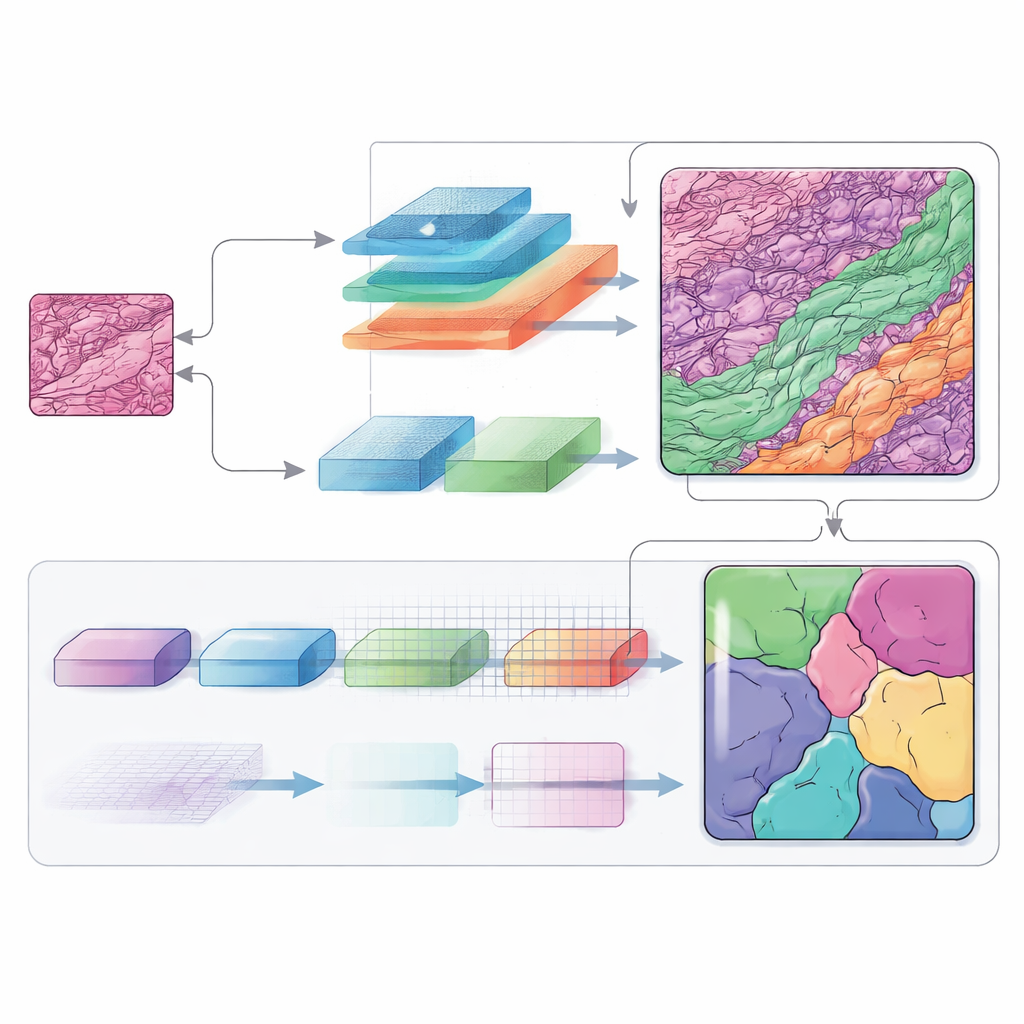

Dos cerebros son mejores que uno

Para resolver esto, el equipo diseñó MSF‑VMDNet, una red de doble codificador que puede entenderse como dos “cerebros” complementarios que examinan la misma lámina en paralelo. Una rama se basa en U‑Net, un modelo popular en imagen médica que sobresale capturando detalles locales finos. Los autores lo mejoran con un módulo espectral que convierte la imagen en una colección de frecuencias —unas describen cambios lentos y suaves, otras capturan bordes y texturas agudas— y luego las recombina para reforzar las fronteras entre clases. Al mismo tiempo, una segunda rama construida sobre un enfoque más reciente llamado Vision Mamba recorre la lámina de manera más eficiente, modelando relaciones a larga distancia para que regiones distantes pero relacionadas puedan influenciarse entre sí.

Escuchar muchas frecuencias a la vez

La información en frecuencia juega un papel central en esta arquitectura. Al moverse entre el espacio de imagen ordinario y una vista basada en frecuencias, la red puede tratar de forma distinta las formas amplias y las estructuras minúsculas. Los componentes de baja frecuencia le ayudan a comprender la disposición general del tumor y las capas de piel circundantes, mientras que los de alta frecuencia agudizan los bordes donde termina un tipo de tejido y comienza otro. Módulos diseñados cuidadosamente vuelven a fusionar estas vistas en un mapa espacial, y un bloque de decodificación adicional (llamado SCConv) filtra señales redundantes a la vez que potencia los patrones realmente informativos. El resultado es un mapa de cada región tisular más limpio y con mayor confianza.

¿Qué tan bien funciona en la práctica?

Los investigadores probaron MSF‑VMDNet en el conjunto de datos de cáncer de piel no melanómico y lo compararon con una amplia gama de modelos de segmentación líderes, incluidos el clásico U‑Net, métodos basados en Transformers y otros híbridos de Vision Mamba. Su sistema produjo contornos tumorales más claros y menos errores en áreas complejas donde tumor, folículos pilosos y tejido inflamado se entrelazan. En medidas estándar de solapamiento, superó a todos los competidores, alcanzando alrededor del 95 por ciento de coincidencia con máscaras dibujadas por expertos. Para comprobar si el método se generaliza más allá de un laboratorio y un tipo de cáncer, el equipo también lo evaluó en tres colecciones adicionales: fotos dermatoscópicas de lesiones cutáneas, imágenes microscópicas de distintos tipos de núcleos celulares y TAC abdominales de órganos. En todos los casos, el método se mantuvo altamente preciso y superó estadísticamente a bases sólidas.

Qué significa esto para pacientes y médicos

En términos sencillos, MSF‑VMDNet es un cartógrafo automatizado para imágenes médicas que puede separar tumores del paisaje concurrido de tejido normal con una precisión inusual. Aunque no sustituye el juicio de los patólogos, puede ofrecer un punto de partida rápido y detallado, reduciendo el esfuerzo manual necesario y ayudando a que no se pasen por alto regiones tumorales sutiles. Dado que el mismo enfoque funciona bien en tipos de imágenes médicas muy diferentes, podría convertirse en una herramienta versátil para muchas tareas diagnósticas. Con más desarrollo e integración de información clínica, sistemas como este podrían apoyar una gradación del cáncer de piel más fiable y, en última instancia, decisiones de tratamiento mejor informadas.

Cita: Zhang, J., Pu, Q., Tian, J. et al. MSF-VMDNet for multi class segmentation of skin cancer whole slide images using a multi frequency dual encoder network. Sci Rep 16, 11722 (2026). https://doi.org/10.1038/s41598-026-40044-1

Palabras clave: imagenología del cáncer de piel, segmentación de imágenes médicas, aprendizaje profundo en patología, análisis histopatológico, diagnóstico por IA