Clear Sky Science · fr

Réseau d’attention à double branche avec convolution à séparation profonde et transformeurs multidimensionnels pour la segmentation d’images médicales

Des vues plus nettes pour les médecins

Les appareils d’imagerie modernes peuvent révéler tumeurs, vaisseaux obstrués et organes endommagés avec un niveau de détail remarquable, mais transformer ces images en nuances de gris en contours clairs compréhensibles par une machine reste étonnamment difficile. Les médecins ont besoin de limites précises autour des organes et des tissus malades pour planifier une chirurgie, suivre un traitement et éviter les erreurs. Cette étude présente un nouveau système d’intelligence artificielle, appelé D3T‑Net, qui trace ces limites de façon plus précise et plus fiable que de nombreuses méthodes de pointe, allégeant potentiellement la charge de travail des radiologues et renforçant la confiance diagnostique.

Pourquoi dessiner des lignes sur des examens médicaux est si difficile

Quand un radiologue examine un scanner ou une radiographie, il sépare mentalement les structures qui se chevauchent, ignore le bruit et infère les bords manquants. Les logiciels traditionnels peinent à faire cela, surtout lorsque la forme des organes varie d’une personne à l’autre ou lorsque la bordure d’une tumeur est floue. Les systèmes antérieurs basés sur des réseaux convolutifs excellent pour capter les textures locales et les contours, mais ils n’analysent généralement qu’un petit voisinage à la fois. Ils risquent ainsi de manquer le contexte global nécessaire pour distinguer, par exemple, un bord tumoral peu marqué d’un tissu normal. À l’inverse, les modèles « Transformer » plus récents saisissent bien les relations à longue portée sur l’ensemble de l’image, mais passent souvent à côté des détails fins, comme de petites lésions ou des frontières minces.

Deux façons complémentaires de voir

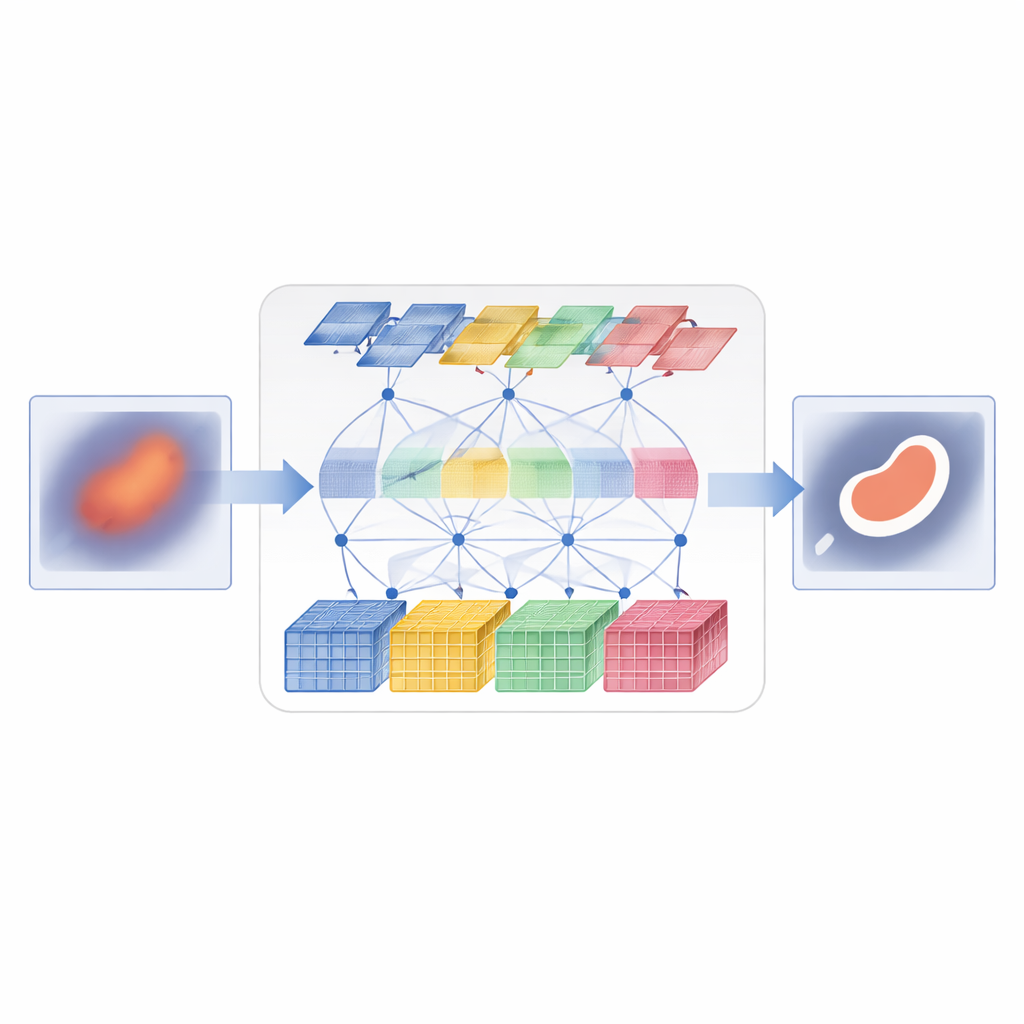

D3T‑Net relève ce défi en combinant ces deux modes de perception au sein d’un réseau unique et étroitement coordonné. Une branche agit comme un analyseur d’images traditionnel, se focalisant sur de petits patches pour capturer les textures fines et les contours nets. Elle utilise une stratégie de « séparation profonde » : les caractéristiques entrantes sont divisées en plusieurs flux parallèles, traitées séparément, puis fusionnées par un mécanisme d’attention qui décide quels flux portent l’information structurelle la plus utile. L’autre branche se comporte davantage comme un observateur global, utilisant une attention de type Transformer pour comparer des régions distantes de l’image et comprendre leurs relations. Elle regarde non seulement à travers le plan de l’image mais aussi à travers les canaux de caractéristiques, ce qui lui permet de capturer à la fois la localisation et la cohérence des motifs d’apparence.

Faire coopérer les deux branches

Lancer deux branches en parallèle ne suffit pas ; elles doivent échanger de l’information de façon intelligente. Dans l’encodeur de D3T‑Net, un module d’interaction spécial examine les motifs selon plusieurs directions dans l’image, en utilisant du pooling et de l’attention pour mettre en évidence les structures les plus informatives — par exemple les contours d’organes ou les noyaux de lésions — et partager cette mise en relief entre les branches locale et globale. Dans le décodeur, où la carte de segmentation finale est assemblée, un mécanisme de cross‑attention apprend à combiner ce que chaque branche a acquis, réorganisant les caractéristiques de sorte que le contexte global affine les contours locaux et que le détail local précise la vue globale. Des connexions skip multi‑échelle transportent l’information des premières étapes à haute résolution vers les étapes ultérieures, aidant le système à suivre les petits objets et les limites délicates qui pourraient autrement se perdre.

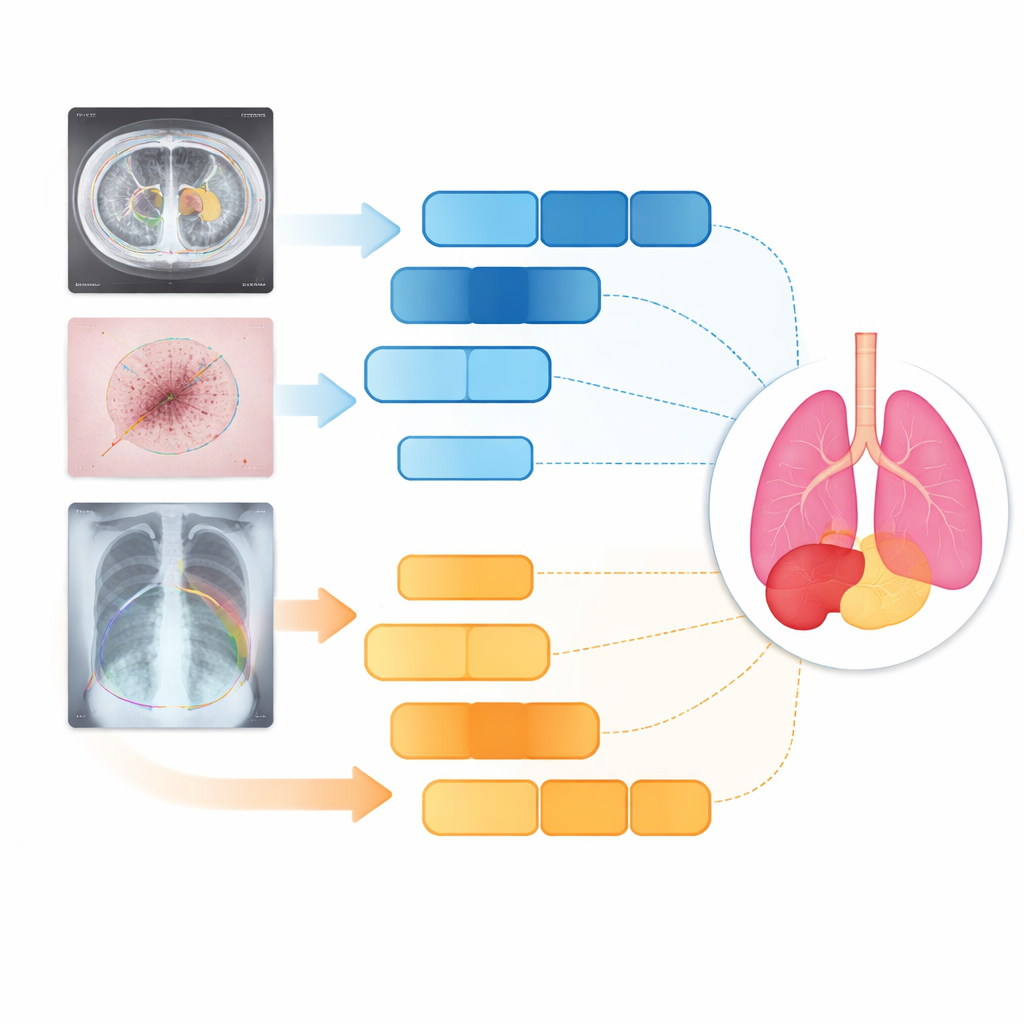

Tests sur organes, peau et poumons

Les chercheurs ont testé D3T‑Net sur trois tâches médicales très différentes : délimitation des organes abdominaux sur scans CT, traçage des lésions cutanées sur photographies cliniques, et segmentation des poumons sur radiographies thoraciques. Sur les mesures standards de précision et de netteté des frontières, D3T‑Net a systématiquement surpassé un large éventail de systèmes à la pointe, y compris des variantes connues de U‑Net et des hybrides basés sur des Transformeurs. Il s’est montré particulièrement performant pour maintenir la continuité des contours d’organes, séparer correctement les structures voisines et capturer des cibles petites ou à faible contraste comme la vésicule biliaire ou des lésions cutanées irrégulières. Fait important, ces gains n’ont pas nécessité une augmentation extrême du coût de calcul : le coût de traitement du modèle est resté comparable à celui de nombreux réseaux largement utilisés, ce qui rend plausible son déploiement clinique.

Ce que cela signifie pour les patients et les cliniciens

Concrètement, l’étude montre que laisser un algorithme « penser » à la fois localement et globalement conduit à des contours plus propres des organes et des pathologies sur les images médicales. En coordonnant soigneusement une branche orientée détail avec une branche consciente du contexte, D3T‑Net peut séparer le tissu sain du tissu malade plus précisément que beaucoup d’outils existants. S’il ne remplacera pas les radiologues, il peut servir d’assistant puissant — présegmentant automatiquement les examens, signalant des lésions subtiles et fournissant des masques plus fiables pour des tâches en aval comme la planification 3D ou la surveillance thérapeutique. À mesure que des architectures duales similaires seront appliquées à d’autres problèmes d’imagerie, les patients pourraient bénéficier de soins plus rapides, plus cohérents et plus personnalisés.

Citation: Li, D., Yuan, C., Yao, Y. et al. Dual-branch attention network with deep split convolution and multi-dimensional transformers for medical image segmentation. Sci Rep 16, 14238 (2026). https://doi.org/10.1038/s41598-026-44413-8

Mots-clés: segmentation d’images médicales, apprentissage profond, réseaux transformeurs, analyse du foie et des organes, diagnostic assisté par ordinateur