Clear Sky Science · de

Dual-Branch-Attention-Netzwerk mit Deep-Split-Convolution und multidimensionalen Transformern für die Segmentierung medizinischer Bilder

Schärfere Ansichten für Ärztinnen und Ärzte

Moderne Aufnahmen können Tumore, verstopfte Gefäße und geschädigte Organe in beeindruckendem Detail zeigen, doch diese grau‑weißen Bilder in klare, für Computer verarbeitbare Konturen zu überführen, bleibt überraschend schwierig. Ärztinnen und Ärzte benötigen präzise Begrenzungen von Organen und erkranktem Gewebe, um Operationen zu planen, Behandlungen zu verfolgen und Fehler zu vermeiden. Diese Studie stellt ein neues KI‑System vor, genannt D3T‑Net, das diese Konturen genauer und zuverlässiger zeichnet als viele führende Methoden und so die Arbeitsbelastung von Radiologinnen und Radiologen verringern und das diagnostische Vertrauen erhöhen könnte.

Warum das Zeichnen von Linien in medizinischen Aufnahmen so schwierig ist

Wenn eine Radiologin oder ein Radiologe eine CT‑ oder Röntgenaufnahme betrachtet, trennt sie oder er überlappende Strukturen gedanklich, blendet Rauschen aus und schließt fehlende Kanten. Traditionelle Computerprogramme tun sich damit schwer, besonders wenn sich Organformen von Person zu Person unterscheiden oder wenn die Grenze eines Tumors unscharf ist. Frühere Systeme auf Basis von Faltungsnetzwerken (CNNs) sind gut darin, lokale Texturen und Kanten zu erfassen, sehen dabei aber oft nur eine kleine Nachbarschaft. Dadurch verpassen sie leicht den größeren Kontext, der nötig ist, um etwa eine schwache Tumorkante von normalem Gewebe zu unterscheiden. Neuere Transformer‑Modelle erfassen zwar langreichweitige Beziehungen über das ganze Bild, übersehen jedoch oft feine Details wie kleine Läsionen oder dünne Grenzen.

Zwei komplementäre Sichtweisen

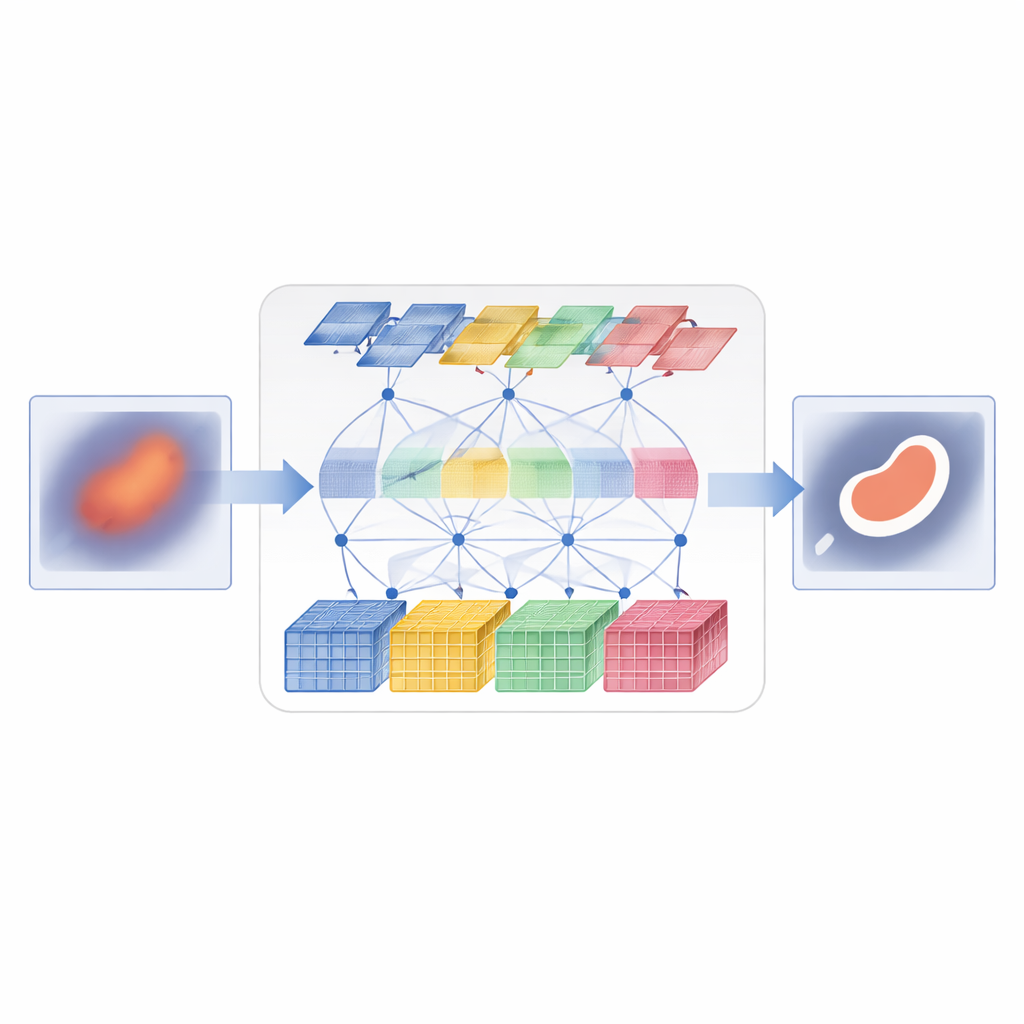

D3T‑Net begegnet dieser Herausforderung, indem es beide Sichtweisen in einem eng abgestimmten Netzwerk kombiniert. Ein Zweig verhält sich wie ein traditioneller Bildanalysator und konzentriert sich auf kleine Bildausschnitte, um feine Texturen und scharfe Kanten zu erfassen. Er verwendet eine „Deep‑Splitting“‑Strategie: eingehende Bildmerkmale werden in mehrere parallele Ströme aufgeteilt, separat verarbeitet und dann mit einem Aufmerksamkeitsmechanismus verschmolzen, der entscheidet, welche Ströme die nützlichsten Strukturdaten liefern. Der andere Zweig fungiert eher als globaler Beobachter und nutzt Transformer‑ähnliche Aufmerksamkeit, um weit entfernte Bildbereiche zu vergleichen und deren Beziehungen zueinander zu verstehen. Er betrachtet nicht nur die räumliche Ebene, sondern auch die Merkmalskanäle und kann so sowohl Ort als auch zusammenhängende Erscheinungsmuster erfassen.

Beide Zweige zur Zusammenarbeit bringen

Zwei Zweige parallel laufen zu lassen reicht nicht aus; sie müssen Informationen auf intelligente Weise austauschen. Im Encoder‑Teil von D3T‑Net untersucht ein spezielles Interaktionsmodul Muster aus mehreren Richtungen im Bild, verwendet Pooling und Aufmerksamkeit, um die informativsten Strukturen hervorzuheben—wie Organumrisse oder Läsionskerne—und teilt diese Betonung zwischen dem lokalen und dem globalen Zweig. Im Decoder‑Teil, wo die endgültige Segmentierungslandkarte zusammengesetzt wird, lernt ein Cross‑Attention‑Mechanismus, wie das, was jeder Zweig gelernt hat, kombiniert werden kann, indem Merkmale so neu organisiert werden, dass globaler Kontext lokale Kanten schärft und lokale Details das breite globale Bild verfeinern. Multiskalige Skip‑Verbindungen transportieren Informationen aus frühen, hochaufgelösten Verarbeitungsstufen direkt zu späteren Phasen und helfen so, kleine Objekte und feine Grenzen zu bewahren, die sonst verloren gehen könnten.

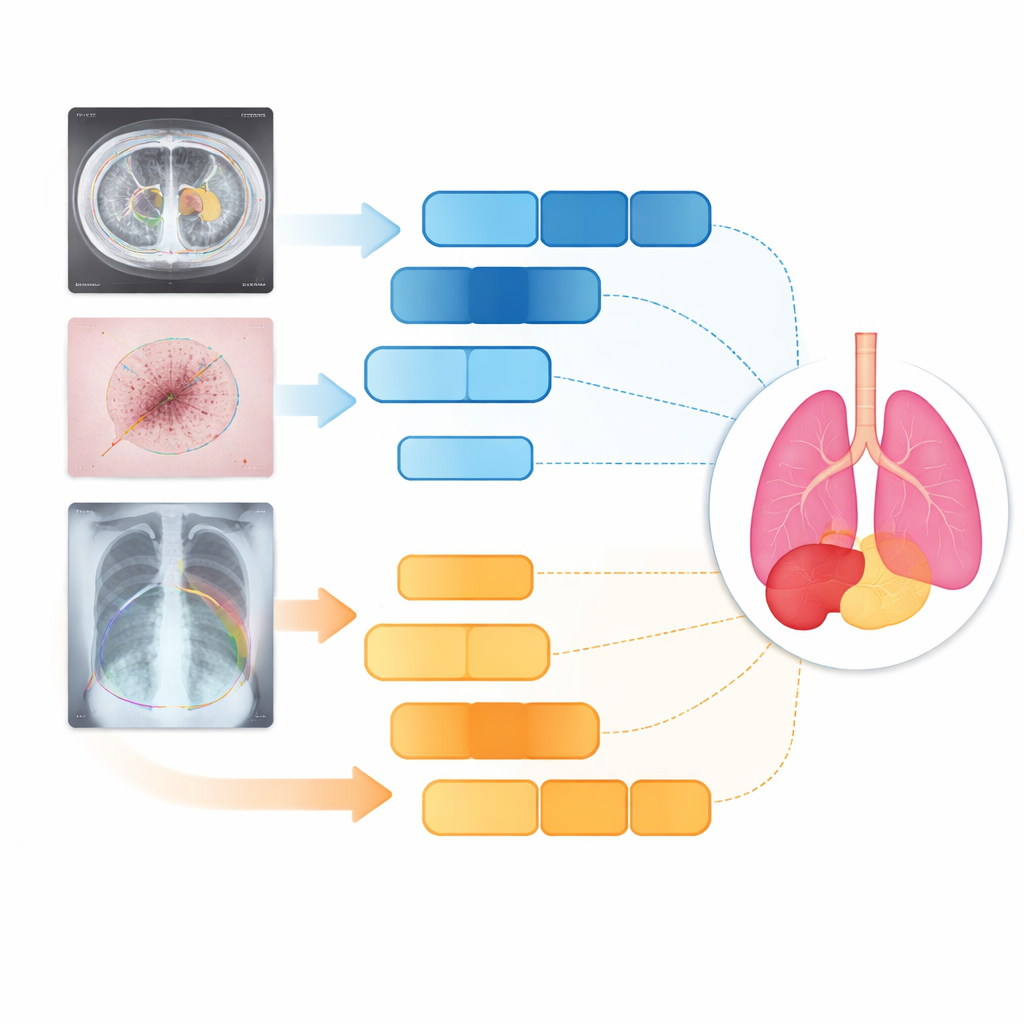

Tests an Organen, Haut und Lungen

Die Forschenden testeten D3T‑Net an drei sehr unterschiedlichen medizinischen Aufgaben: dem Umreißen abdominaler Organe in CT‑Scans, dem Nachzeichnen von Hautläsionen in klinischen Fotografien und der Segmentierung von Lungen auf Brust‑Röntgenaufnahmen. Über gängige Genauigkeits‑ und Kantenschärfemaße hinweg übertraf D3T‑Net durchgehend eine breite Palette moderner Systeme, darunter bekannte U‑Net‑Varianten und Transformer‑basierte Hybride. Besonders stark war das Modell darin, Organumrisse kontinuierlich zu halten, benachbarte Strukturen korrekt zu trennen und kleine oder kontrastarme Ziele wie die Gallenblase oder unregelmäßige Hautläsionen zu erfassen. Wichtig ist, dass diese Verbesserungen nicht mit einem extremen Anstieg der Rechenzeit einhergingen: Die Verarbeitungskosten des Modells blieben vergleichbar mit vielen weit verbreiteten Netzwerken, was eine klinische Einsetzbarkeit plausibel macht.

Was das für Patientinnen, Patienten und Klinikpersonal bedeutet

Einfach gesagt zeigt die Studie, dass ein Algorithmus, der gleichzeitig lokal und global „denkt“, zu saubereren Umrissen von Organen und Erkrankungen in medizinischen Bildern führt. Durch die sorgfältige Koordination eines detailorientierten Zweigs mit einem kontextbewussten Zweig kann D3T‑Net gesundes und krankes Gewebe genauer trennen als viele existierende Werkzeuge. Es wird Radiologinnen und Radiologen nicht ersetzen, kann aber als leistungsfähiger Assistent dienen—indem es Aufnahmen automatisch vorsegmentiert, subtile Läsionen markiert und verlässlichere Masken für nachgelagerte Aufgaben wie 3D‑Planung oder Therapieüberwachung liefert. Wenn ähnliche Dual‑View‑Designs auf andere bildgebende Probleme angewendet werden, könnten Patientinnen und Patienten von schnellerer, konsistenterer und stärker personalisierter Versorgung profitieren.

Zitation: Li, D., Yuan, C., Yao, Y. et al. Dual-branch attention network with deep split convolution and multi-dimensional transformers for medical image segmentation. Sci Rep 16, 14238 (2026). https://doi.org/10.1038/s41598-026-44413-8

Schlüsselwörter: Segmentierung medizinischer Bilder, Tiefes Lernen, Transformer-Netzwerke, Leber- und Organanalyse, computerassistierte Diagnose