Clear Sky Science · zh

使用“读心眼睛测试”评估多模态大语言模型的跨族裔情感识别能力

这为何与日常生活相关

想象一个计算机程序能通过观察一个人的眼睛来猜测他们的感受——有时比大多数人更准确。本研究探讨此类系统是否能公平地对待来自不同族裔背景的人。随着人工智能(AI)工具进入医疗、教育和日常应用,了解它们是否对不同群体一视同仁,对于建立信任、保障安全和遵守伦理至关重要。

在眼睛里寻找情感

研究者聚焦于一个著名的心理学测试,称为“读心眼睛测试”。在该任务中,仅显示面部的眼部区域,观察者必须从选项中挑出眼睛所表达的情绪或心理状态。该测试有三个版本,分别使用白人、黑人或韩国人的照片。人们通常发现要判断其他族裔面孔的情绪更困难,这种模式被称为“异族效应”。本研究问:先进的AI系统是否也表现出类似的弱点,还是能在这些不同面孔集合上同样准确地识别情绪。

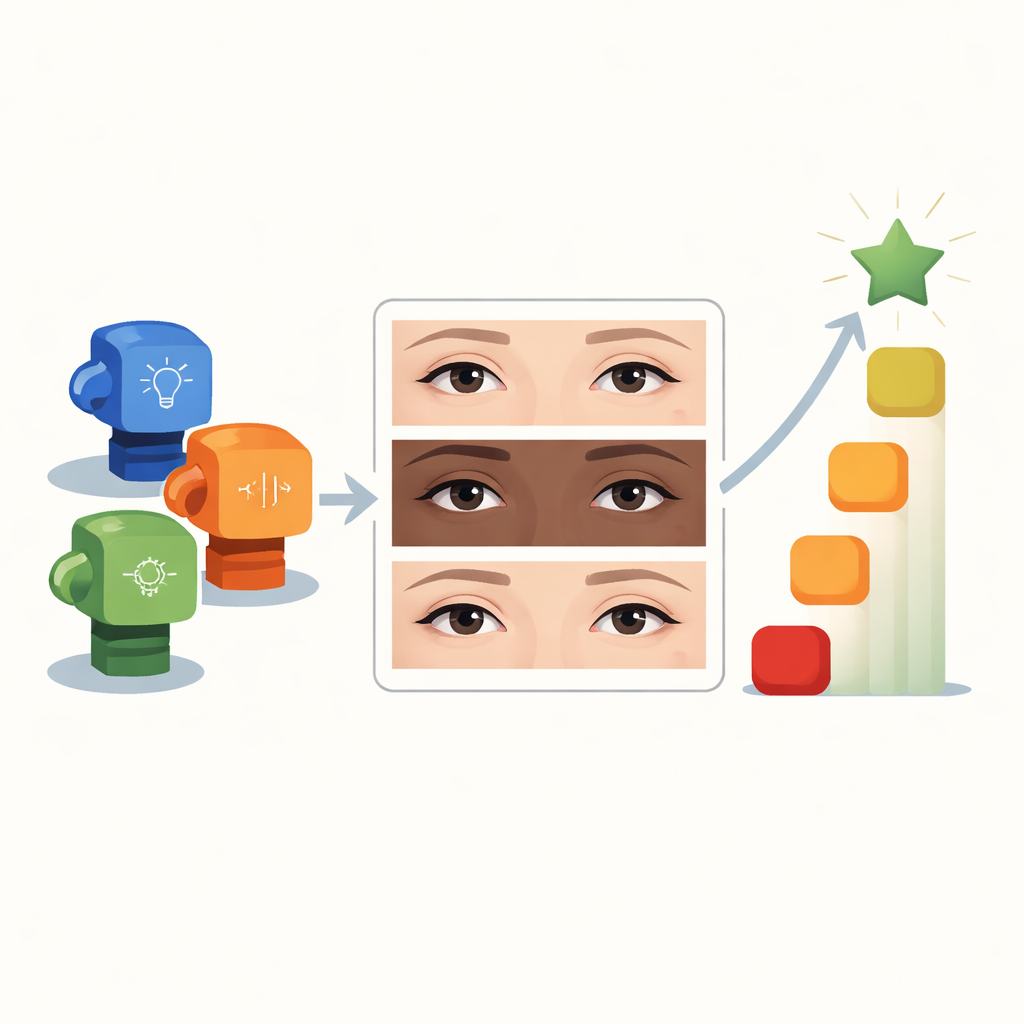

把三款AI系统放到考验中

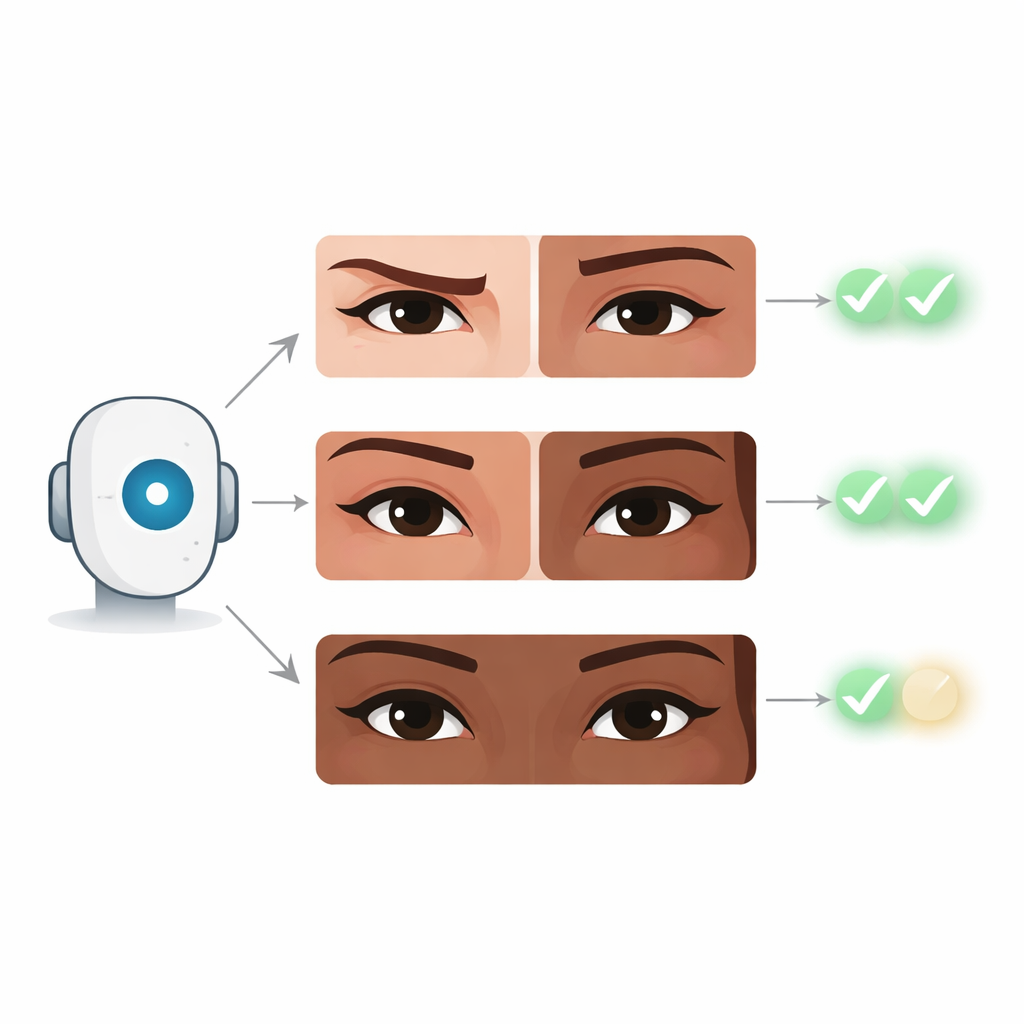

研究团队评估了三款流行的多模态大语言模型——能够处理图像与文本的系统。他们测试了一款较早的基于GPT-4的模型、一款较新的基于GPT-4o的模型,以及一款竞争系统Claude 3 Opus。每个模型对三种眼睛测试的每个版本都完成了两次,以便研究者同时检查准确性和随时间的一致性。AI模型像人类测试者一样看到每张眼部图像及四个可能答案,并需选择一个。科学家随后将AI的得分与先前大量人群完成相同测试的结果进行了比较。

机器表现如何

较新的GPT-4o模型表现突出。在白人面孔上其答对约83%的题目,在黑人面孔上约94%,在韩国人面孔上约86%。这些得分将其置于与人类表现相比的大约第85到94百分位,意味着它比大多数参加过这些测试的人做得更好。重要的是,它在三种族裔上的成功率相似,表明它并未表现出人们在此类任务中常见的那种族裔偏差。较早的GPT-4模型表现优于随机猜测,但接近人类平均水平,而Claude 3 Opus则接近随机水平,表现像主要在猜测的人。

AI觉得容易和困难的部分

为了超越单纯的总分,作者还检查了各类情绪中哪些是模型擅长或不擅长的。总体而言,系统倾向于较准确地识别诸如担忧、不安或沉思等内在状态。相反,它们在识别承载人际意味的社会性、积极表情上困难更多——例如调皮、友好或调情等。较新的GPT-4o系统比其他模型减少了这些错误,这暗示每一代新的AI可能在捕捉早期模型遗漏的微妙社交信号方面有所进步。

这对人们可能意味着什么

这些发现既带来令人振奋的可能性,也提出重要的警示。一方面,能够像许多人甚至更好地从面部读出情绪——并且在不同族裔间表现相似的系统——未来或许能为心理学家、医生或教师提供关于社交线索的更稳定的第二意见。另一方面,眼睛测试本身存在严重的科学局限,可能无法反映依赖肢体语言、语气与情境的真实社交理解。作者强调,这些结果并不证明AI具有真正的共情能力,也不表明它在其他情境中没有偏见。相反,这项工作提供了一个早期基准:在一个聚焦于眼部区域的狭窄受控任务中,至少一种现代AI表现出高度准确性并在不同族裔间相对公正,但在让这类工具影响现实世界决策之前仍需大量进一步研究。

引用: Refoua, E., Elyoseph, Z., Piterman, D. et al. Evaluation of cross-ethnic emotion recognition capabilities in multimodal large language models using the reading the mind in the eyes test. Sci Rep 16, 9975 (2026). https://doi.org/10.1038/s41598-026-39292-y

关键词: 情绪识别, 人工智能, 社会认知, 跨族裔偏见, 心理健康