Clear Sky Science · pt

Avaliação das capacidades de reconhecimento de emoções entre etnias em modelos de grande porte multimodais usando o teste “Reading the Mind in the Eyes”

Por que isso importa no cotidiano

Imagine um programa de computador capaz de olhar para os olhos de uma pessoa e adivinhar o que ela está sentindo—por vezes com mais precisão do que a maioria das pessoas. Este estudo pergunta se tais sistemas conseguem fazer isso de maneira justa para pessoas de diferentes origens étnicas. À medida que ferramentas de inteligência artificial (IA) entram na saúde, educação e aplicativos do dia a dia, saber se tratam grupos distintos de forma equivalente é crucial para confiança, segurança e ética.

Procurando sentimentos nos olhos

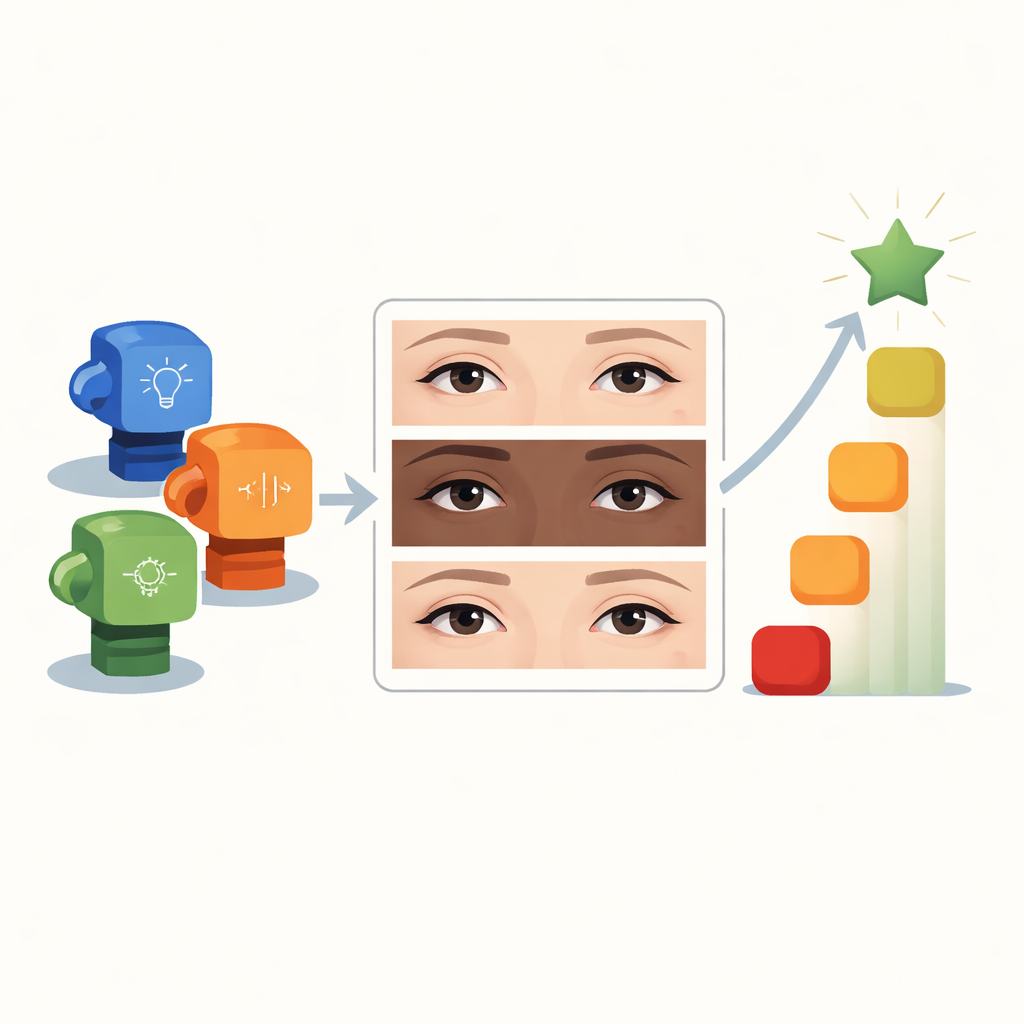

Os pesquisadores concentraram-se em um teste psicológico conhecido chamado “Reading the Mind in the Eyes.” Nesta tarefa, mostra-se apenas a região dos olhos de um rosto, e o observador deve escolher qual emoção ou estado mental os olhos expressam. Existem três versões do teste, cada uma usando fotos de indivíduos brancos, negros ou coreanos. Frequentemente as pessoas têm mais dificuldade em julgar emoções a partir de rostos de outro grupo étnico, um padrão conhecido como “efeito da outra raça.” O estudo investigou se sistemas avançados de IA apresentam uma fraqueza semelhante, ou se conseguem reconhecer emoções de forma igualmente eficaz entre esses diferentes conjuntos de rostos.

Testando três sistemas de IA

A equipe avaliou três modelos multimodais de grande porte populares—sistemas capazes de processar imagens e texto. Testaram um modelo baseado em GPT-4 mais antigo, um modelo mais novo baseado em GPT-4o e um sistema concorrente chamado Claude 3 Opus. Cada modelo completou as três versões do teste dos olhos duas vezes, para que os pesquisadores pudessem verificar precisão e consistência ao longo do tempo. Os modelos de IA viram cada imagem dos olhos com quatro respostas possíveis e precisaram escolher uma, assim como um participante humano faria. Os cientistas então compararam as pontuações das IAs com as de grandes grupos de pessoas que já haviam feito os mesmos testes.

Como as máquinas se saíram

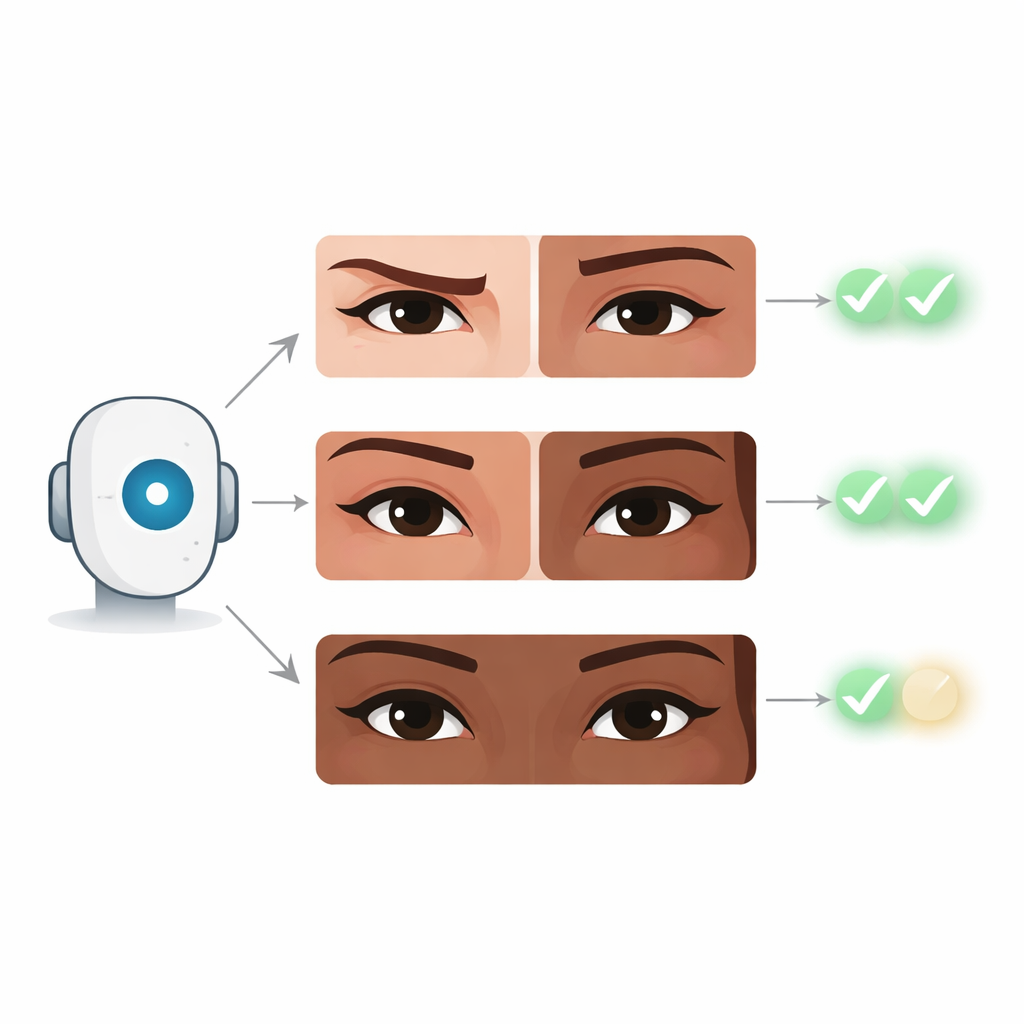

O modelo mais novo, GPT-4o, destacou-se. Ele respondeu corretamente em cerca de 83% dos itens para rostos brancos, 94% para rostos negros e 86% para rostos coreanos. Essas pontuações o colocaram aproximadamente nos percentis entre 85 e 94 em comparação com o desempenho humano, ou seja, ele se saiu melhor do que a maioria das pessoas que fizeram esses testes. De forma importante, seu sucesso foi semelhante entre os três grupos étnicos, sugerindo que não exibiu o tipo de viés étnico que as pessoas frequentemente mostram nessas tarefas. O GPT-4 mais antigo teve desempenho melhor que o acaso, mas mais próximo do nível médio humano, enquanto o Claude 3 Opus ficou perto do aleatório, atuando como alguém que estava basicamente chutando as respostas.

O que a IA achou fácil e difícil

Para ir além dos totais de pontuação simples, os autores examinaram que tipos de emoções os modelos lidaram bem ou mal. Em geral, eles tenderam a reconhecer com alta precisão estados internos como estar preocupado, inquieto ou pensativo. Em contraste, tiveram mais dificuldade com expressões socialmente ricas e positivas que carregam significado interpessoal—como estar brincalhão, amigável ou flirtante. O sistema mais novo, GPT-4o, reduziu esses erros mais do que os outros, sugerindo que cada nova geração de IA pode estar melhorando na identificação de sinais sociais sutis que modelos anteriores perdem.

O que isso pode significar para as pessoas

As descobertas levantam possibilidades empolgantes e precauções importantes. Por um lado, um sistema capaz de ler emoções a partir de rostos tão bem quanto, ou melhor do que, muitas pessoas—e fazê-lo de forma semelhante entre grupos étnicos—poderia um dia ajudar psicólogos, médicos ou professores oferecendo uma segunda opinião mais estável sobre pistas sociais. Por outro lado, o próprio teste dos olhos tem limitações científicas sérias e pode não refletir a compreensão social na vida real, que depende da linguagem corporal, do tom de voz e do contexto. Os autores enfatizam que esses resultados não provam que a IA tenha empatia genuína nem que esteja livre de viés em outros cenários. Em vez disso, o trabalho oferece um marco inicial: para uma tarefa estreita e controlada focada apenas na região dos olhos, pelo menos uma IA moderna parece altamente precisa e relativamente imparcial entre diferentes grupos étnicos, mas são necessárias muitas pesquisas antes que tais ferramentas devam influenciar decisões do mundo real.

Citação: Refoua, E., Elyoseph, Z., Piterman, D. et al. Evaluation of cross-ethnic emotion recognition capabilities in multimodal large language models using the reading the mind in the eyes test. Sci Rep 16, 9975 (2026). https://doi.org/10.1038/s41598-026-39292-y

Palavras-chave: reconhecimento de emoções, inteligência artificial, cognição social, viés entre etnias, saúde mental