Clear Sky Science · de

Bewertung der fähigkeit multimodaler großer Sprachmodelle zur emotionserkennung über Ethnie hinweg mit dem "Reading the Mind in the Eyes"-Test

Warum das im Alltag wichtig ist

Stellen Sie sich ein Computerprogramm vor, das einer Person in die Augen blickt und errät, was sie fühlt – in manchen Fällen genauer als viele Menschen. Diese Studie untersucht, ob solche Systeme Menschen unterschiedlicher ethnischer Herkunft gleichermaßen gerecht bewerten können. Da KI-Werkzeuge zunehmend in Gesundheitswesen, Bildung und alltäglichen Apps eingesetzt werden, ist es entscheidend zu wissen, ob sie verschiedene Bevölkerungsgruppen gleich behandeln; das ist wichtig für Vertrauen, Sicherheit und Ethik.

Gefühle in den Augen lesen

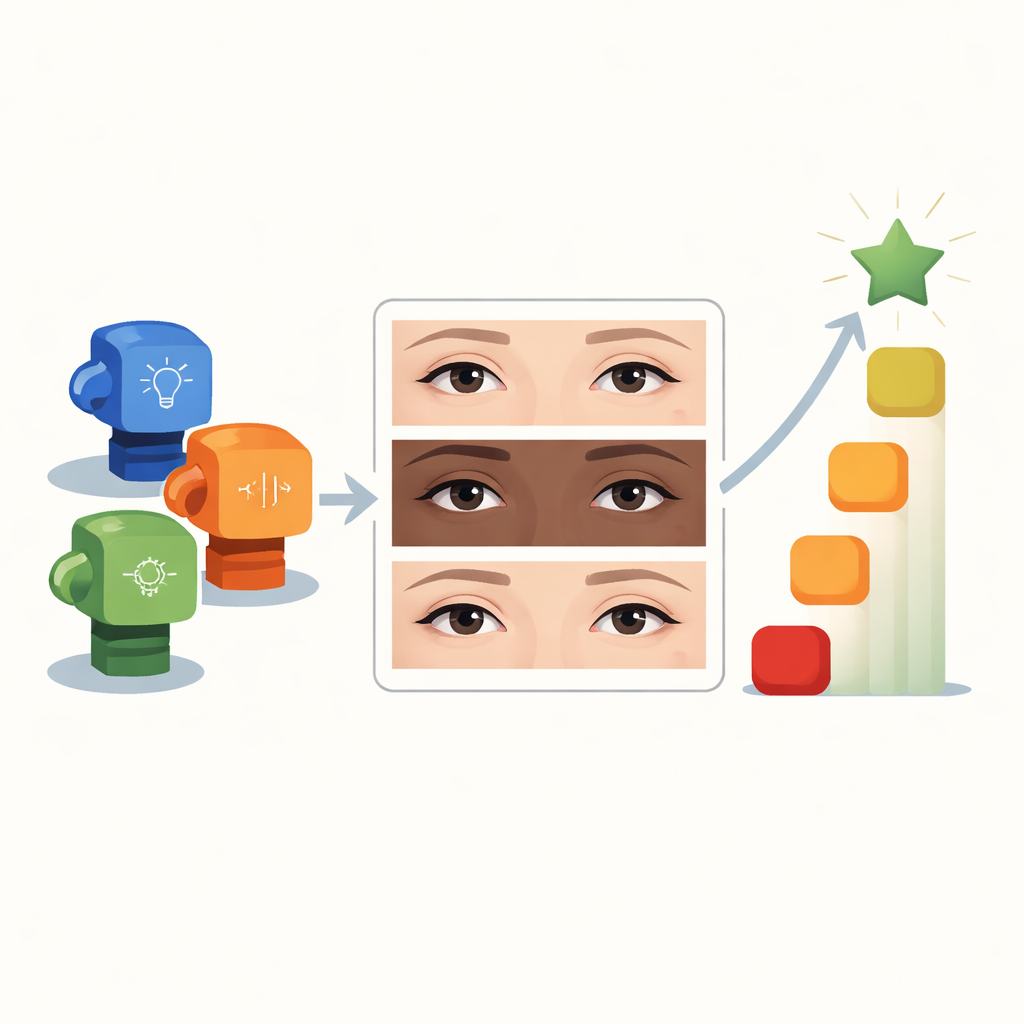

Die Forschenden konzentrierten sich auf einen bekannten psychologischen Test namens „Reading the Mind in the Eyes“. Bei dieser Aufgabe wird nur der Augenbereich eines Gesichts gezeigt und die Testperson muss auswählen, welches Gefühl oder welcher Geisteszustand in den Augen ausgedrückt wird. Es gibt drei Versionen des Tests, die jeweils Fotos von weißen, schwarzen oder koreanischen Personen verwenden. Menschen finden es häufig schwerer, Emotionen in Gesichtern einer anderen Ethnie zu beurteilen – ein Muster, das als „other-race effect“ (Fremdrasseneffekt) bekannt ist. Die Studie fragte, ob fortgeschrittene KI-Systeme eine ähnliche Schwäche zeigen oder ob sie Emotionen über diese unterschiedlichen Gesichtssätze hinweg gleich gut erkennen können.

Drei KI-Systeme im Test

Das Team bewertete drei verbreitete multimodale große Sprachmodelle – Systeme, die sowohl Bilder als auch Text verarbeiten können. Getestet wurden ein älteres auf GPT-4 basierendes Modell, ein neueres auf GPT-4o basierendes Modell und ein konkurrierendes System namens Claude 3 Opus. Jedes Modell absolvierte alle drei Versionen des Augentests zweimal, sodass die Forschenden sowohl die Genauigkeit als auch die Konsistenz über die Zeit überprüfen konnten. Die KI-Modelle sahen jedes Augenbild mit vier möglichen Antworten und mussten, wie ein menschlicher Proband, eine Option auswählen. Anschließend verglichen die Wissenschaftler die KI-Ergebnisse mit denen großer Gruppen von Menschen, die dieselben Tests zuvor absolviert hatten.

Wie gut die Maschinen abschnitten

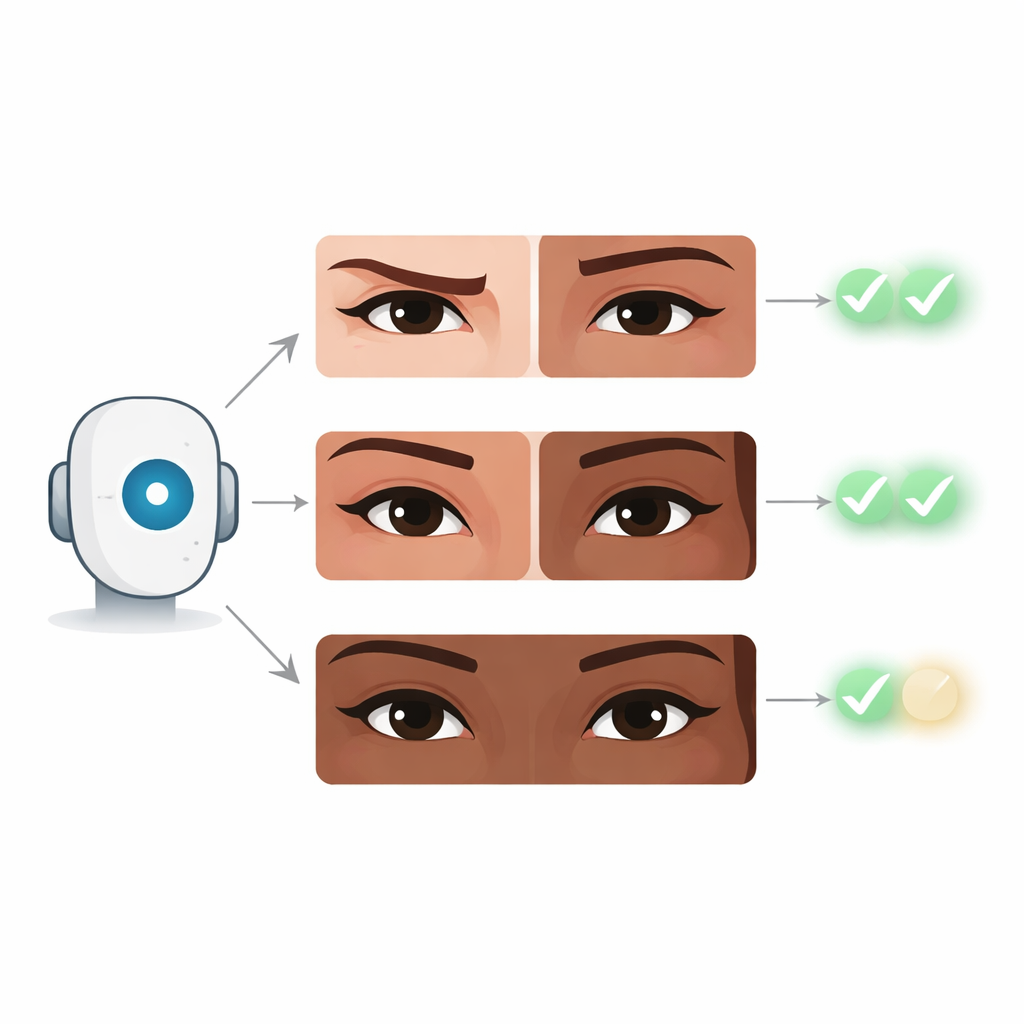

Das neuere GPT-4o-Modell fiel positiv auf. Es beantwortete etwa 83 % der Items bei weißen Gesichtern, 94 % bei schwarzen Gesichtern und 86 % bei koreanischen Gesichtern korrekt. Diese Werte lagen ungefähr im 85. bis 94. Perzentil im Vergleich zur menschlichen Leistung, das heißt: es schnitt besser ab als die meisten Menschen, die diese Tests gemacht haben. Wichtig ist, dass seine Leistungsfähigkeit über alle drei ethnischen Gruppen hinweg ähnlich war, was darauf hindeutet, dass es nicht die gleiche Art von ethnischer Verzerrung zeigte, die Menschen bei solchen Aufgaben oft zeigen. Das ältere GPT-4-Modell lag zwar über dem Niveau zufälligen Ratschätzens, erreichte aber eher durchschnittliche menschliche Werte, während Claude 3 Opus nahe der Zufallserwartung bewegte und wie jemand performte, der größtenteils rät.

Was die KI leicht bzw. schwer fand

Um über reine Punktzahlen hinauszugehen, untersuchten die Autorinnen und Autoren, welche Arten von Emotionen die Modelle gut oder schlecht bewältigten. Über die Systeme hinweg erkannten sie innere Zustände wie Besorgtheit, Unruhe oder Nachdenklichkeit mit hoher Genauigkeit. Dagegen taten sie sich schwerer mit sozial reichhaltigen, positiven Ausdrücken, die zwischenmenschliche Bedeutung tragen – etwa Verspieltheit, Freundlichkeit oder Flirten. Das neuere GPT-4o-System verringerte diese Fehler stärker als die anderen, was andeutet, dass jede neue KI-Generation womöglich besser darin wird, subtile soziale Signale zu erfassen, die frühere Modelle übersehen.

Was das für Menschen bedeuten könnte

Die Ergebnisse eröffnen sowohl spannende Möglichkeiten als auch wichtige Vorbehalte. Einerseits könnte ein System, das Emotionen aus Gesichtern mindestens so gut oder besser als viele Menschen liest – und dies über ethnische Gruppen hinweg ähnlich tut – eines Tages Psychologen, Ärzten oder Lehrkräften als stabile zweite Meinung zu sozialen Hinweisen dienen. Andererseits hat der Augentest selbst erhebliche wissenschaftliche Grenzen und bildet vielleicht kein reales soziales Verständnis ab, das von Körpersprache, Stimmlage und Kontext abhängt. Die Autorinnen und Autoren betonen, dass diese Befunde nicht beweisen, dass KI echte Empathie besitzt oder in anderen Kontexten frei von Verzerrungen ist. Vielmehr liefern die Ergebnisse einen frühen Referenzpunkt: Bei einer engen, kontrollierten Aufgabe, die auf den Augenbereich fokussiert, scheint zumindest eine moderne KI sehr genau und relativ fair zwischen verschiedenen Ethniegruppen zu sein – doch es bedarf deutlich mehr Forschung, bevor solche Werkzeuge reale Entscheidungen beeinflussen sollten.

Zitation: Refoua, E., Elyoseph, Z., Piterman, D. et al. Evaluation of cross-ethnic emotion recognition capabilities in multimodal large language models using the reading the mind in the eyes test. Sci Rep 16, 9975 (2026). https://doi.org/10.1038/s41598-026-39292-y

Schlüsselwörter: Emotionserkennung, künstliche Intelligenz, soziale Kognition, ethnienübergreifende Verzerrung, psychische Gesundheit