Clear Sky Science · pl

Ocena zdolności rozpoznawania emocji międzyetnicznych w multimodalnych dużych modelach językowych przy użyciu testu "Czytanie umysłu z oczu"

Dlaczego to ma znaczenie w życiu codziennym

Wyobraź sobie program komputerowy, który potrafi spojrzeć na czyjeś oczy i odgadnąć, co ta osoba czuje — czasem bardziej trafnie niż większość ludzi. Badanie stawia pytanie, czy takie systemy potrafią robić to uczciwie wobec osób z różnych grup etnicznych. W miarę jak narzędzia sztucznej inteligencji (AI) trafiają do służby zdrowia, edukacji i codziennych aplikacji, ważne jest ustalenie, czy traktują różne grupy ludzi równo — to kluczowe dla zaufania, bezpieczeństwa i etyki.

Szukając uczuć w oczach

Naukowcy skupili się na znanym teście psychologicznym „Czytanie umysłu z oczu”. W tym zadaniu pokazywany jest jedynie obszar oczu twarzy, a obserwator musi wybrać, jaką emocję lub stan umysłowy wyrażają oczy. Istnieją trzy wersje testu, każda wykorzystująca zdjęcia osób białych, czarnoskórych lub koreańskich. Ludzie często mają trudności z oceniając emocje na twarzach osób z innej grupy etnicznej — to zjawisko znane jako „efekt innych ras”. Badanie pytało, czy zaawansowane systemy AI przejawiają podobną słabość, czy też potrafią rozpoznawać emocje równie dobrze we wszystkich tych zestawach twarzy.

Trzy systemy AI poddane próbie

Zespół ocenił trzy popularne multimodalne duże modele językowe — systemy potrafiące przetwarzać obrazy i tekst. Testowano starszy model oparty na GPT-4, nowszy model oparty na GPT-4o oraz konkurencyjny system Claude 3 Opus. Każdy model wykonał wszystkie trzy wersje testu oczu dwukrotnie, aby badacze mogli sprawdzić zarówno dokładność, jak i spójność wyników w czasie. Modele AI widziały każde zdjęcie oczu z czterema możliwymi odpowiedziami i musiały wybrać jedną, tak jak ludzki uczestnik testu. Naukowcy następnie porównali wyniki AI z wynikami dużych grup ludzi, które wcześniej wykonywały te same testy.

Jak poradziły sobie maszyny

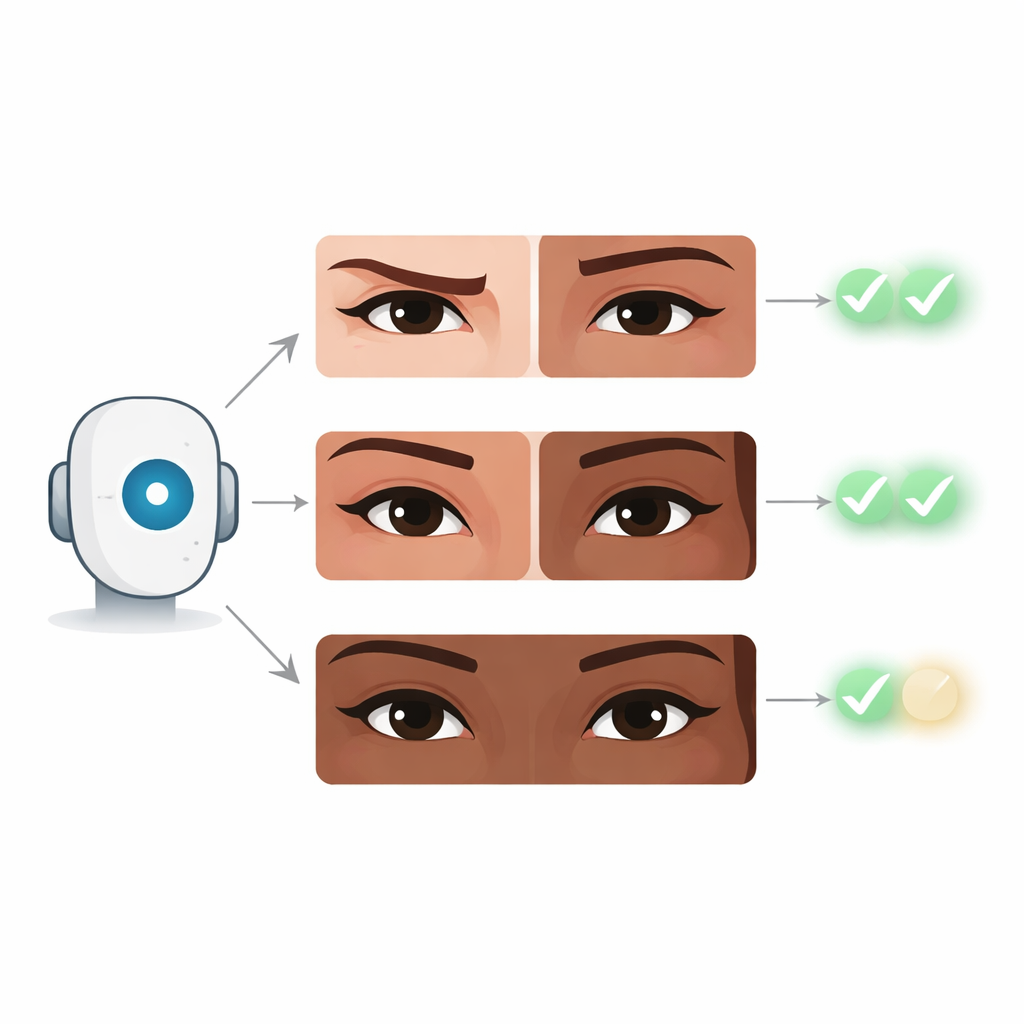

Najnowszy model GPT-4o wyróżniał się. Odpowiadał poprawnie na około 83% pozycji dla twarzy białych, 94% dla twarzy czarnoskórych i 86% dla twarzy koreańskich. Wyniki te plasowały go mniej więcej w 85. do 94. percentyla w porównaniu z wynikami ludzi, co oznacza, że poradził sobie lepiej niż większość osób, które wykonywały te testy. Co ważne, jego skuteczność była podobna we wszystkich trzech grupach etnicznych, co sugeruje, że nie przejawiał tego rodzaju uprzedzeń etnicznych, które często obserwuje się u ludzi w takich zadaniach. Starszy model GPT-4 radził sobie lepiej niż losowe zgadywanie, ale osiągał wyniki bliższe przeciętnym poziomom ludzkim, podczas gdy Claude 3 Opus oscylował wokół poziomu losowego, zachowując się jak ktoś, kto głównie zgaduje.

Co AI uważało za łatwe, a co za trudne

Aby pójść dalej niż proste sumy punktów, autorzy przeanalizowali, jakiego rodzaju emocje modele rozpoznawały dobrze, a z którymi miały problemy. We wszystkich systemach lepiej rozpoznawano stany wewnętrzne, takie jak zmartwienie, niespokojność czy zadumę, z wysoką dokładnością. Natomiast większe trudności sprawiały im społecznie bogate, pozytywne wyrazy niosące znaczenie interpersonalne — na przykład bycie figlarnym, przyjaznym czy zalotnym. Nowszy system GPT-4o zmniejszał te błędy bardziej niż pozostałe, co sugeruje, że każde nowe pokolenie AI może coraz lepiej wychwytywać subtelne sygnały społeczne, które umykają wcześniejszym modelom.

Co to może oznaczać dla ludzi

Wyniki rodzą zarówno ekscytujące możliwości, jak i istotne zastrzeżenia. Z jednej strony system, który potrafi czytać emocje z twarzy równie dobrze lub lepiej niż wielu ludzi — i robi to podobnie w różnych grupach etnicznych — mógłby kiedyś wspierać psychologów, lekarzy czy nauczycieli, oferując bardziej stabilną opinię pomocniczą w zakresie wskazówek społecznych. Z drugiej strony sam test oczu ma poważne ograniczenia naukowe i może nie odzwierciedlać rozumienia społecznego w rzeczywistych sytuacjach, które zależy od mowy ciała, tonu głosu i kontekstu. Autorzy podkreślają, że wyniki te nie dowodzą, iż AI ma prawdziwą empatię ani że jest wolna od uprzedzeń w innych zastosowaniach. Raczej praca ta dostarcza wczesnego punktu odniesienia: w wąskim, kontrolowanym zadaniu skupionym na obszarze oczu co najmniej jedno nowoczesne AI wydaje się wysoce dokładne i stosunkowo bezstronne wobec różnych grup etnicznych, ale potrzeba znacznie więcej badań, zanim takie narzędzia powinny wpływać na decyzje w świecie rzeczywistym.

Cytowanie: Refoua, E., Elyoseph, Z., Piterman, D. et al. Evaluation of cross-ethnic emotion recognition capabilities in multimodal large language models using the reading the mind in the eyes test. Sci Rep 16, 9975 (2026). https://doi.org/10.1038/s41598-026-39292-y

Słowa kluczowe: rozpoznawanie emocji, sztuczna inteligencja, poznanie społeczne, uprzedzenia międzyetniczne, zdrowie psychiczne