Clear Sky Science · it

Valutazione delle capacità di riconoscimento delle emozioni cross-etniche nei modelli linguistici multimodali di grande scala usando il test "Reading the Mind in the Eyes"

Perché questo conta nella vita quotidiana

Immaginate un programma informatico in grado di osservare gli occhi di una persona e indovinarne lo stato emotivo—talvolta con maggiore accuratezza rispetto alla maggior parte degli esseri umani. Questo studio indaga se sistemi di questo tipo siano in grado di farlo in modo equo per persone di diverse origini etniche. Man mano che gli strumenti di intelligenza artificiale (IA) entrano nel campo della sanità, dell’istruzione e delle applicazioni quotidiane, sapere se trattano i diversi gruppi in modo paritario è cruciale per fiducia, sicurezza ed etica.

Cercare le emozioni negli occhi

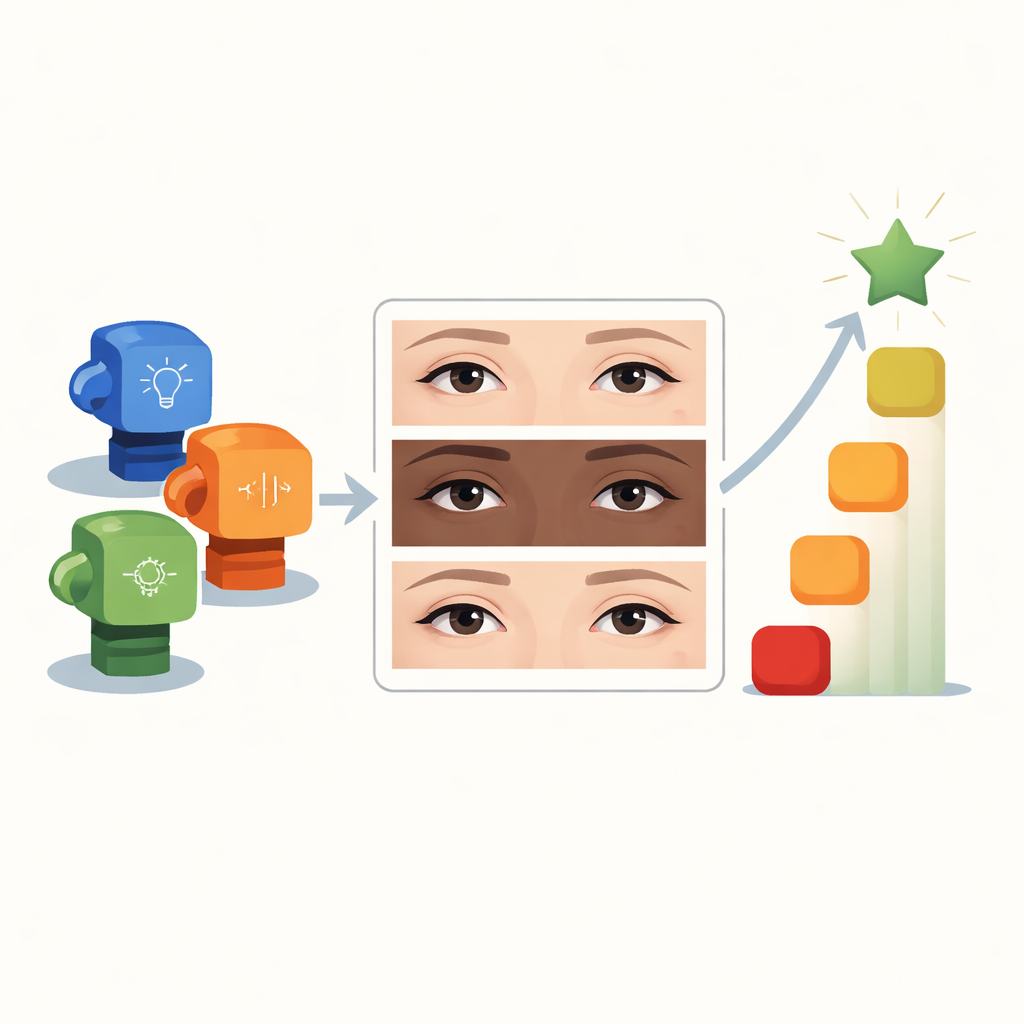

I ricercatori si sono concentrati su un noto test psicologico chiamato “Reading the Mind in the Eyes”. In questo compito viene mostrata solo la regione degli occhi di un volto e l’osservatore deve scegliere quale emozione o stato mentale gli occhi esprimono. Esistono tre versioni del test, ciascuna con foto di individui bianchi, neri o coreani. Le persone spesso trovano più difficile giudicare le emozioni dai volti di un gruppo etnico diverso dal proprio, un fenomeno noto come “effetto dell’altra razza”. Lo studio ha chiesto se i sistemi IA avanzati mostrino una debolezza simile, o se riescano a riconoscere le emozioni in modo altrettanto efficace attraverso questi diversi set di volti.

Mettere alla prova tre sistemi IA

Il team ha valutato tre popolari modelli linguistici multimodali—sistemi in grado di elaborare sia immagini sia testo. Hanno testato un modello basato su GPT-4 più datato, un modello più recente basato su GPT-4o e un sistema concorrente chiamato Claude 3 Opus. Ciascun modello ha completato tutte e tre le versioni del test degli occhi due volte, in modo che i ricercatori potessero verificare sia l’accuratezza sia la coerenza nel tempo. I modelli IA hanno visto ogni immagine degli occhi con quattro possibili risposte e dovevano sceglierne una, proprio come un soggetto umano. Gli scienziati hanno poi confrontato i punteggi delle IA con quelli di ampi gruppi di persone che avevano precedentemente sostenuto gli stessi test.

Come se l’hanno cavata le macchine

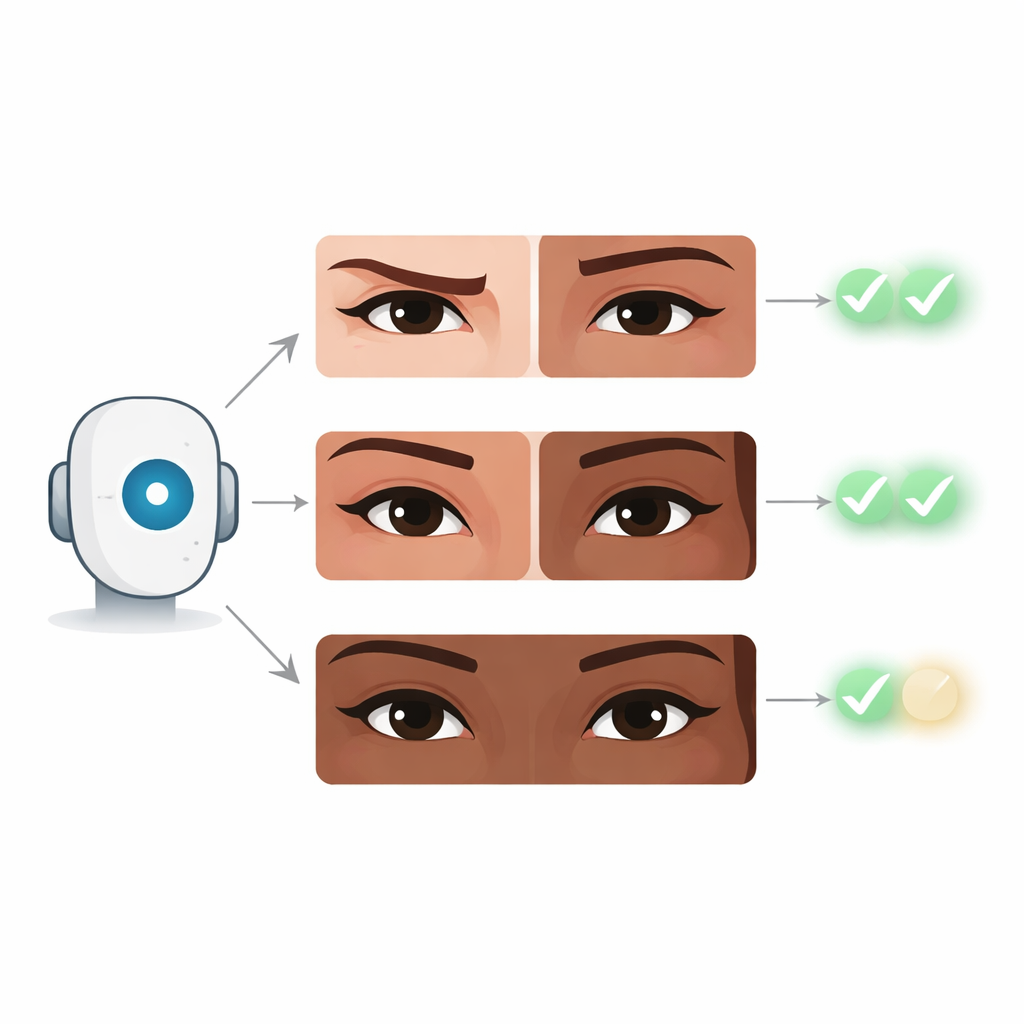

Il modello più recente, GPT-4o, si è distinto. Ha risposto correttamente in circa l’83% degli item per i volti bianchi, il 94% per i volti neri e l’86% per i volti coreani. Questi punteggi lo collocano grosso modo tra l’85° e il 94° percentile rispetto alle prestazioni umane, il che significa che ha fatto meglio della maggior parte delle persone che hanno sostenuto questi test. È importante notare che il suo successo è stato simile tra tutti e tre i gruppi etnici, suggerendo che non mostrava lo stesso tipo di bias etnico che le persone spesso evidenziano in tali compiti. Il modello GPT-4 più vecchio ha fatto meglio del caso, ma si è attestato vicino ai livelli medi umani, mentre Claude 3 Opus si è avvicinato alla casualità, comportandosi come chi stava per lo più indovinando.

Cosa l’IA ha trovato facile e cosa difficile

Per andare oltre i semplici totali di punteggio, gli autori hanno esaminato quali tipi di emozioni i modelli gestivano bene o male. Nei diversi sistemi, tendevano a riconoscere con alta accuratezza stati interiori come essere preoccupato, a disagio o pensieroso. Al contrario, faticavano di più con espressioni socialmente ricche e positive che veicolano significati interpersonali—come essere giocoso, amichevole o civettuolo. Il sistema più recente GPT-4o ha ridotto questi errori più degli altri, suggerendo che ogni nuova generazione di IA potrebbe migliorare nel cogliere segnali sociali sottili che i modelli precedenti non rilevavano.

Cosa potrebbe significare per le persone

I risultati sollevano sia possibilità interessanti sia importanti cautele. Da un lato, un sistema in grado di leggere le emozioni dai volti tanto bene—o meglio—di molti esseri umani e di farlo in modo simile tra gruppi etnici diversi potrebbe un giorno assistere psicologi, medici o insegnanti offrendo un parere secondario più stabile sui segnali sociali. Dall’altro, lo stesso test degli occhi ha limiti scientifici seri e potrebbe non rispecchiare la comprensione sociale nella vita reale, che dipende dal linguaggio del corpo, dal tono di voce e dal contesto. Gli autori sottolineano che questi risultati non dimostrano che l’IA possieda vera empatia né che sia priva di bias in altri contesti. Piuttosto, il lavoro offre un primo punto di riferimento: per un compito ristretto e controllato centrato sulla regione degli occhi, almeno una IA moderna appare altamente accurata e relativamente equa tra diversi gruppi etnici, ma sono necessarie molte più ricerche prima che tali strumenti possano influenzare decisioni nel mondo reale.

Citazione: Refoua, E., Elyoseph, Z., Piterman, D. et al. Evaluation of cross-ethnic emotion recognition capabilities in multimodal large language models using the reading the mind in the eyes test. Sci Rep 16, 9975 (2026). https://doi.org/10.1038/s41598-026-39292-y

Parole chiave: riconoscimento delle emozioni, intelligenza artificiale, cognizione sociale, pregiudizio cross-etnico, salute mentale