Clear Sky Science · fr

Évaluation des capacités de reconnaissance des émotions interethniques dans des modèles de langage multimodaux à grande échelle à l’aide du test « Reading the Mind in the Eyes »

Pourquoi cela compte au quotidien

Imaginez un programme informatique capable de regarder les yeux d’une personne et d’estimer ce qu’elle ressent — parfois avec plus de précision que la plupart des humains. Cette étude interroge si de tels systèmes peuvent accomplir cette tâche de manière équitable pour des personnes de différents groupes ethniques. À mesure que les outils d’intelligence artificielle (IA) s’immiscent dans la santé, l’éducation et les applications courantes, il est essentiel de savoir s’ils traitent les différents groupes de façon égale pour garantir confiance, sécurité et éthique.

Lire les émotions dans les yeux

Les chercheurs se sont concentrés sur un test psychologique bien connu appelé « Reading the Mind in the Eyes ». Dans cette tâche, seule la région des yeux d’un visage est montrée, et la personne doit choisir quelle émotion ou quel état d’esprit les yeux expriment. Il existe trois versions du test, chacune utilisant des photos d’individus blancs, noirs ou coréens. Les gens ont souvent plus de difficulté à juger les émotions sur des visages d’un autre groupe ethnique, un phénomène appelé « effet de l’autre race ». L’étude a demandé si des systèmes d’IA avancés présentaient une faiblesse similaire ou s’ils pouvaient reconnaître les émotions de façon équivalente à travers ces différents ensembles de visages.

Trois systèmes d’IA mis à l’épreuve

L’équipe a évalué trois modèles multimodaux de grande taille populaires — des systèmes capables de traiter à la fois des images et du texte. Ils ont testé un modèle ancien basé sur GPT-4, un modèle plus récent basé sur GPT-4o, et un système concurrent nommé Claude 3 Opus. Chaque modèle a complété les trois versions du test des yeux deux fois, de manière à ce que les chercheurs puissent vérifier à la fois la précision et la cohérence dans le temps. Les modèles ont vu chaque image d’yeux avec quatre réponses possibles et devaient en choisir une, comme le ferait un participant humain. Les scientifiques ont ensuite comparé les scores des IA à ceux de larges groupes de personnes ayant déjà passé les mêmes tests.

Les performances des machines

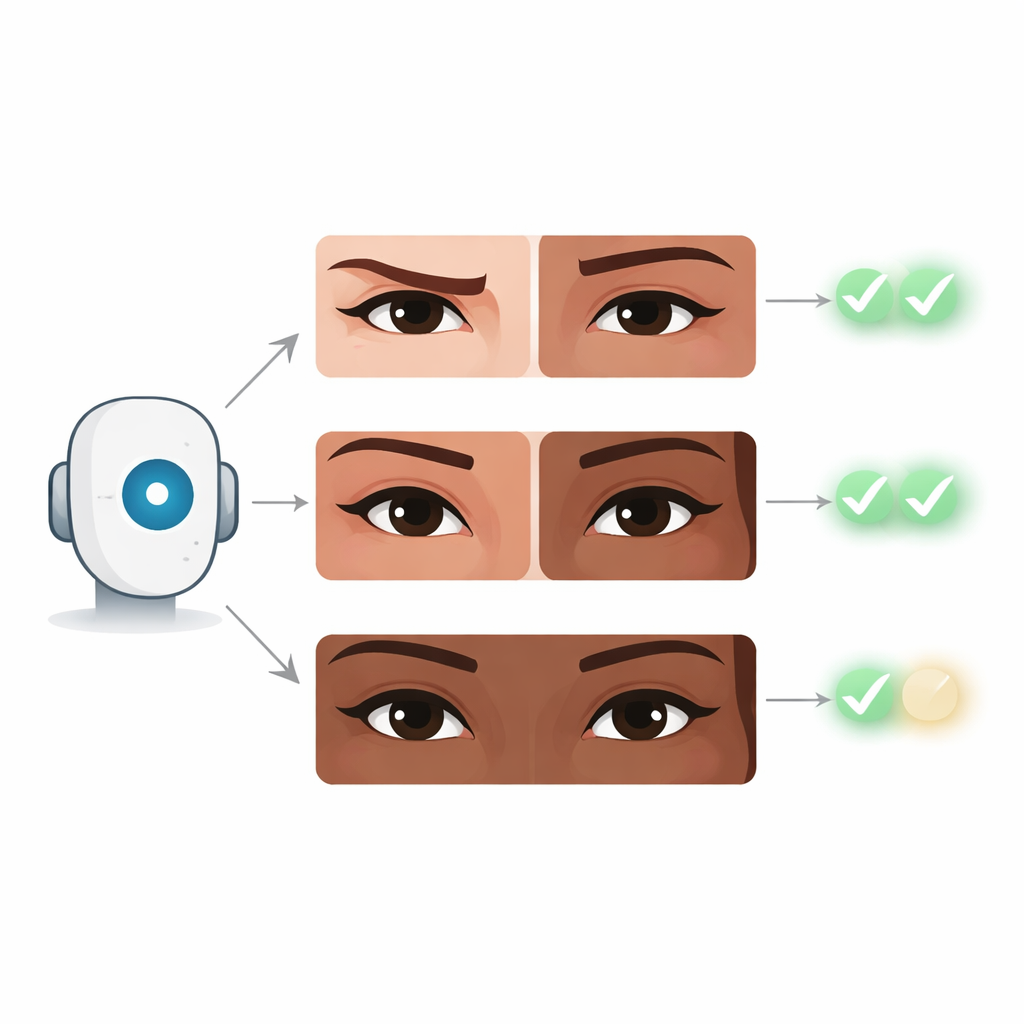

Le modèle GPT-4o le plus récent s’est distingué. Il a répondu correctement à environ 83 % des items pour les visages blancs, 94 % pour les visages noirs et 86 % pour les visages coréens. Ces scores le placent environ dans les 85e à 94e percentiles par rapport aux performances humaines, ce qui signifie qu’il a fait mieux que la plupart des personnes ayant passé ces tests. Fait important, son succès était similaire pour les trois groupes ethniques, suggérant qu’il ne présentait pas le même type de biais ethnique que celui souvent observé chez les humains sur ce type de tâche. Le modèle GPT-4 plus ancien a fait mieux que le hasard mais s’est situé plutôt au niveau moyen humain, tandis que Claude 3 Opus s’est approché du niveau du hasard, se comportant comme quelqu’un qui devine majoritairement.

Ce que l’IA a trouvé facile ou difficile

Pour aller au-delà des simples totaux de scores, les auteurs ont examiné quels types d’émotions les modèles traitaient bien ou mal. Globalement, ils reconnaissaient avec une haute précision des états intérieurs comme l’inquiétude, le malaise ou la réflexion. En revanche, ils peinaient davantage avec des expressions socialement riches et positives qui portent une signification interpersonnelle — par exemple l’espièglerie, la convivialité ou le flirt. Le système GPT-4o plus récent a réduit ces erreurs davantage que les autres, ce qui laisse entendre que chaque nouvelle génération d’IA pourrait mieux capter des signaux sociaux subtils que les modèles précédents manquaient.

Ce que cela pourrait signifier pour les personnes

Ces résultats ouvrent des perspectives enthousiasmantes tout en appelant à la prudence. D’une part, un système capable de lire les émotions à partir d’un visage aussi bien, voire mieux, que de nombreux humains — et de le faire de manière comparable entre groupes ethniques — pourrait un jour aider psychologues, médecins ou enseignants en fournissant un deuxième avis plus stable sur des indices sociaux. D’autre part, le test des yeux présente des limites scientifiques importantes et peut ne pas refléter la compréhension sociale en situation réelle, qui dépend du langage corporel, du ton de la voix et du contexte. Les auteurs insistent sur le fait que ces résultats ne prouvent pas que l’IA ait une véritable empathie ni qu’elle soit exempte de biais dans d’autres contextes. Plutôt, ce travail offre un premier repère : pour une tâche étroite et contrôlée centrée sur la région des yeux, au moins une IA moderne apparaît très précise et relativement impartiale entre groupes ethniques, mais beaucoup plus de recherches sont nécessaires avant que de tels outils n’influencent des décisions du monde réel.

Citation: Refoua, E., Elyoseph, Z., Piterman, D. et al. Evaluation of cross-ethnic emotion recognition capabilities in multimodal large language models using the reading the mind in the eyes test. Sci Rep 16, 9975 (2026). https://doi.org/10.1038/s41598-026-39292-y

Mots-clés: reconnaissance des émotions, intelligence artificielle, cognition sociale, biais interethnique, santé mentale