Clear Sky Science · nl

Evaluatie van cross-etnische emotieherkenningsmogelijkheden in multimodale grote taalmodellen met behulp van de Reading the Mind in the Eyes-test

Waarom dit van belang is voor het dagelijkse leven

Stel je een computerprogramma voor dat iemands ogen kan bekijken en kan raden wat die persoon voelt—soms zelfs nauwkeuriger dan de meeste mensen. Deze studie onderzoekt of zulke systemen eerlijk kunnen oordelen over mensen met verschillende etnische achtergronden. Nu kunstmatige intelligentie (AI)-hulpmiddelen steeds vaker worden ingezet in de gezondheidszorg, het onderwijs en alledaagse apps, is het essentieel om te weten of ze verschillende groepen mensen gelijk behandelen voor vertrouwen, veiligheid en ethiek.

Gevoelens aflezen uit de ogen

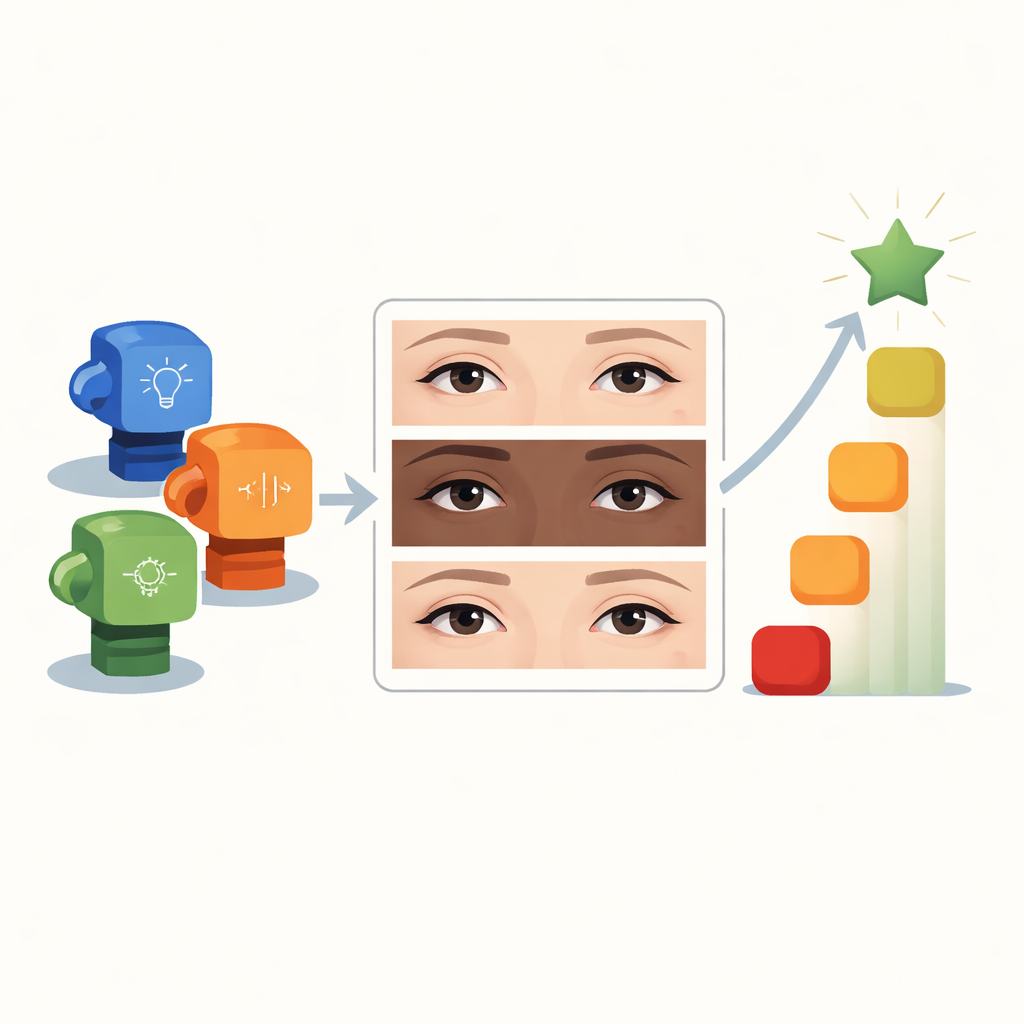

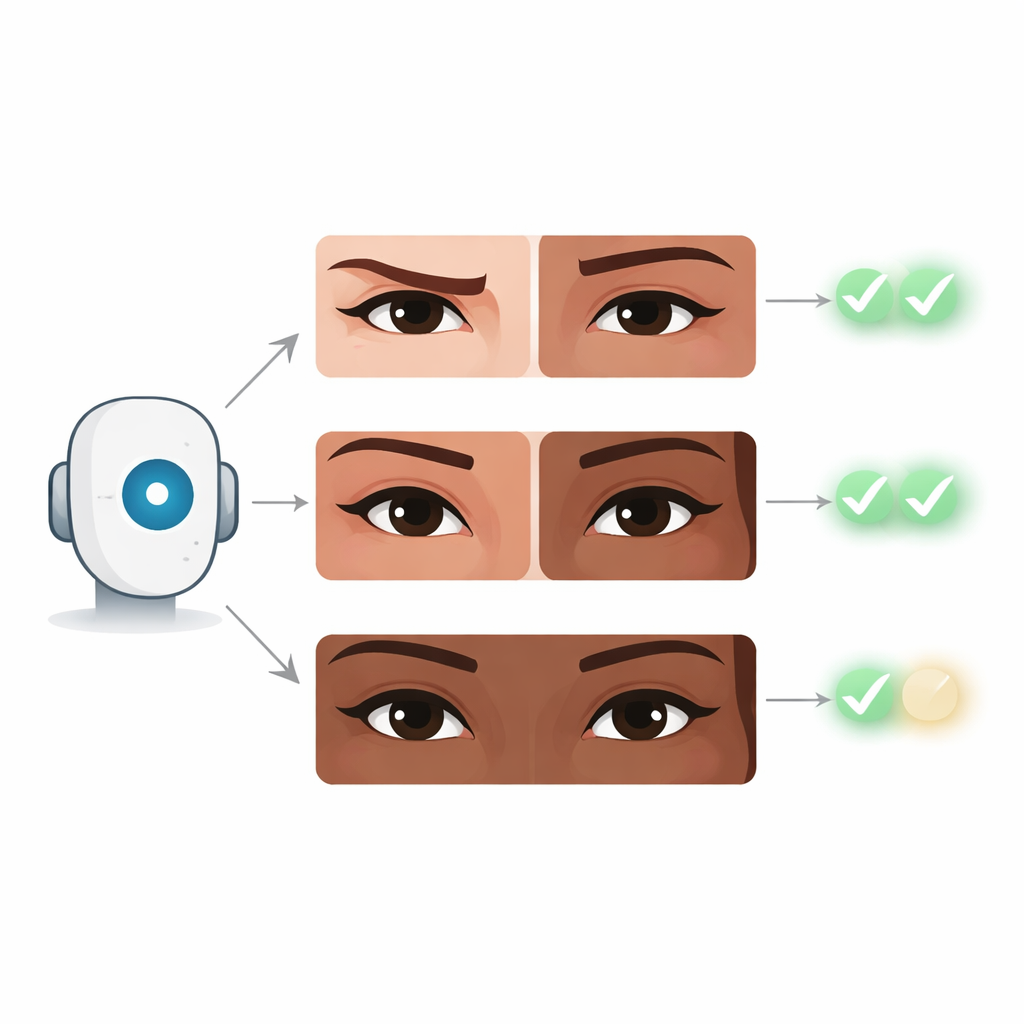

De onderzoekers concentreerden zich op een bekende psychologische test genaamd “Reading the Mind in the Eyes.” Bij deze taak wordt alleen het ooggebied van een gezicht getoond en moet de kijker kiezen welke emotie of gemoedstoestand de ogen uitdrukken. Er zijn drie versies van de test, elk met foto’s van witte, zwarte of Koreaanse personen. Mensen vinden het vaak moeilijker emoties in gezichten van een andere etnische groep te beoordelen, een patroon dat bekendstaat als het “other-race effect.” De studie vroeg of geavanceerde AI-systemen een vergelijkbare zwakte tonen, of dat ze emoties even goed kunnen herkennen over deze verschillende gezichtspopulaties heen.

Drie AI-systemen op de proef

Het team evalueerde drie populaire multimodale grote taalmodellen—systemen die zowel afbeeldingen als tekst kunnen verwerken. Ze testten een ouder model op basis van GPT-4, een nieuwer model gebaseerd op GPT-4o, en een concurrerend systeem genaamd Claude 3 Opus. Elk model voltooide alle drie versies van de oogtest twee keer, zodat de onderzoekers zowel nauwkeurigheid als consistentie in de loop van de tijd konden controleren. De AI-modellen zagen bij elke oogfoto vier mogelijke antwoorden en moesten er één kiezen, net zoals een menselijke deelnemer. De wetenschappers vergeleken de AI-scores vervolgens met die van grote groepen mensen die eerder dezelfde tests hadden gemaakt.

Hoe goed de machines het deden

Het nieuwere GPT-4o-model sprong eruit. Het gaf ongeveer 83% juiste antwoorden voor witte gezichten, 94% voor zwarte gezichten en 86% voor Koreaanse gezichten. Deze scores plaatsten het ongeveer in het 85e tot 94e percentiel vergeleken met menselijke prestaties, wat betekent dat het beter presteerde dan de meeste mensen die deze tests hebben gemaakt. Belangrijk was dat het succes vergelijkbaar was over alle drie etnische groepen, wat suggereert dat het niet dezelfde soort etnische bias vertoonde die mensen vaak laten zien bij zulke taken. Het oudere GPT-4-model deed het beter dan willekeurig raden maar scoorde dichter bij gemiddelde menselijke niveaus, terwijl Claude 3 Opus rond kansniveau presteerde en zich gedroeg als iemand die vooral aan het gokken was.

Wat de AI makkelijk en moeilijk vond

Om verder te gaan dan simpele totaalscores onderzochten de auteurs welke soorten emoties de modellen goed of slecht herkenden. Over de systemen heen gingen ze er doorgaans goed in om innerlijke toestanden zoals bezorgdheid, ongemak of nadenkendheid nauwkeurig te herkennen. Daarentegen hadden ze meer moeite met sociaal rijke, positieve uitdrukkingen die interpersoonlijke betekenis dragen—zoals speelsheid, vriendelijkheid of flirtgedrag. Het nieuwere GPT-4o-systeem verminderde deze fouten meer dan de andere, wat erop wijst dat elke nieuwe generatie AI mogelijk beter wordt in het oppikken van subtiele sociale signalen die eerdere modellen missen.

Wat dit voor mensen zou kunnen betekenen

De bevindingen roepen zowel veelbelovende mogelijkheden als belangrijke voorzichtigheid op. Aan de ene kant zou een systeem dat emoties van gezichten even goed of beter kan lezen dan veel mensen—en dat dit op vergelijkbare wijze over etnische groepen heen doet—op een dag psychologen, artsen of leraren kunnen bijstaan door een stabieler tweede oordeel over sociale signalen te leveren. Aan de andere kant heeft de oogtest zelf ernstige wetenschappelijke beperkingen en weerspiegelt mogelijk geen sociale begrip in het echte leven, dat afhankelijk is van lichaamstaal, intonatie en context. De auteurs benadrukken dat deze resultaten niet bewijzen dat AI echte empathie heeft of dat het vrij is van bias in andere situaties. In plaats daarvan biedt het werk een vroeg benchmark: voor een smalle, gecontroleerde taak gericht op het ooggebied lijkt ten minste één modern AI-model zeer nauwkeurig en relatief gelijkmatig over verschillende etnische groepen, maar veel meer onderzoek is nodig voordat zulke tools echte beslissingen zouden moeten beïnvloeden.

Bronvermelding: Refoua, E., Elyoseph, Z., Piterman, D. et al. Evaluation of cross-ethnic emotion recognition capabilities in multimodal large language models using the reading the mind in the eyes test. Sci Rep 16, 9975 (2026). https://doi.org/10.1038/s41598-026-39292-y

Trefwoorden: emotieherkenning, kunstmatige intelligentie, sociale cognitie, cross-etnische vooringenomenheid, geestelijke gezondheid