Clear Sky Science · tr

Örnekleme yoluyla derin sinir ağı performansını iyileştirme

Minik Yazı-Tura Nöronlarla Daha Akıllı Yapay Zeka

Yapay zeka güçlendikçe enerji açlığı da arttı. Modern görüntü ve dil modellerini eğitmek ve çalıştırmak, küçük kasabalardaki kadar elektrik çekebiliyor. Bu makale, sezgisel olarak beklenmedik bir fikri araştırıyor: sinir ağlarını giderek daha hassas ve karmaşık hale getirmek yerine, yapı taşlarını daha basit ve gürültülü—dijital yazı-tura atmaya benzeyen—hale getirip, eşdeğer veya daha iyi sonuçları enerji tasarrufu sağlayarak akıllı örnekleme ile elde edebilir miyiz?

Kesin Devrelerden Olasılıksal Beyinlere

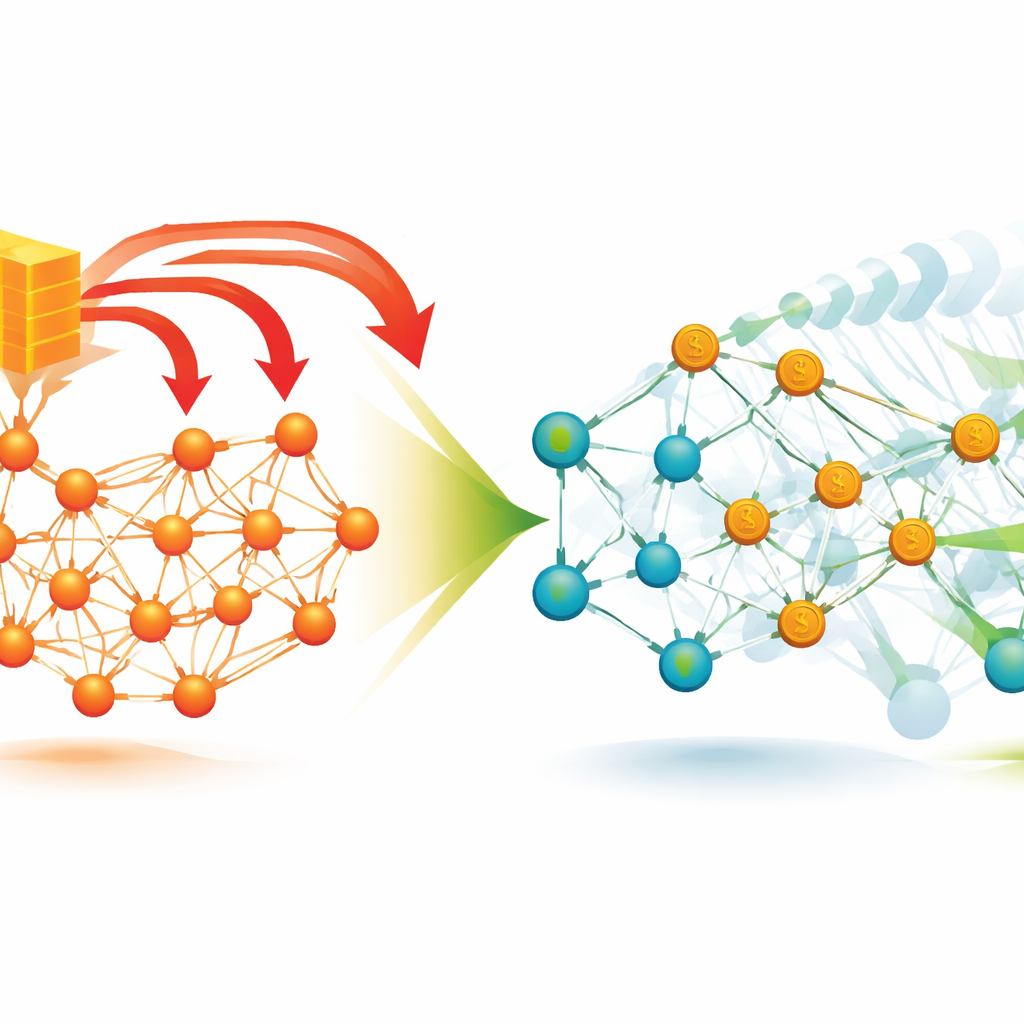

Günümüzün derin sinir ağlarının çoğu “deterministik” birimler kullanır: aynı girdileri verirseniz her zaman aynı sonucu alırsınız. Yazarlar, p-bit olarak adlandırılan alternatif bir yaklaşıma odaklanıyor. Her p-bit, girişleriyle belirlenen olasılıklara göre 0 ile 1 arasında değişen, küçük ve eğimli bir yazı-tura gibi davranır. Aynı p-bit ağından birden fazla örnek alıp çıktılarını ortalamak, o ağa daha zengin, çok-bitli davranışları saklamadan ya da birçok hassas sayıyı taşımadan yaklaştırma imkânı verir. Bu fikir, modern yapay zekayı daha önce optimizasyon ve örnekleme problemleri için verimli olduğu bilinen Ising ve Boltzmann makineleriyle ilişkilendirir.

Tek Ağır Cevap Yerine Birçok Hızlı Tahmin Kullanmak

Çalışma basit ama pratik bir soru soruyor: daha iyi doğruluk istiyorsak, her nörona daha fazla dijital hassasiyet eklemek mi daha ucuza gelir, yoksa nöronları son derece basit tutup onlardan birden çok örnek almak mı? Yazarlar, bir sinir ağındaki temel işlemin maliyetini bellekten ağırlık okuma, aktivite okuma/yazma, girişleri birleştirme (sinaps) ve doğrusal olmayan işlemi uygulama (nöron) olmak üzere dört parçaya ayıran genel bir enerji formülü kuruyor. Önemli olarak, ağırlıklar bir kez okunup birkaç örnek üretmek için tekrar kullanılabildiğinden, baskın maliyet—belleğe erişim—birçok çalışmaya yayılabiliyor. Bu da on örneğin birden on kat daha pahalı olmadığı anlamına geliyor.

Görüntüler Üzerinde Olasılıksal Ağları Test Etmek

Bu takasın pratikte işe yarayıp yaramadığını görmek için araştırmacılar, olasılıksal derin sinir ağlarını (p-DNN) hem görüntü sınıflandırma (CIFAR-10) hem de görüntü üretimi (CelebA yüzleri ve MNIST rakamları) üzerinde test ediyorlar. Standart çok bitli aktivasyon sinyallerini tek bitlik p-bitlerle değiştiriyor ve ağları, kayıp fonksiyonunun birkaç stokastik ileri geçişin ortalamasından hesaplandığı “örneklemeye duyarlı” bir şekilde eğitiyorlar. Sınıflandırmada, 1 bitlik aktivasyonlarla bile tek bir örneğin tam hassasiyetli bir modelin doğruluğuna eşdeğer olabileceğini ve iki örneğin bunu aşabildiğini görüyorlar. Daha fazla örnekle, 1-bit p-DNN’ler 3-bit deterministik ağların doğruluğuna yaklaşabiliyor. Görüntü üretiminde, aktivasyonların saf bir şekilde p-bitlerle değiştirilmesi gürültülü görüntüler üretiyor, ancak gerçek stokastik elemanlarla yeniden eğitme ve son katmanı dikkatle ele alma, standart bir uzaklık metriğiyle ölçüldüğünde 32-bit temel modele neredeyse eşdeğer kalitede yüz görüntüleri üretiyor.

Enerji Maliyetleri ve Gerçek Donanım

Yazarlar simülasyonların ötesine geçip gerçek donanımda enerji incelemesi yapıyorlar. Olasılıksal devreler için tasarlanmış 65 nm bir çipten alınan veriler ve ek devre simülasyonlarını kullanarak, büyük modern yapay zeka iş yüklerinin hesaplamadan ziyade bellek enerjisi tarafından domine edildiğini gösteriyorlar. p-DNN’ler ana hesaplama aşamasını—tam çarpma ve toplama işlemlerinden 1 bitlik aktivasyonlarla basit toplamaya—dramatik biçimde sadeleştirdiği için, birkaç örnek almak üzere gereken ek hesaplama, ağırlıklar enerji açlığı olan harici bellekte saklandığında toplam enerjiyi neredeyse değiştirmiyor. Bu öngörüleri, bir görüntü üreten ağın FPGA uygulamasında doğruluyorlar: olasılıksal versiyon, standart bir tasarıma kıyasla çıkarım başına toplam enerjiyi yaklaşık 2,5 kat azaltırken benzer kalitede rakam görüntüleri üretiyor. Rastgele sayı üretimi ve karşılaştırmaların ek yükü, bellek ve temel aritmetiğe kıyasla önemsiz kalıyor.

Ayarlanabilir Örneklemenin Önemi

Olasılıksal ağların ayırt edici bir faydası, doğruluğun çalışma zamanında örnek sayısını değiştirerek ayarlanabilmesidir. Tek bir 1-bit p-DNN motoru, aldığı örnek sayısına bağlı olarak yeniden donanım tasarlamaya gerek kalmadan 1-, 2- veya 3-bitli kuantize edilmiş bir model gibi davranabilir. Bu esneklik, ağırlık hassasiyetinin zaten birkaç bite indirildiği ancak aktivasyon hassasiyetinin kaliteyi düşürmeden azaltılmasının daha zor olduğu büyük dil modelleri için özellikle çekicidir. Bu makaledeki çerçeve, herhangi bir böyle model için ekstra örnek almanın bit genişliğini artırmaya kıyasla enerji açısından değerli olup olmadığını tahmin etme yöntemini gösteriyor.

Verimli, Esnek Yapay Zeka İçin Yeni Bir Yol

Daha basit bir ifadeyle, makale “gürültülü” sinir birimlerinin kaçınılmak yerine kullanılabileceğini gösteriyor. Her ileri geçişi ucuz, yaklaşık bir tahmin olarak ele alıp bu tahminlerin küçük bir ortalamasını alarak, ağlar son derece basitleştirilmiş hesaplamalar ve mütevazı enerji fazlasıyla neredeyse tam hassasiyet performansına ulaşabiliyor. Bellek güç faturalarını domine ettiğinden, ek örneklemenin maliyeti, özellikle ağırlıklar bir kez okunup yeniden kullanıldığında küçük kalıyor. Bu, yalnızca daha enerji verimli değil, aynı zamanda gerektiğinde doğruluk ile pil ömrü ya da hız arasında denge kurmak için örneklemeyi dinamik olarak artırıp azaltabilen, anında uyarlanabilir AI donanımına yönelik umut verici bir yol öneriyor.

Atıf: Ghantasala, L.A., Li, MC., Jaiswal, R. et al. Improving deep neural network performance through sampling. npj Unconv. Comput. 3, 18 (2026). https://doi.org/10.1038/s44335-026-00063-7

Anahtar kelimeler: probabilistik sinir ağları, enerji verimli yapay zeka, örneklemeye dayalı çıkarım, düşük hassasiyetli hesaplama, derin öğrenme donanımı