Clear Sky Science · es

Mejorar el rendimiento de redes neuronales profundas mediante muestreo

IA más inteligente con neuronas que funcionan como caras o cruces

A medida que la inteligencia artificial se ha hecho más potente, también se ha vuelto voraz en consumo energético. Entrenar y ejecutar los modelos modernos de imágenes y lenguaje puede consumir tanta electricidad como pequeños municipios. Este artículo explora una idea contraintuitiva: en lugar de hacer las redes neuronales cada vez más precisas y complejas, podríamos simplificar y añadir ruido a sus componentes —más parecidos a lanzar monedas digitales— y luego usar muestreo inteligente para obtener resultados iguales o incluso mejores mientras ahorramos energía.

De circuitos precisos a cerebros probabilísticos

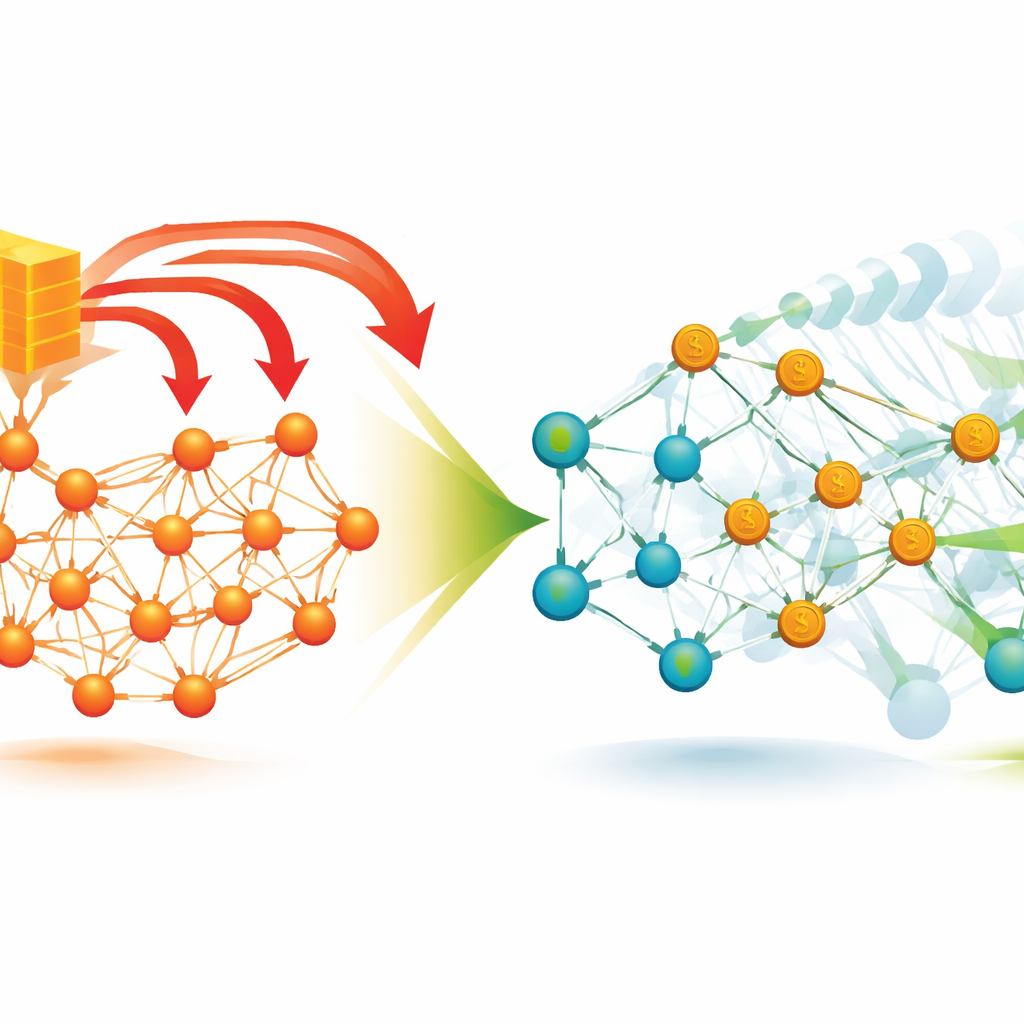

La mayoría de las redes neuronales profundas actuales usan unidades “deterministas”: si les introduces los mismos números siempre dan la misma respuesta. Los autores se centran en una alternativa llamada bits probabilísticos, o p-bits. Cada p-bit se comporta como una pequeña moneda sesgada que cambia entre 0 y 1 según probabilidades fijadas por sus entradas. Tomando varias muestras de la misma red de p-bits y promediando sus salidas, el sistema puede aproximar comportamientos de varios bits sin almacenar ni manipular tantos números precisos. Esta idea conecta la IA moderna con las antiguas máquinas de Ising y de Boltzmann, donde ya se conocía que tales unidades probabilísticas eran eficientes para problemas de optimización y muestreo.

Usar muchas conjeturas rápidas en lugar de una respuesta pesada

El estudio plantea una pregunta simple pero práctica: si queremos mayor precisión, ¿sale más barato aumentar la precisión digital de cada neurona, o mantener las neuronas extremadamente simples y en su lugar extraer múltiples muestras de ellas? Los autores construyen una fórmula energética general que descompone el coste de una operación elemental en una red neuronal en cuatro partes: leer pesos de la memoria, leer y escribir activaciones, combinar entradas (la sinapsis) y aplicar la no linealidad (la neurona). De forma importante, los pesos pueden leerse una vez y reutilizarse para generar varias muestras, por lo que el coste dominante —acceder a la memoria— puede repartirse entre muchas ejecuciones. Eso significa que diez muestras son mucho menos que diez veces el coste de una.

Probando redes probabilísticas en imágenes

Para comprobar si este compromiso funciona en la práctica, los investigadores prueban redes neuronales profundas probabilísticas (p-DNNs) tanto en clasificación de imágenes (CIFAR-10) como en generación de imágenes (rostros de CelebA y dígitos de MNIST). Sustituyen las señales de activación estándar de varios bits por p-bits de un solo bit, y entrenan las redes de forma “consciente del muestreo”, donde la función de pérdida se calcula a partir del promedio de varias pasadas hacia delante estocásticas. Para clasificación, encuentran que incluso con activaciones de 1 bit, una sola muestra puede igualar la precisión de un modelo de precisión completa, y dos muestras la superan. Con más muestras, las p-DNNs de 1 bit se aproximan a la precisión de redes deterministas de 3 bits. En generación de imágenes, la sustitución ingenua de activaciones por p-bits produce imágenes ruidosas, pero reentrenando con los elementos estocásticos reales y manejando cuidadosamente la capa final se obtienen rostros cuya calidad casi iguala la línea base de 32 bits, según una métrica de distancia estándar.

Costes energéticos y hardware real

Los autores van más allá de las simulaciones y examinan la energía en hardware real. Usando datos de un chip de 65 nm diseñado para circuitos probabilísticos y simulaciones adicionales de circuito, muestran que las grandes cargas de trabajo modernas de IA están dominadas por la energía de la memoria, no por la aritmética. Debido a que las p-DNNs simplifican drásticamente el paso principal de cómputo —de multiplicar y acumular a sumas simples con activaciones de 1 bit—, el cómputo extra necesario para tomar unas cuantas muestras apenas cambia la energía total cuando los pesos residen en memorias externas con alto consumo. Validan estas predicciones en una implementación FPGA de una red generadora de imágenes: la versión probabilística reduce la energía total por inferencia en aproximadamente 2,5 veces respecto a un diseño estándar, al tiempo que produce imágenes de dígitos comparables. La sobrecarga de generación de números aleatorios y comparaciones es pequeña en relación con la memoria y la aritmética básica.

Por qué importa el muestreo ajustable

Un beneficio distintivo de las redes probabilísticas es que la precisión puede ajustarse en tiempo de ejecución cambiando el número de muestras. Un único motor p-DNN de 1 bit puede comportarse como un modelo cuantizado de 1, 2 o 3 bits según cuántas muestras tome, sin rediseñar el hardware. Esta flexibilidad es especialmente atractiva para modelos de lenguaje grandes, donde la precisión de los pesos ya se está reduciendo a pocos bits, pero la precisión de las activaciones es más difícil de bajar sin perjudicar la calidad. El marco presentado en este artículo muestra cómo estimar, para cualquier modelo de este tipo, si tomar muestras extra compensa energéticamente frente a aumentar el ancho de bits.

Un nuevo camino hacia una IA eficiente y flexible

En términos sencillos, el artículo demuestra que las unidades neuronales “ruidosas” pueden aprovecharse en lugar de evitarse. Tratando cada pasada hacia delante como una conjetura barata y aproximada y luego promediando un pequeño número de esas conjeturas, las redes pueden alcanzar un rendimiento cercano a la precisión completa con cálculos drásticamente más simples y una sobrecarga energética modesta. Dado que la memoria domina la factura de energía, el coste del muestreo adicional es pequeño, especialmente cuando los pesos se leen una vez y se reutilizan. Esto sugiere una vía prometedora hacia hardware de IA que no solo sea más eficiente energéticamente, sino también adaptable sobre la marcha: aumentar o reducir el muestreo para intercambiar precisión por duración de batería o velocidad según convenga.

Cita: Ghantasala, L.A., Li, MC., Jaiswal, R. et al. Improving deep neural network performance through sampling. npj Unconv. Comput. 3, 18 (2026). https://doi.org/10.1038/s44335-026-00063-7

Palabras clave: redes neuronales probabilísticas, IA energéticamente eficiente, inferencia basada en muestreo, cálculo de baja precisión, hardware para aprendizaje profundo