Clear Sky Science · de

Verbesserung der Leistung tiefer neuronaler Netze durch Sampling

Klügere KI mit winzigen Münzwurf-Neuronen

Während die künstliche Intelligenz leistungsfähiger geworden ist, ist auch ihr Energiehunger stark gestiegen. Das Training und der Betrieb moderner Bild‑ und Sprachmodelle kann so viel Strom verbrauchen wie kleine Städte. Dieser Artikel untersucht eine kontraintuitive Idee: Anstatt neuronale Netze immer präziser und komplexer zu machen, könnte man ihre Bausteine vereinfachen und verrauschen—mehr wie das Werfen digitaler Münzen—und dann intelligentes Sampling nutzen, um gleichwertige oder bessere Ergebnisse bei geringerem Energieaufwand zu erzielen.

Von präzisen Schaltungen zu probabilistischen Gehirnen

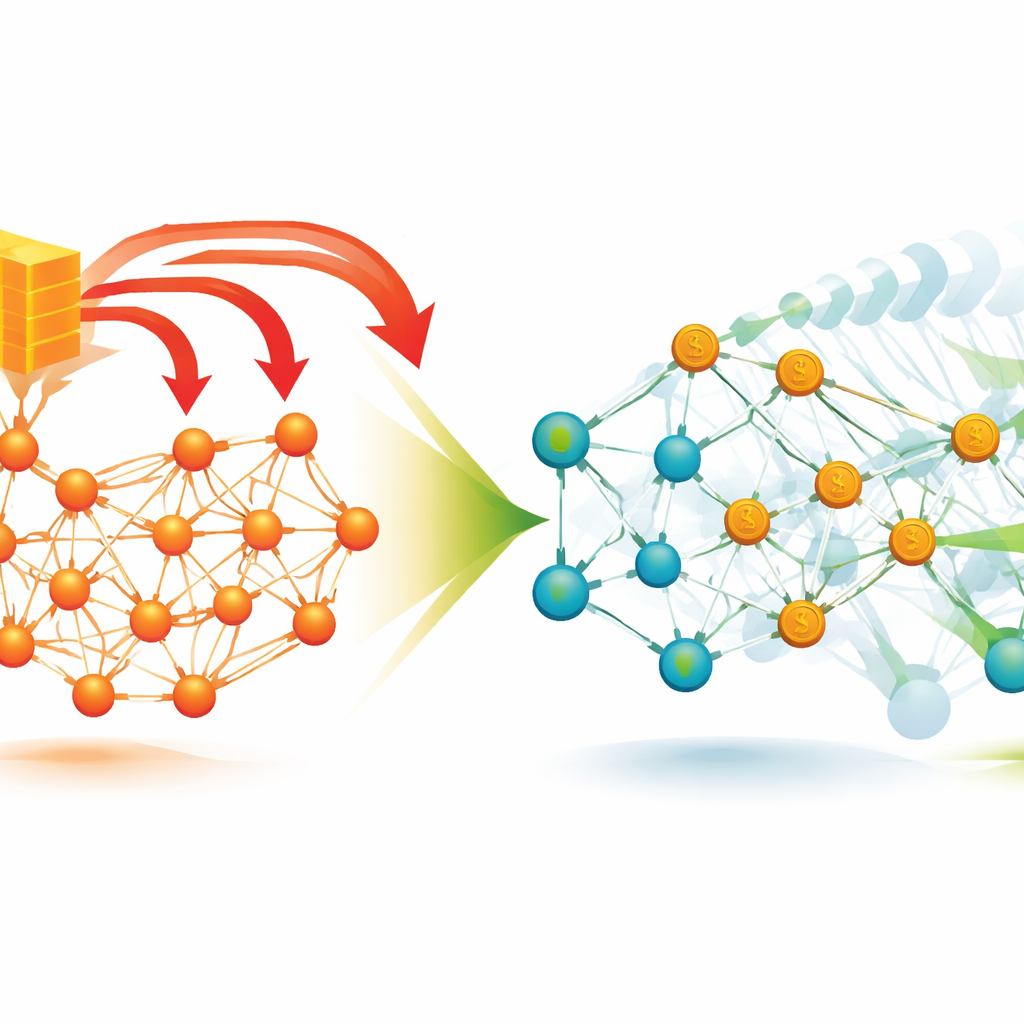

Die meisten heutigen tiefen neuronalen Netze verwenden „deterministische“ Einheiten: Bei gleichen Eingaben erhält man immer dieselbe Ausgabe. Die Autoren konzentrieren sich auf eine Alternative, sogenannte probabilistische Bits oder p-bits. Jedes p-bit verhält sich wie eine kleine, verzerrte Münze, die je nach ihren Eingaben mit einer bestimmten Wahrscheinlichkeit zwischen 0 und 1 wechselt. Indem man mehrere Stichproben aus demselben Netzwerk von p-bits zieht und ihre Ausgaben mittelt, kann das System ein reichhaltigeres, mehrbitiges Verhalten annähern, ohne so viele präzise Zahlen zu speichern oder zu bewegen. Diese Idee verbindet moderne KI mit älteren Ising‑ und Boltzmann‑Maschinen, in denen solche probabilistischen Einheiten bereits als effizient für Optimierungs‑ und Sampling‑Aufgaben bekannt waren.

Viele schnelle Vermutungen statt einer aufwendigen Antwort

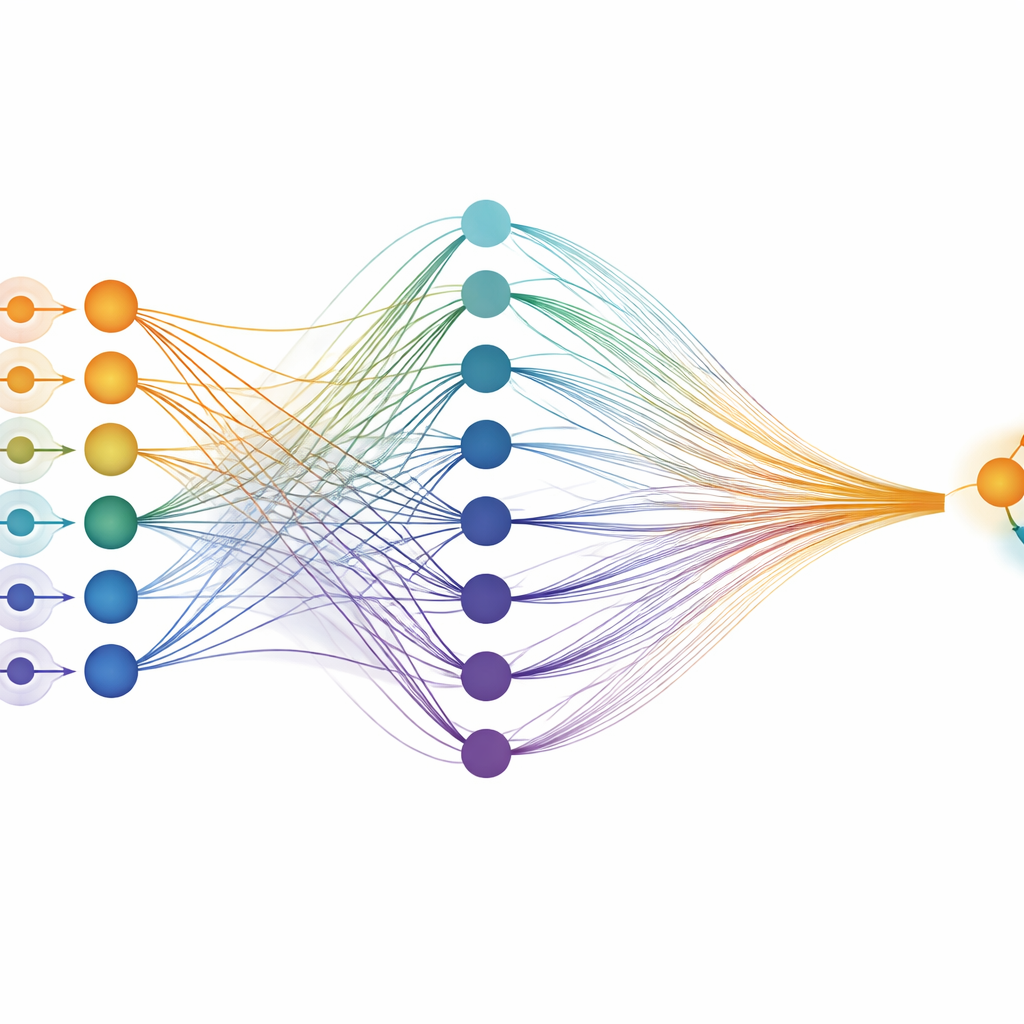

Die Studie stellt eine einfache, aber praktische Frage: Wenn wir bessere Genauigkeit wollen, ist es günstiger, die digitale Präzision jeder Neuroneneinheit zu erhöhen, oder die Neuronen extrem einfach zu halten und stattdessen mehrere Stichproben aus ihnen zu ziehen? Die Autoren formulieren eine allgemeine Energiebilanz, die die Kosten einer elementaren Operation in einem neuronalen Netz in vier Teile aufschlüsselt: das Lesen von Gewichten aus dem Speicher, das Lesen und Schreiben von Aktivierungen, das Zusammenführen von Eingaben (die Synapse) und das Anwenden der Nichtlinearität (das Neuron). Wichtig ist, dass Gewichte einmal gelesen und dann wiederverwendet werden können, um mehrere Samples zu erzeugen, sodass die dominierende Kostenstelle—Speicherzugriff—auf viele Läufe verteilt werden kann. Das bedeutet, dass zehn Stichproben bei Weitem nicht zehnmal so teuer sind wie eine.

Testen probabilistischer Netze an Bildern

Um zu prüfen, ob sich dieser Trade‑off in der Praxis auszahlt, testen die Forschenden probabilistische tiefe neuronale Netze (p‑DNNs) sowohl bei Bildklassifikation (CIFAR‑10) als auch bei Bilderzeugung (Gesichter aus CelebA und Ziffern aus MNIST). Sie ersetzen standardmäßige mehrbitige Aktivierungssignale durch einbitige p‑bits und trainieren die Netze „sample‑aware“, wobei die Verlustfunktion aus dem Durchschnitt mehrerer stochastischer Vorwärtsdurchläufe berechnet wird. Für die Klassifikation stellen sie fest, dass selbst mit 1‑Bit‑Aktivierungen bereits eine einzige Stichprobe die Genauigkeit eines Vollpräzisionsmodells erreichen kann und zwei Stichproben dieses übertreffen. Mit mehr Stichproben nähern sich 1‑Bit‑p‑DNNs der Genauigkeit von 3‑Bit‑deterministischen Netzen an. Bei der Bilderzeugung führt ein naiver Austausch der Aktivierungen durch p‑bits zu verrauschten Bildern, aber durch Retraining mit den echten stochastischen Elementen und einer sorgfältigen Behandlung der Ausgabeschicht entstehen Gesichtsabbildungen, deren Qualität gemessen mit einem Standardabstandsmaß fast an die 32‑Bit‑Referenz heranreicht.

Energiekosten und reale Hardware

Die Autoren gehen über Simulationen hinaus und untersuchen den Energieverbrauch auf echter Hardware. Anhand von Daten eines in 65 nm gefertigten Chips für probabilistische Schaltungen und zusätzlicher Schaltungssimulationen zeigen sie, dass große moderne KI‑Workloads vom Speicherenergieverbrauch dominiert werden, nicht von der Arithmetik. Weil p‑DNNs den Hauptrechenvorgang drastisch vereinfachen—von vollständigen Multiply‑and‑Accumulate‑Operationen zu einfachen Additionen mit 1‑Bit‑Aktivierungen—verändert der zusätzliche Rechenaufwand für einige Stichproben die Gesamtenergie kaum, wenn die Gewichte in stromhungrigem externen Speicher liegen. Diese Vorhersagen validieren sie auf einer FPGA‑Implementierung eines bilderzeugenden Netzes: Die probabilistische Variante reduziert die Energie pro Inferenz um etwa den Faktor 2,5 im Vergleich zu einem Standarddesign, während vergleichbare Ziffernbilder erzeugt werden. Der Overhead durch Zufallszahlengenerierung und Vergleiche ist im Vergleich zu Speicherzugriffen und Grundarithmetik gering.

Warum anpassbares Sampling wichtig ist

Ein markanter Vorteil probabilistischer Netze ist, dass die Genauigkeit zur Laufzeit durch Ändern der Anzahl der Stichproben feinjustiert werden kann. Eine einzelne 1‑Bit‑p‑DNN‑Einheit kann sich je nach Anzahl der gezogenen Stichproben wie ein 1‑, 2‑ oder 3‑Bit quantisiertes Modell verhalten, ohne die Hardware neu entwerfen zu müssen. Diese Flexibilität ist besonders attraktiv für große Sprachmodelle, bei denen die Gewichtspräzision bereits auf wenige Bits reduziert wird, während die Aktivierungspräzision schwerer zu verringern ist, ohne die Qualität zu beeinträchtigen. Das hier vorgestellte Rahmenwerk zeigt, wie man für ein beliebiges solches Modell abschätzen kann, ob zusätzliche Stichproben den Energieaufwand im Vergleich zur Erhöhung der Bitbreite rechtfertigen.

Ein neuer Weg zu effizienter, flexibler KI

Kurz gesagt demonstriert die Arbeit, dass „rauschende“ neuronale Einheiten nutzbar sein können statt vermieden zu werden. Indem jeder Vorwärtsdurchlauf als günstige, approximative Vermutung behandelt und dann eine kleine Anzahl dieser Vermutungen gemittelt wird, können Netze nahezu Vollpräzisionsleistung mit deutlich einfacheren Berechnungen und moderatem Energieaufwand erreichen. Da der Speicher die Hauptkostenstelle ist, sind die Kosten zusätzlichen Samplings gering, insbesondere wenn Gewichte einmal gelesen und wiederverwendet werden. Das deutet auf einen vielversprechenden Weg zu KI‑Hardware hin, die nicht nur energieeffizienter, sondern auch unterwegs anpassbar ist—man kann das Sampling je nach Bedarf hoch- oder runterfahren, um Genauigkeit gegen Batterielaufzeit oder Geschwindigkeit abzuwägen.

Zitation: Ghantasala, L.A., Li, MC., Jaiswal, R. et al. Improving deep neural network performance through sampling. npj Unconv. Comput. 3, 18 (2026). https://doi.org/10.1038/s44335-026-00063-7

Schlüsselwörter: probabilistische neuronale Netze, energieeffiziente KI, sampling-basierte Inferenz, niedrigpräzise Berechnung, Hardware für Deep Learning