Clear Sky Science · it

Migliorare le prestazioni delle reti neurali profonde tramite campionamento

Un’IA più intelligente con neuroni come lanci di moneta

Man mano che l’intelligenza artificiale è diventata più potente, è cresciuta anche la sua voracità energetica. Addestrare ed eseguire i modelli moderni per immagini e linguaggio può consumare tanta elettricità quanta ne serve a piccole città. Questo articolo esplora un’idea controintuitiva: invece di rendere le reti neurali sempre più precise e complesse, potremmo semplificare e rendere più rumorosi i loro mattoni di base — più simili a lanci di moneta digitali — e poi usare un campionamento intelligente per ottenere risultati pari o addirittura migliori risparmiando energia.

Dai circuiti precisi ai cervelli probabilistici

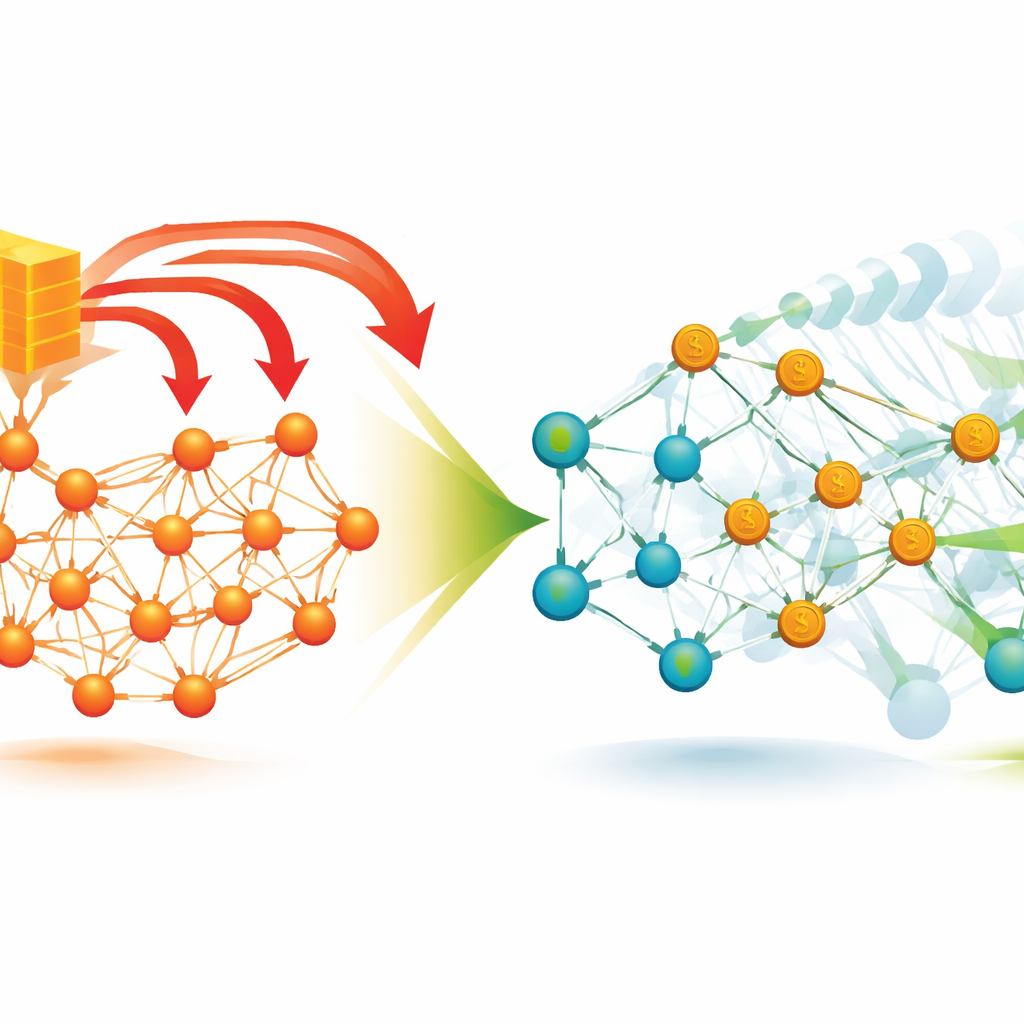

La maggior parte delle reti neurali profonde odierne usa unità “deterministiche”: fornendo gli stessi numeri si ottiene sempre la stessa risposta. Gli autori si concentrano su un’alternativa chiamata bit probabilistico, o p-bit. Ogni p-bit si comporta come una piccola moneta sbilanciata che passa tra 0 e 1 secondo probabilità determinate dai suoi input. Prendendo più campioni dalla stessa rete di p-bit e mediandone le uscite, il sistema può approssimare comportamenti più ricchi su più bit senza memorizzare o spostare tanti numeri precisi. Questa idea collega l’IA moderna a precedenti macchine «Ising» e di Boltzmann, dove unità probabilistiche di questo tipo erano già note per la loro efficienza in problemi di ottimizzazione e campionamento.

Molte ipotesi rapide invece di una risposta pesante

Lo studio pone una domanda semplice ma pratica: se vogliamo maggiore accuratezza, è meno costoso aumentare la precisione digitale di ogni neurone, o mantenere i neuroni estremamente semplici e invece ottenere più campioni da essi? Gli autori costruiscono una formula energetica generale che scompone il costo di un’operazione elementare in una rete neurale in quattro parti: leggere i pesi dalla memoria, leggere e scrivere le attivazioni, combinare gli input (la sinapsi) e applicare la non linearità (il neurone). Importante è che i pesi possono essere letti una volta e poi riutilizzati per generare più campioni, perciò il costo dominante — l’accesso alla memoria — può essere distribuito su molte esecuzioni. Ciò significa che dieci campioni costano molto meno di dieci volte un singolo campione.

Testare le reti probabilistiche sulle immagini

Per verificare se questo compromesso funziona nella pratica, i ricercatori testano reti neurali profonde probabilistiche (p-DNN) sia su classificazione di immagini (CIFAR-10) sia su generazione di immagini (volti da CelebA e cifre da MNIST). Sostituiscono i consueti segnali di attivazione multi-bit con p-bit a singolo bit e addestrano le reti in modo «consapevole del campionamento», dove la funzione di perdita è calcolata dalla media di più passaggi forward stocastici. Per la classificazione, riscontrano che anche con attivazioni a 1 bit un singolo campione può eguagliare l’accuratezza di un modello a precisione piena, e due campioni la superano. Con più campioni, le p-DNN a 1 bit si avvicinano all’accuratezza delle reti deterministiche a 3 bit. Per la generazione di immagini, la sostituzione ingenua delle attivazioni con p-bit produce immagini rumorose, ma riaddestrando tenendo conto degli elementi stocastici e gestendo con cura l’ultimo strato si ottengono volti la cui qualità si avvicina molto al riferimento a 32 bit, misurata con una metrica di distanza standard.

Costi energetici e hardware reale

Gli autori vanno oltre le simulazioni ed esaminano l’energia su hardware reale. Utilizzando dati da un chip a 65 nm progettato per circuiti probabilistici e ulteriori simulazioni di circuito, mostrano che i carichi di lavoro moderni dell’IA sono dominati dall’energia della memoria, non dall’aritmetica. Poiché le p-DNN semplificano drasticamente il passo di calcolo principale — dalla moltiplicazione-accumulazione completa a semplici addizioni con attivazioni a 1 bit — il calcolo aggiuntivo necessario per raccogliere alcuni campioni cambia di poco l’energia totale quando i pesi risiedono in memorie esterne energivore. Validano queste predizioni su un’implementazione FPGA di una rete generatrice di immagini: la versione probabilistica riduce l’energia per inferenza complessiva di circa 2,5 volte rispetto a un progetto standard, pur producendo immagini di cifre comparabili. L’overhead per la generazione di numeri casuali e le comparazioni è piccolo rispetto alla memoria e all’aritmetica di base.

Perché il campionamento regolabile conta

Un vantaggio distintivo delle reti probabilistiche è che l’accuratezza può essere regolata in esecuzione variando il numero di campioni. Un singolo motore p-DNN a 1 bit può comportarsi come un modello quantizzato a 1, 2 o 3 bit a seconda di quanti campioni esegue, senza ridisegnare l’hardware. Questa flessibilità è particolarmente interessante per i grandi modelli di linguaggio, dove la precisione dei pesi è già spinta verso pochi bit, mentre ridurre la precisione delle attivazioni è più difficile senza degradare la qualità. Il quadro introdotto in questo articolo mostra come stimare, per qualunque modello di questo tipo, se raccogliere campioni extra conviene in termini energetici rispetto ad aumentare il numero di bit.

Una nuova strada verso un’IA efficiente e flessibile

In termini semplici, l’articolo dimostra che le unità neurali “rumorose” possono essere sfruttate invece di essere evitate. Trattando ogni passaggio forward come una stima economica e approssimata e poi mediando un piccolo numero di queste stime, le reti possono raggiungere prestazioni vicine alla precisione piena con calcoli drasticamente più semplici e un modesto sovraccarico energetico. Poiché la memoria domina il conto energetico, il costo del campionamento extra è ridotto, specialmente quando i pesi vengono letti una volta e riutilizzati. Questo suggerisce una via promettente verso hardware per l’IA non solo più efficiente dal punto di vista energetico, ma anche adattabile al volo — aumentando o diminuendo il campionamento per scambiare accuratezza con autonomia della batteria o velocità secondo necessità.

Citazione: Ghantasala, L.A., Li, MC., Jaiswal, R. et al. Improving deep neural network performance through sampling. npj Unconv. Comput. 3, 18 (2026). https://doi.org/10.1038/s44335-026-00063-7

Parole chiave: reti neurali probabilistiche, IA a basso consumo energetico, inferenza basata su campionamento, calcolo a bassa precisione, hardware per deep learning