Clear Sky Science · pt

Melhorando o desempenho de redes neurais profundas por meio de amostragem

IA mais inteligente com neurônios que funcionam como moeda ao ar

À medida que a inteligência artificial se tornou mais poderosa, também ficou mais voraz por energia. Treinar e executar modelos modernos de imagem e linguagem pode consumir tanta eletricidade quanto pequenas cidades. Este artigo explora uma ideia contraintuitiva: em vez de tornar as redes neurais cada vez mais precisas e complexas, poderíamos simplificar e tornar mais ruidosos seus blocos básicos — mais parecidos com o ato de jogar moedas digitais — e então usar técnicas de amostragem inteligentes para obter resultados iguais ou até melhores, economizando energia.

De circuitos precisos a cérebros probabilísticos

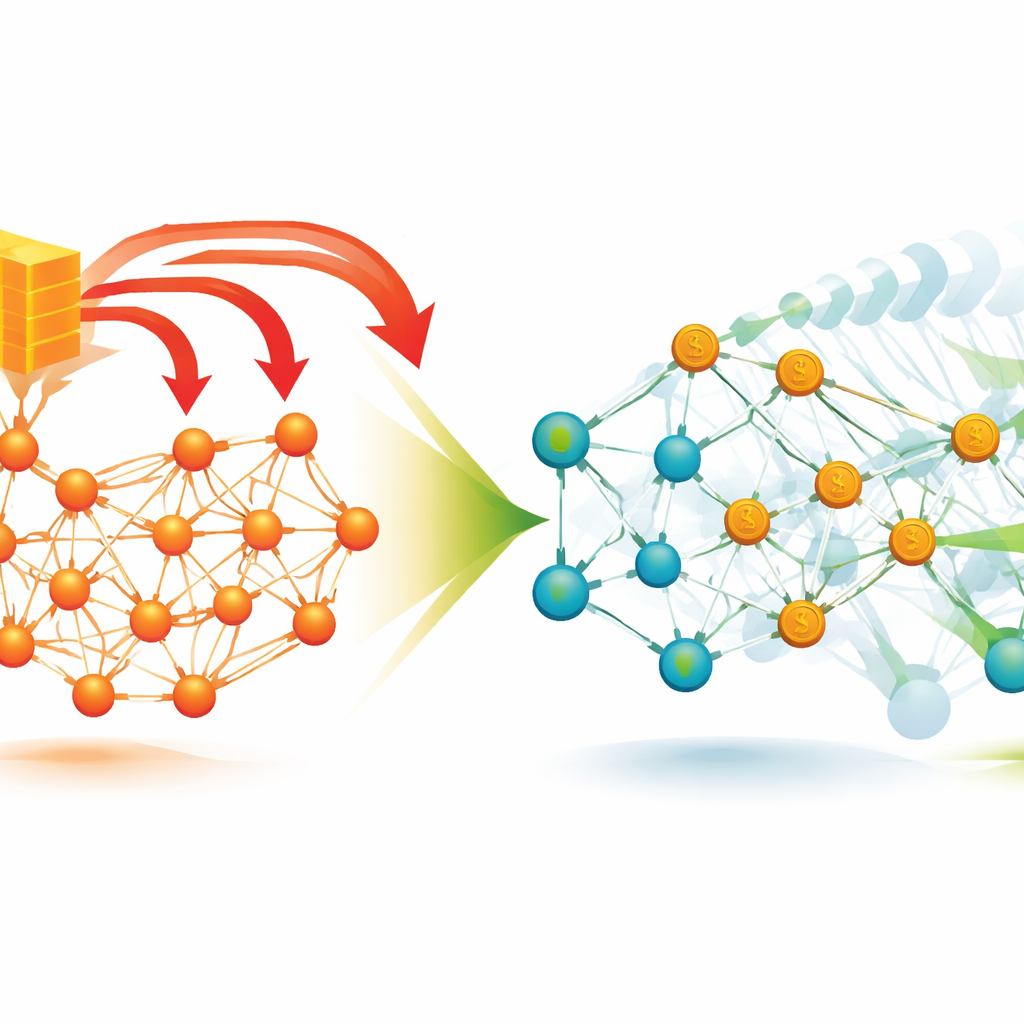

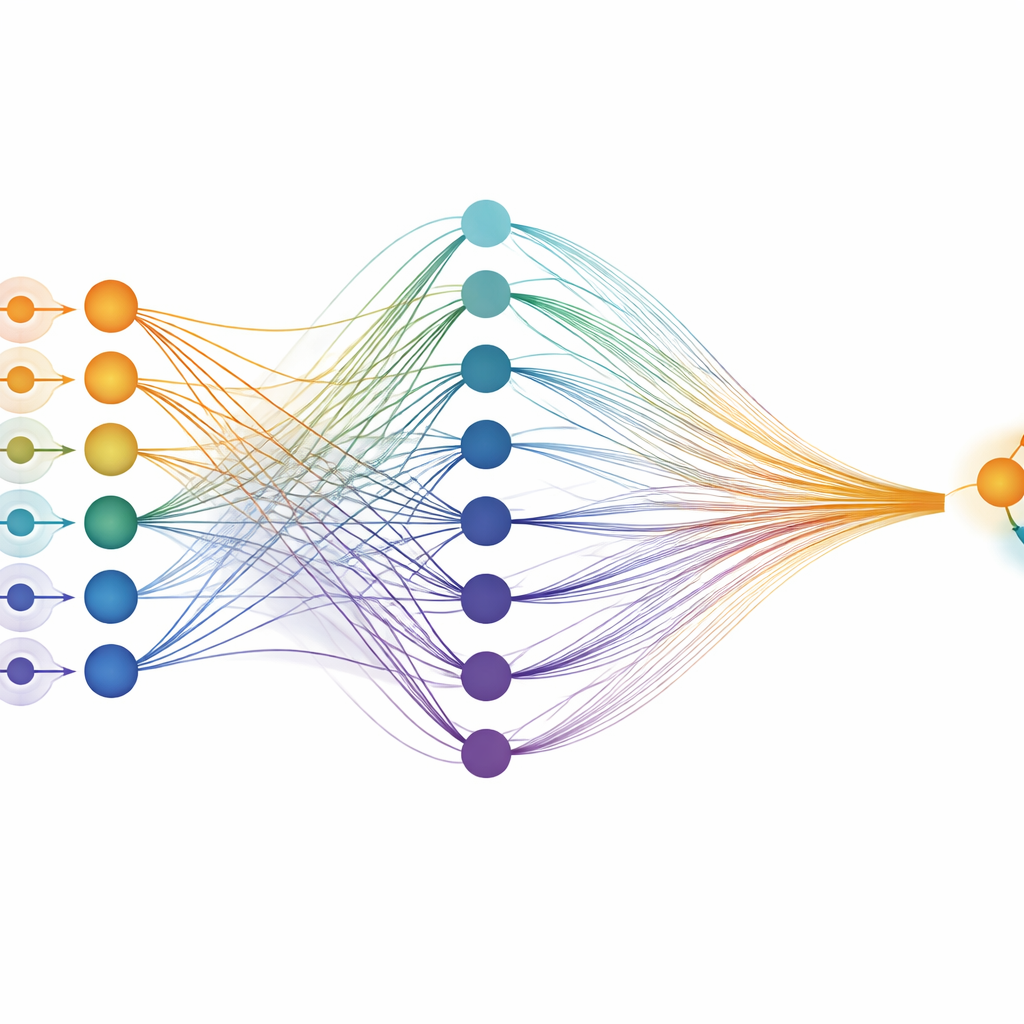

A maioria das redes neurais profundas atuais usa unidades “determinísticas”: insira os mesmos números e você sempre obtém a mesma resposta. Os autores concentram-se em uma alternativa chamada bits probabilísticos, ou p-bits. Cada p-bit comporta-se como uma pequena moeda enviesada que alterna entre 0 e 1 conforme probabilidades definidas por suas entradas. Ao coletar várias amostras da mesma rede de p-bits e calcular a média de suas saídas, o sistema pode aproximar um comportamento mais rico, com múltiplos bits, sem armazenar ou manipular tantos números precisos. Essa ideia conecta a IA moderna a máquinas de Ising e de Boltzmann anteriores, onde unidades probabilísticas já eram conhecidas por sua eficiência em problemas de otimização e amostragem.

Usando muitos palpites rápidos em vez de uma resposta pesada

O estudo plantea uma pergunta simples, porém prática: se quisermos melhor acurácia, é mais barato aumentar a precisão digital de cada neurônio ou manter os neurônios extremamente simples e, em vez disso, extrair várias amostras deles? Os autores elaboram uma fórmula geral de energia que decompõe o custo de uma operação elementar em uma rede neural em quatro partes: leitura de pesos da memória, leitura e escrita de ativações, combinação de entradas (a sinapse) e aplicação da não linearidade (o neurônio). Importante: os pesos podem ser lidos uma vez e então reutilizados para gerar várias amostras, de modo que o custo dominante — acessar a memória — pode ser diluído por várias execuções. Isso significa que dez amostras saem bem menos que dez vezes o custo de uma única.

Testando redes probabilísticas em imagens

Para verificar se essa troca compensa na prática, os pesquisadores testam redes neurais profundas probabilísticas (p-DNNs) tanto em classificação de imagens (CIFAR-10) quanto em geração de imagens (rostos do CelebA e dígitos do MNIST). Eles substituem sinais de ativação multi-bit padrão por p-bits de um bit e treinam as redes de forma “consciente à amostra”, em que a função de perda é computada a partir da média de várias passagens estocásticas para frente. Na classificação, constatam que mesmo com ativações de 1 bit, apenas uma amostra pode igualar a acurácia de um modelo de precisão total, e duas amostras superam esse modelo. Com mais amostras, p-DNNs de 1 bit se aproximam da acurácia de redes determinísticas de 3 bits. Na geração de imagens, a substituição ingênua das ativações por p-bits produz imagens ruidosas, mas o re-treinamento com os elementos estocásticos reais e o tratamento cuidadoso da camada final geram imagens de rostos cuja qualidade se aproxima da linha de base de 32 bits, conforme medido por uma métrica de distância padrão.

Custos de energia e hardware real

Os autores vão além de simulações e examinam o consumo energético em hardware real. Usando dados de um chip de 65 nm projetado para circuitos probabilísticos e simulações adicionais de circuito, mostram que grandes cargas de trabalho modernas de IA são dominadas pela energia de memória, não pela aritmética. Como p-DNNs simplificam drasticamente a etapa principal de computação — de multiplicar-e-acumular completo para somas simples com ativações de 1 bit — o custo extra de computação para coletar algumas amostras mal altera a energia total quando os pesos residem em memória externa energeticamente cara. Eles validam essas previsões em uma implementação FPGA de uma rede geradora de imagens: a versão probabilística reduz a energia total por inferência em cerca de 2,5 vezes em comparação com um design padrão, produzindo imagens de dígitos comparáveis. A sobrecarga de geração de números aleatórios e comparações é ínfima em relação à memória e à aritmética básica.

Por que a amostragem ajustável importa

Um benefício distintivo das redes probabilísticas é que a acurácia pode ser ajustada em tempo de execução alterando o número de amostras. Um único motor p-DNN de 1 bit pode comportar-se como um modelo quantizado de 1, 2 ou 3 bits dependendo de quantas amostras realiza, sem redesenhar o hardware. Essa flexibilidade é especialmente atraente para grandes modelos de linguagem, onde a precisão dos pesos já vem sendo reduzida a poucos bits, mas reduzir a precisão das ativações é mais difícil sem prejudicar a qualidade. O arcabouço apresentado neste artigo mostra como estimar, para qualquer modelo desse tipo, se coletar amostras extras vale a pena em termos de energia em comparação com aumentar a largura de bits.

Um novo caminho para IA eficiente e flexível

Em termos simples, o artigo demonstra que unidades neurais “ruidosas” podem ser aproveitadas em vez de evitadas. Tratando cada passagem para frente como um palpite barato e aproximado e depois fazendo a média de um pequeno número desses palpites, redes podem atingir desempenho próximo ao de precisão total com cálculos drasticamente mais simples e sobrecarga de energia modesta. Como a memória domina a conta de energia, o custo de amostragem extra é pequeno, especialmente quando os pesos são lidos uma vez e reutilizados. Isso sugere uma rota promissora para hardware de IA que não só é mais eficiente em termos de energia, como também adaptável em tempo real — ajustando a amostragem para trocar precisão por duração de bateria ou velocidade conforme necessário.

Citação: Ghantasala, L.A., Li, MC., Jaiswal, R. et al. Improving deep neural network performance through sampling. npj Unconv. Comput. 3, 18 (2026). https://doi.org/10.1038/s44335-026-00063-7

Palavras-chave: redes neurais probabilísticas, IA energeticamente eficiente, inferência baseada em amostragem, computação de baixa precisão, hardware para aprendizado profundo