Clear Sky Science · ru

Повышение производительности глубоких нейронных сетей с помощью семплирования

Более умный ИИ с крошечными монетоподобными нейронами

По мере того как искусственный интеллект становился мощнее, он также стал очень требователен к энергии. Обучение и запуск современных моделей для изображений и языка могут потреблять электричества не меньше, чем небольшие города. В этой статье рассматривается контринтуитивная идея: вместо того чтобы делать нейронные сети всё более точными и сложными, можно упростить их элементарные блоки и сделать их шумными — наподобие цифровых подбрасываний монеты — а затем с помощью хитрого семплирования получать равные или даже лучшие результаты при меньших энергозатратах.

От точных схем к вероятностным «мозгам»

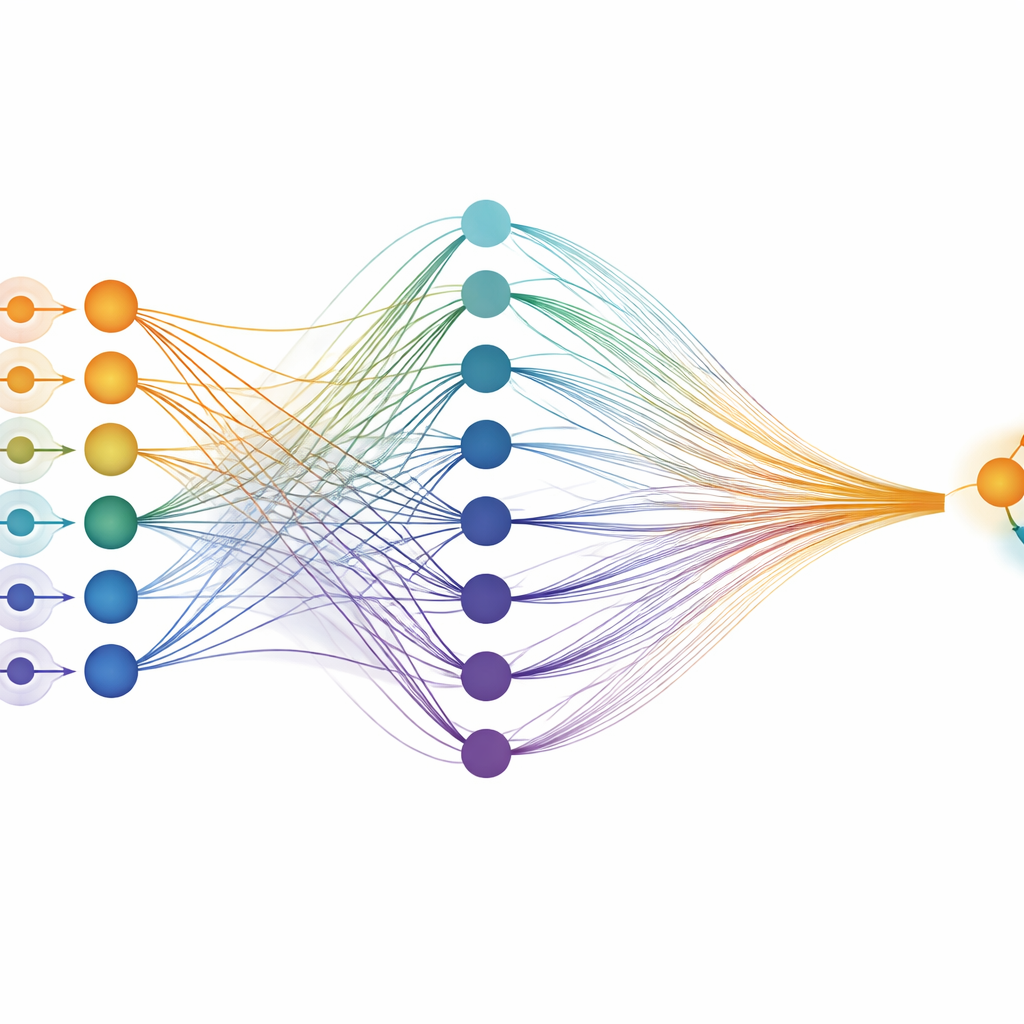

Большинство современных глубоких нейронных сетей используют «детерминированные» элементы: при одинаковых входных данных вы всегда получаете один и тот же ответ. Авторы сосредотачиваются на альтернативе, называемой вероятностными битами, или p-битами. Каждый p-бит ведёт себя как маленькая, с уклоном монета, которая переключается между 0 и 1 с вероятностями, задаваемыми её входами. Беря несколько выборок из одной и той же сети p-битов и усредняя их выходы, система может аппроксимировать более богатое, многобитное поведение без хранения или перемешивания столь большого количества точных чисел. Эта идея связывает современный ИИ с ранними моделями типа Изинга и машинами Больцмана, где такие вероятностные элементы уже известны своей эффективностью для задач оптимизации и семплирования.

Множество быстрых предположений вместо одного тяжёлого ответа

Исследование ставит простой, но практический вопрос: если мы хотим повысить точность, что экономичнее — добавить цифровой разрядности каждому нейрону или сохранить нейроны чрезвычайно простыми и вместо этого получать от них несколько выборок? Авторы выводят общую энергетическую формулу, которая разбивает стоимость одной элементарной операции в нейронной сети на четыре части: чтение весов из памяти, чтение и запись активаций, объединение входов (синапс) и применение нелинейности (нейрон). Важно, что веса можно прочитать один раз и затем повторно использовать для генерации нескольких семплов, поэтому доминирующая стоимость — доступ к памяти — может распределяться на многие прогоны. Это означает, что десять выборок обходятся далеко не в десять раз дороже одной.

Тестирование вероятностных сетей на изображениях

Чтобы проверить, окупается ли такая замена на практике, исследователи испытали вероятностные глубокие нейронные сети (p-DNN) на задачах классификации изображений (CIFAR-10) и генерации изображений (лица из CelebA и цифры из MNIST). Они заменили стандартные многобитные сигналы активации однобитовыми p-битами и обучали сети с учётом семплирования, когда функция потерь вычисляется от среднего нескольких стохастических прямых проходов. Для классификации они обнаружили, что даже при 1-битных активациях одна выборка может соответствовать точности модели с полной точностью, а две выборки дают лучший результат. С увеличением числа выборок 1-битные p-DNN приближаются по точности к 3-битным детерминированным сетям. Для генерации изображений простая замена активаций на p-биты даёт шумные картинки, но дообучение с учётом истинной стохастики и осторожная обработка финального слоя позволяют получить изображения лиц, качество которых по стандартной метрике почти сравнимо с 32-битным эталоном.

Энергетические затраты и реальное железо

Авторы выходят за рамки симуляций и изучают энергопотребление на реальном оборудовании. Используя данные с 65 нм чипа, созданного для вероятностных схем, и дополнительные моделирования, они показывают, что в больших современных нагрузках ИИ доминирует энергия памяти, а не арифметики. Поскольку p-DNN значительно упрощают основную вычислительную операцию — от полного умножения и аккумуляции до простых сложений с 1-битными активациями — дополнительная вычислительная стоимость за несколько выборок почти не меняет общей энергии, когда веса хранятся во внешней энергозатратной памяти. Они подтверждают эти предсказания на реализации сети, генерирующей изображения, на FPGA: вероятностная версия уменьшает общую энергию на вывод примерно в 2,5 раза по сравнению со стандартным дизайном, при этом давая сопоставимые изображения цифр. Накладные расходы на генерацию случайных чисел и сравнения ничтожны по сравнению с энергозатратами памяти и базовой арифметикой.

Почему важна регулируемая выборка

Отличительное преимущество вероятностных сетей в том, что точность можно регулировать во время работы, изменяя число выборок. Один движок 1-битного p-DNN может вести себя как квантизированная модель с 1, 2 или 3 битами в зависимости от того, сколько семплов он делает, без переделки аппаратуры. Эта гибкость особенно привлекательна для больших языковых моделей, где точность весов уже опускают до нескольких бит, а точность активаций снизить сложнее без ухудшения качества. Предложенная в статье методика показывает, как оценить для любой такой модели, стоит ли получать дополнительные выборки с точки зрения энергии по сравнению с увеличением битности.

Новый путь к эффективному и гибкому ИИ

Проще говоря, в статье показано, что «шумные» нейронные блоки можно использовать во благо, а не избегать. Рассматривая каждый прямой проход как дешёвое приближённое предположение и затем усредняя небольшое число таких предположений, сети могут достигать производительности, близкой к полной точности, при значительно более простых вычислениях и умеренных затратах энергии. Поскольку память определяет основную часть энергопотребления, стоимость дополнительного семплирования невелика, особенно если веса читаются один раз и переиспользуются. Это открывает перспективный путь к аппаратуре для ИИ, которая не только более энергоэффективна, но и адаптивна — позволяя в реальном времени менять объём семплирования, чтобы обменять точность на время автономной работы или скорость по необходимости.

Цитирование: Ghantasala, L.A., Li, MC., Jaiswal, R. et al. Improving deep neural network performance through sampling. npj Unconv. Comput. 3, 18 (2026). https://doi.org/10.1038/s44335-026-00063-7

Ключевые слова: вероятностные нейронные сети, энергоэффективный ИИ, инференция на основе семплирования, вычисления с низкой точностью, аппаратное обеспечение для глубокого обучения