Clear Sky Science · sv

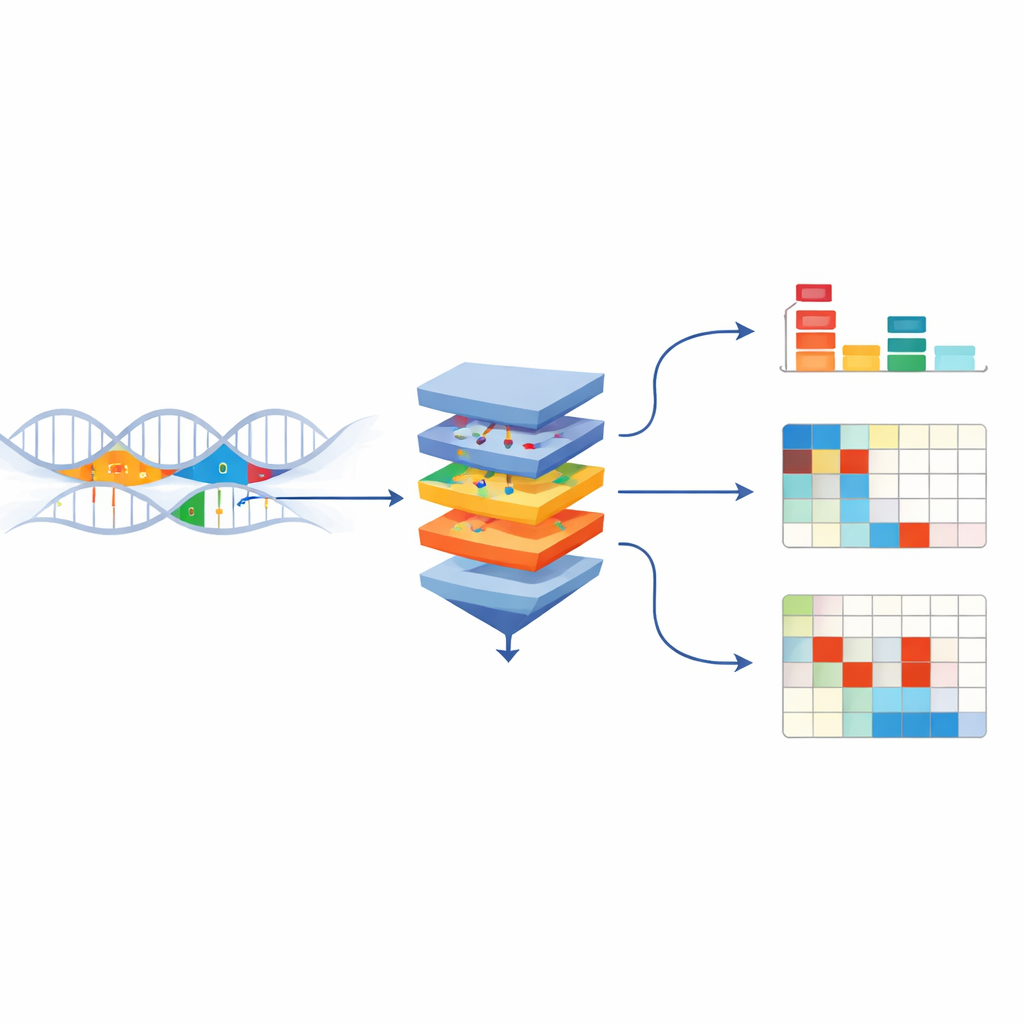

Förtränad genomisk språkmodell med varianter för bättre modellering av funktionell genetik

Lära datorer att läsa DNA:s språk

Varje persons DNA innehåller miljontals små skillnader, eller varianter, som bidrar till allt från längd till sjukdomsrisk. Forskare vet att många av dessa varianter påverkar hur starkt gener slås på eller av, men att koppla DNA-bokstäverna till genaktivitet har varit svårt. Denna studie presenterar nya artificiella intelligensmodeller som behandlar DNA som ett språk och använder varianter observerade hos hundratusentals människor för att bättre förutsäga hur gener beter sig i specifika celler och individer.

Varför DNA kan behandlas som ett mänskligt språk

Precis som ord får olika betydelser beroende på den omgivande meningen kan DNA-sekvenser spela olika roller beroende på deras genomiska ”kontext”. Reglerande regioner kan ligga långt från de gener de kontrollerar, och samma DNA-bit kan bidra till flera biologiska funktioner. Författarna bygger vidare på idén att dessa långväga mönster liknar polysemi och kontextberoende som ses i naturligt språk. Genom att använda neurala nätverksarkitekturer som ursprungligen utvecklades för text avser de att lära sig hur DNA:s ”grammatik” och mänsklig genetisk variation tillsammans formar genfunktion och uttryck.

Bygga en genomisk språkmodell från verklig mänsklig variation

Forskarna skapade UKBioBERT, en DNA-språkmodell tränad på både den mänskliga referensgenomen och över 13 miljoner varianter från ungefär 300 000 deltagare i UK Biobank. Under träningen visas modellen modifierade DNA-sekvenser där vissa nukleotider är dolda och måste gissas utifrån kontext, likt att fylla i saknade ord i en mening. Denna självövervakade process tvingar modellen att internalisera vilka sekvensmönster som tenderar att förekomma tillsammans och hur varianter ändrar dessa mönster. Teamet testar sedan modellens interna representationer genom att undersöka om sekvenser från gener med liknande kända funktioner hamnar nära varandra i detta lärda rum. Enligt flera klusteringsmått separerar UKBioBERT genfunktioner tydligare än tidigare genomiska modeller, utan att någonsin bli instruerad om dessa funktioner under träningen.

Från sekvensmönster till genaktivitet i celler och människor

Att lära sig DNA:s ”språk” är bara användbart om det hjälper till att förklara verklig biologi, särskilt genuttryck—nivån vid vilken gener är aktiva i olika celltyper och individer. Författarna kopplar UKBioBERT:s sekvensinbäddningar till befintliga djupinlärningsramverk som förutsäger genaktivitet från DNA. På cellinjenivå förbättrar de en arkitektur kallad EPInformer, som redan kombinerar promotor- och enhancer-sekvenser med epigenetiska signaler. Att lägga till UKBioBERT:s DNA-inbäddningar och separata textbaserade beskrivningar av genfunktion leder till mer precisa förutsägelser av genuttryck i flera humana cellinjer, med högre korrelationer mellan predicerade och uppmätta värden och mer stabil prestanda över korsvalideringsuppdelningar.

Personliga förutsägelser och vad som gör en gen förutsägbar

Teamet vänder sig sedan till en svårare uppgift: att förutsäga genuttryck för enskilda personer enbart baserat på deras helgenomsekvenser. De använder först UKBioBERT-inbäddningar med en traditionell statistisk metod för att förutsäga uttryck för 41 representativa gener i GTEx-kohorten. Prestandan konkurrerar med eller hamnar något efter starka baslinjer som använder handkonstruerade genetiska funktioner, och överträffar vida en oseparerad sekvensmodell. Intressant nog varierar gener kraftigt i hur förutsägbart deras uttryck är. Denna variation förklaras inte väl av standardmått som ärftlighet. Istället tenderar gener vars uttrycksnivåer naturligt faller i tydligare kluster mellan individer—mönster som UKBioBERT:s inbäddningar kan fånga—att vara mer förutsägbara. Gener som är involverade i många olika biologiska funktioner är svårare att förutsäga från sekvensen ensam.

Sammansmälta modeller för starkare individnivåförutsägelser

För att driva personliga förutsägelser längre förenar författarna UKBioBERT med kraftfulla sekvens-till-funktion-modeller Enformer och Borzoi och skapar UKBioFormer och UKBioZoi. Dessa hybrider kombinerar långväga sekvensmodellering med variantmedvetna inbäddningar och finjusteras effektivt med parameterbesparande tekniker. Över samma geneset presterar UKBioFormer ofta bättre än både den tidigare bästa djupmodellen (Performer) och standardstatistiska metoder för gener vars uttryck är rimligt förutsägbart. Den visar också förbättrad generalisering när modeller som tränats på personer med europeiskt ursprung tillämpas på afroamerikanska individer, vilket tyder på att lärande från rå sekvens plus populationsvarianter fångar viss delad reglerande logik över grupper.

Se hur enskilda varianter ändrar genaktivitet

Eftersom UKBioFormer är ett neuralt nätverk kan det undersökas för att avslöja hur enskilda varianter påverkar dess prediktioner. Författarna använder gradientbaserade metoder och in-silico-mutagenesexperiment för att uppskatta hur förändringar av specifika baser ändrar predicerat uttryck. För flera gener, inklusive en som kallas JUP, härleder modellen korrekt riktning och ungefärlig storlek på effekterna för en majoritet av kända reglerande varianter (eQTLs), inklusive några sällsynta. Den framhäver också lokala sekvensmotiv runt dessa varianter som matchar kända bindningsmönster hos reglerande proteiner. Detta visar att modellen inte enbart passar övergripande uttrycksnivåer, utan lär sig mekanistiska länkar mellan sekvensmotiv, varianter och genreglering.

Vad detta arbete innebär för genomik och medicin

Denna studie visar att träning av genomiska språkmodeller direkt på stora samlingar av mänskliga varianter ger rikare DNA-representationer som förbättrar prediktion av genuttryck och tolkning av varianter. Även om inte alla gener är förutsägbara från sekvensen ensam, presterar det kombinerade UKBioBERT–UKBioFormer-ramverket särskilt väl för gener vars uttrycksmönster är strukturerade och variantdrivna. Det ger också ett praktiskt sätt att utforska vilka varianter som sannolikt påverkar genaktivitet innan kostsamma experiment genomförs. Allt eftersom dataset blir mer diversifierade och metoder för multigen-träning förbättras kan sådana modeller bli viktiga verktyg för att koppla personliga genom till molekylära egenskaper och i slutändan vägleda forskning om genetiskt påverkade sjukdomar.

Citering: Liu, T., Zhang, X., Lin, J. et al. Pre-training genomic language model with variants for better modeling functional genomics. npj Artif. Intell. 2, 46 (2026). https://doi.org/10.1038/s44387-026-00103-4

Nyckelord: genomiska språkmodeller, prediktion av genuttryck, genetiska varianter, funktionell genomik, UK Biobank