Clear Sky Science · es

Preentrenamiento de un modelo de lenguaje genómico con variantes para un mejor modelado de la genómica funcional

Enseñar a los ordenadores a leer el lenguaje del ADN

El ADN de cada persona contiene millones de pequeñas diferencias, o variantes, que contribuyen a definir desde la altura hasta el riesgo de enfermedad. Los científicos saben que muchas de estas variantes influyen en la intensidad con la que los genes se activan o reprimen, pero conectar las letras del ADN con la actividad génica ha sido difícil. Este estudio presenta nuevos modelos de inteligencia artificial que tratan el ADN como un lenguaje, aprovechando los patrones de variantes observados en cientos de miles de personas para predecir mejor cómo se comportan los genes en células e individuos concretos.

Por qué el ADN puede tratarse como un lenguaje humano

Del mismo modo que las palabras adquieren distintos significados según la frase que las rodea, los fragmentos de ADN pueden desempeñar distintos papeles según su “contexto” genómico. Las regiones reguladoras pueden situarse lejos de los genes que controlan, y un mismo trozo de ADN puede participar en varias funciones biológicas. Los autores se basan en la idea de que estos patrones de largo alcance recuerdan la polisemia y la dependencia del contexto propias del lenguaje natural. Utilizando arquitecturas neuronales desarrolladas originalmente para texto, buscan aprender cómo la “gramática” del ADN y la variación genética humana conforman conjuntamente la función y la expresión génica.

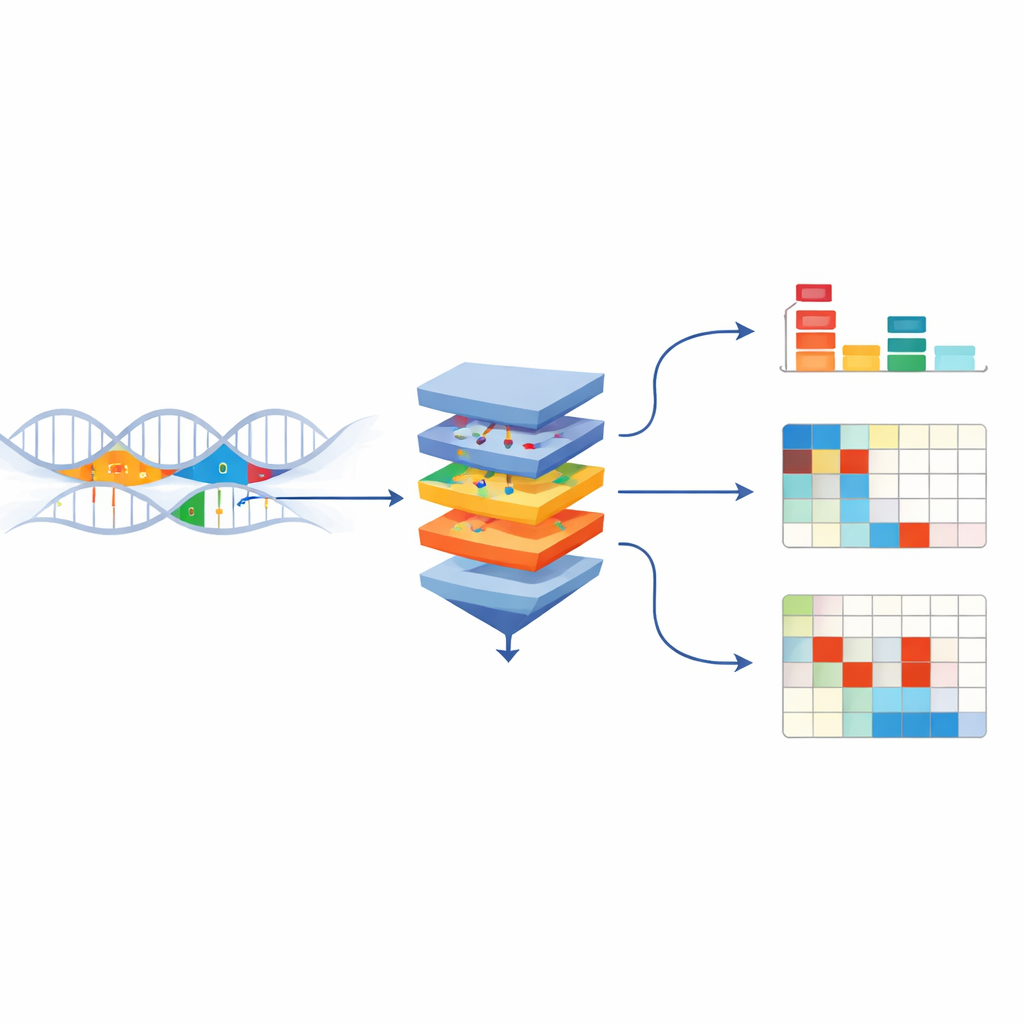

Construir un modelo de lenguaje genómico a partir de la variación humana real

Los investigadores crearon UKBioBERT, un modelo de lenguaje del ADN entrenado tanto con el genoma de referencia humano como con más de 13 millones de variantes procedentes de aproximadamente 300 000 participantes del UK Biobank. Durante el entrenamiento, al modelo se le muestran secuencias de ADN modificadas en las que algunas bases están ocultas y deben adivinarse a partir del contexto, similar a rellenar palabras ausentes en una frase. Este proceso de autoaprendizaje obliga al modelo a internalizar qué patrones de secuencia tienden a aparecer juntos y cómo las variantes alteran esos patrones. El equipo evalúa luego las representaciones internas del modelo comprobando si las secuencias de genes con funciones conocidas y similares quedan agrupadas en este espacio aprendido. Según varias medidas de clustering, UKBioBERT separa las funciones génicas con más claridad que modelos genómicos previos, sin que se le hayan enseñado esas funciones durante el entrenamiento.

De los patrones de secuencia a la actividad génica en células y personas

Aprender el “lenguaje” del ADN solo es útil si ayuda a explicar la biología real, en particular la expresión génica—el nivel al que los genes se encienden en distintos tipos celulares y en diferentes individuos. Los autores integran las incrustaciones (embeddings) de secuencia de UKBioBERT en marcos de aprendizaje profundo existentes que predicen la actividad génica a partir del ADN. A nivel de líneas celulares, mejoran una arquitectura llamada EPInformer, que ya combina secuencias de promotores y potenciadores con señales epigenéticas. Añadir las incrustaciones de ADN de UKBioBERT y descripciones textuales separadas de la función génica conduce a predicciones más precisas de la expresión génica en varias líneas celulares humanas, con correlaciones más altas entre valores predichos y medidos y un rendimiento más estable en los distintos pliegues de validación cruzada.

Predicciones personalizadas y qué hace que un gen sea predecible

El equipo aborda a continuación una tarea más difícil: predecir la expresión génica de individuos concretos solo a partir de sus secuencias genómicas completas. Primero emplean las incrustaciones de UKBioBERT con un método estadístico tradicional para predecir la expresión de 41 genes representativos en la cohorte GTEx. El rendimiento rivaliza o queda ligeramente por detrás de fuertes referencias que usan características genéticas diseñadas manualmente, y supera con creces a un modelo de secuencia no afinado. De forma intrigante, los genes difieren mucho en la previsibilidad de su expresión. Esta variación no se explica bien con medidas estándar como la heredabilidad. En cambio, los genes cuyas expresiones tienden a agruparse en clústeres más claros entre individuos—patrones que las incrustaciones de UKBioBERT pueden captar—suelen ser más predecibles. Los genes implicados en muchas funciones biológicas distintas son más difíciles de predecir solo a partir de la secuencia.

Fusionar modelos para predicciones individuales más robustas

Para llevar más lejos la predicción personalizada, los autores fusionan UKBioBERT con potentes modelos secuencia-a-función como Enformer y Borzoi, creando UKBioFormer y UKBioZoi. Estos híbridos combinan el modelado de secuencias a largo alcance con incrustaciones sensibles a variantes y se afinan de forma eficiente usando técnicas de ahorro de parámetros. En el mismo conjunto de genes, UKBioFormer suele superar tanto al mejor modelo profundo previo (Performer) como a los enfoques estadísticos estándar para genes cuya expresión es razonablemente predecible. También muestra mejor generalización cuando modelos entrenados con personas de ascendencia europea se aplican a individuos afroamericanos, lo que sugiere que aprender a partir de la secuencia cruda más variantes poblacionales captura cierta lógica reguladora compartida entre grupos.

Ver cómo variantes individuales cambian la actividad génica

Como UKBioFormer es una red neuronal, puede sondearse para revelar cómo variantes individuales influyen en sus predicciones. Los autores emplean métodos basados en gradientes y experimentos de mutación in silico para estimar cómo cambiar bases específicas altera la expresión predicha. Para varios genes, incluido uno llamado JUP, el modelo infiere correctamente la dirección y la magnitud aproximada de los efectos para la mayoría de variantes reguladoras conocidas (eQTL), incluidas algunas raras. También destaca motivos locales de secuencia alrededor de estas variantes que coinciden con patrones de unión conocidos de proteínas reguladoras. Esto muestra que el modelo no se limita a ajustar niveles globales de expresión, sino que aprende vínculos mecanísticos entre motivos de secuencia, variantes y regulación génica.

Qué supone este trabajo para la genómica y la medicina

Este estudio demuestra que entrenar modelos de lenguaje genómico directamente con grandes colecciones de variantes humanas genera representaciones del ADN más ricas que mejoran la predicción de la expresión génica y la interpretación de variantes. Aunque no todos los genes son predecibles solo por la secuencia, el marco combinado UKBioBERT–UKBioFormer funciona especialmente bien para genes cuyas pautas de expresión están estructuradas y son impulsadas por variantes. También ofrece una forma práctica de explorar qué variantes tienen más probabilidades de alterar la actividad génica antes de realizar costosos experimentos. A medida que los conjuntos de datos se vuelvan más diversos y mejoren los métodos para entrenar en varios genes, estos modelos podrían convertirse en herramientas importantes para vincular genomas personales con rasgos moleculares y, en última instancia, para orientar la investigación sobre enfermedades con base genética.

Cita: Liu, T., Zhang, X., Lin, J. et al. Pre-training genomic language model with variants for better modeling functional genomics. npj Artif. Intell. 2, 46 (2026). https://doi.org/10.1038/s44387-026-00103-4

Palabras clave: modelos de lenguaje genómico, predicción de la expresión génica, variantes genéticas, genómica funcional, UK Biobank