Clear Sky Science · nl

Vooraf trainen van genomische taalmodellen met varianten voor betere modellering van functionele genomica

Computers leren de taal van DNA lezen

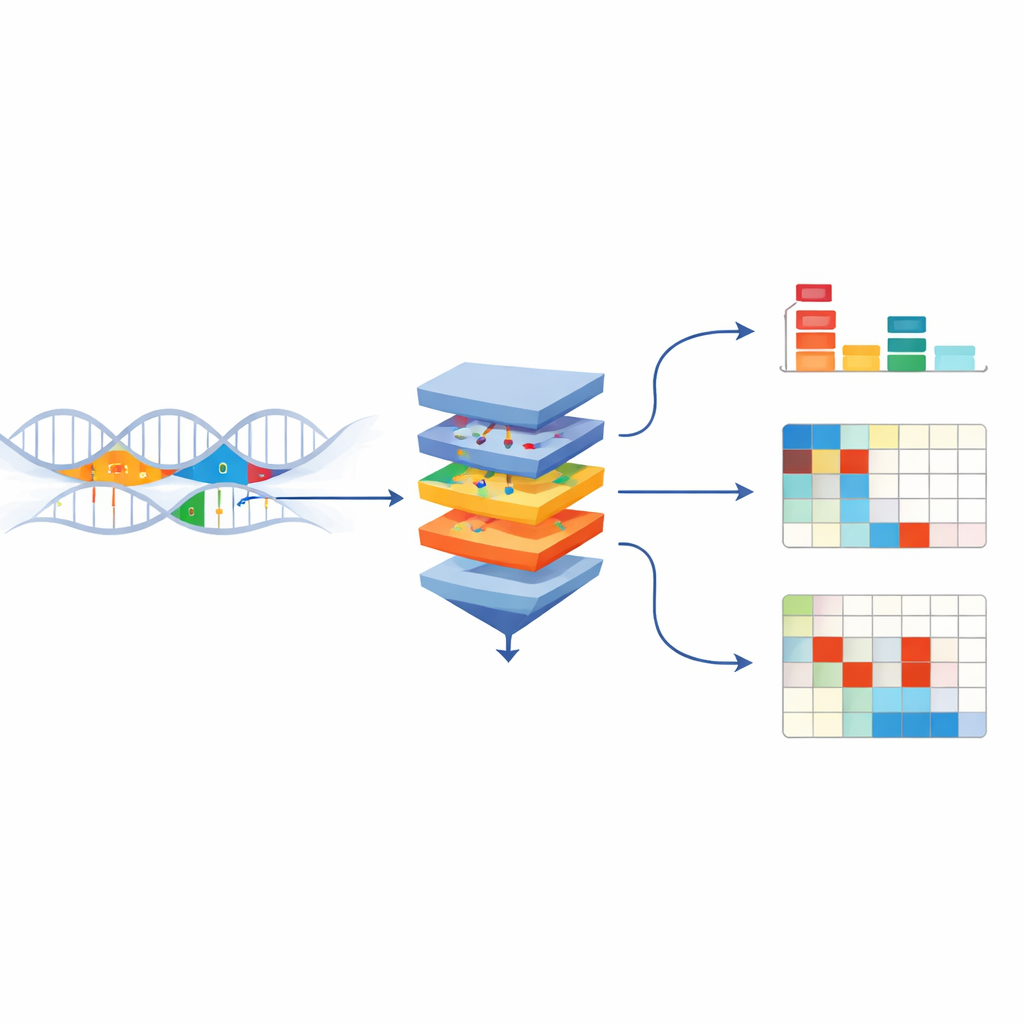

Het DNA van elke persoon bevat miljoenen kleine verschillen, of varianten, die bijdragen aan eigenschappen zoals lengte en ziektegevoeligheid. Wetenschappers weten dat veel van deze varianten bepalen hoe sterk genen aan- of uitgezet worden, maar het leggen van de verbinding tussen DNA-letters en genactiviteit is lastig geweest. Deze studie introduceert nieuwe kunstmatige-intelligentie modellen die DNA behandelen als een taal en gebruikmaken van variatiepatronen die in honderden duizenden mensen zijn waargenomen om beter te voorspellen hoe genen zich gedragen in specifieke cellen en bij individuele personen.

Waarom DNA als menselijke taal kan worden behandeld

Net zoals woorden in een zin verschillende betekenissen kunnen krijgen afhankelijk van de omgeving, kunnen DNA-stukken verschillende rollen vervullen afhankelijk van hun genomische “context”. Regulerende gebieden kunnen ver verwijderd liggen van de genen die ze aansturen, en hetzelfde DNA-stuk kan aan meerdere biologische functies bijdragen. De auteurs bouwen voort op het idee dat deze langafstandspatronen lijken op polysemie en contextafhankelijkheid in natuurlijke taal. Met neurale netwerkarchitecturen die oorspronkelijk voor tekst ontwikkeld zijn, proberen ze te leren hoe DNA-„grammatica” en menselijke genetische variatie samen genfunctie en expressie vormgeven.

Een genomisch taalmodel bouwen op basis van echte menselijke variatie

De onderzoekers creëerden UKBioBERT, een DNA-taalmodel dat is getraind op zowel het menselijke referentiegenoom als meer dan 13 miljoen varianten van ongeveer 300.000 deelnemers uit de UK Biobank. Tijdens het trainen krijgt het model gewijzigde DNA-sequenties te zien waarbij sommige basen verborgen zijn en uit de context geraden moeten worden, vergelijkbaar met het invullen van ontbrekende woorden in een zin. Dit zelfgestuurde proces dwingt het model om te internaliseren welke sequentiepatronen vaak samen voorkomen en hoe varianten die patronen veranderen. Het team test vervolgens de interne representaties van het model door na te gaan of sequenties van genen met vergelijkbare bekende functies dicht bij elkaar komen te liggen in deze geleerde ruimte. Volgens meerdere clustermaatregelen onderscheidt UKBioBERT genfuncties duidelijker dan vorige genomische modellen, zonder ooit die functies tijdens het trainen te hebben opgelegd.

Van sequentiepatronen naar genactiviteit in cellen en mensen

Het leren van de „taal” van DNA is alleen nuttig als het helpt echte biologie te verklaren, vooral genexpressie—het niveau waarop genen in verschillende celtypen en bij individuen worden aan- of uitgezet. De auteurs pluggen UKBioBERT’s sequentie-embeddings in bestaande deep-learning kaders die genactiviteit uit DNA voorspellen. Op het niveau van cellijnen verbeteren ze een architectuur genaamd EPInformer, die al promotor- en enhancer-sequenties met epigenetische signalen combineert. Het toevoegen van UKBioBERT’s DNA-embeddings en aparte tekstgebaseerde beschrijvingen van genfunctie leidt tot nauwkeurigere voorspellingen van genexpressie in meerdere menselijke cellijnen, met hogere correlaties tussen voorspelde en gemeten waarden en stabielere prestaties over cross-validatie-splits.

Gepersonaliseerde voorspellingen en wat een gen voorspelbaar maakt

Het team richt zich vervolgens op een moeilijkere taak: het voorspellen van genexpressie voor individuele personen op basis van hun gehele genoomsequenties. Eerst gebruiken ze UKBioBERT-embeddings met een traditionele statistische methode om expressie te voorspellen voor 41 representatieve genen in de GTEx-cohort. De prestaties zijn vergelijkbaar met, of lopen iets achter op, sterke referentiemodellen die handgemaakte genetische kenmerken gebruiken, en overtreffen ruim een niet-finetuned sequentiemodel. Intrigerend genoeg verschillen genen sterk in hoe voorspelbaar hun expressie is. Deze variatie wordt niet goed verklaard door standaardmaten zoals erfelijkheid (heritability). In plaats daarvan zijn genen waarvan de expressieniveaus over individuen duidelijkere clusterpatronen vormen—patronen die UKBioBERT’s embeddings kunnen vastleggen—geneigd beter voorspelbaar te zijn. Genen die bij veel verschillende biologische functies betrokken zijn, zijn moeilijker alleen uit sequentie te voorspellen.

Modellen fusioneren voor sterkere voorspellingen op individueel niveau

Om gepersonaliseerde voorspelling verder te verbeteren, fuseren de auteurs UKBioBERT met krachtige sequence-to-function modellen Enformer en Borzoi, en creëren UKBioFormer en UKBioZoi. Deze hybriden combineren langafstand-sequentiemodellering met variantenbewuste embeddings en worden efficiënt gefinetuned met parameterbesparende technieken. Over dezelfde set genen presteert UKBioFormer vaak beter dan zowel het vorige beste deep-model (Performer) als standaard statistische benaderingen voor genen waarvan de expressie redelijk voorspelbaar is. Het toont ook betere generalisatie wanneer modellen die op personen van Europese afkomst getraind zijn, worden toegepast op Afro-Amerikaanse individuen, wat suggereert dat leren van rauwe sequentie plus populatievarianten enige gedeelde regulerende logica tussen groepen vastlegt.

Inzage in hoe enkele varianten genactiviteit veranderen

Aangezien UKBioFormer een neuraal netwerk is, kan het worden bevraagd om te onthullen hoe individuele varianten zijn voorspellingen beïnvloeden. De auteurs gebruiken gradientgebaseerde methoden en in-silico mutatie-experimenten om te schatten hoe het veranderen van specifieke basen de voorspelde expressie beïnvloedt. Voor meerdere genen, waaronder één genaamd JUP, leidt het model de richting en de geschatte grootte van effecten voor de meerderheid van bekende regulerende varianten (eQTLs) correct af, inclusief enkele zeldzame varianten. Het benadrukt ook lokale sequentiemotieven rond deze varianten die overeenkomen met bekende bindingspatronen van regulerende eiwitten. Dit toont aan dat het model niet slechts algemene expressieniveaus past, maar mechanistische verbindingen leert tussen sequentiemotieven, varianten en genregulatie.

Wat dit werk betekent voor genomica en geneeskunde

Deze studie laat zien dat het trainen van genomische taalmodellen direct op grote verzamelingen menselijke varianten rijkere DNA-representaties oplevert die de voorspelling van genexpressie en de interpretatie van varianten verbeteren. Hoewel niet elk gen alleen uit sequentie voorspelbaar is, presteert het gecombineerde UKBioBERT–UKBioFormer-framework bijzonder goed voor genen waarvan de expressiepatronen gestructureerd en variant-gedreven zijn. Het biedt ook een praktische manier om te onderzoeken welke varianten het meest waarschijnlijk genactiviteit veranderen voordat kostbare experimenten worden uitgevoerd. Naarmate datasets diverser worden en methoden voor multi-gen training verbeteren, zouden dergelijke modellen belangrijke instrumenten kunnen worden om persoonlijke genomen aan moleculaire eigenschappen te koppelen en uiteindelijk onderzoek naar genetisch beïnvloede ziekten te sturen.

Bronvermelding: Liu, T., Zhang, X., Lin, J. et al. Pre-training genomic language model with variants for better modeling functional genomics. npj Artif. Intell. 2, 46 (2026). https://doi.org/10.1038/s44387-026-00103-4

Trefwoorden: genomische taalmodellen, voorspelling van genexpressie, genetische varianten, functionele genomica, UK Biobank