Clear Sky Science · pt

Pré-treinamento de um modelo de linguagem genômica com variantes para melhor modelagem da genômica funcional

Ensinando computadores a ler a linguagem do DNA

O DNA de cada pessoa carrega milhões de pequenas diferenças, ou variantes, que ajudam a moldar desde a altura até o risco de doenças. Cientistas sabem que muitas dessas variantes influenciam o quanto os genes são ativados ou desativados, mas conectar as letras do DNA à atividade gênica tem sido difícil. Este estudo introduz novos modelos de inteligência artificial que tratam o DNA como uma linguagem, usando padrões de variantes observados em centenas de milhares de pessoas para prever melhor como os genes se comportam em células e indivíduos específicos.

Por que o DNA pode ser tratado como uma linguagem humana

Assim como palavras assumem significados diferentes dependendo da frase ao redor, trechos de DNA podem ter papéis distintos dependendo do “contexto” genômico. Regiões regulatórias podem ficar longe dos genes que controlam, e o mesmo segmento de DNA pode contribuir para várias funções biológicas. Os autores partem da ideia de que esses padrões de longo alcance se assemelham à polissemia e à dependência de contexto observadas na linguagem natural. Usando arquiteturas de redes neurais originalmente desenvolvidas para texto, eles buscam aprender como a “gramática” do DNA e a variação genética humana juntas moldam a função e a expressão gênica.

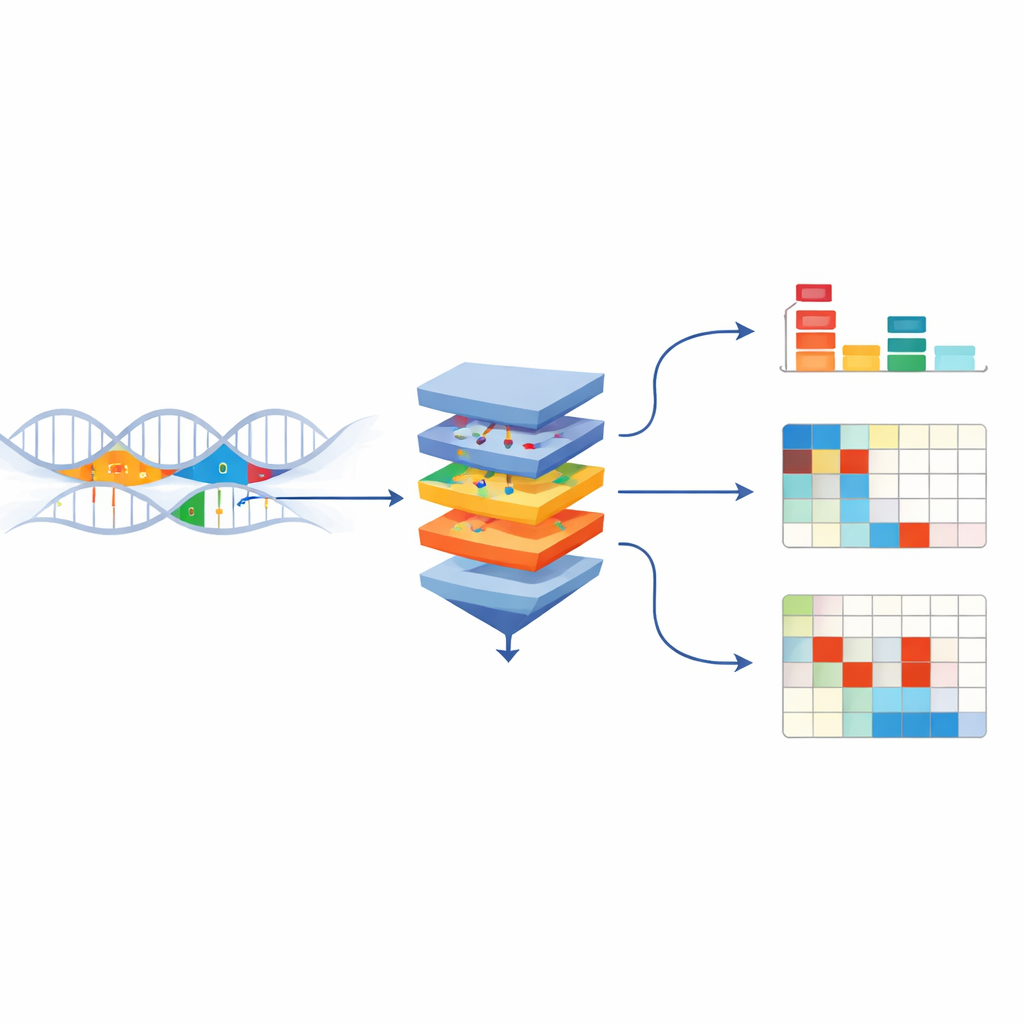

Construindo um modelo de linguagem genômica a partir da variação humana real

Os pesquisadores criaram o UKBioBERT, um modelo de linguagem para DNA treinado tanto no genoma de referência humano quanto em mais de 13 milhões de variantes de aproximadamente 300.000 participantes do UK Biobank. Durante o treinamento, o modelo recebe sequências de DNA modificadas em que algumas bases são ocultadas e devem ser adivinhadas pelo contexto, similar a preencher palavras que faltam em uma frase. Esse processo auto-supervisionado força o modelo a internalizar quais padrões de sequência tendem a coocorrer e como as variantes alteram esses padrões. A equipe então testa as representações internas do modelo questionando se sequências de genes com funções conhecidas semelhantes acabam próximas nesse espaço aprendido. Por várias medidas de clusterização, o UKBioBERT separa funções gênicas de forma mais clara do que modelos genômicos anteriores, sem nunca ter sido informado sobre essas funções durante o treinamento.

De padrões de sequência à atividade gênica em células e pessoas

Aprender a “linguagem” do DNA só é útil se ajudar a explicar a biologia real, especialmente a expressão gênica — o nível em que genes são ativados em diferentes tipos celulares e indivíduos. Os autores inserem as embeddings de sequência do UKBioBERT em estruturas de deep learning existentes que prevêem atividade gênica a partir do DNA. No nível de linhagens celulares, eles aprimoram uma arquitetura chamada EPInformer, que já combina sequências de promotores e enhancers com sinais epigenéticos. Adicionar as embeddings de DNA do UKBioBERT e descrições textuais separadas de função gênica leva a previsões mais precisas da expressão gênica em várias linhagens humanas, com correlações maiores entre valores previstos e medidos e desempenho mais estável entre divisões de validação cruzada.

Previsões personalizadas e o que torna um gene previsível

A equipe então aborda uma tarefa mais difícil: prever a expressão gênica para indivíduos com base apenas em suas sequências de genoma completo. Primeiro usam as embeddings do UKBioBERT com um método estatístico tradicional para prever expressão de 41 genes representativos na coorte GTEx. O desempenho rivaliza ou fica um pouco atrás de fortes linhas de base que usam características genéticas elaboradas manualmente, e supera por muito um modelo de sequência não ajustado. Curiosamente, os genes variam amplamente em quão previsíveis são em termos de expressão. Essa variação não é bem explicada por medidas padrão como herdabilidade. Em vez disso, genes cujos níveis de expressão naturalmente se organizam em clusters mais nítidos entre indivíduos — padrões que as embeddings do UKBioBERT conseguem capturar — tendem a ser mais previsíveis. Genes envolvidos em muitas funções biológicas diferentes são mais difíceis de prever somente pela sequência.

Fundindo modelos para previsões individuais mais robustas

Para avançar na previsão personalizada, os autores fundem o UKBioBERT com poderosos modelos de sequência-para-função Enformer e Borzoi, criando UKBioFormer e UKBioZoi. Esses híbridos combinam modelagem de sequência de longo alcance com embeddings sensíveis a variantes e são ajustados eficientemente usando técnicas que economizam parâmetros. No mesmo conjunto de genes, o UKBioFormer frequentemente supera tanto o melhor modelo profundo anterior (Performer) quanto abordagens estatísticas padrão para genes cuja expressão é razoavelmente previsível. Também mostra melhor generalização quando modelos treinados em pessoas de ascendência europeia são aplicados a indivíduos afro-americanos, sugerindo que aprender a partir da sequência bruta mais variantes populacionais captura alguma lógica regulatória compartilhada entre grupos.

Vendo como variantes únicas mudam a atividade gênica

Porque o UKBioFormer é uma rede neural, ele pode ser investigado para revelar como variantes individuais influenciam suas previsões. Os autores usam métodos baseados em gradiente e experimentos de mutação in-silico para estimar como alterar bases específicas modifica a expressão prevista. Para vários genes, incluindo um chamado JUP, o modelo infere corretamente a direção e o tamanho aproximado dos efeitos para a maioria das variantes regulatórias conhecidas (eQTLs), incluindo algumas raras. Ele também destaca motivos de sequência locais em torno dessas variantes que coincidem com padrões de ligação conhecidos de proteínas regulatórias. Isso mostra que o modelo não está apenas ajustando níveis globais de expressão, mas aprendendo vínculos mecanísticos entre motivos de sequência, variantes e regulação gênica.

O que este trabalho significa para genômica e medicina

Este estudo demonstra que treinar modelos de linguagem genômica diretamente em grandes coleções de variantes humanas gera representações de DNA mais ricas que melhoram a previsão de expressão gênica e a interpretação de variantes. Embora nem todo gene seja previsível apenas pela sequência, a combinação UKBioBERT–UKBioFormer tem desempenho particularmente bom para genes cujos padrões de expressão são estruturados e dirigidos por variantes. Também fornece uma forma prática de explorar quais variantes têm maior probabilidade de afetar a atividade gênica antes de realizar experimentos dispendiosos. À medida que conjuntos de dados se tornam mais diversos e métodos de treinamento multigênico melhoram, tais modelos podem se tornar ferramentas importantes para ligar genomas pessoais a traços moleculares e, em última instância, para orientar pesquisas sobre doenças influenciadas geneticamente.

Citação: Liu, T., Zhang, X., Lin, J. et al. Pre-training genomic language model with variants for better modeling functional genomics. npj Artif. Intell. 2, 46 (2026). https://doi.org/10.1038/s44387-026-00103-4

Palavras-chave: modelos de linguagem genômica, previsão de expressão gênica, variantes genéticas, genômica funcional, UK Biobank