Clear Sky Science · de

Vortrainieren eines genomischen Sprachmodells mit Varianten zur besseren Modellierung funktionaler Genomik

Computern beibringen, die Sprache der DNA zu lesen

Die DNA jeder Person trägt Millionen winziger Unterschiede, oder Varianten, die vielerlei Merkmale beeinflussen – von der Körpergröße bis zum Krankheitsrisiko. Wissenschaftler wissen, dass viele dieser Varianten steuern, wie stark Gene ein- oder ausgeschaltet werden, doch die Verbindung von DNA-Buchstaben zu Genaktivität war bisher schwer herzustellen. Diese Studie stellt neue KI-Modelle vor, die DNA wie eine Sprache behandeln und Muster von Varianten aus Hunderttausenden von Menschen nutzen, um besser vorherzusagen, wie Gene in bestimmten Zellen und Individuen funktionieren.

Warum DNA wie menschliche Sprache behandelt werden kann

So wie Wörter je nach umgebendem Satz unterschiedliche Bedeutungen annehmen, können DNA-Abschnitte je nach genomischem „Kontext“ verschiedene Rollen spielen. Regulationsbereiche können weit entfernt von den Genen liegen, die sie steuern, und derselbe DNA-Abschnitt kann zu mehreren biologischen Funktionen beitragen. Die Autor:innen bauen auf der Idee auf, dass diese langfristigen Muster der Polysemie und Kontextabhängigkeit natürlicher Sprache ähneln. Mit neuronalen Netzen, die ursprünglich für Text entwickelt wurden, wollen sie lernen, wie DNA-„Grammatik“ und menschliche genetische Variation zusammen Genfunktion und -expression formen.

Ein genomisches Sprachmodell aus realer menschlicher Variation aufbauen

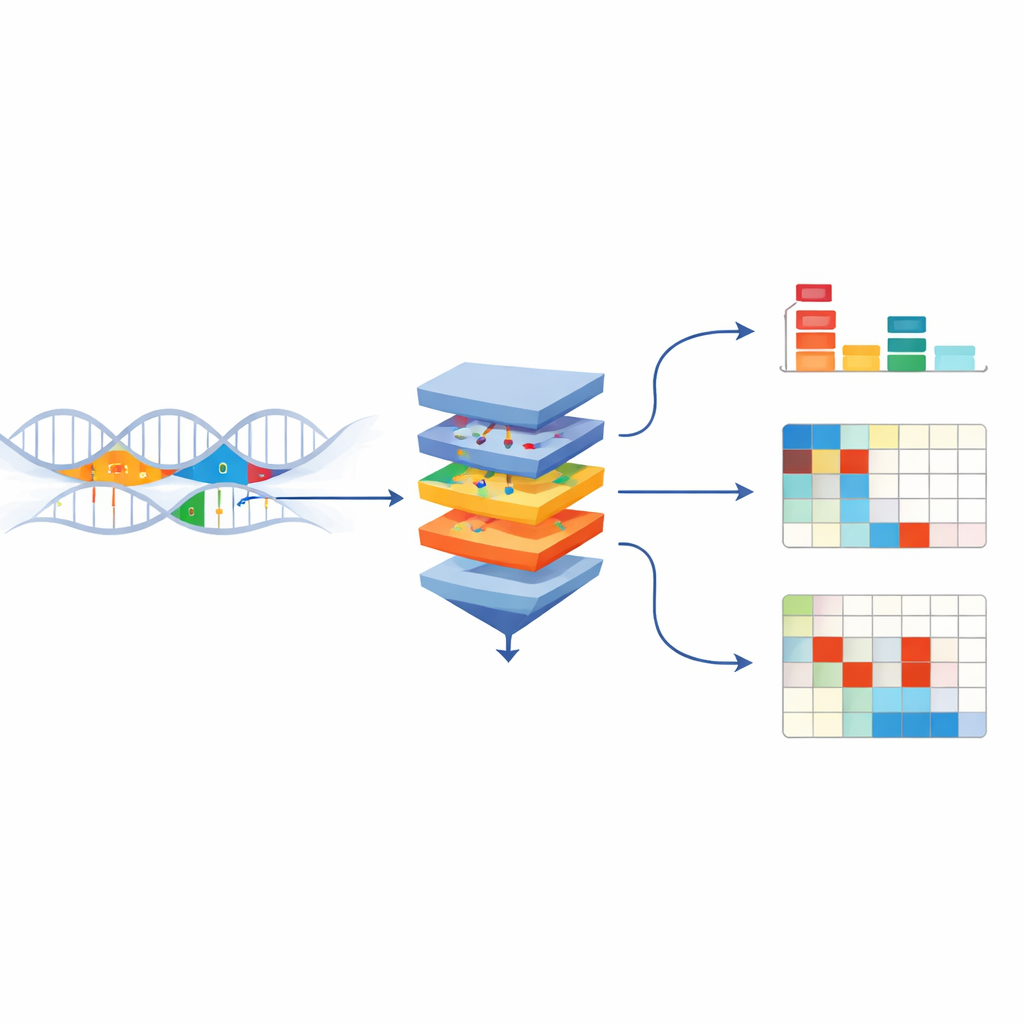

Die Forschenden entwickelten UKBioBERT, ein DNA-Sprachmodell, das sowohl am menschlichen Referenzgenom als auch an über 13 Millionen Varianten von rund 300.000 UK-Biobank-Teilnehmenden trainiert wurde. Während des Trainings werden dem Modell veränderte DNA-Sequenzen gezeigt, bei denen einige Basen verborgen sind und aus dem Kontext erraten werden müssen – ähnlich dem Ausfüllen fehlender Wörter in einem Satz. Dieser selbstüberwachte Prozess zwingt das Modell dazu, interne Muster zu lernen, welche Sequenzen typischerweise zusammen auftreten und wie Varianten diese Muster verändern. Das Team testet dann die internen Repräsentationen des Modells, indem es prüft, ob Sequenzen von Genen mit ähnlichen bekannten Funktionen im gelernten Raum nahe beieinander liegen. Anhand mehrerer Clustering-Maße trennt UKBioBERT Genfunktionen klarer als frühere genomische Modelle, obwohl ihm diese Funktionen nie während des Trainings mitgeteilt wurden.

Von Sequenzmustern zur Genaktivität in Zellen und Menschen

Das Erlernen der „Sprache“ der DNA ist nur nützlich, wenn es hilft, echte biologische Phänomene zu erklären – insbesondere die Genexpression, also das Ausmaß, in dem Gene in verschiedenen Zelltypen und Individuen ein- bzw. ausgeschaltet sind. Die Autor:innen fügen UKBioBERTs Sequenz-Einbettungen in bestehende Deep-Learning-Frameworks ein, die Genaktivität aus DNA vorhersagen. Auf Ebene von Zelllinien erweitern sie eine Architektur namens EPInformer, die bereits Promotor- und Enhancer-Sequenzen mit epigenetischen Signalen kombiniert. Das Hinzufügen von UKBioBERTs DNA-Einbettungen und separaten textbasierten Beschreibungen der Genfunktion führt zu genaueren Vorhersagen der Genexpression in mehreren menschlichen Zelllinien, mit höheren Korrelationen zwischen vorhergesagten und gemessenen Werten und stabilerer Leistung über Cross-Validation-Splits hinweg.

Personalisierte Vorhersagen und was ein Gen vorhersehbar macht

Das Team wendet sich dann einer schwierigeren Aufgabe zu: der Vorhersage der Genexpression einzelner Personen allein anhand ihrer Ganzgenomsequenzen. Zuerst nutzen sie UKBioBERT-Einbettungen mit einer traditionellen statistischen Methode, um die Expression von 41 repräsentativen Genen im GTEx-Kohorten zu prognostizieren. Die Leistung erreicht die starken Baselines, die handgestaltete genetische Merkmale verwenden, oder liegt nur leicht darunter, und übertrifft deutlich ein nicht feinabgestimmtes Sequenzmodell. Auffällig ist, dass Gene stark darin variieren, wie vorhersehbar ihre Expression ist. Diese Variation wird nicht gut durch Standardmaße wie Heritabilität erklärt. Stattdessen sind Gene, deren Expressionsniveaus über Individuen hinweg natürlicherweise klarere Cluster bilden – Muster, die UKBioBERTs Einbettungen erfassen können – tendenziell besser vorhersehbar. Gene, die an vielen verschiedenen biologischen Funktionen beteiligt sind, lassen sich allein aus der Sequenz schwerer vorhersagen.

Modelle verschmelzen für stärkere Vorhersagen auf Individualebene

Um personalisierte Vorhersagen weiter zu verbessern, verschmelzen die Autor:innen UKBioBERT mit leistungsstarken Sequence-to-Function-Modellen Enformer und Borzoi und schaffen so UKBioFormer und UKBioZoi. Diese Hybride kombinieren Langstrecken-Sequenzmodellierung mit variantensensitiven Einbettungen und werden effizient mittels parameter-schonender Feinabstimmung optimiert. Für denselben Gen-Satz übertrifft UKBioFormer häufig sowohl das bisher beste Deep-Modell (Performer) als auch standardmäßige statistische Ansätze für Gene, deren Expression einigermaßen vorhersehbar ist. Es zeigt auch verbesserte Generalisierung, wenn Modelle, die an Personen europäischer Abstammung trainiert wurden, auf Afroamerikanische Individuen angewendet werden, was darauf hindeutet, dass das Lernen aus Rohsequenz plus Populationsvarianten einige gemeinsame regulatorische Logiken über Gruppen hinweg erfasst.

Beobachten, wie einzelne Varianten die Genaktivität verändern

Da UKBioFormer ein neuronales Netzwerk ist, lässt es sich untersuchen, um zu zeigen, wie einzelne Varianten seine Vorhersagen beeinflussen. Die Autor:innen verwenden gradientenbasierte Methoden und In-silico-Mutations-Experimente, um abzuschätzen, wie das Ändern spezifischer Basen die vorhergesagte Expression verändert. Für mehrere Gene, darunter eines namens JUP, sagt das Modell die Richtung und die ungefähre Größe der Effekte für die Mehrheit bekannter regulatorischer Varianten (eQTLs) korrekt voraus, einschließlich einiger seltener. Es hebt außerdem lokale Sequenzmotive um diese Varianten hervor, die mit bekannten Bindungsmustern regulatorischer Proteine übereinstimmen. Das zeigt, dass das Modell nicht nur Gesamt-Expressionsniveaus anpasst, sondern mechanistische Verknüpfungen zwischen Sequenzmotiven, Varianten und Genregulation lernt.

Was diese Arbeit für Genomik und Medizin bedeutet

Die Studie zeigt, dass das direkte Training genomischer Sprachmodelle an großen Sammlungen menschlicher Varianten reichhaltigere DNA-Repräsentationen liefert, die die Vorhersage der Genexpression und die Interpretation von Varianten verbessern. Zwar ist nicht jedes Gen allein aus der Sequenz vorhersehbar, doch das kombinierte UKBioBERT–UKBioFormer-Framework liefert besonders gute Ergebnisse für Gene, deren Expressionsmuster strukturiert und variantengesteuert sind. Es bietet außerdem eine praktische Möglichkeit, vor teuren Experimenten zu untersuchen, welche Varianten am wahrscheinlichsten die Genaktivität verändern. Mit diverseren Datensätzen und verbesserten Methoden für Multi-Gen-Training könnten solche Modelle zu wichtigen Werkzeugen werden, um persönliche Genome mit molekularen Merkmalen zu verknüpfen und letztlich die Forschung zu genetisch beeinflussten Krankheiten zu leiten.

Zitation: Liu, T., Zhang, X., Lin, J. et al. Pre-training genomic language model with variants for better modeling functional genomics. npj Artif. Intell. 2, 46 (2026). https://doi.org/10.1038/s44387-026-00103-4

Schlüsselwörter: genomische Sprachmodelle, Vorhersage der Genexpression, genetische Varianten, funktionale Genomik, UK Biobank