Clear Sky Science · ru

Предобучение языковой модели генома с вариантами для лучшего моделирования функциональной геномики

Обучение компьютеров «читать» язык ДНК

В ДНК каждого человека содержится миллионы небольших различий, или вариантов, которые влияют на всё — от роста до риска заболеваний. Ученым известно, что многие из этих вариантов меняют силу включения и выключения генов, но установить последовательную связь между буквами ДНК и активностью генов было непросто. В этом исследовании представлены новые модели искусственного интеллекта, которые рассматривают ДНК как язык, используя шаблоны вариантов, наблюдаемые у сотен тысяч людей, чтобы лучше предсказывать, как гены ведут себя в конкретных клетках и у отдельных людей.

Почему ДНК можно рассматривать как человеческий язык

Точно так же, как слова меняют значение в зависимости от окружения в предложении, участки ДНК могут играть разные роли в зависимости от их геномного «контекста». Регуляторные регионы могут находиться далеко от генов, которыми они управляют, и тот же фрагмент ДНК может участвовать в нескольких биологических функциях. Авторы опираются на идею, что такие дальнодействующие закономерности напоминают полисемию и зависимость от контекста, наблюдаемые в естественном языке. Используя нейронные сети, изначально разработанные для текста, они стремятся научиться тому, как «грамматика» ДНК и человеческая генетическая вариативность вместе формируют функции и экспрессию генов.

Построение языковой модели генома на реальной человеческой вариативности

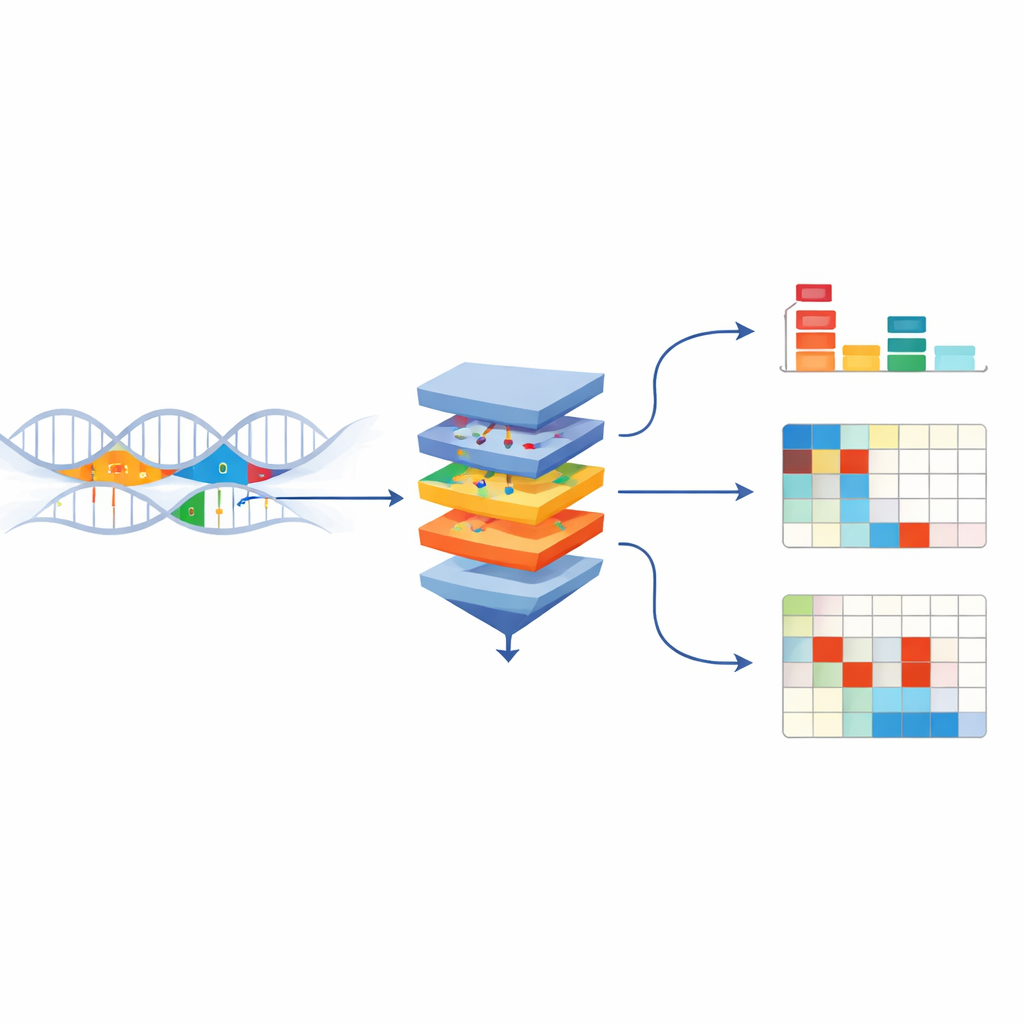

Исследователи создали UKBioBERT — языковую модель ДНК, обученную на эталонном человеческом геноме и более чем 13 миллионах вариантов от примерно 300 000 участников UK Biobank. В процессе обучения модели показывают модифицированные последовательности ДНК, в которых некоторые основания скрыты и их нужно угадать по контексту, аналогично заполнению пропущенных слов в предложении. Этот самообучающийся процесс заставляет модель усвоить, какие последовательные шаблоны обычно встречаются вместе и как варианты изменяют эти шаблоны. Команда затем проверяет внутренние представления модели, задаваясь вопросом, оказываются ли последовательности генов с похожими известными функциями близкими в этом обученном пространстве. По нескольким метрикам кластеризации UKBioBERT лучше разделяет функции генов, чем предыдущие геномные модели, хотя во время обучения ему никогда не сообщали эти функции.

От шаблонов последовательности к активности генов в клетках и у людей

Изучение «языка» ДНК имеет смысл только в том случае, если это помогает объяснять реальную биологию, особенно экспрессию генов — уровень, на котором гены включаются в разных типах клеток и у разных людей. Авторы подставляют встраивания последовательностей UKBioBERT в существующие глубокие архитектуры, предсказывающие активность генов по ДНК. На уровне клеточных линий они улучшают архитектуру EPInformer, которая уже объединяет промоторные и энхансерные последовательности с эпигенетическими сигналами. Добавление встраиваний ДНК от UKBioBERT и отдельных текстовых описаний функций генов приводит к более точным предсказаниям экспрессии генов в нескольких человеческих клеточных линиях: наблюдаются более высокие корреляции между предсказанными и измеренными значениями и более стабильная производительность при кросс-валидации.

Персонализированные предсказания и признаки предсказуемости гена

Затем команда переходит к более сложной задаче: предсказанию экспрессии генов у отдельных людей, исходя только из их полногеномных последовательностей. Сначала они используют встраивания UKBioBERT вместе с традиционным статистическим методом для прогнозирования экспрессии 41 представительного гена в когорте GTEx. Производительность сопоставима или немного уступает сильным базовым методам, использующим вручную сформированные генетические признаки, и значительно превосходит немодифицированную последовательностную модель. Примечательно, что гены сильно различаются по тому, насколько предсказуема их экспрессия. Это различие плохо объясняется стандартными мерами, такими как наследуемость. Вместо этого гены, чьи уровни экспрессии естественно образуют более чёткие кластеры между индивидами — шаблоны, которые встраивания UKBioBERT способны захватить, — обычно предсказуемы с большей точностью. Гены, вовлечённые во многие разные биологические функции, сложнее предсказать, опираясь только на последовательность.

Слияние моделей для более сильных предсказаний на уровне отдельных людей

Чтобы усилить персонализированные предсказания, авторы объединяют UKBioBERT с мощными моделями «последовательность→функция» Enformer и Borzoi, создавая UKBioFormer и UKBioZoi. Эти гибриды сочетают моделирование дальнего контекста последовательности с учётом вариантов и дообучаются эффективно с использованием приёмов сохранения параметров. По тому же набору генов UKBioFormer часто превосходит как предыдущую лучшую глубокую модель (Performer), так и стандартные статистические подходы для генов с достаточно предсказуемой экспрессией. Он также показывает лучшую обобщаемость, когда модели, обученные на людях европейского происхождения, применяют к представителям афроамериканской популяции, что указывает на то, что обучение на сырой последовательности в сочетании с популяционными вариантами улавливает общую регуляторную логику между группами.

Наблюдение, как отдельные варианты меняют активность генов

Поскольку UKBioFormer — нейронная сеть, её можно исследовать, чтобы выяснить, как отдельные варианты влияют на предсказания. Авторы используют методы на основе градиентов и ин-силико эксперименты с мутациями, чтобы оценить, как замена конкретных оснований меняет предсказанную экспрессию. Для нескольких генов, включая JUP, модель правильно восстанавливает направление и примерный масштаб эффектов для большинства известных регуляторных вариантов (eQTL), включая некоторые редкие. Она также выделяет локальные последовательностные мотивы вокруг этих вариантов, соответствующие известным паттернам связывания регуляторных белков. Это показывает, что модель не просто подстраивается под общие уровни экспрессии, но изучает механистические связи между последовательностными мотивами, вариантами и регуляцией генов.

Что это значит для геномики и медицины

Исследование демонстрирует, что обучение языковых моделей генома напрямую на больших наборах человеческих вариантов даёт более богатые представления ДНК, которые улучшают прогнозирование экспрессии генов и интерпретацию вариантов. Хотя не каждый ген предсказуем только по последовательности, объединённая схема UKBioBERT–UKBioFormer показывает особенно хорошую работу для генов с упорядоченными и управляемыми вариантами паттернами экспрессии. Она также предоставляет практический способ оценить, какие варианты с наибольшей вероятностью изменят активность гена, прежде чем проводить дорогостоящие эксперименты. По мере того как наборы данных станут более разнообразными и методы обучения на многих генах улучшатся, такие модели могут превратиться в важные инструменты для связывания персональных геномов с молекулярными признаками и, в конечном счёте, для направления исследований генетически детерминированных заболеваний.

Цитирование: Liu, T., Zhang, X., Lin, J. et al. Pre-training genomic language model with variants for better modeling functional genomics. npj Artif. Intell. 2, 46 (2026). https://doi.org/10.1038/s44387-026-00103-4

Ключевые слова: языковые модели генома, прогнозирование экспрессии генов, генетические варианты, функциональная геномика, UK Biobank