Clear Sky Science · it

Pre-addestramento di un modello linguistico genomico con varianti per una migliore modellazione della genomica funzionale

Insegnare ai computer a leggere il linguaggio del DNA

Il DNA di ciascuna persona contiene milioni di piccole differenze, o varianti, che contribuiscono a determinare tutto, dall’altezza al rischio di malattia. I ricercatori sanno che molte di queste varianti influenzano quanto fortemente i geni vengono attivati o disattivati, ma collegare le lettere del DNA all’attività genica è stato finora difficile. Questo studio presenta nuovi modelli di intelligenza artificiale che trattano il DNA come una lingua, sfruttando i pattern di varianti osservati in centinaia di migliaia di persone per prevedere meglio come i geni si comportano in cellule e individui specifici.

Perché il DNA può essere trattato come il linguaggio umano

Proprio come le parole assumono significati diversi a seconda della frase che le circonda, tratti di DNA possono svolgere ruoli diversi a seconda del “contesto” genomico. Le regioni regolatorie possono trovarsi lontano dai geni che controllano, e lo stesso segmento di DNA può contribuire a diverse funzioni biologiche. Gli autori partono dall’idea che questi schemi a lungo raggio somiglino alla polisemia e alla dipendenza dal contesto osservate nel linguaggio naturale. Utilizzando architetture neurali sviluppate originariamente per il testo, mirano a imparare come la “grammatica” del DNA e la variazione genetica umana insieme plasmino la funzione e l’espressione genica.

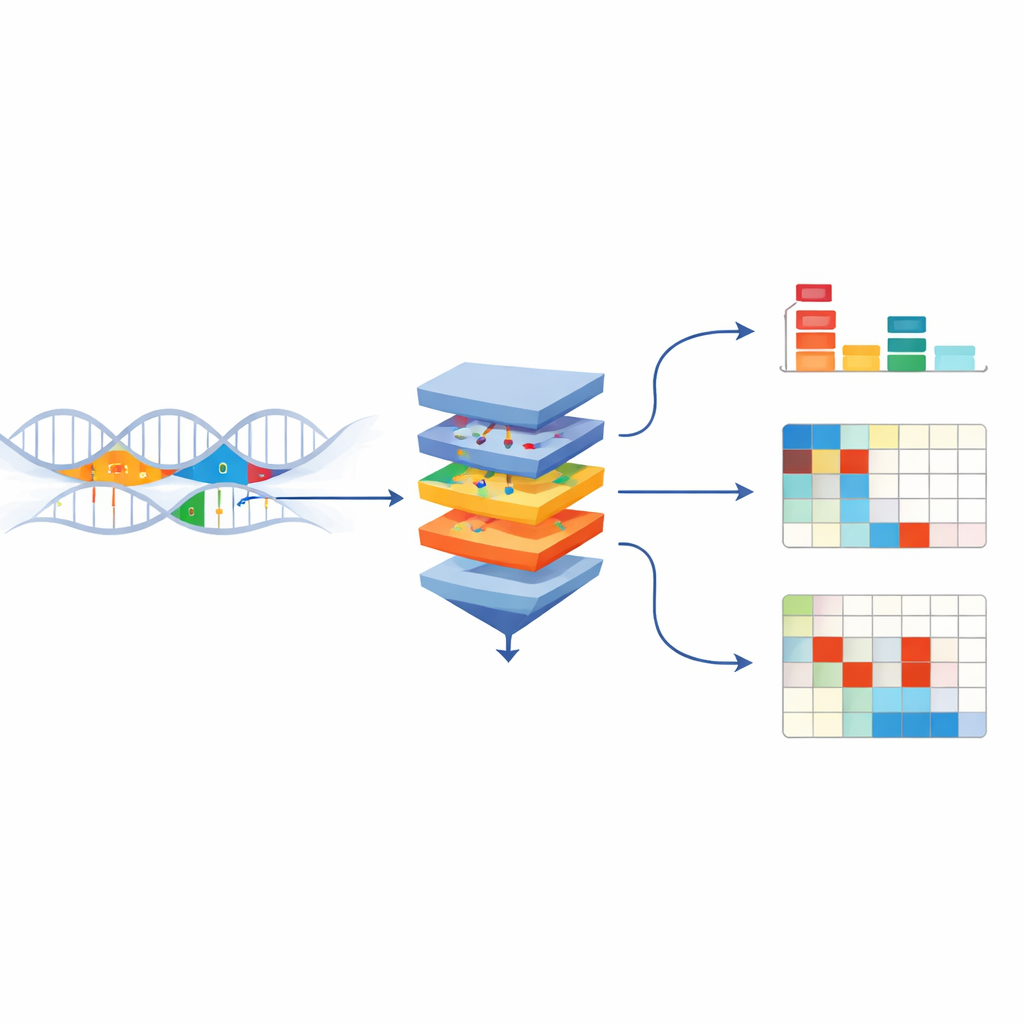

Costruire un modello linguistico genomico a partire dalla variazione umana reale

I ricercatori hanno creato UKBioBERT, un modello linguistico del DNA addestrato sia sul genoma di riferimento umano sia su oltre 13 milioni di varianti provenienti da circa 300.000 partecipanti della UK Biobank. Durante l’addestramento, al modello vengono mostrate sequenze di DNA modificate in cui alcune basi sono nascoste e devono essere indovinate dal contesto, in modo analogo a riempire parole mancanti in una frase. Questo processo auto-supervisionato obbliga il modello a interiorizzare quali pattern di sequenza tendono a co-occorre e come le varianti ne alterano la struttura. Il team poi valuta le rappresentazioni interne del modello verificando se sequenze provenienti da geni con funzioni note simili finiscono vicine nello spazio appreso. Secondo diverse misure di clustering, UKBioBERT separa le funzioni geniche in modo più netto rispetto ai precedenti modelli genomici, pur non essendo mai stato informato di tali funzioni durante l’addestramento.

Dai pattern di sequenza all’attività genica in cellule e persone

Imparare il “linguaggio” del DNA è utile solo se aiuta a spiegare la biologia reale, in particolare l’espressione genica — il livello a cui i geni vengono attivati in diversi tipi cellulari e individui. Gli autori inseriscono gli embedding delle sequenze di UKBioBERT in architetture di deep learning esistenti che prevedono l’attività genica a partire dal DNA. A livello di linee cellulari, potenziano un’architettura chiamata EPInformer, che già combina sequenze di promotori e enhancer con segnali epigenetici. L’aggiunta degli embedding del DNA di UKBioBERT e di descrizioni testuali separate della funzione genica porta a predizioni più accurate dell’espressione genica in diverse linee cellulari umane, con correlazioni più elevate tra valori predetti e misurati e prestazioni più stabili attraverso split di cross-validation.

Predizioni personalizzate e cosa rende un gene prevedibile

Il team affronta poi un compito più difficile: prevedere l’espressione genica per singoli individui basandosi esclusivamente sulle loro sequenze genomiche complete. In primo luogo usano gli embedding di UKBioBERT con un metodo statistico tradizionale per predire l’espressione di 41 geni rappresentativi nella coorte GTEx. Le prestazioni sono in linea o leggermente inferiori rispetto a solidi baseline che impiegano caratteristiche genetiche costruite a mano, e superano di gran lunga un modello di sequenza non adattato. È interessante notare che i geni variano molto nella prevedibilità della loro espressione. Questa variazione non è ben spiegata da misure standard come l’ereditabilità. Invece, i geni i cui livelli di espressione si distribuiscono naturalmente in cluster più chiari tra gli individui — pattern che gli embedding di UKBioBERT possono catturare — tendono a essere più prevedibili. I geni coinvolti in molteplici funzioni biologiche sono più difficili da prevedere dalla sola sequenza.

Fondere modelli per predizioni individuali più accurate

Per spingere oltre la predizione personalizzata, gli autori fondono UKBioBERT con potenti modelli sequence-to-function come Enformer e Borzoi, creando UKBioFormer e UKBioZoi. Questi ibridi combinano la modellazione di sequenze a lungo raggio con embedding sensibili alle varianti e vengono ottimizzati in modo efficiente usando tecniche che risparmiano parametri. Sull’insieme di geni considerato, UKBioFormer spesso supera sia il precedente miglior modello deep (Performer) sia gli approcci statistici standard per i geni la cui espressione è ragionevolmente prevedibile. Mostra inoltre una migliore generalizzazione quando modelli addestrati su persone di ascendenza europea sono applicati a individui afroamericani, suggerendo che l’apprendimento dalla sequenza grezza più le varianti di popolazione cattura una logica regolatoria condivisa tra i gruppi.

Osservare come singole varianti cambiano l’attività genica

Poiché UKBioFormer è una rete neurale, può essere sondato per rivelare come singole varianti influenzano le sue predizioni. Gli autori usano metodi basati sui gradienti e esperimenti di mutazione in silico per stimare come la modifica di basi specifiche alteri l’espressione predetta. Per diversi geni, incluso uno chiamato JUP, il modello inferisce correttamente la direzione e la dimensione approssimativa degli effetti per la maggioranza delle varianti regolatorie note (eQTL), comprese alcune rare. Evidenzia anche motivi di sequenza locali attorno a queste varianti che corrispondono a pattern di legame noti di proteine regolatorie. Ciò dimostra che il modello non si limita ad adattare i livelli globali di espressione, ma apprende legami meccanicistici tra motivi di sequenza, varianti e regolazione genica.

Cosa significa questo lavoro per la genomica e la medicina

Questo studio dimostra che addestrare modelli linguistici genomici direttamente su grandi raccolte di varianti umane produce rappresentazioni del DNA più ricche che migliorano la predizione dell’espressione genica e l’interpretazione delle varianti. Pur non essendo prevedibile ogni gene dalla sola sequenza, il framework combinato UKBioBERT–UKBioFormer funziona particolarmente bene per geni i cui schemi di espressione sono strutturati e guidati dalle varianti. Fornisce inoltre un modo pratico per esplorare quali varianti è più probabile che modifichino l’attività genica prima di condurre esperimenti costosi. Con l’aumentare della diversità dei dataset e il miglioramento dei metodi per l’addestramento multi-gene, tali modelli potrebbero diventare strumenti importanti per collegare i genomi personali a tratti molecolari e, in ultima analisi, per guidare la ricerca sulle malattie influenzate geneticamente.

Citazione: Liu, T., Zhang, X., Lin, J. et al. Pre-training genomic language model with variants for better modeling functional genomics. npj Artif. Intell. 2, 46 (2026). https://doi.org/10.1038/s44387-026-00103-4

Parole chiave: modelli linguistici genomici, predizione dell'espressione genica, varianti genetiche, genomica funzionale, UK Biobank