Clear Sky Science · sv

Borttagning av hår och artefakter i dermoskopiska bilder med djupinlärning för förbättrad hudcancerdetektion

Klarare hudbilder för att rädda liv

Att upptäcka farliga hudcancerformer tidigt kan skilja mellan en enkel poliklinisk åtgärd och livshotande sjukdom. Läkare förlitar sig i ökande grad på närbilder av huden, så kallade dermoskopiska bilder, för att se subtila färgmönster och gränser i leverfläckar. Men i verkligheten är dessa bilder ofta stökiga med hår, blänk från lampor och skuggor. Denna studie visar hur ett modernt artificiellt intelligenssystem automatiskt kan "rensa" sådana bilder, ta bort visuell oreda samtidigt som de fina detaljer som läkare och diagnostisk programvara behöver för att upptäcka melanom bevaras.

Problemet med röriga hudfoton

Även om melanom är mindre vanligt än andra hudcancerformer är det betydligt mer dödligt, så tidig och korrekt diagnos är avgörande. Dermoskopi gör det möjligt för kliniker att se strukturer under hudytan, men bilderna är sällan felfria. Hår som korsar synfältet, ojämn belysning och reflexer från huden eller kameralinsen kan sudda ut lesioners gränser och dölja pigmentmönster. Traditionella städrutiner förlitar sig på handgjorda regler och filter. De fungerar ofta bara för specifika typer av hår eller belysning och kan av misstag sudda ut delar av själva lesionen. Samtidigt förutsätter många datorstödda hudcancersystem tyst att indata redan är rena, vilket sällan stämmer i hektiska kliniker.

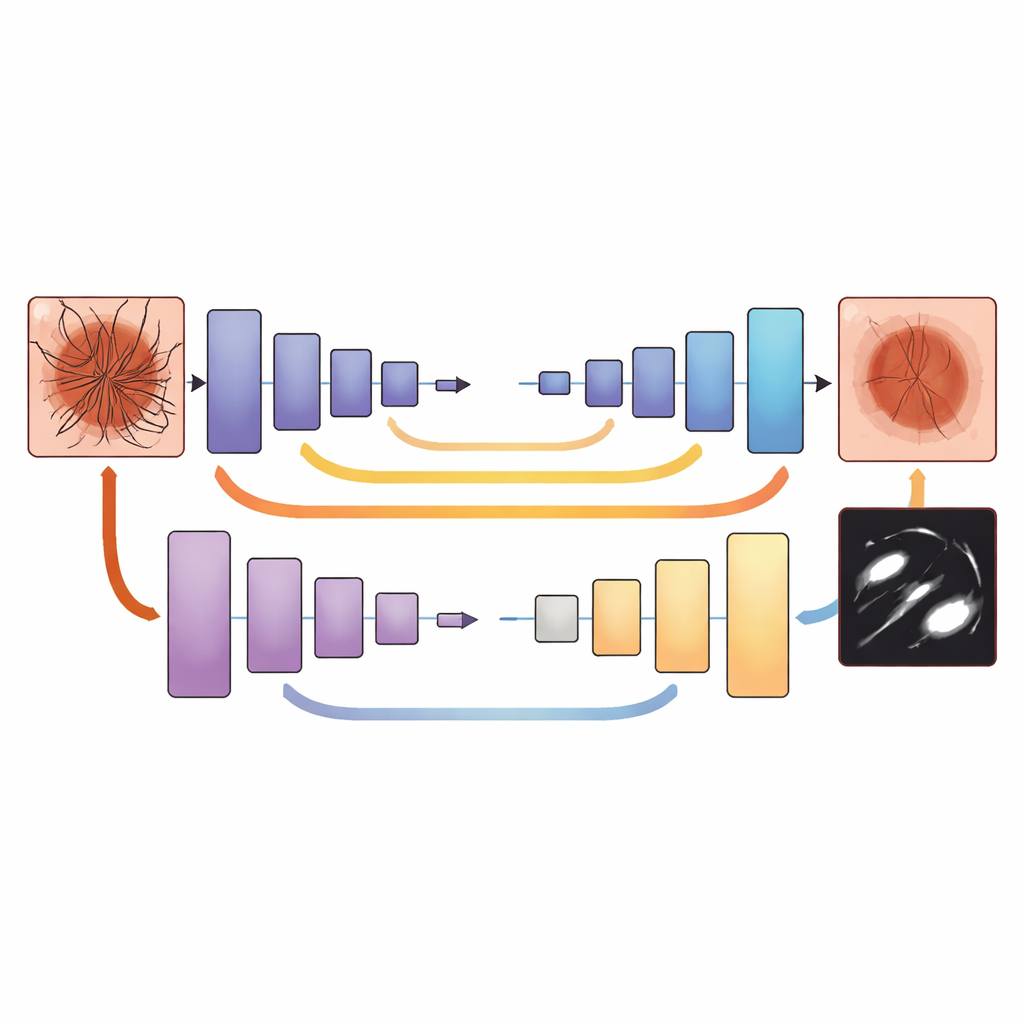

Att lära ett nätverk vad som ska tas bort och vad som ska bevaras

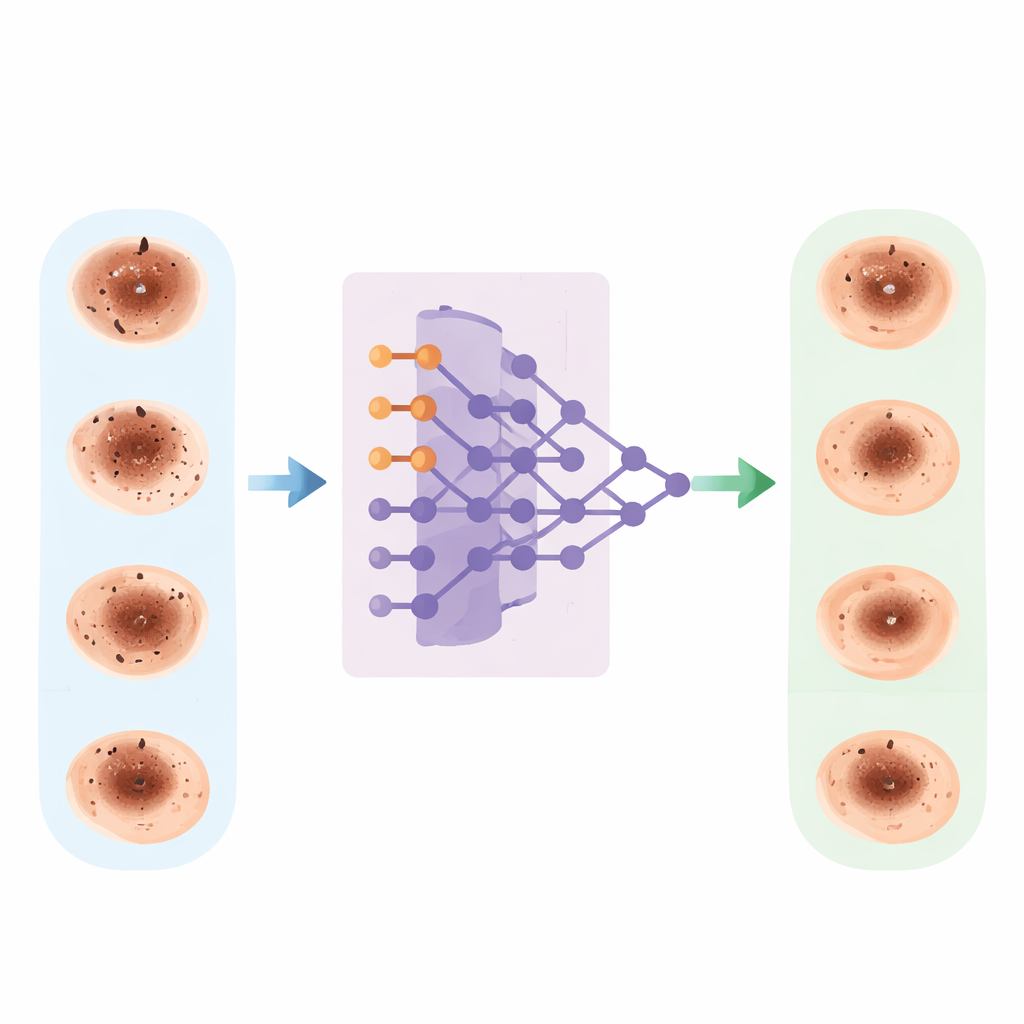

Forskarna tog itu med problemet genom att träna en djupinlärningsmodell känd som U‑Net för att separera oönskade artefakter från den faktiska hudlesionen på pixelnivå. De använde två stora, offentligt tillgängliga bildsamlingar av leverfläckar och andra fläckar på huden, som tillsammans täckte mer än 20 000 dermoskopiska bilder med både benigna och cancerösa lesioner. Varje bild förbehandlades noggrant: färger normaliserades så att bilder tagna med olika kameror eller belysning blev mer jämförbara, och datasetet utökades med spegelvända, roterade och lätt omfärgade versioner för att efterlikna den variation som ses i praktiken.

Att skapa precisa "ground truth" för oreda

Ett viktigt steg var att berätta för nätverket exakt vilka pixlar som var hår eller annan oreda och vilka som tillhörde lesionen eller den omgivande huden. Dermatologiexperter ritade manuellt detaljerade masker på representativa bilder och följde tunna hårstrån, måttlinjer, blänkundersökningar och skuggor samtidigt som de undvek viktiga lesionstrukturer. Klassiska bildbehandlingsverktyg användes därefter för att generera utkast till masker för många fler bilder, vilka experterna granskade och korrigerade. Alla bilder och masker ändrades i storlek till ett standardformat så att nätverket kunde lära sig konsekventa mönster. Under träningen belönade en specialanpassad förlustfunktion modellen både för att noggrant avgränsa artefakter och för att undvika oavsiktlig skada på lesionens detaljer, särskilt mycket tunna eller små strukturer.

Skarpare bilder och bättre cancerupptäckt

När modellen var tränad testades systemet på osedda bilder. Mått på bildkvalitet förbättrades markant: de rensade bilderna liknade mer ideala referensbilder och deras struktur bevarades bättre. Nätverket lärde sig också att markera hår och andra artefakter med hög precision, även när de var täta eller oregelbundna. För att se om detta hade klinisk betydelse matade författarna både original- och rensade bilder till en befintlig AI för melanomdetektion. Med rensade indata steg den klassificerarens noggrannhet från cirka 84 % till omkring 90–92 %, och ett viktigt balanserat prestationsmått (F1‑poäng) förbättrades med nästan 10 procentenheter. Modellens säkerhet i sina beslut ökade också, särskilt i svåra fall där oreda tidigare hade dolt lesionens gränser.

Vad detta betyder för framtida hudundersökningar

Detta arbete visar att borttagning av hår och annan visuell oreda inte bara är kosmetisk redigering utan ett avgörande första steg för tillförlitlig datorstödd hudcancerdiagnostik. Genom att lägga in ett artefaktborttagningsnätverk framför befintliga klassificerare kan kliniker och telemedicintjänster få klarare, mer standardiserade dermoskopiska bilder i realtid, utan att lägga extra arbete på läkare. Metoden behöver fortfarande testas på ännu mer varierade hudtoner, kameror och klinikmiljöer, men den erbjuder en praktisk väg mot mer tillförlitlig AI‑stödd melanomscreening och i slutändan tidigare behandling för patienter.

Citering: Hammouda, N.G., Shalaby, M., Alfilh, R.H.C. et al. Hair and artifact removal in dermoscopic images using deep learning for enhanced skin cancer detection. Sci Rep 16, 14452 (2026). https://doi.org/10.1038/s41598-026-44545-x

Nyckelord: melanom, dermoskopi, djupinlärning, bildförbehandling, upptäckt av hudcancer