Clear Sky Science · it

Rimozione di peli e artefatti nelle immagini dermoscopiche mediante deep learning per migliorare la rilevazione del cancro cutaneo

Immagini cutanee più nitide per salvare vite

Individuare tempestivamente i tumori cutanei pericolosi può fare la differenza tra una semplice procedura ambulatoriale e una malattia che mette a rischio la vita. I medici fanno sempre più affidamento su fotografie ravvicinate della pelle, chiamate immagini dermoscopiche, per osservare sottili pattern di colore e i bordi nei nei. Ma nella pratica reale queste immagini sono spesso infestate da peli, riflessi delle luci e ombre. Questo studio mostra come un moderno sistema di intelligenza artificiale possa automaticamente “pulire” tali immagini, rimuovendo il disturbo visivo preservando al contempo i dettagli fini di cui medici e software diagnostici hanno bisogno per individuare il melanoma prima.

Il problema delle foto cutanee disordinate

Sebbene il melanoma sia meno comune di altri tumori cutanei, è di gran lunga più letale, quindi una diagnosi precoce e accurata è fondamentale. La dermoscopia permette ai clinici di vedere strutture sotto la superficie cutanea, ma le immagini raramente sono perfette. Peli che attraversano il campo visivo, illuminazione non uniforme e riflessi dalla pelle o dall’obiettivo possono sfocare i bordi della lesione e nascondere i pattern di pigmento. I metodi tradizionali di pulizia si basano su regole e filtri artigianali: spesso funzionano solo su tipi specifici di peli o condizioni di luce e possono cancellare accidentalmente parti della lesione stessa. Allo stesso tempo, molti sistemi di supporto al rilevamento del cancro cutaneo danno per scontato che le immagini di ingresso siano già pulite, cosa che raramente corrisponde alla realtà nelle cliniche affollate.

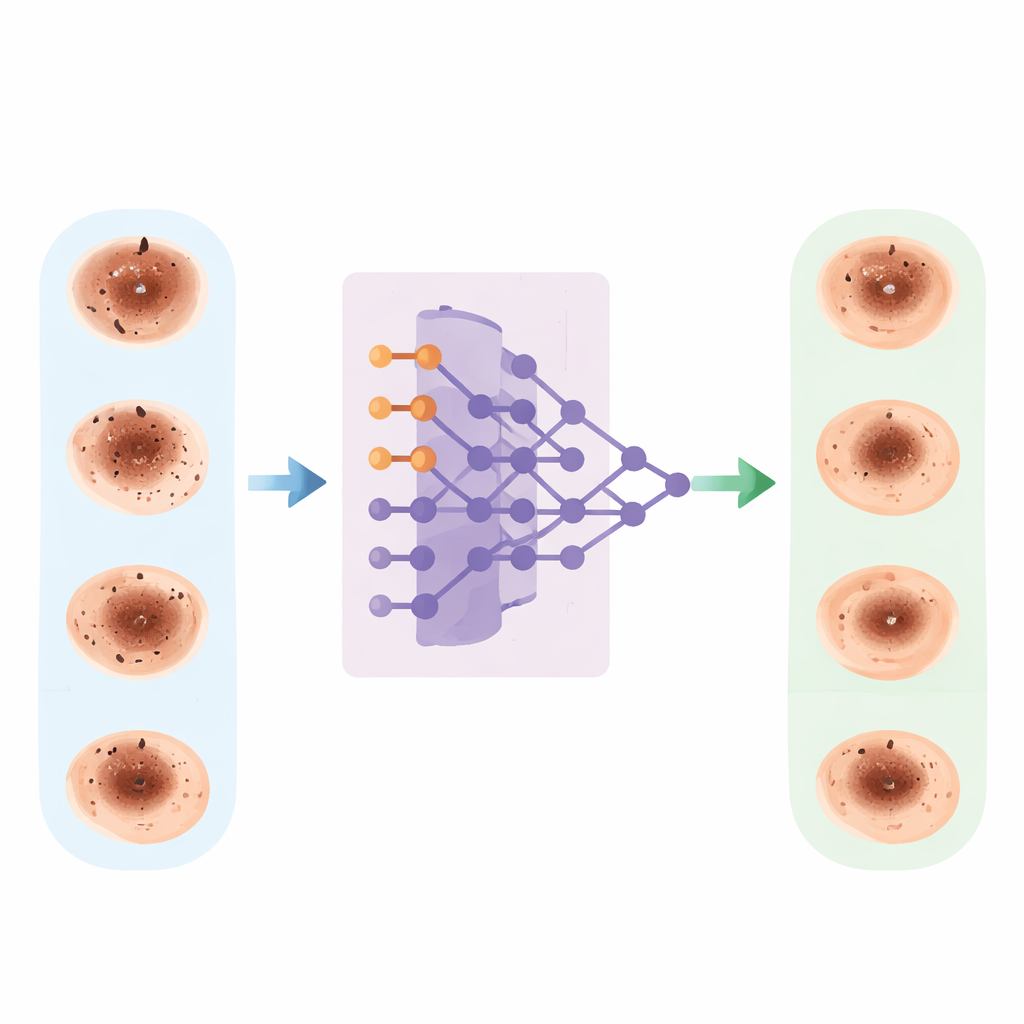

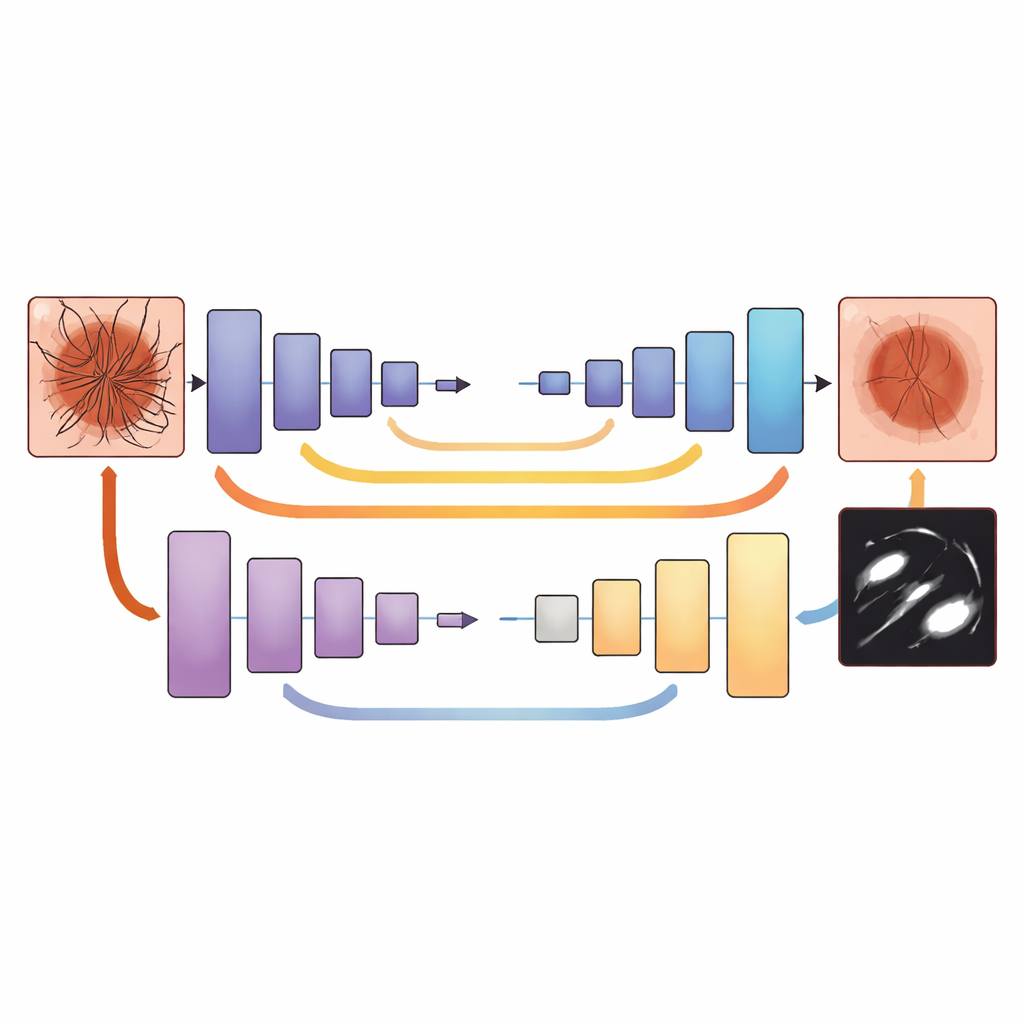

Addestrare una rete a cosa rimuovere e cosa conservare

I ricercatori hanno affrontato il problema addestrando un modello di deep learning noto come U‑Net a separare gli artefatti indesiderati dalla lesione cutanea reale a livello di singolo pixel. Hanno utilizzato due grandi raccolte di immagini di nevi e altre macchie cutanee disponibili pubblicamente, che insieme coprono oltre 20.000 immagini dermoscopiche con lesioni sia benigne sia maligne. Ogni immagine è stata accuratamente preelaborata: i colori sono stati normalizzati in modo che foto scattate con fotocamere o illuminazioni diverse risultassero più comparabili, e il dataset è stato ampliato con versioni ribaltate, ruotate e leggermente ricolorate per simulare la varietà osservata nella pratica reale.

Costruire un “ground truth” preciso per il disturbo

Un passaggio chiave è stato indicare alla rete esattamente quali pixel erano peli o altri artefatti e quali appartenevano alla lesione o alla pelle circostante. Esperti di dermatologia hanno disegnato manualmente maschere dettagliate su immagini rappresentative, tracciando peli sottili, segni di righelli, macchie da riverbero e ombre evitando le strutture importanti della lesione. Strumenti classici di elaborazione delle immagini sono stati poi usati per generare maschere di bozza per molte altre immagini, che gli esperti hanno revisionato e corretto. Tutte le immagini e le maschere sono state ridimensionate a un formato standard in modo che la rete potesse apprendere schemi coerenti. Durante l’addestramento, una funzione di perdita su misura ha ricompensato il modello sia per il corretto contorno degli artefatti sia per l’evitare danni accidentali ai dettagli della lesione, specialmente strutture molto sottili o piccole.

Immagini più nitide e migliore rilevazione del cancro

Una volta addestrato, il sistema è stato testato su immagini non viste in precedenza. Le misure della qualità dell’immagine sono migliorate nettamente: le immagini pulite assomigliavano di più a immagini di riferimento ideali e la loro struttura è risultata meglio preservata. La rete ha anche imparato a segnare peli e altri artefatti con alta precisione, anche quando erano densi o irregolari. Per valutare l’impatto clinico, gli autori hanno fornito sia le immagini originali sia quelle pulite a un AI già esistente per la rilevazione del melanoma. Con input puliti, la precisione di quel classificatore è aumentata da circa l’84% a circa il 90–92%, e una misura importante dell’equilibrio delle prestazioni (l’F1‑score) è migliorata di quasi 10 punti percentuali. Anche la fiducia del modello nelle sue decisioni è cresciuta, soprattutto nei casi difficili in cui il disturbo aveva in precedenza offuscato i bordi della lesione.

Cosa significa per i controlli cutanei futuri

Questo lavoro dimostra che rimuovere peli e altri disturbi visivi non è solo un ritocco estetico, ma un primo passo cruciale per una diagnosi computerizzata del cancro cutaneo affidabile. Integrando una rete di rimozione degli artefatti davanti ai classificatori esistenti, cliniche e servizi di telemedicina potrebbero ottenere immagini dermoscopiche più chiare e standardizzate in tempo reale, senza aumentare il carico di lavoro dei medici. L’approccio richiede ancora test su una gamma ancora più ampia di toni di pelle, fotocamere e contesti clinici, ma offre una strada pratica verso uno screening del melanoma con assistenza AI più affidabile e, in ultima analisi, trattamenti più precoci per i pazienti.

Citazione: Hammouda, N.G., Shalaby, M., Alfilh, R.H.C. et al. Hair and artifact removal in dermoscopic images using deep learning for enhanced skin cancer detection. Sci Rep 16, 14452 (2026). https://doi.org/10.1038/s41598-026-44545-x

Parole chiave: melanoma, dermoscopia, deep learning, preelaborazione delle immagini, rilevazione del cancro cutaneo