Clear Sky Science · es

Eliminación de cabello y artefactos en imágenes dermoscópicas mediante aprendizaje profundo para mejorar la detección del cáncer de piel

Imágenes cutáneas más claras para salvar vidas

Detectar cánceres de piel peligrosos de forma temprana puede marcar la diferencia entre un procedimiento ambulatorio sencillo y una enfermedad potencialmente mortal. Los médicos confían cada vez más en fotografías de primer plano de la piel, llamadas imágenes dermoscópicas, para ver patrones sutiles de color y los bordes de los lunares. Pero en la práctica estas imágenes suelen estar llenas de cabello, reflejos de las luces y sombras. Este estudio muestra cómo un sistema moderno de inteligencia artificial puede "limpiar" automáticamente esas imágenes, eliminando el desorden visual y preservando los detalles finos que los médicos y los programas de diagnóstico necesitan para detectar el melanoma antes.

El problema de las fotos cutáneas desordenadas

Aunque el melanoma es menos común que otros cánceres de piel, es mucho más letal, por lo que el diagnóstico temprano y preciso es crítico. La dermoscopia permite a los clínicos ver estructuras bajo la superficie de la piel, pero las imágenes rara vez son impecables. Los pelos que cruzan el campo de visión, la iluminación desigual y los reflejos de la piel o del objetivo de la cámara pueden difuminar los bordes de la lesión y ocultar patrones de pigmento. Los métodos tradicionales de limpieza se basan en reglas y filtros diseñados manualmente. A menudo funcionan solo con tipos específicos de cabello o condiciones de iluminación y pueden eliminar accidentalmente partes de la propia lesión. Al mismo tiempo, muchos sistemas informáticos de ayuda al diagnóstico del cáncer de piel dan por hecho, sin decirlo, que las imágenes de entrada ya están limpias, lo cual rara vez es cierto en clínicas concurridas.

Enseñar a una red qué eliminar y qué conservar

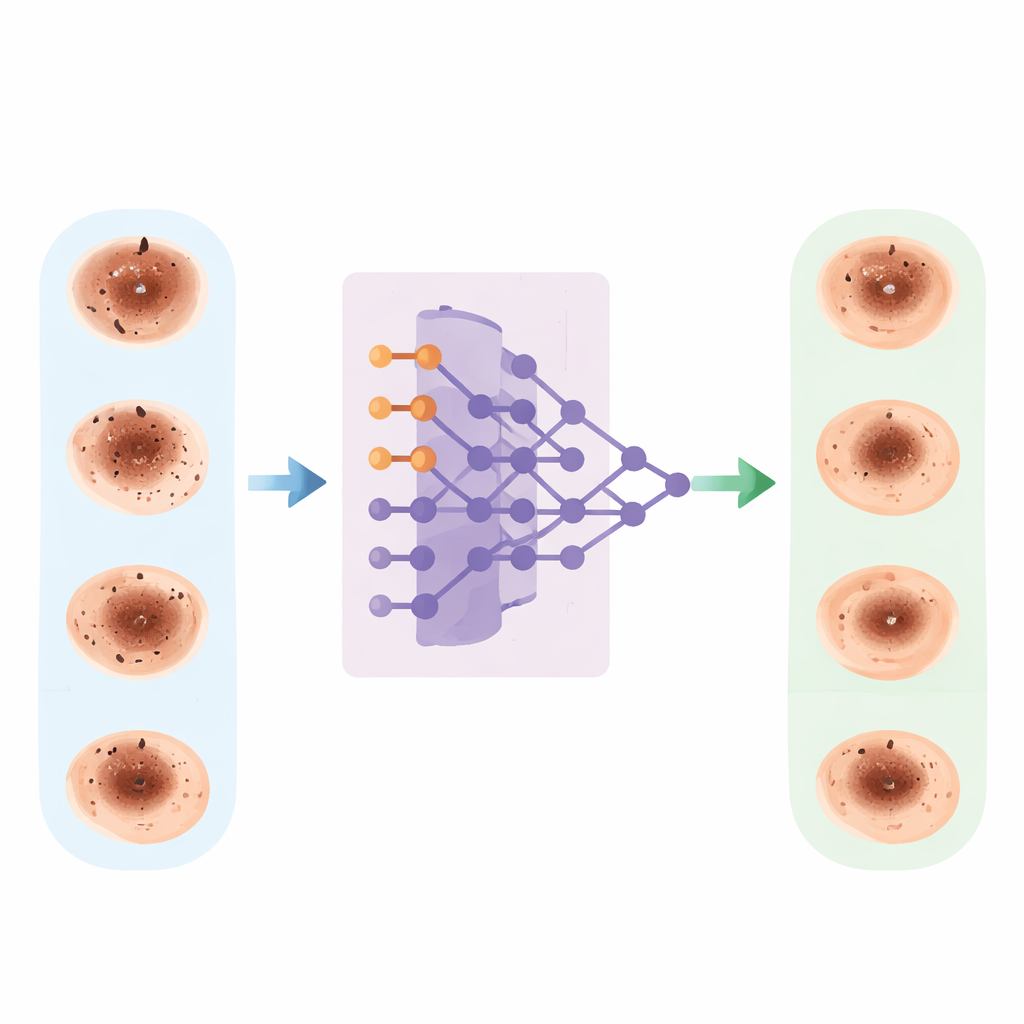

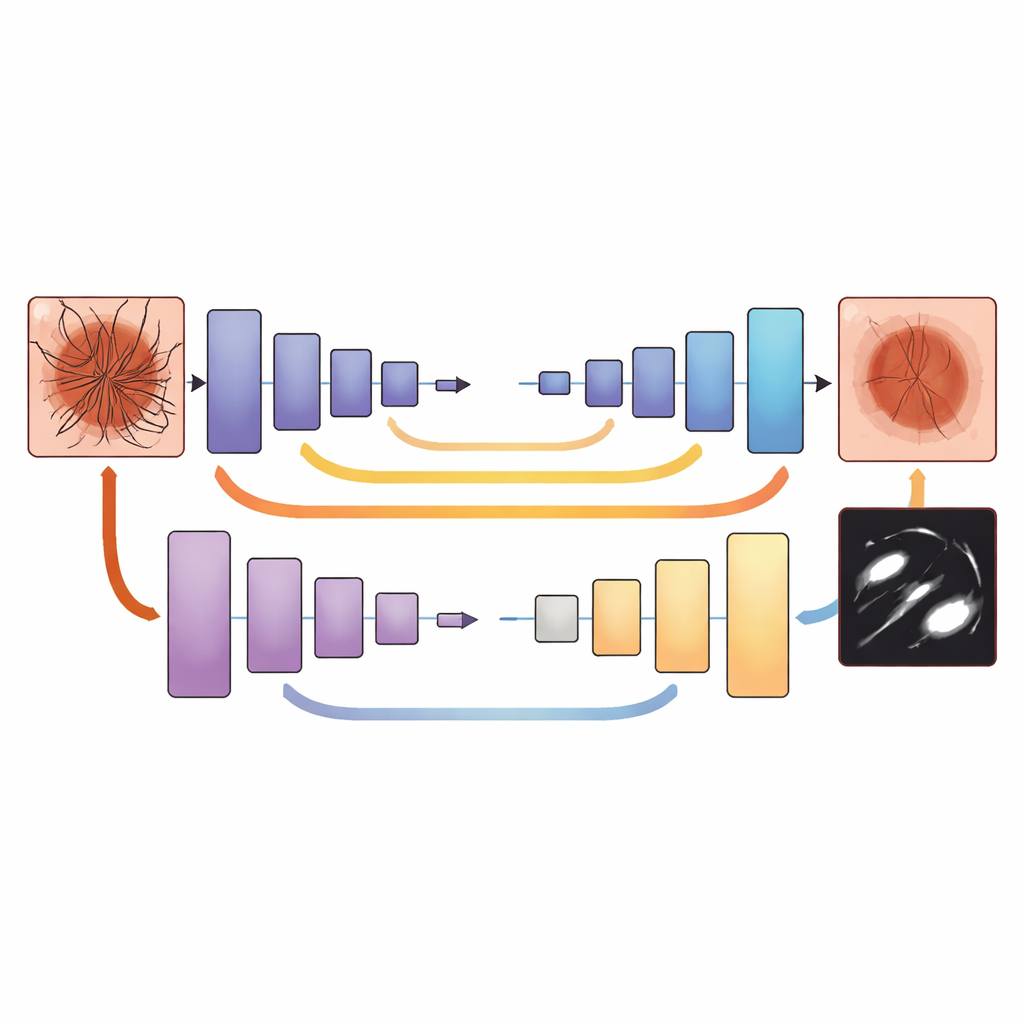

Los investigadores abordaron este problema entrenando un modelo de aprendizaje profundo conocido como U-Net para separar los artefactos no deseados de la lesión cutánea real a nivel de píxel. Utilizaron dos grandes colecciones públicas de imágenes de lunares y otras lesiones cutáneas, que sumadas cubren más de 20.000 imágenes dermoscópicas con lesiones benignas y cancerosas. Cada imagen fue cuidadosamente preprocesada: se normalizaron los colores para que fotos tomadas con cámaras o iluminaciones distintas fueran más comparables, y el conjunto de datos se amplió con versiones volteadas, rotadas y ligeramente recoloreadas para imitar la variedad que se observa en la práctica real.

Construir una “verdad de referencia” precisa para el desorden

Un paso clave fue indicarle a la red exactamente qué píxeles eran cabello u otro desorden y cuáles pertenecían a la lesión o a la piel circundante. Expertos en dermatología dibujaron manualmente máscaras detalladas en imágenes representativas, trazando pelos finos, marcas de regla, puntos de deslumbramiento y sombras, evitando las estructuras importantes de la lesión. Luego se emplearon herramientas clásicas de procesamiento de imagen para generar máscaras provisionales para muchas más imágenes, que los expertos revisaron y corrigieron. Todas las imágenes y máscaras se redimensionaron a un formato estándar para que la red pudiera aprender patrones consistentes. Durante el entrenamiento, una función de pérdida adaptada recompensó al modelo tanto por delinear con precisión los artefactos como por evitar dañar accidentalmente los detalles de la lesión, especialmente las estructuras muy finas o pequeñas.

Imágenes más nítidas y mejor detección del cáncer

Una vez entrenado, el sistema se probó con imágenes no vistas anteriormente. Las métricas de calidad de imagen mejoraron notablemente: las imágenes limpiadas se parecían más a imágenes de referencia ideales y su estructura se conservó mejor. La red también aprendió a marcar pelos y otros artefactos con alta precisión, incluso cuando eran densos o irregulares. Para evaluar si esto tenía impacto clínico, los autores introdujeron tanto las imágenes originales como las limpiadas en un sistema existente de detección de melanoma. Con entradas limpiadas, la precisión de ese clasificador aumentó de aproximadamente un 84% a alrededor de un 90–92%, y una medida clave de equilibrio del rendimiento (la puntuación F1) mejoró casi 10 puntos porcentuales. La confianza del modelo en sus decisiones también aumentó, especialmente en los casos difíciles donde el desorden antes ocultaba los bordes de la lesión.

Qué significa esto para las futuras revisiones de la piel

Este trabajo demuestra que eliminar el cabello y otros elementos visuales no es solo una edición cosmética, sino un paso inicial crucial para un diagnóstico por ordenador del cáncer de piel fiable. Al integrar una red de eliminación de artefactos delante de los clasificadores existentes, las clínicas y los servicios de telemedicina podrían obtener imágenes dermoscópicas más claras y estandarizadas en tiempo real, sin añadir trabajo a los médicos. El enfoque aún necesita pruebas en tonos de piel, cámaras y entornos clínicos aún más diversos, pero ofrece una vía práctica hacia un cribado de melanoma asistido por IA más fiable y, en última instancia, tratamientos más tempranos para los pacientes.

Cita: Hammouda, N.G., Shalaby, M., Alfilh, R.H.C. et al. Hair and artifact removal in dermoscopic images using deep learning for enhanced skin cancer detection. Sci Rep 16, 14452 (2026). https://doi.org/10.1038/s41598-026-44545-x

Palabras clave: melanoma, dermoscopia, aprendizaje profundo, preprocesamiento de imágenes, detección del cáncer de piel