Clear Sky Science · pt

Remoção de pelos e artefatos em imagens dermatoscópicas usando aprendizado profundo para melhorar a detecção do câncer de pele

Imagens de pele mais nítidas para salvar vidas

Detectar cânceres de pele perigosos precocemente pode representar a diferença entre um procedimento ambulatorial simples e uma doença com risco de vida. Médicos cada vez mais dependem de fotografias de close-up da pele, chamadas imagens dermatoscópicas, para observar padrões sutis de cor e contorno em pintas. Mas, na prática, essas imagens frequentemente vêm poluídas por pelos, brilho das luzes e sombras. Este estudo mostra como um sistema moderno de inteligência artificial pode “limpar” automaticamente essas imagens, removendo a desordem visual enquanto preserva os detalhes finos que médicos e softwares diagnósticos precisam para detectar o melanoma mais cedo.

O problema das fotos de pele confusas

Embora o melanoma seja menos comum que outros cânceres de pele, é muito mais letal, por isso o diagnóstico precoce e preciso é crucial. A dermoscopia permite que os clínicos vejam estruturas abaixo da superfície da pele, mas as imagens raramente estão impecáveis. Pelos que cruzam o campo de visão, iluminação desigual e reflexos da pele ou da lente da câmera podem borrar as bordas das lesões e ocultar padrões de pigmentação. Métodos tradicionais de limpeza dependem de regras e filtros manuais. Frequentemente funcionam apenas em tipos específicos de pelo ou iluminação e podem apagar acidentalmente partes da própria lesão. Ao mesmo tempo, muitos sistemas auxiliados por computador para detecção de câncer de pele presumem silenciosamente que as imagens de entrada já estão limpas, o que raramente é verdade em clínicas movimentadas.

Ensinar à rede o que remover e o que preservar

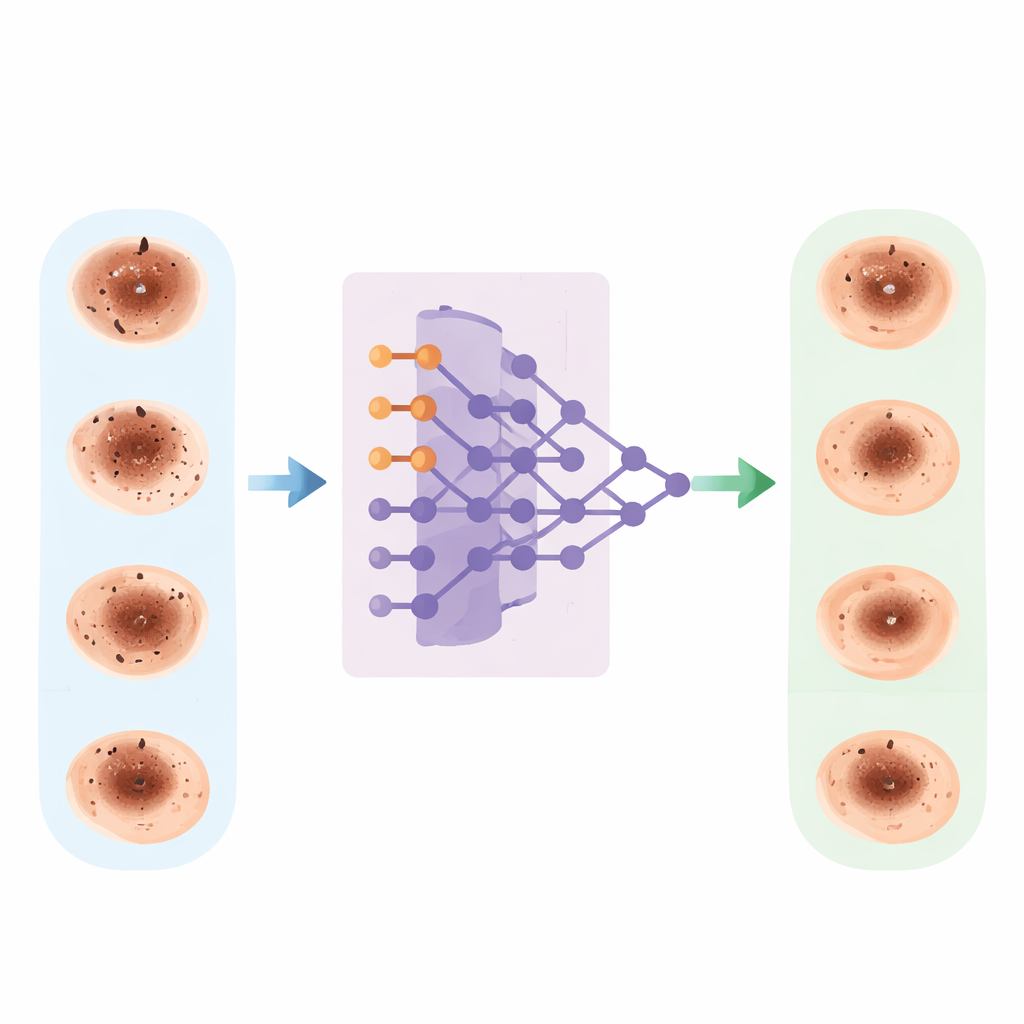

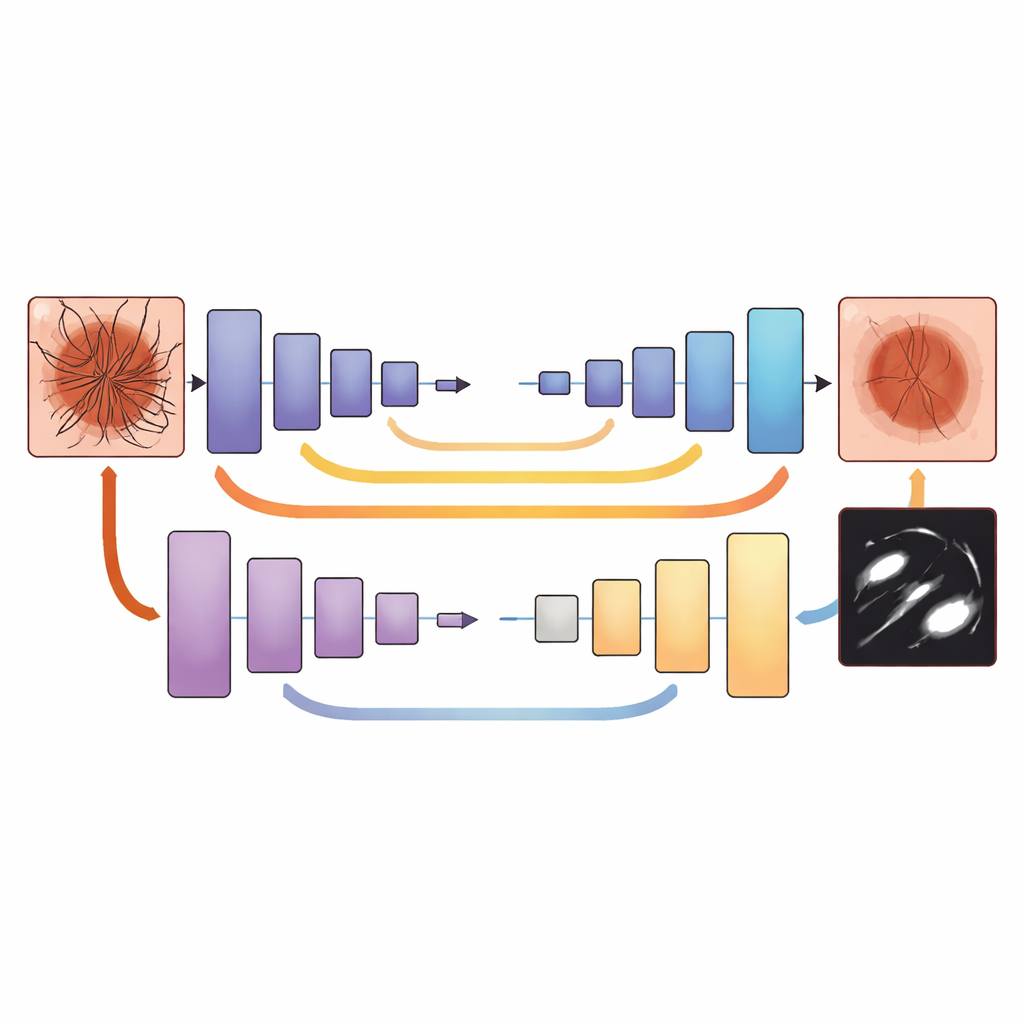

Os pesquisadores enfrentaram esse problema treinando um modelo de aprendizado profundo conhecido como U-Net para separar artefatos indesejados da lesão cutânea real ao nível de pixels individuais. Eles usaram duas grandes coleções públicas de imagens de pintas e outras manchas na pele, cobrindo conjuntamente mais de 20.000 imagens dermatoscópicas com lesões benignas e cancerosas. Cada imagem foi cuidadosamente pré-processada: as cores foram normalizadas para que fotos tiradas com câmeras ou iluminação diferentes ficassem mais comparáveis, e o conjunto de dados foi ampliado com versões espelhadas, rotacionadas e ligeiramente recoloridas para imitar a variedade observada na prática clínica.

Construindo um “ground truth” preciso para a desordem

Um passo-chave foi indicar à rede exatamente quais pixels eram pelo ou outro tipo de ruído e quais pertenciam à lesão ou à pele circundante. Especialistas em dermatologia desenharam manualmente máscaras detalhadas em imagens representativas, traçando pelos finos, marcas de régua, pontos de brilho e sombras, evitando estruturas importantes da lesão. Ferramentas clássicas de processamento de imagem foram então usadas para gerar máscaras provisórias para muitas outras imagens, que os especialistas revisaram e corrigiram. Todas as imagens e máscaras foram redimensionadas para um formato padrão para que a rede pudesse aprender padrões consistentes. Durante o treinamento, uma função de perda ajustada recompensou o modelo tanto por contornar com precisão os artefatos quanto por evitar danos acidentais aos detalhes da lesão, especialmente estruturas muito finas ou pequenas.

Imagens mais nítidas e melhor detecção do câncer

Uma vez treinado, o sistema foi testado em imagens não vistas anteriormente. As métricas de qualidade da imagem melhoraram de forma marcante: as imagens limpas ficaram mais semelhantes às imagens de referência ideais e sua estrutura foi melhor preservada. A rede também aprendeu a marcar pelos e outros artefatos com alta precisão, mesmo quando eram densos ou irregulares. Para verificar se isso tinha impacto clínico, os autores alimentaram tanto as imagens originais quanto as limpas em um classificador de melanoma já existente. Com as entradas limpas, a acurácia desse classificador subiu de cerca de 84% para aproximadamente 90–92%, e uma medida-chave de equilíbrio de desempenho (a pontuação F1) melhorou em quase 10 pontos percentuais. A confiança do modelo em suas decisões também aumentou, especialmente em casos difíceis onde a desordem anteriormente obscurecia as bordas das lesões.

O que isso significa para futuros exames de pele

Este trabalho demonstra que remover pelos e outras desordens visuais não é apenas edição cosmética, mas um primeiro passo crucial para um diagnóstico assistido por computador confiável do câncer de pele. Ao incorporar uma rede de remoção de artefatos antes de classificadores existentes, clínicas e serviços de telemedicina poderiam obter imagens dermatoscópicas mais claras e padronizadas em tempo real, sem acrescentar trabalho aos médicos. A abordagem ainda precisa ser testada em uma variedade ainda maior de tons de pele, câmeras e ambientes clínicos, mas oferece um caminho prático rumo a um rastreamento de melanoma assistido por IA mais confiável e, em última instância, ao tratamento mais precoce dos pacientes.

Citação: Hammouda, N.G., Shalaby, M., Alfilh, R.H.C. et al. Hair and artifact removal in dermoscopic images using deep learning for enhanced skin cancer detection. Sci Rep 16, 14452 (2026). https://doi.org/10.1038/s41598-026-44545-x

Palavras-chave: melanoma, dermoscopia, aprendizado profundo, pré-processamento de imagens, detecção de câncer de pele