Clear Sky Science · fr

Suppression des cheveux et des artefacts dans les images dermoscopiques par apprentissage profond pour améliorer la détection du cancer de la peau

Des images de peau plus nettes pour sauver des vies

Repérer précocement les cancers cutanés dangereux peut faire la différence entre une simple intervention ambulatoire et une maladie mettant la vie en danger. Les médecins s'appuient de plus en plus sur des photographies en gros plan de la peau, appelées images dermoscopiques, pour distinguer des motifs de couleur et des contours subtils dans les grains de beauté. Mais dans la pratique, ces images sont souvent encombrées par des poils, des reflets lumineux et des ombres. Cette étude montre comment un système d'intelligence artificielle moderne peut automatiquement « nettoyer » ces images, en supprimant le bruit visuel tout en préservant les détails fins dont les médecins et les logiciels de diagnostic ont besoin pour détecter le mélanome plus tôt.

Le problème des photos de peau encombrées

Bien que le mélanome soit moins fréquent que d'autres cancers cutanés, il est beaucoup plus meurtrier, ce qui rend le diagnostic précoce et précis crucial. La dermoscopie permet aux cliniciens de voir des structures sous la surface de la peau, mais les images sont rarement parfaites. Des poils traversant le champ, un éclairage inégal et des reflets de la peau ou de l'objectif peuvent estomper les contours des lésions et masquer les motifs de pigmentation. Les méthodes traditionnelles de nettoyage reposent sur des règles et des filtres conçus à la main. Elles fonctionnent souvent uniquement pour des types de poils ou d'éclairage spécifiques et peuvent effacer par inadvertance des parties de la lésion elle‑même. Parallèlement, de nombreux systèmes d'aide au diagnostic du cancer de la peau supposent tacitement que les images d'entrée sont déjà nettoyées, ce qui est rarement le cas dans des cliniques surchargées.

Apprendre à un réseau ce qu'il faut enlever et ce qu'il faut garder

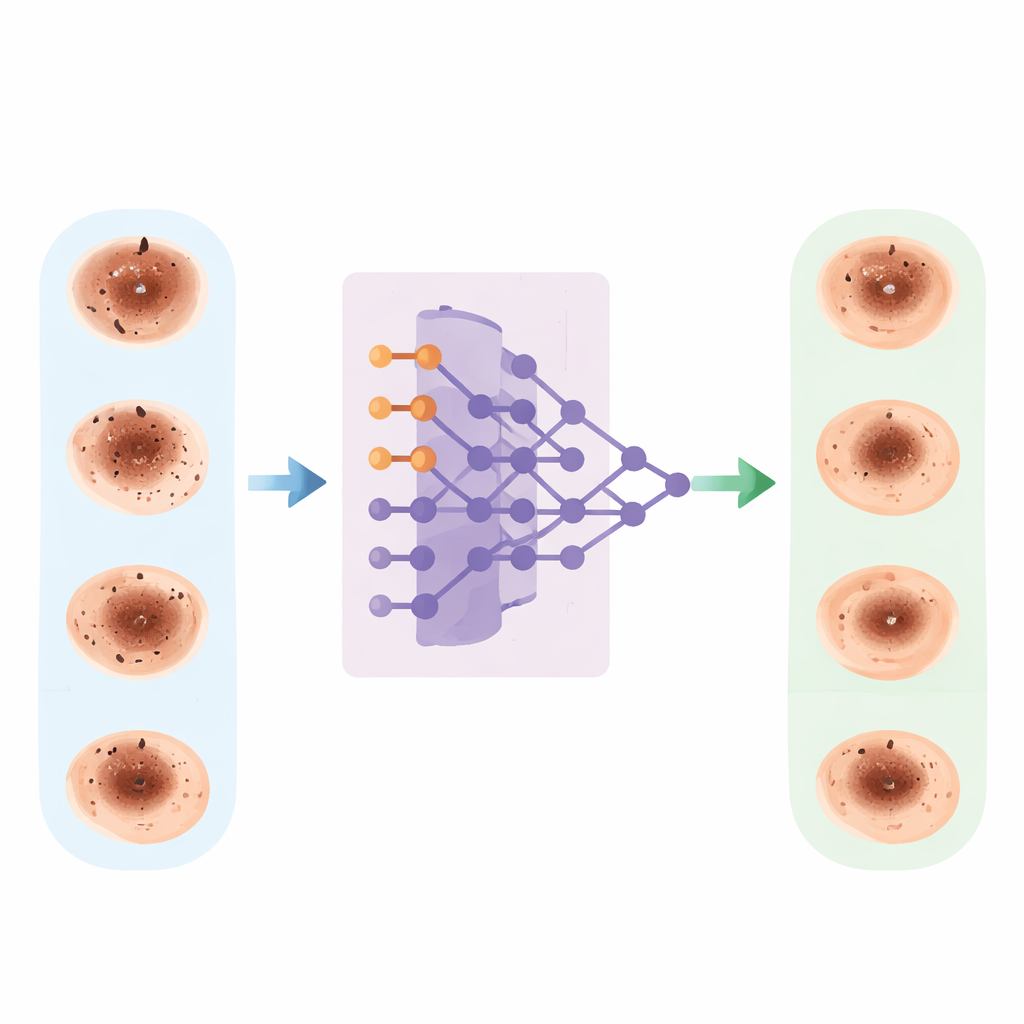

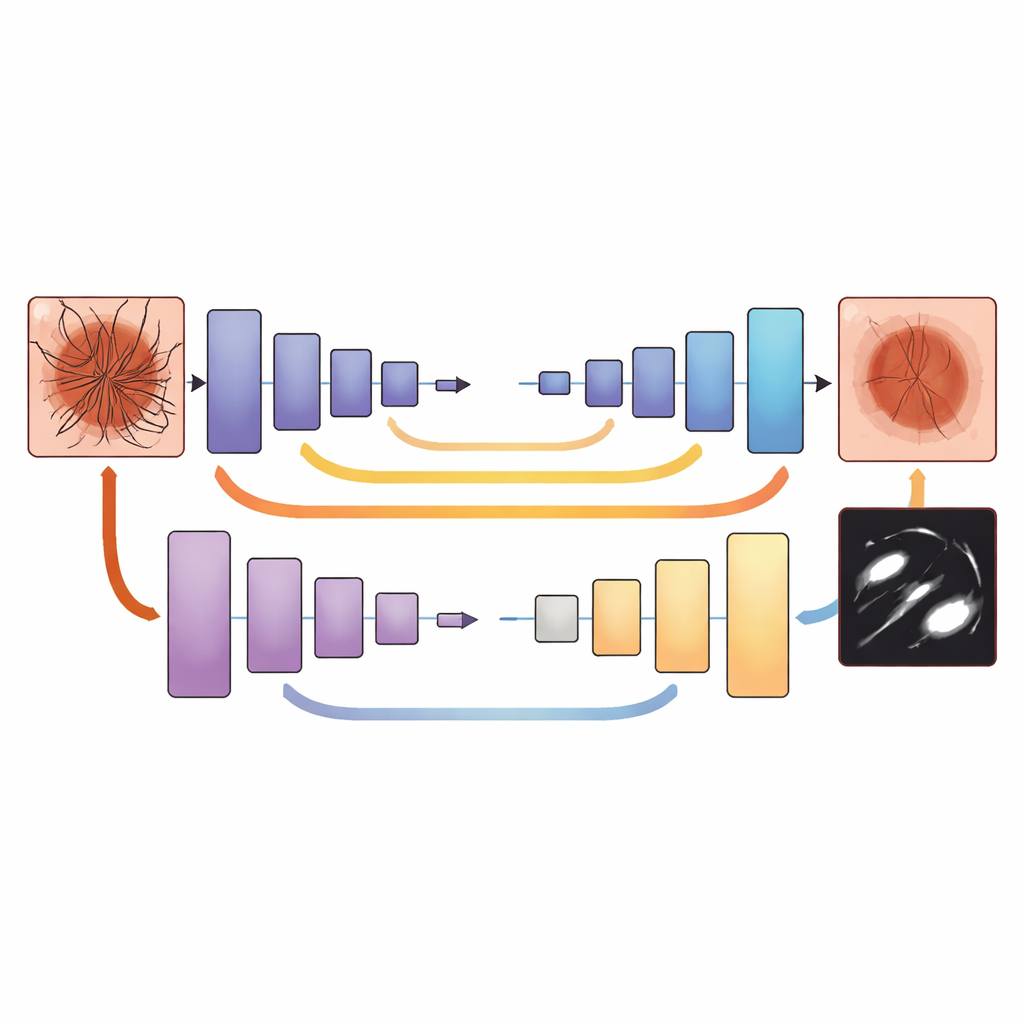

Les chercheurs ont abordé ce problème en entraînant un modèle d'apprentissage profond connu sous le nom de U‑Net pour séparer les artefacts indésirables de la lésion cutanée réelle au niveau des pixels. Ils ont utilisé deux grandes collections d'images de grains de beauté et d'autres anomalies cutanées accessibles au public, couvrant au total plus de 20 000 images dermoscopiques contenant des lésions bénignes et cancéreuses. Chaque image a été soigneusement prétraitée : les couleurs ont été normalisées pour rendre comparables des photos prises avec différents appareils ou éclairages, et le jeu de données a été étendu par des versions retournées, pivotées et légèrement recolorisées afin de reproduire la variété observée en pratique réelle.

Construire une « vérité terrain » précise pour le bruit

Une étape clé a consisté à indiquer au réseau précisément quels pixels représentaient des poils ou d'autres éléments indésirables et lesquels appartenaient à la lésion ou à la peau environnante. Des experts en dermatologie ont dessiné manuellement des masques détaillés sur des images représentatives, retraçant les poils fins, les marques de règle, les zones de reflets et les ombres tout en évitant les structures importantes de la lésion. Des outils classiques de traitement d'image ont ensuite été utilisés pour générer des masques provisoires pour de nombreuses autres images, que les experts ont relus et corrigés. Toutes les images et tous les masques ont été redimensionnés dans un format standard afin que le réseau puisse apprendre des motifs cohérents. Lors de l'entraînement, une fonction de perte adaptée récompensait le modèle à la fois pour le traçage précis des artefacts et pour l'évitement des dommages accidentels aux détails de la lésion, en particulier aux structures très fines ou de petite taille.

Des images plus nettes et une meilleure détection du cancer

Une fois entraîné, le système a été testé sur des images inédites. Les mesures de qualité d'image se sont nettement améliorées : les images nettoyées ressemblaient davantage aux images de référence idéales et leur structure était mieux préservée. Le réseau a également appris à repérer les poils et autres artefacts avec une grande précision, même lorsqu'ils étaient denses ou irréguliers. Pour évaluer l'impact clinique, les auteurs ont alimenté à la fois les images originales et les images nettoyées dans un outil existant de détection du mélanome. Avec les images nettoyées, la précision de ce classifieur est passée d'environ 84 % à environ 90–92 %, et une mesure clé d'équilibre de la performance (le score F1) s'est améliorée de près de 10 points de pourcentage. La confiance du modèle dans ses décisions a également augmenté, en particulier dans les cas difficiles où le bruit masquait auparavant les contours des lésions.

Ce que cela signifie pour les futurs examens de la peau

Ce travail démontre que la suppression des poils et d'autres éléments visuels n'est pas seulement une retouche cosmétique, mais une étape cruciale pour un diagnostic assisté par ordinateur fiable du cancer de la peau. En intégrant un réseau de suppression d'artefacts en amont des classifieurs existants, les cliniques et les services de télémédecine pourraient obtenir en temps réel des images dermoscopiques plus nettes et mieux standardisées, sans ajouter de travail aux médecins. L'approche doit encore être testée sur des teints de peau, des appareils photo et des environnements cliniques encore plus variés, mais elle offre une voie pratique vers un dépistage du mélanome assisté par IA plus fiable et, en fin de compte, un traitement plus précoce pour les patients.

Citation: Hammouda, N.G., Shalaby, M., Alfilh, R.H.C. et al. Hair and artifact removal in dermoscopic images using deep learning for enhanced skin cancer detection. Sci Rep 16, 14452 (2026). https://doi.org/10.1038/s41598-026-44545-x

Mots-clés: mélanome, dermoscopie, apprentissage profond, prétraitement d'image, détection du cancer de la peau