Clear Sky Science · nl

Verwijderen van haren en artefacten in dermoscopische beelden met deep learning voor verbeterde huidkankerdetectie

Helderdere huidbeelden om levens te redden

Het vroegtijdig herkennen van gevaarlijke huidkankers kan het verschil betekenen tussen een eenvoudige poliklinische ingreep en een levensbedreigende ziekte. Artsen vertrouwen steeds vaker op close‑up huidfoto’s, zogenaamde dermoscopische beelden, om subtiele kleurpatronen en randen van moedervlekken te zien. In de praktijk zijn deze foto’s echter vaak verstrooid met haren, lichtreflecties en schaduwen. Deze studie laat zien hoe een modern kunstmatig‑intelligentiesysteem die beelden automatisch kan “schoonmaken”, visuele rommel kan verwijderen en tegelijkertijd de fijne details behoudt die artsen en diagnostische software nodig hebben om melanoom eerder te ontdekken.

Het probleem van rommelige huidfoto’s

Hoewel melanoom minder vaak voorkomt dan andere huidkankers, is het veel dodelijker, waardoor vroege en nauwkeurige diagnose cruciaal is. Dermoscopie stelt clinici in staat structuren onder het huidoppervlak te zien, maar de beelden zijn zelden ongerept. Haren die het gezichtsveld kruisen, ongelijkmatige belichting en reflecties van de huid of cameralens kunnen laesiergrenzen vervagen en pigmentpatronen verbergen. Traditionele schoonmaakmethoden zijn gebaseerd op handgemaakte regels en filters. Die werken vaak alleen bij specifieke typen haren of belichting en kunnen per ongeluk delen van de laesie zelf wissen. Tegelijkertijd gaan veel computerondersteunde systemen voor huidkanker stilzwijgend uit van schone invoerbeelden, wat in drukke klinieken zelden het geval is.

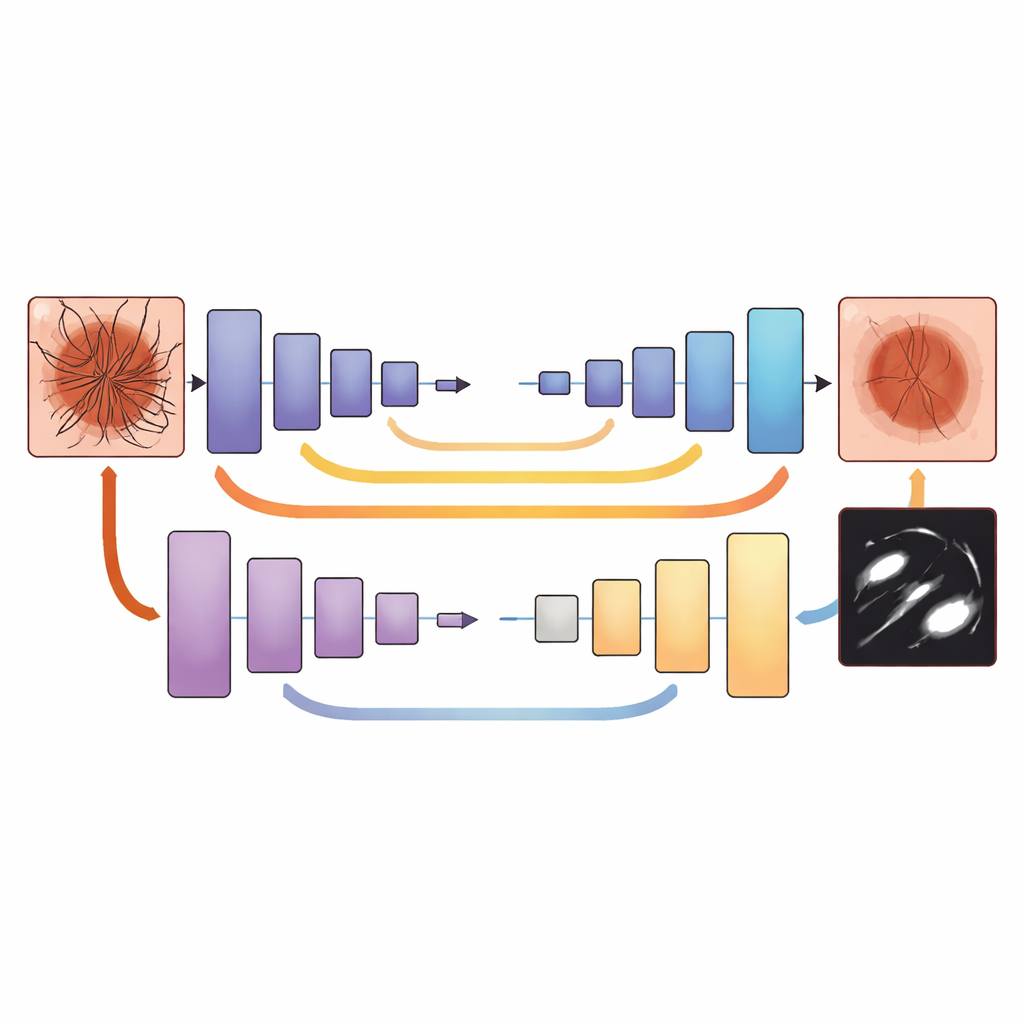

Een netwerk leren wat te verwijderen en wat te behouden

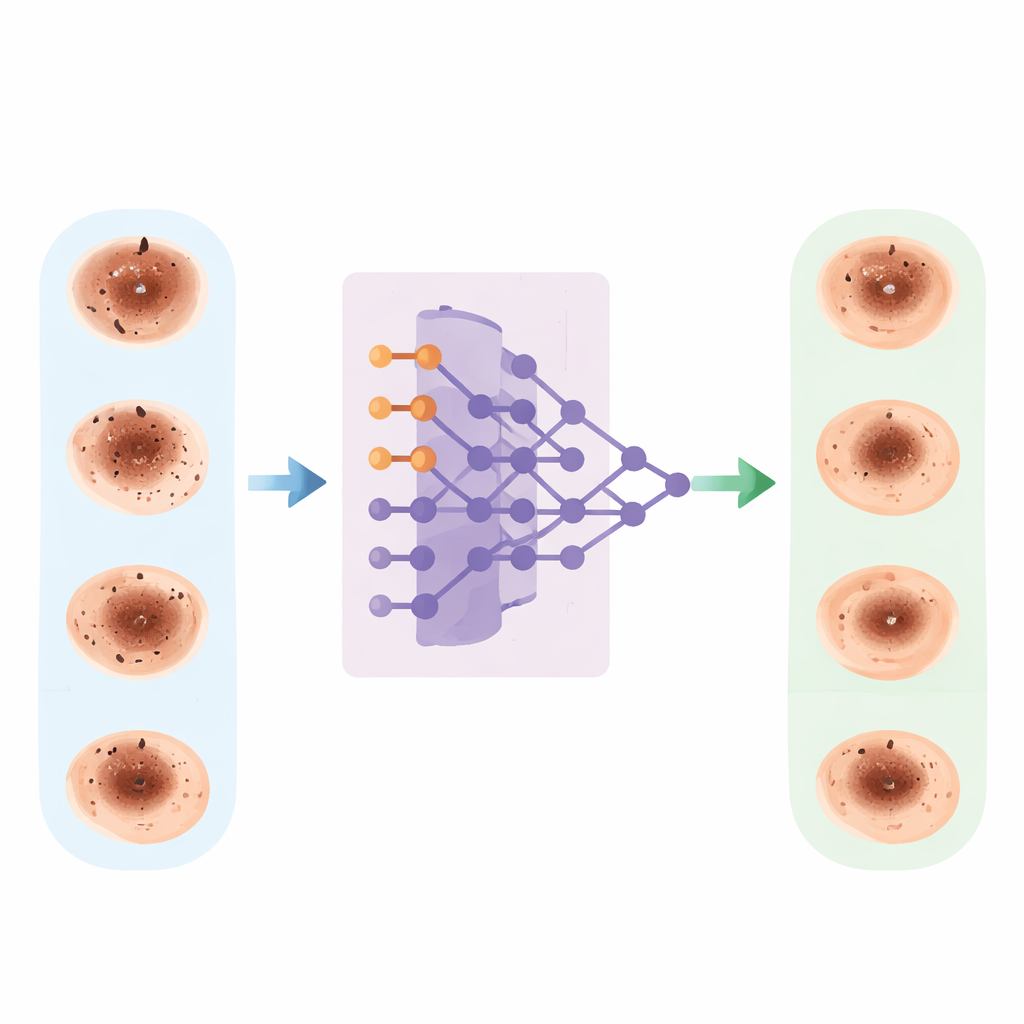

De onderzoekers pakten dit probleem aan door een deep learning‑model, bekend als U‑Net, te trainen om ongewenste artefacten te scheiden van de werkelijke huidlaesie op pixelniveau. Ze gebruikten twee grote, openbaar beschikbare beeldcollecties van moedervlekken en andere huidvlekken, die samen meer dan 20.000 dermoscopische beelden van zowel goedaardige als kwaadaardige laesies beslaan. Elk beeld werd zorgvuldig voorbewerkt: kleuren werden genormaliseerd zodat foto’s gemaakt met verschillende camera’s of belichting beter vergelijkbaar werden, en de dataset werd uitgebreid met gespiegeld, geroteerde en licht herkleurd versies om de variatie uit de praktijk na te bootsen.

Precies “grondwaarheid” bouwen voor rommel

Een cruciale stap was het netwerk precies vertellen welke pixels haar of andere rommel waren en welke bij de laesie of de omliggende huid hoorden. Dermatologie‑experts tekenden handmatig gedetailleerde maskers op representatieve beelden, waarbij ze dunne haren, liniaalmarkeringen, schitteringsvlekken en schaduwen traceerden en tegelijkertijd belangrijke laesiestructuren ontweken. Klassieke beeldverwerkingstools werden vervolgens gebruikt om conceptmaskers voor veel meer beelden te genereren, die de experts beoordeelden en corrigeerden. Alle beelden en maskers werden naar een standaardformaat geschaald zodat het netwerk consistente patronen kon leren. Tijdens de training beloonde een op maat gemaakte verliesfunctie het model zowel voor het nauwkeurig omlijnen van artefacten als voor het vermijden van per ongeluk beschadigen van laesiedetails, met name zeer dunne of kleine structuren.

Scherpere beelden en betere kankerdetectie

Eenmaal getraind, werd het systeem getest op niet eerder geziene beelden. Maatstaven voor beeldkwaliteit verbeterden aanzienlijk: de schoongemaakte beelden leken meer op ideale referentiebeelden en hun structuur bleef beter behouden. Het netwerk leerde ook haren en andere artefacten met hoge precisie te markeren, zelfs wanneer die dicht of onregelmatig waren. Om te beoordelen of dit klinisch relevant was, voerden de auteurs zowel de originele als de schoongemaakte beelden in een bestaand AI‑systeem voor melanoomdetectie. Met schoongemaakte invoer steeg de nauwkeurigheid van die classifier van ongeveer 84% naar circa 90–92%, en een belangrijke evenwichtsmaat voor prestaties (de F1‑score) verbeterde met bijna 10 procentpunten. De zekerheid van het model in zijn beslissingen nam ook toe, vooral in moeilijke gevallen waar rommel eerder laesiergrenzen verhulde.

Wat dit betekent voor toekomstige huidcontroles

Dit werk toont aan dat het verwijderen van haren en andere visuele rommel niet slechts cosmetische bewerking is, maar een cruciale eerste stap voor betrouwbare computerondersteunde diagnose van huidkanker. Door een artefactverwijderings‑netwerk voor bestaande classifiers te plaatsen, zouden klinieken en telezorgdiensten in realtime helderdere, meer gestandaardiseerde dermoscopische beelden kunnen verkrijgen, zonder extra werk voor artsen. De aanpak moet nog wel worden getest op nog diversere huidskleuren, camera’s en klinische omgevingen, maar biedt een praktisch pad naar betrouwbaarder AI‑ondersteund melanoomscreening en uiteindelijk vroegere behandeling voor patiënten.

Bronvermelding: Hammouda, N.G., Shalaby, M., Alfilh, R.H.C. et al. Hair and artifact removal in dermoscopic images using deep learning for enhanced skin cancer detection. Sci Rep 16, 14452 (2026). https://doi.org/10.1038/s41598-026-44545-x

Trefwoorden: melanoom, dermoscopie, deep learning, beeldvoorbewerking, detectie van huidkanker