Clear Sky Science · de

Entfernung von Haaren und Artefakten in dermoskopischen Bildern mittels Deep Learning zur verbesserten Hautkrebserkennung

Deutlichere Hautbilder, die Leben retten können

Das frühzeitige Erkennen gefährlicher Hautkrebserkrankungen kann den Unterschied zwischen einem einfachen ambulanten Eingriff und einer lebensbedrohlichen Erkrankung ausmachen. Ärztinnen und Ärzte verlassen sich zunehmend auf Aufnahmen aus nächster Nähe, sogenannte dermoskopische Bilder, um subtile Farbverläufe und Begrenzungen in Muttermalen zu erkennen. In der Praxis sind diese Aufnahmen jedoch oft mit Haaren, Blendlicht und Schatten beeinträchtigt. Diese Studie zeigt, wie ein modernes KI‑System solche Bilder automatisch „säubern“ kann, indem es visuelle Störelemente entfernt und gleichzeitig die feinen Details erhält, die Ärztinnen, Ärzte und diagnostische Software benötigen, um ein Melanom früher zu erfassen.

Das Problem unordentlicher Hautfotos

Obwohl Melanome seltener sind als andere Hautkrebserkrankungen, sind sie deutlich tödlicher, weshalb frühe und genaue Diagnosen entscheidend sind. Die Dermoskopie erlaubt es, Strukturen unterhalb der Hautoberfläche sichtbar zu machen, doch die Bilder sind selten makellos. Haare, die das Sichtfeld kreuzen, ungleichmäßige Beleuchtung und Reflexionen von Haut oder Objektiv können die Ränder von Läsionen verwischen und Pigmentmuster verbergen. Traditionelle Reinigungsverfahren beruhen auf handgefertigten Regeln und Filtern. Sie funktionieren oft nur bei bestimmten Haartypen oder Beleuchtungssituationen und können versehentlich Teile der Läsion entfernen. Gleichzeitig gehen viele computergestützte Hautkrebssysteme stillschweigend davon aus, dass die Eingabebilder bereits sauber sind — was in überfüllten Kliniken selten der Fall ist.

Ein Netzwerk lehren, was entfernt und was erhalten werden soll

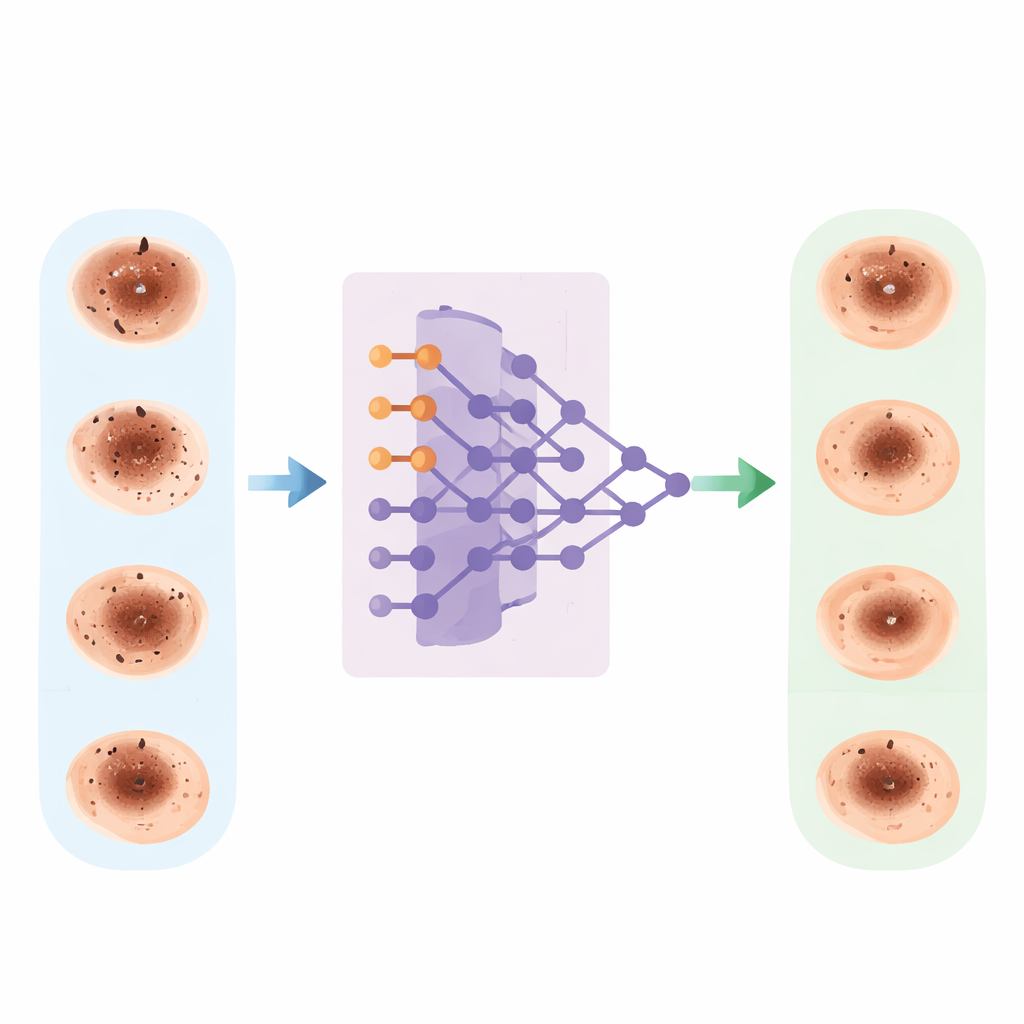

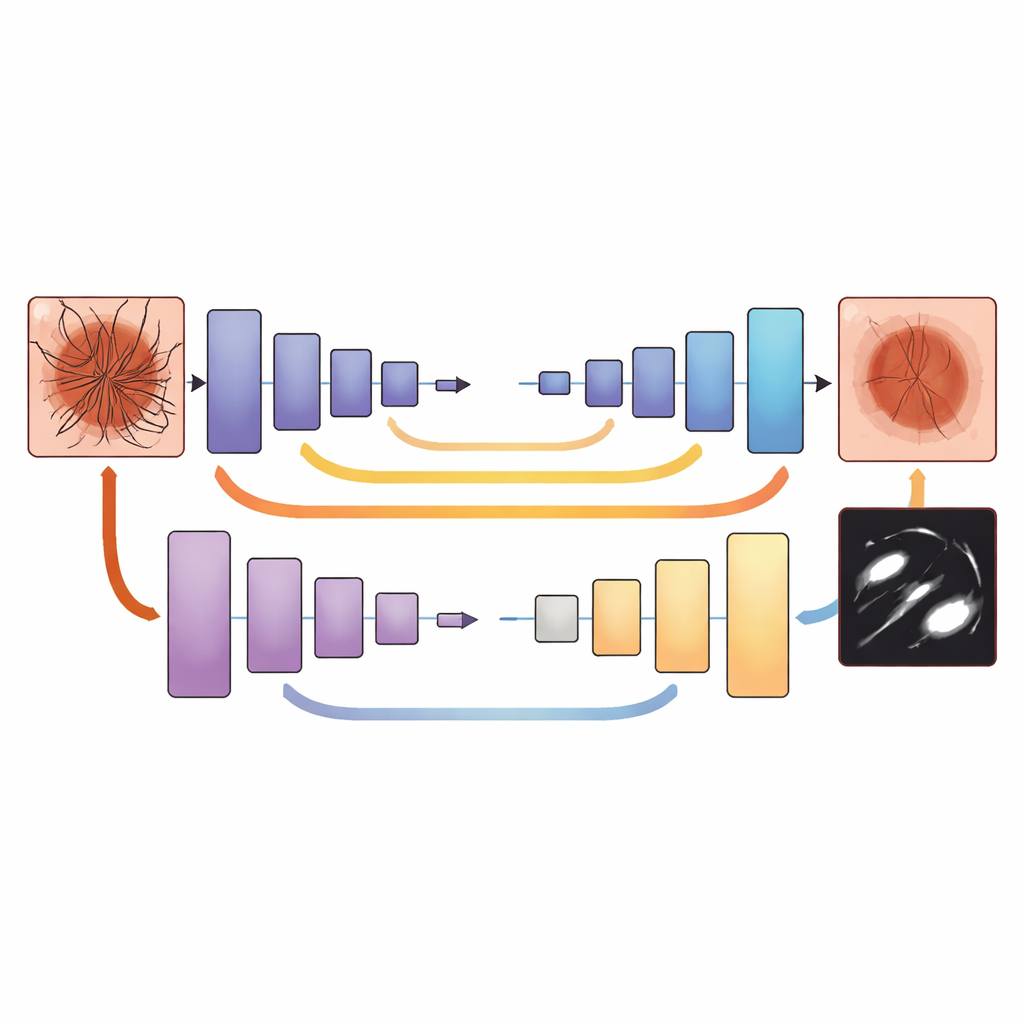

Die Forschenden gingen das Problem an, indem sie ein Deep‑Learning‑Modell vom Typ U‑Net trainierten, um unerwünschte Artefakte von der tatsächlichen Hautläsion auf Pixelebene zu trennen. Sie nutzten zwei große, öffentlich verfügbare Bildsammlungen von Muttermalen und anderen Hautveränderungen, die zusammen mehr als 20.000 dermoskopische Bilder mit benignen und bösartigen Läsionen abdeckten. Jedes Bild wurde sorgfältig vorverarbeitet: Farben wurden normalisiert, sodass Aufnahmen mit unterschiedlichen Kameras oder Beleuchtungen vergleichbarer wurden, und der Datensatz wurde durch horizontale/vertikale Spiegelungen, Rotation und leichte Farbveränderungen erweitert, um die in der Praxis auftretende Vielfalt zu simulieren.

Präzises „Ground Truth“ für Störelemente erstellen

Ein zentraler Schritt bestand darin, dem Netzwerk genau zu zeigen, welche Pixel Haare oder andere Störelemente waren und welche zur Läsion oder zur umgebenden Haut gehörten. Dermatologische Expertinnen und Experten zeichneten manuell detaillierte Masken auf repräsentativen Bildern, zeichneten dünne Haare, Linealmarkierungen, Blendflecken und Schatten nach und vermieden dabei wichtige Läsionsstrukturen. Klassische Bildverarbeitungstools wurden dann verwendet, um Entwurfsmasken für viele weitere Bilder zu erzeugen, die die Expertinnen und Experten überprüften und korrigierten. Alle Bilder und Masken wurden auf ein Standardformat skaliert, damit das Netzwerk konsistente Muster lernen konnte. Während des Trainings belohnte eine maßgeschneiderte Verlustfunktion das Modell sowohl dafür, Artefakte genau zu umreißen, als auch dafür, unbeabsichtigte Schäden an Läsionsdetails zu vermeiden — besonders bei sehr feinen oder kleinen Strukturen.

Scharfere Bilder und bessere Krebsdetektion

Nach dem Training wurde das System an unbekannten Bildern getestet. Maßzahlen für die Bildqualität verbesserten sich deutlich: Die bereinigten Bilder glichen idealen Referenzbildern stärker, und deren Struktur blieb besser erhalten. Das Netzwerk lernte außerdem, Haare und andere Artefakte mit hoher Präzision zu markieren, selbst wenn diese dicht oder unregelmäßig waren. Um zu prüfen, ob das klinisch relevant ist, fütterten die Autorinnen und Autoren sowohl die Original- als auch die bereinigten Bilder in einen bestehenden Melanom‑Erkennungs‑KI‑Klassifikator. Mit bereinigten Eingaben stieg die Genauigkeit dieses Klassifikators von etwa 84 % auf rund 90–92 %, und ein wichtiges Leistungsmaß (der F1‑Score) verbesserte sich um nahezu 10 Prozentpunkte. Auch das Vertrauen des Modells in seine Entscheidungen nahm zu, insbesondere in schwierigen Fällen, in denen Störelemente zuvor Läsionsränder verschleiert hatten.

Was das für zukünftige Hautuntersuchungen bedeutet

Die Arbeit zeigt, dass das Entfernen von Haaren und anderem visuellen Störmaterial keine bloße kosmetische Nachbearbeitung ist, sondern ein entscheidender erster Schritt für verlässliche computergestützte Hautkrebserkennung. Indem ein Artefakt‑Entfernungsnetzwerk vor bestehende Klassifikatoren geschaltet wird, könnten Kliniken und Telemedizin‑Dienste in Echtzeit klarere, standardisiertere dermoskopische Bilder erhalten, ohne zusätzlichen Aufwand für Ärztinnen und Ärzte. Der Ansatz muss noch an noch vielfältigeren Hauttönen, Kameras und Klinikumgebungen getestet werden, bietet jedoch einen praktikablen Weg zu verlässlicherem KI‑gestütztem Melanom‑Screening und letztlich zu früheren Behandlungen für Patientinnen und Patienten.

Zitation: Hammouda, N.G., Shalaby, M., Alfilh, R.H.C. et al. Hair and artifact removal in dermoscopic images using deep learning for enhanced skin cancer detection. Sci Rep 16, 14452 (2026). https://doi.org/10.1038/s41598-026-44545-x

Schlüsselwörter: Melanom, Dermoskopie, Deep Learning, Bildvorverarbeitung, Hautkrebserkennung