Clear Sky Science · sv

AI‑driven RF‑datalagring för bröstultraljud: effektivitet i kvantitativ ultraljudskaraktärisering av vävnad

Varför detta är viktigt för bröstcancervård

Bröstcancerscreening förlitar sig ofta på ultraljudsbilder som ser ut som korniga svartvita moln. Dolda bakom dessa bilder finns rika råsignaler som skulle kunna avslöja mycket mer om en knöl är ofarlig eller farlig, men dessa signaler slängs vanligtvis bort eftersom de är för stora att lagra. I denna studie undersöks om artificiell intelligens kan återskapa dessa förlorade signaler från vanliga ultraljudsbilder, vilket öppnar möjligheten till mer exakt och prisvärd bedömning av bröstcancer utan att byta de skannrar som redan används i kliniker.

Från enkla bilder till dolda signaldetaljer

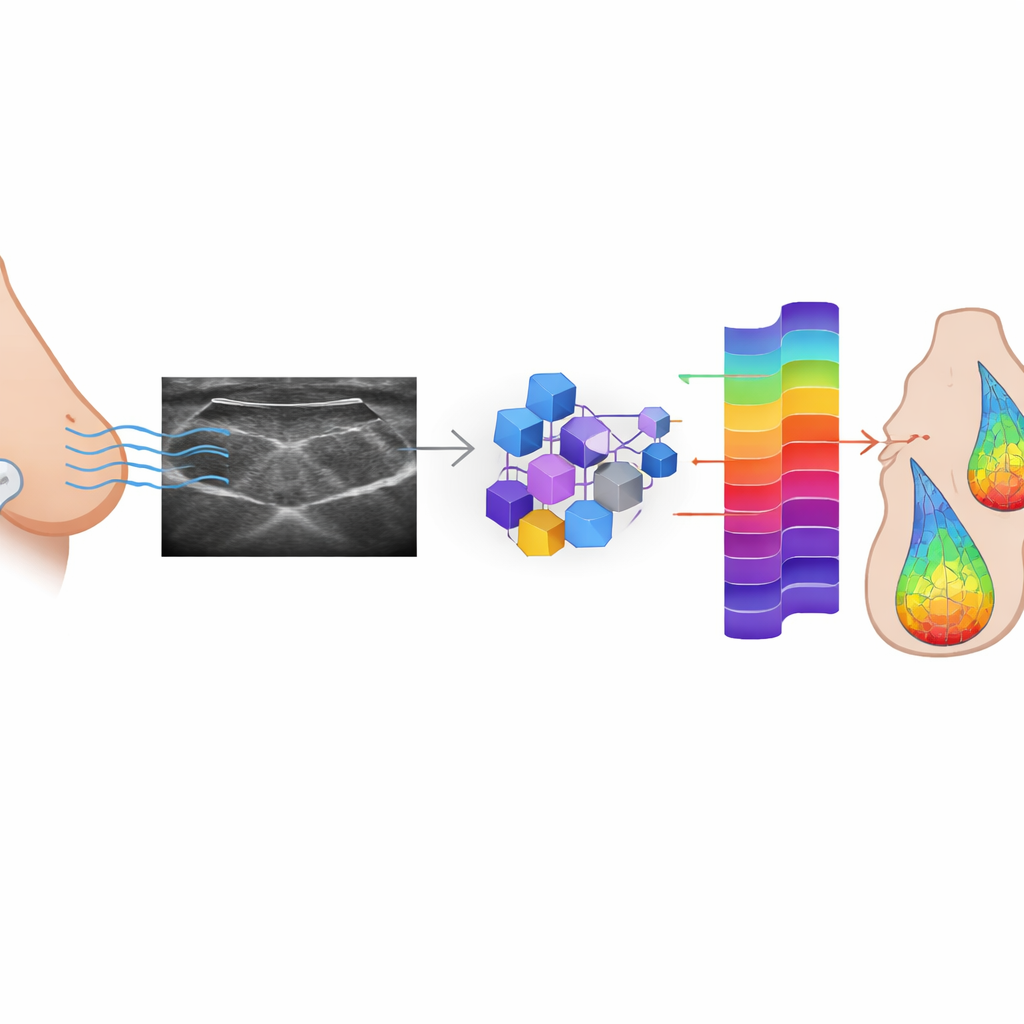

Dagens bröstultraljudsundersökningar använder vanligen så kallade B‑mode‑bilder: gråskaleporträtt som visar vävnadens form och övergripande ljusstyrka. Innan dessa bilder visas på skärmen spelar maskinen först in råa ekosignaler, kända som radiofrekvens‑(RF‑)data. Kvantitativa ultraljudsmetoder (QUS) kan analysera dessa råsignaler för att uppskatta egenskaper relaterade till storlek, ordning och koncentration av små strukturer i vävnaden. Tidigare forskning har visat att sådana kvantitativa kartor kan hjälpa till att skilja godartade från maligna lesioner och till och med följa hur tumörer svarar på kemoterapi. Problemet är att RF‑data är enorma, svåra att lagra och överföra, och ofta otillgängliga i kommersiella skannrar, vilket har hållit QUS till stor del inom forskningslaboratorier.

Lära AI att bygga upp de förlorade signalerna igen

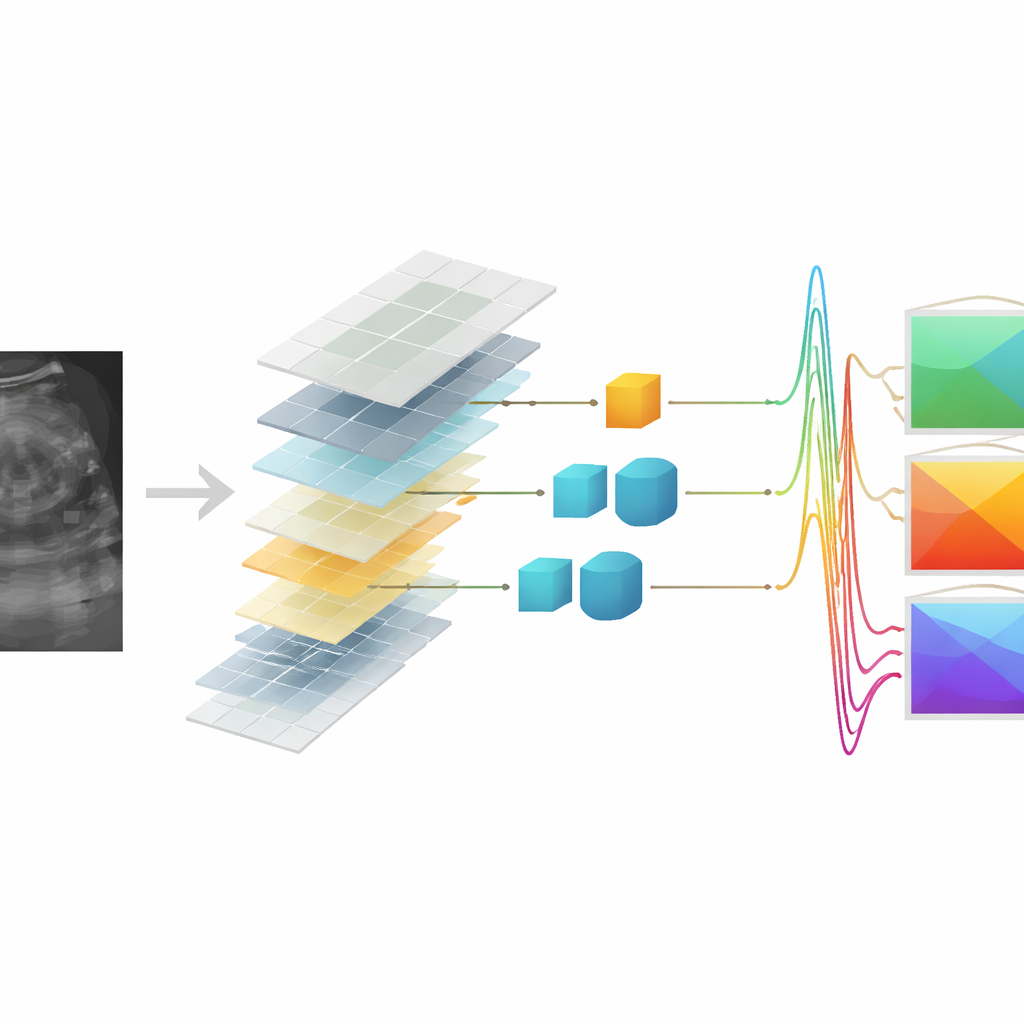

Forskarna ville se om AI kunde lära sig rekonstruera RF‑data från de B‑mode‑bilder som rutinmässigt sparas. De tränade tre typer av villkorade generativa adversariella nätverk (cGAN)—en etablerad Pix2Pix‑modell och två varianter baserade på vision‑transformers (en grund, en djupare)—på en stor datamängd av parade RF‑ och B‑mode‑rutor från 152 patienter med suspekta bröstlesioner. I denna adversariella uppställning försöker ett generatornätverk skapa realistiska RF‑signaler från varje B‑mode‑bild, samtidigt som ett diskriminatornätverk lär sig skilja verkliga från syntetiska signaler. Med tiden förbättras generatorn tills dess utsignaler blir svåra att skilja från originalen. Modellerna finjusterades inte bara för att lura diskriminatorn utan också för att hålla varje genererad RF‑ruta numeriskt nära sin verkliga motsvarighet.

Sätta syntetiska signaler på prov

För att bedöma hur väl de AI‑genererade RF‑datan matchade originalen använde teamet flera bildkvalitetsmått och ställde sedan en tuffare fråga: kan de syntetiserade signalerna stödja samma typ av lesionkaraktärisering som verkliga RF‑data? På en avskiljd testmängd med tusentals rutor producerade alla tre modeller syntetiska RF som var strukturellt mycket lika de verkliga signalerna och ledde till B‑mode‑rekonstruktioner som noggrant bevarade lesionens form och ultraljudets korniga utseende. Den mest kraftfulla modellen, den djupa transformer‑cGAN, nådde bäst total trohet. När QUS‑kartor beräknades från den syntetiska RF‑datan liknade deras numeriska värden och fördelningsmönster starkt de som härstammade från originalsignalerna, vilket tyder på att nyckelinformation om vävnaden bevarats.

Kan syntetiska data fortfarande upptäcka cancer?

Det avgörande testet var om dessa syntetiskt baserade QUS‑kartor kunde hjälpa till att skilja godartade från maligna bröstlesioner. Författarna byggde en klassificeringspipeline som först valde de mest informativa QUS‑egenskaperna och sedan tränade en support vector machine för att separera de två grupperna. Med endast egenskaper från verkliga RF‑data klassificerade systemet lesioner korrekt med cirka 82 % noggrannhet. Anmärkningsvärt nog uppnådde de djupa transformer‑ och Pix2Pix‑modellerna cirka 81 % noggrannhet när de tränades och testades enbart på QUS‑egenskaper härledda från syntetisk RF, vilket i praktiken matchade originalprestandan inom statistisk variation. I vissa scenarier överträffade den djupa transformer‑modellen till och med något referensvärdet när syntetiska egenskaper användes för testning mot en klassificerare tränad på realdata‑egenskaper, vilket understryker den inlärda mappningens robusthet.

Framtiden för smartare skanningar

Den här studien visar att AI effektivt kan "fylla i" de saknade råa ultraljudssignalerna från standardbilder samtidigt som de viktigaste kvantitativa ledtrådarna som hjälper till att skilja ofarliga från farliga bröstlesioner bevaras. I praktiken skulle ett sjukhus en dag kunna köra QUS‑analyser direkt från rutinmässiga B‑mode‑data utan att behöva spela in eller lagra massiva RF‑dataset på varje skanner. Studien är ett tidigt proof‑of‑concept, begränsat till en typ av ultraljudssystem och fokuserat på bröstlesioner, men den pekar mot en framtid där befintliga ultraljudsmaskiner kan förbättras via mjukvara för att ge djupare, mer objektiv insikt i vävnadens hälsa—vilket potentiellt kan förbättra cancerdiagnostik och behandlingsbeslut utan att lägga till ny hårdvara eller invasiva procedurer.

Citering: Sheibani-Asl, N., Osapoetra, L.O., Czarnota, G.J. et al. AI-enabled RF data synthesis for breast ultrasound: efficacy in quantitative ultrasound tissue characterization. Sci Rep 16, 12544 (2026). https://doi.org/10.1038/s41598-026-43319-9

Nyckelord: bröstultraljud, artificiell intelligens, kvantitativt ultraljud, medicinsk bildsyntes, cancerdiagnostik