Clear Sky Science · de

KI‑unterstützte RF‑Datensynthese für die Brustultraschallbildgebung: Wirksamkeit bei der quantitativen Ultraschall‑Gewebecharakterisierung

Warum das für die Brustkrebsversorgung wichtig ist

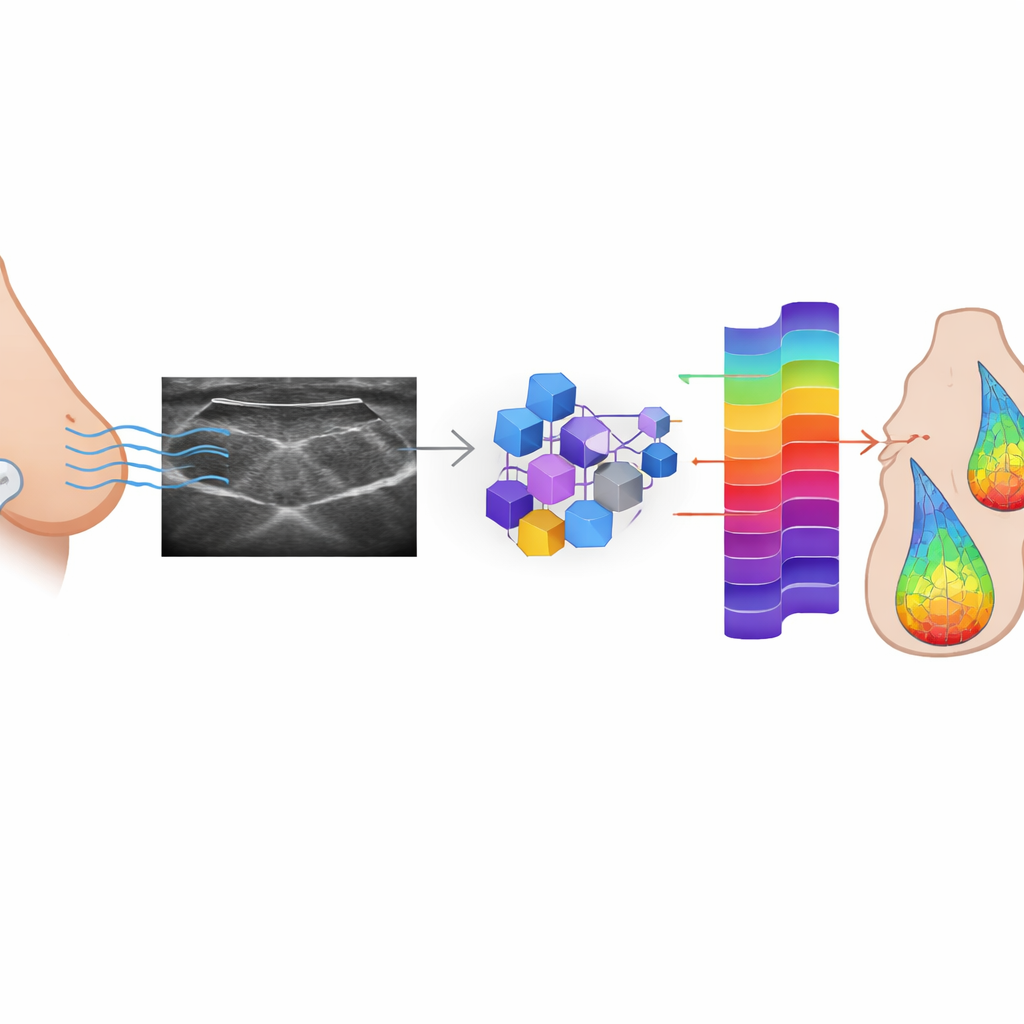

Beim Brustkrebsscreening stützt man sich häufig auf Ultraschallbilder, die wie körnige Schwarz‑weiß‑Wolken aussehen. Hinter diesen Bildern verbergen sich jedoch reichhaltige Rohsignale, die deutlich mehr darüber verraten könnten, ob eine Verhärtung harmlos oder gefährlich ist. Diese Signale werden jedoch meist verworfen, weil sie zu groß zum Speichern sind. In dieser Studie wird untersucht, ob künstliche Intelligenz diese verlorenen Signale aus gewöhnlichen Ultraschallbildern rekonstruieren kann — und damit genauere, kostengünstigere Beurteilungen von Brustknoten ermöglicht, ohne die in Kliniken bereits verwendeten Geräte zu verändern.

Von einfachen Bildern zu verborgenen Signaldetails

Heutige Brustultraschalluntersuchungen verwenden typischerweise sogenannte B‑Mode‑Bilder: Graustufenabschnitte, die Form und Helligkeit des Gewebes abbilden. Bevor diese Bilder auf dem Bildschirm erscheinen, zeichnet das Gerät zunächst die rohen Echosignale auf, bekannt als Radiofrequenz‑(RF‑)Daten. Quantitative Ultraschall‑(QUS‑)Techniken können diese Rohsignale analysieren, um Eigenschaften abzuschätzen, die mit Größe, Anordnung und Konzentration winziger Strukturen im Gewebe zusammenhängen. Frühere Arbeiten haben gezeigt, dass solche quantitativen Karten helfen können, gutartige von bösartigen Läsionen zu unterscheiden und sogar die Reaktion von Tumoren auf Chemotherapie zu verfolgen. Das Problem ist, dass RF‑Daten sehr groß, schwer zu speichern und zu übertragen und auf kommerziellen Geräten oft nicht zugänglich sind, weshalb QUS weitgehend auf Forschungslabore beschränkt blieb.

Der KI beibringen, die verlorenen Signale wiederherzustellen

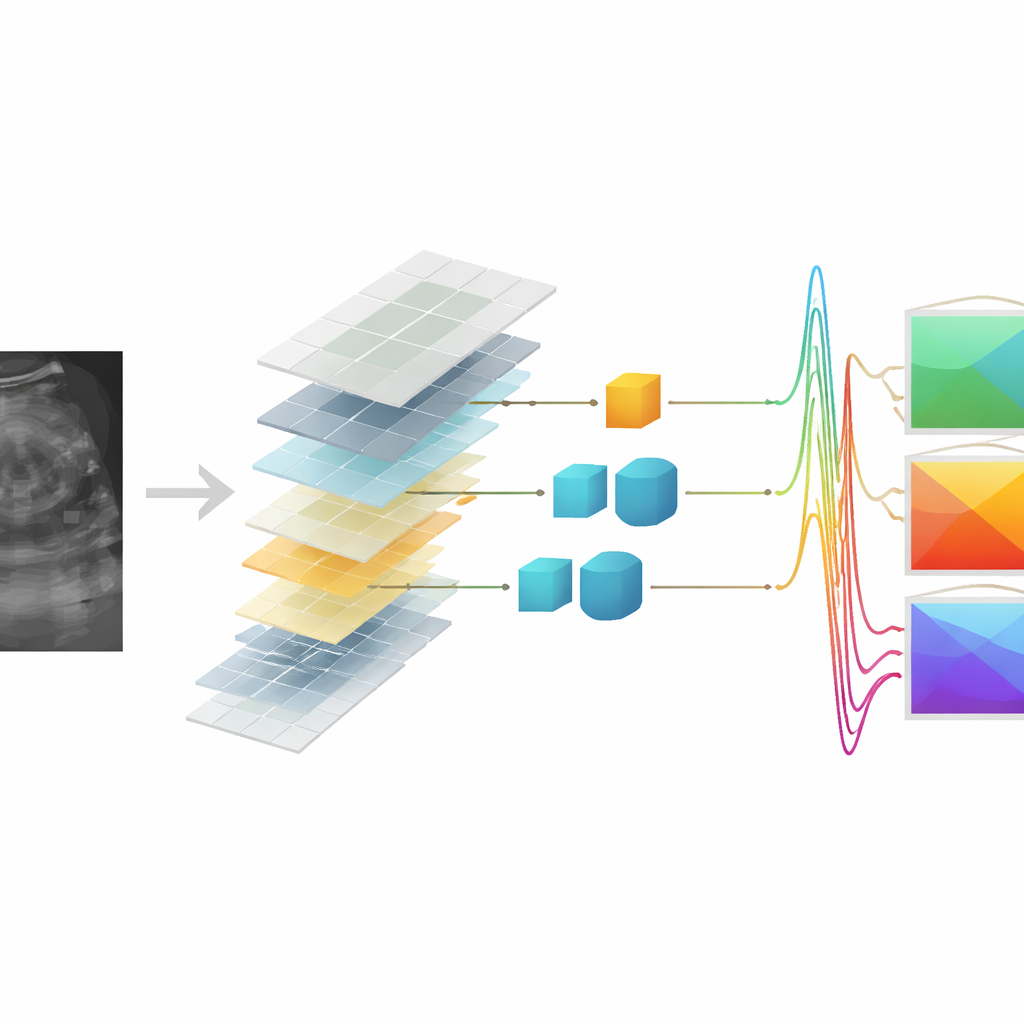

Die Forschenden wollten herausfinden, ob KI lernen kann, RF‑Daten aus den routinemäßig gespeicherten B‑Mode‑Bildern zu rekonstruieren. Sie trainierten drei Arten von bedingten generativen Gegnernetzwerken (cGANs) — ein weit verbreitetes Pix2Pix‑Modell und zwei Versionen auf Basis von Vision‑Transformern (ein flaches, ein tiefes) — auf einem großen Datensatz gepaarter RF‑ und B‑Mode‑Frames von 152 Patientinnen mit suspekten Brustläsionen. In diesem adversarialen Aufbau versucht ein Generatornetzwerk, realistische RF‑Signale aus jedem B‑Mode‑Bild zu erzeugen, während ein Diskriminatornetzwerk lernt, echte von synthetischen Signalen zu unterscheiden. Im Laufe der Zeit verbessert sich der Generator, bis seine Ausgaben schwer von den Originalen zu unterscheiden sind. Die Modelle wurden nicht nur darauf ausgelegt, den Diskriminator zu täuschen, sondern auch jede erzeugte RF‑Frame numerisch nahe an ihrem wahren Gegenstück zu halten.

Die synthetischen Signale auf die Probe stellen

Um zu beurteilen, wie gut die KI‑generierten RF‑Daten mit den Originalen übereinstimmten, verwendete das Team mehrere Bildqualitätsmaße und stellte dann eine härtere Frage: Können die synthetischen Signale dieselbe Art von Läsionscharakterisierung unterstützen wie echte RF‑Daten? Auf einem zurückgehaltenen Testset mit tausenden Frames erzeugten alle drei Modelle synthetische RF‑Signale, die den realen strukturell sehr ähnlich waren und zu B‑Mode‑Rekonstruktionen führten, die Form der Läsion und das körnige Ultraschall‑Erscheinungsbild gut bewahrten. Das leistungsstärkste Modell, das tiefe Transformer‑cGAN, erreichte die beste Gesamttreue. Als aus den synthetischen RF‑Daten QUS‑Karten berechnet wurden, ähnelten deren numerische Werte und Verteilungsmuster stark denen, die aus den Originalsignalen abgeleitet wurden, was darauf hindeutet, dass wichtige Gewebeinformationen erhalten geblieben sind.

Können synthetische Daten trotzdem Krebs erkennen?

Der entscheidende Test war, ob diese auf synthetischen Daten basierenden QUS‑Karten zwischen gutartigen und bösartigen Brustläsionen unterscheiden können. Die Autoren bauten eine Klassifikationspipeline, die zunächst die informativsten QUS‑Merkmale auswählte und dann eine Support‑Vector‑Machine trainierte, um die beiden Gruppen zu trennen. Mit nur Merkmalen aus echten RF‑Daten klassifizierte das System Läsionen mit etwa 82 % Genauigkeit korrekt. Bemerkenswerterweise erreichten, wenn ausschließlich auf QUS‑Merkmalen aus synthetischen RF‑Daten trainiert und getestet wurde, das tiefe Transformer‑ und das Pix2Pix‑Modell etwa 81 % Genauigkeit — im Wesentlichen die ursprüngliche Leistung innerhalb statistischer Schwankungen. In einigen Szenarien übertraf das tiefe Transformer‑Modell sogar leicht die Baseline, wenn synthetische Merkmale zur Prüfung gegen einen auf Realdaten‑Merkmalen trainierten Klassifikator verwendet wurden, was die Robustheit der gelernten Abbildung unterstreicht.

Blick in die Zukunft: intelligentere Untersuchungen

Diese Arbeit zeigt, dass KI die fehlenden rohen Ultraschallsignale aus Standardbildern effektiv „auffüllen“ kann, während sie die wichtigen quantitativen Hinweise bewahrt, die helfen, harmlose von gefährlichen Brustläsionen zu trennen. Praktisch könnte ein Krankenhaus eines Tages QUS‑Analysen direkt aus routinemäßigen B‑Mode‑Daten durchführen, ohne riesige RF‑Datensätze auf jedem Gerät erfassen oder speichern zu müssen. Die Studie ist ein frühes Proof‑of‑Concept, das auf einen Gerätetyp beschränkt ist und sich auf Brustläsionen konzentriert, aber sie weist in Richtung einer Zukunft, in der vorhandene Ultraschallgeräte per Software erweitert werden können, um tiefere, objektivere Einblicke in den Gewebezustand zu liefern — was potenziell die Krebsdiagnose und Therapieentscheidungen verbessert, ohne neue Hardware oder invasive Verfahren hinzuzufügen.

Zitation: Sheibani-Asl, N., Osapoetra, L.O., Czarnota, G.J. et al. AI-enabled RF data synthesis for breast ultrasound: efficacy in quantitative ultrasound tissue characterization. Sci Rep 16, 12544 (2026). https://doi.org/10.1038/s41598-026-43319-9

Schlüsselwörter: Brustultraschall, künstliche Intelligenz, quantitativer Ultraschall, medizinische Bildsynthese, Krebsdiagnose