Clear Sky Science · pt

Sintetização de dados RF por IA para ultrassom de mama: eficácia na caracterização quantitativa de tecidos por ultrassom

Por que isso importa para o cuidado do câncer de mama

O rastreamento do câncer de mama frequentemente depende de imagens de ultrassom que parecem nuvens granuladas em preto e branco. Ocultos nessas imagens estão sinais brutos ricos em informação que poderiam revelar muito mais sobre se um nódulo é inofensivo ou perigoso, mas esses sinais geralmente são descartados porque são grandes demais para armazenar. Este estudo investiga se a inteligência artificial pode recriar esses sinais perdidos a partir de imagens de ultrassom comuns, abrindo caminho para avaliações de câncer de mama mais precisas e acessíveis sem alterar os aparelhos já usados nas clínicas.

De imagens simples a detalhes do sinal oculto

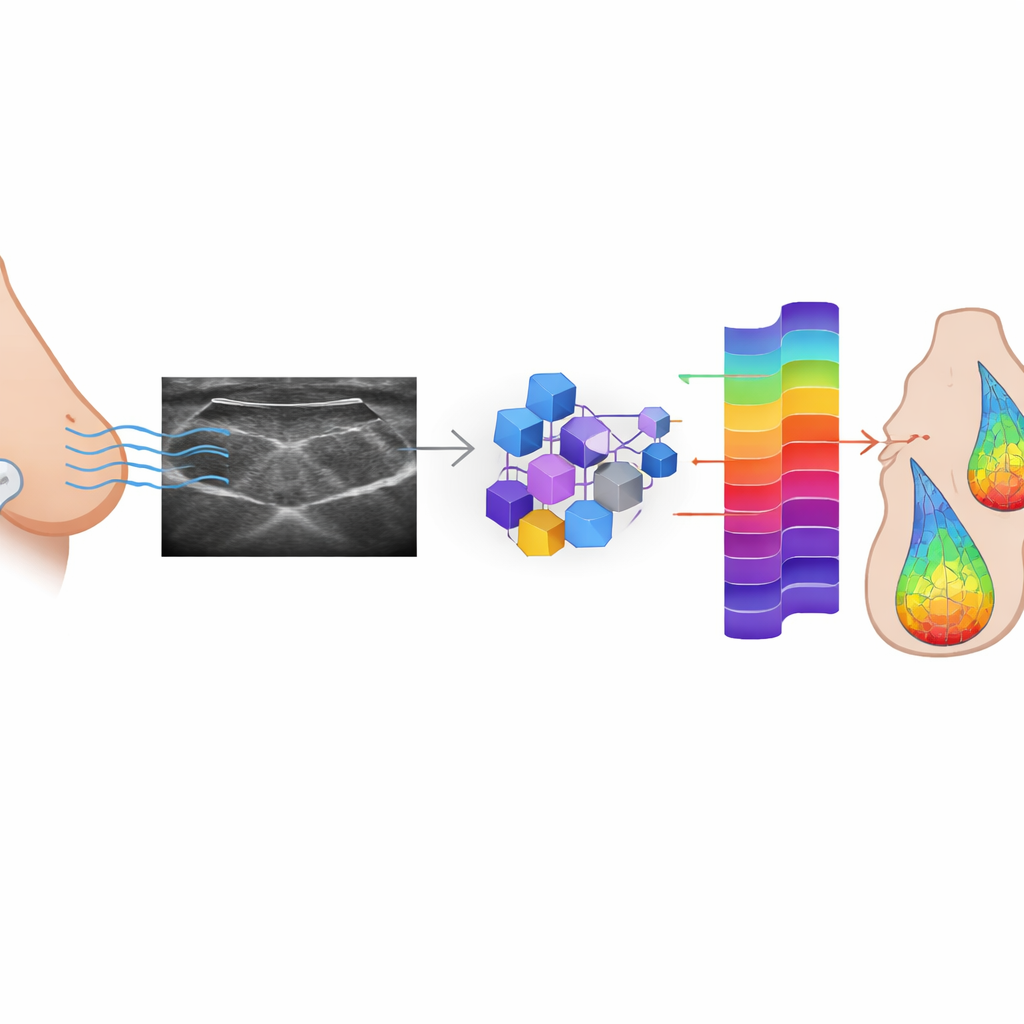

Os exames de ultrassom de mama usados hoje tipicamente geram as chamadas imagens em modo B: cortes em tons de cinza que mostram a forma e o brilho geral do tecido. Antes que essas imagens apareçam na tela, a máquina registra primeiro sinais de eco brutos, conhecidos como dados de radiofrequência (RF). Técnicas de ultrassom quantitativo (QUS) podem analisar esses sinais brutos para estimar propriedades relacionadas ao tamanho, arranjo e concentração de pequenas estruturas dentro do tecido. Trabalhos anteriores demonstraram que esses mapas quantitativos podem ajudar a distinguir lesões benignas de malignas e até acompanhar como tumores respondem à quimioterapia. O problema é que os dados RF são enormes, difíceis de armazenar e transmitir, e muitas vezes inacessíveis em aparelhos comerciais, o que manteve o QUS majoritariamente confinado a laboratórios de pesquisa.

Ensinando a IA a reconstruir os sinais perdidos

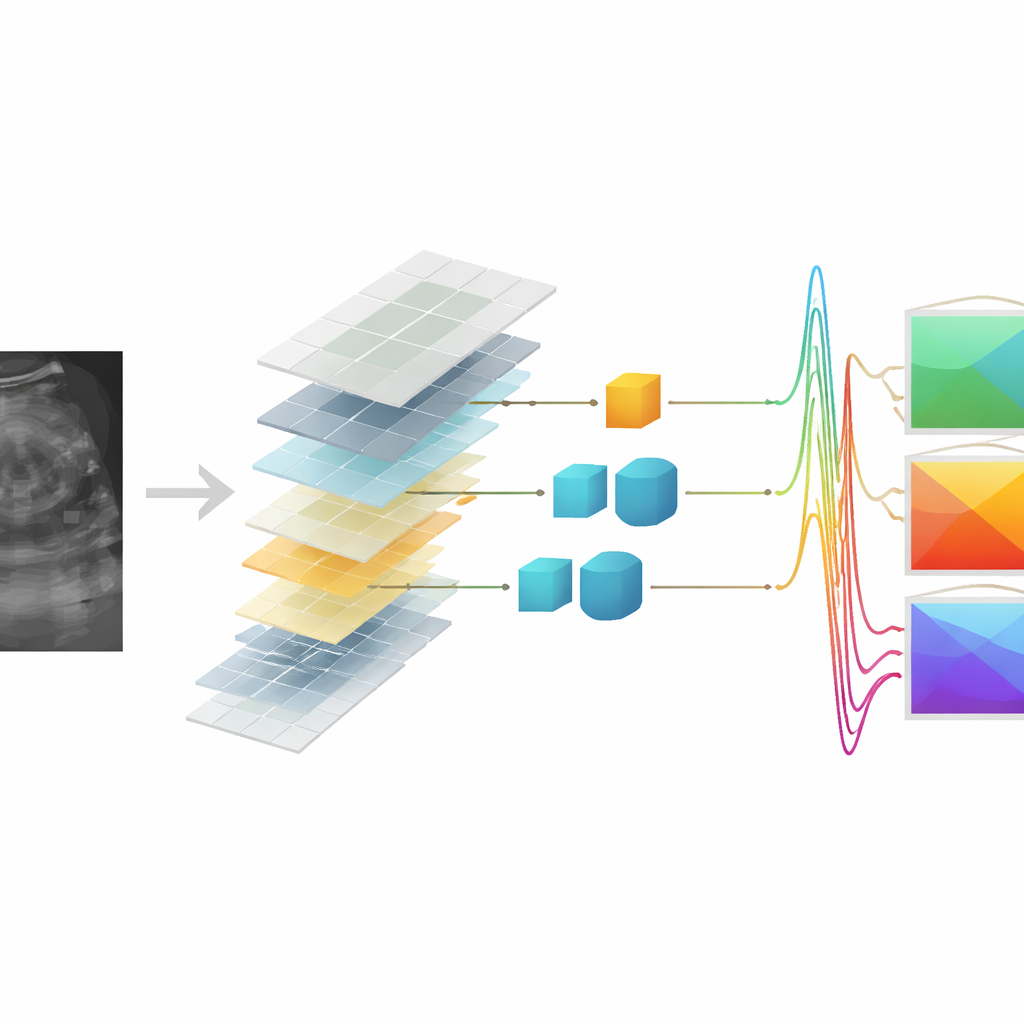

Os pesquisadores propuseram-se a verificar se a IA poderia aprender a reconstruir dados RF a partir das imagens em modo B que são rotineiramente salvas. Treinaram três tipos de redes adversariais generativas condicionais (cGANs)—um modelo Pix2Pix amplamente utilizado e duas versões baseadas em transformers de visão (uma rasa, outra mais profunda)—em um grande conjunto de dados pareados de quadros RF e modo B de 152 pacientes com lesões mamárias suspeitas. Nesse arranjo adversarial, uma rede geradora tenta criar sinais RF realistas a partir de cada imagem em modo B, enquanto uma rede discriminadora aprende a distinguir sinais reais dos sintéticos. Com o tempo, o gerador melhora até que suas saídas se tornem difíceis de diferenciar dos originais. Os modelos foram ajustados não apenas para enganar o discriminador, mas também para manter cada quadro RF gerado numericamente próximo ao seu correspondente verdadeiro.

Testando os sinais sintéticos

Para avaliar o quão bem os dados RF gerados por IA correspondiam aos originais, a equipe usou várias métricas de qualidade de imagem e então fez uma pergunta mais exigente: os sinais sintetizados conseguem suportar o mesmo tipo de caracterização de lesões que os dados RF reais? Em um conjunto de teste reservado com milhares de quadros, todos os três modelos produziram RF sintético estruturalmente muito semelhante aos sinais reais e geraram reconstruções em modo B que preservaram de perto a forma da lesão e a aparência salpicada do ultrassom. O modelo mais poderoso, o cGAN transformer profundo, alcançou a melhor fidelidade geral. Quando mapas QUS foram computados a partir dos dados RF sintéticos, seus valores numéricos e padrões de distribuição se assemelharam fortemente aos derivados dos sinais originais, sugerindo que informações teciduais-chave foram preservadas.

Dados sintéticos ainda conseguem detectar câncer?

O teste decisivo foi se esses mapas QUS baseados em sintéticos poderiam ajudar a distinguir lesões mamárias benignas de malignas. Os autores construíram um pipeline de classificação que primeiro selecionou as características QUS mais informativas e então treinou uma máquina de vetores de suporte para separar os dois grupos. Usando apenas características provenientes de dados RF reais, o sistema classificou corretamente as lesões com cerca de 82% de acurácia. Notavelmente, quando treinados e testados puramente em características QUS derivadas de RF sintético, o modelo transformer profundo e o Pix2Pix alcançaram cerca de 81% de acurácia, equivalendo essencialmente ao desempenho original dentro da variação estatística. Em alguns cenários, o modelo transformer profundo até superou ligeiramente a linha de base quando características sintéticas foram usadas para testar um classificador treinado com dados reais, ressaltando a robustez do mapeamento aprendido.

Perspectivas para exames mais inteligentes

Este trabalho mostra que a IA pode efetivamente "preencher" os sinais brutos de ultrassom ausentes a partir de imagens padrão, preservando os sinais quantitativos chave que ajudam a separar lesões mamárias inofensivas das perigosas. Em termos práticos, um hospital poderia um dia executar análises QUS diretamente a partir de dados de modo B de rotina, sem precisar gravar ou armazenar massivos conjuntos de dados RF em cada aparelho. O estudo é uma prova de conceito inicial, limitada a um tipo de sistema de ultrassom e focada em lesões mamárias, mas aponta para um futuro no qual máquinas de ultrassom existentes podem ser aprimoradas por software para fornecer uma visão mais profunda e objetiva sobre a saúde do tecido—potencialmente melhorando o diagnóstico e as decisões de tratamento do câncer sem adicionar novo hardware ou procedimentos invasivos.

Citação: Sheibani-Asl, N., Osapoetra, L.O., Czarnota, G.J. et al. AI-enabled RF data synthesis for breast ultrasound: efficacy in quantitative ultrasound tissue characterization. Sci Rep 16, 12544 (2026). https://doi.org/10.1038/s41598-026-43319-9

Palavras-chave: ultrassom de mama, inteligência artificial, ultrassom quantitativo, síntese de imagens médicas, diagnóstico de câncer