Clear Sky Science · nl

AI-gestuurde RF-gegevenssynthese voor borstechografie: doeltreffendheid bij kwantitatieve echografische weefselkarakterisering

Waarom dit belangrijk is voor borstkankerzorg

Borstkankerscreening leunt vaak op echobeelden die eruitzien als korrelige zwart‑wit wolken. Achter die beelden schuilen echter rijke ruwe signalen die veel meer zouden kunnen onthullen over de vraag of een knobbel onschadelijk of kwaadaardig is, maar die signalen worden meestal niet bewaard omdat ze te groot zijn om op te slaan. Deze studie onderzoekt of kunstmatige intelligentie die verloren signalen kan reconstrueren uit gewone echoafbeeldingen, wat de weg zou vrijmaken voor nauwkeuriger en betaalbaarder borstkankeronderzoek zonder de in klinieken gebruikte scanners te hoeven vervangen.

Van simpele plaatjes naar verborgen signaaldetails

De huidige borstecho-examens gebruiken doorgaans zogenaamde B‑mode beelden: grijstintdoorsneden die de vorm en de algemene helderheid van weefsel tonen. Voordat deze beelden op het scherm verschijnen, registreert het apparaat eerst ruwe echosignalen, bekend als radiofrequentie (RF)‑gegevens. Kwantitatieve echografietechnieken (QUS) kunnen deze ruwe signalen analyseren om eigenschappen te schatten die verband houden met de grootte, ordening en concentratie van microscopische structuren in het weefsel. Eerder onderzoek heeft aangetoond dat dergelijke kwantitatieve kaarten kunnen helpen onderscheid te maken tussen goedaardige en kwaadaardige laesies en zelfs het antwoord van tumoren op chemotherapie kunnen volgen. Het probleem is dat RF‑gegevens enorm zijn, moeilijk op te slaan en te verzenden, en vaak ontoegankelijk op commerciële scanners, waardoor QUS grotendeels beperkt is gebleven tot onderzoeksomgevingen.

AI leren de verloren signalen te reconstrueren

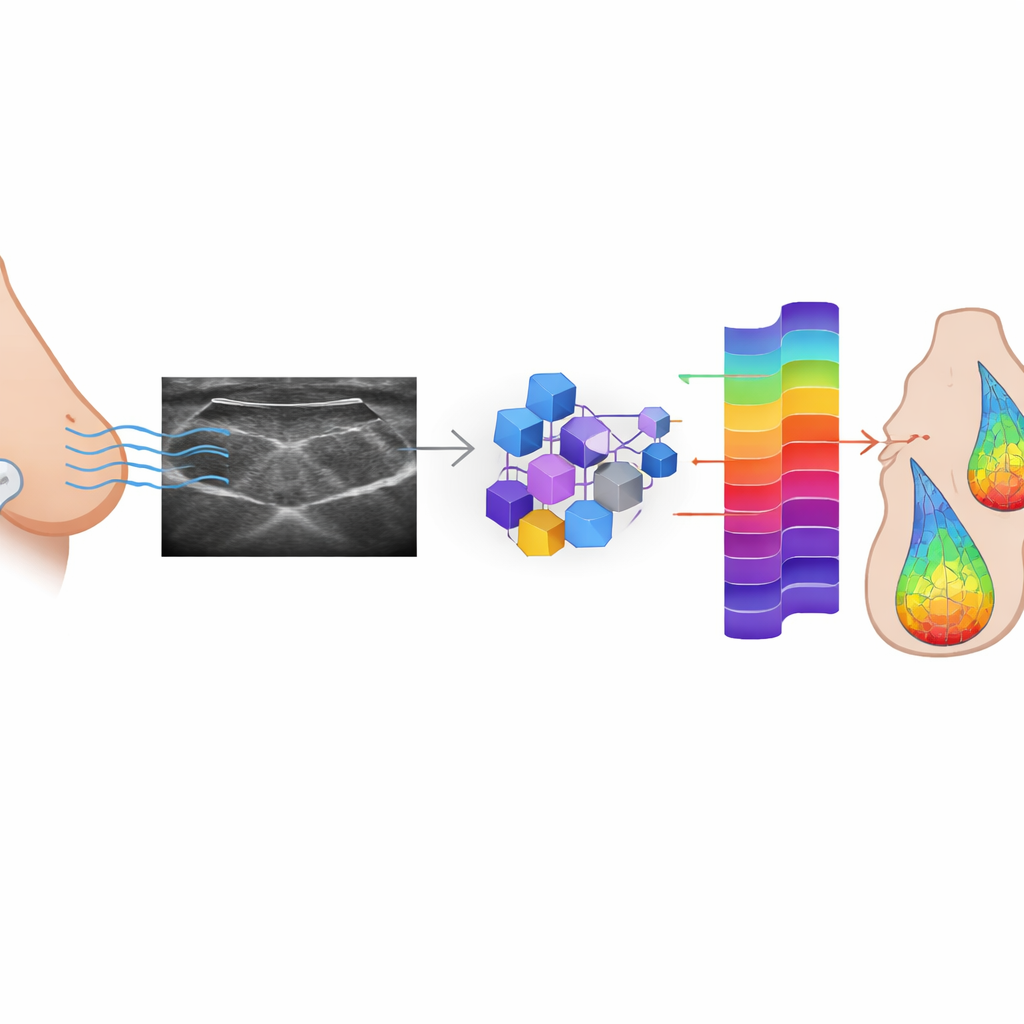

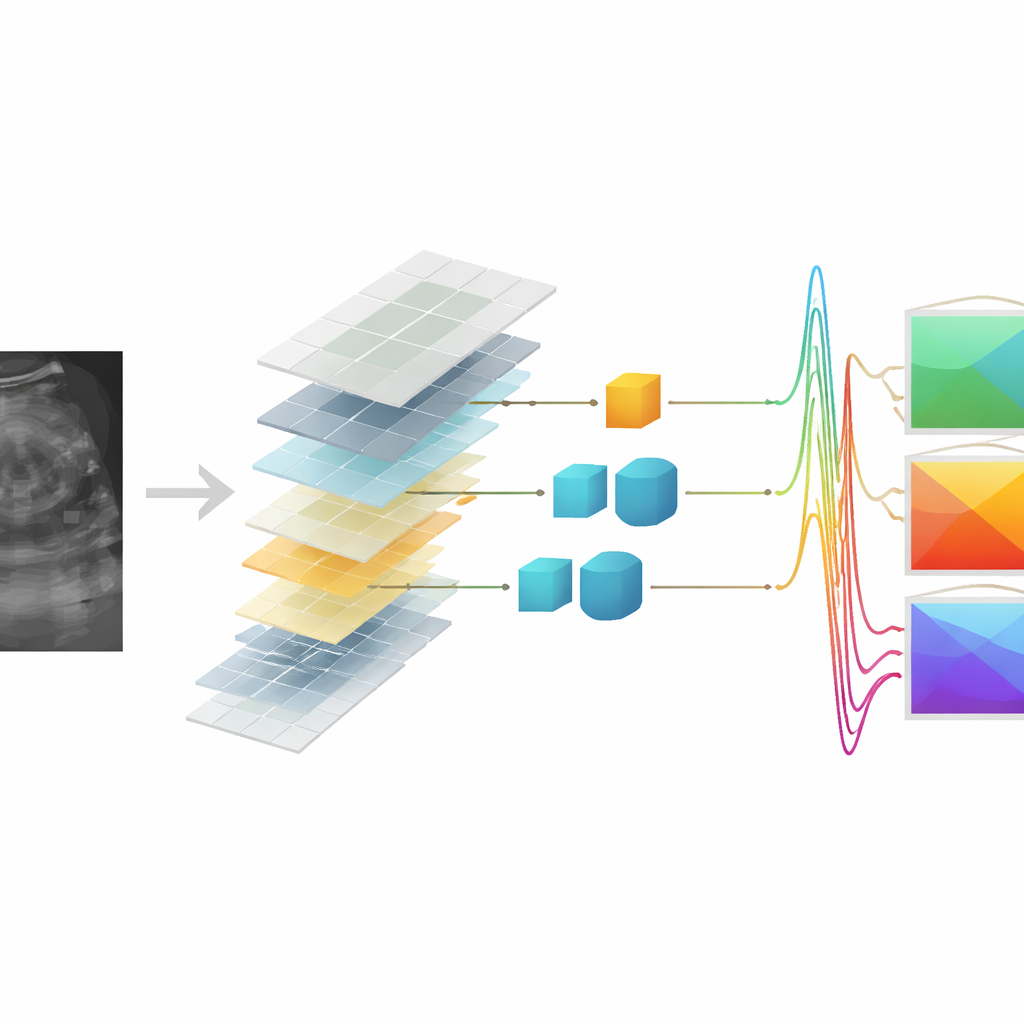

De onderzoekers wilden weten of AI RF‑gegevens kon leren reconstrueren uit de B‑mode beelden die routinematig worden opgeslagen. Ze trainden drie soorten conditionele generatieve adversariële netwerken (cGANs)—een veelgebruikt Pix2Pix‑model en twee varianten gebaseerd op vision transformers (één ondiep, één dieper)—op een grote dataset van gekoppelde RF‑ en B‑mode frames van 152 patiënten met verdachte borstlaesies. In deze adversariële opzet probeert een generatornetwerk realistische RF‑signalen te creëren uit elk B‑mode beeld, terwijl een discriminatornetwerk leert echte van synthetische signalen te onderscheiden. In de loop van de training verbetert de generator totdat de output moeilijk van het origineel te onderscheiden is. De modellen werden niet alleen geoptimaliseerd om de discriminator te misleiden, maar ook om elk gegenereerd RF‑frame numeriek dicht bij het echte tegenhanger te houden.

Synthetische signalen aan de tand voelen

Om te beoordelen hoe goed de AI‑gegenereerde RF‑gegevens overeenkwamen met het origineel, gebruikte het team verschillende beeldkwaliteitscores en stelde daarna een zwaardere vraag: kunnen de gesynthetiseerde signalen dezelfde vorm van laesiekarakterisering ondersteunen als echte RF‑gegevens? Op een afzijdig gehouden testset van duizenden frames produceerden alle drie de modellen synthetische RF die structureel zeer vergelijkbaar was met de echte signalen en leidden tot B‑mode reconstructies die de laesievorm en het korrelige uiterlijk van echo goed behielden. Het krachtigste model, de diepe transformer‑cGAN, behaalde de beste algehele trouw. Toen QUS‑kaarten werden berekend uit de synthetische RF‑gegevens, leken hun numerieke waarden en verdelingspatronen sterk op die afgeleid van de oorspronkelijke signalen, wat suggereert dat cruciale weefselinformatie behouden bleef.

Vinden synthetische gegevens nog steeds kanker?

De beslissende test was of deze op synthetische gegevens gebaseerde QUS‑kaarten konden helpen onderscheid te maken tussen goedaardige en kwaadaardige borstlaesies. De auteurs bouwden een classificatiepipeline die eerst de meest informatieve QUS‑kenmerken selecteerde en vervolgens een support vector machine trainde om de twee groepen te scheiden. Met alleen kenmerken uit echte RF‑gegevens classificeerde het systeem laesies correct met ongeveer 82% nauwkeurigheid. Opmerkelijk genoeg bereikten de diepe transformer en het Pix2Pix‑model, wanneer louter getraind en getest op QUS‑kenmerken afgeleid van synthetische RF, ongeveer 81% nauwkeurigheid, wat in wezen overeenkomt met de oorspronkelijke prestatie binnen statistische variatie. In sommige scenario’s overtrof het diepe transformer‑model zelfs licht de referentie wanneer synthetische kenmerken werden gebruikt om te testen tegen een classificator die op echte‑gegevenskenmerken was getraind, wat de robuustheid van de geleerde mapping benadrukt.

Vooruitkijken naar slimere scans

Dit werk laat zien dat AI effectief de ontbrekende ruwe echosignalen kan "invullen" vanuit standaardbeelden, terwijl de belangrijkste kwantitatieve aanwijzingen behouden blijven die helpen onschadelijke van gevaarlijke borstlaesies te onderscheiden. In praktische zin zou een ziekenhuis in de toekomst QUS‑analyses direct kunnen uitvoeren op routinematig B‑mode materiaal, zonder op elke scanner enorme RF‑datasets te hoeven opnemen of opslaan. De studie is een vroeg proof of concept, beperkt tot één type echoapparaat en gericht op borstlaesies, maar wijst op een toekomst waarin bestaande echomachines met software kunnen worden uitgebreid om dieper en objectiever inzicht in weefselgezondheid te bieden—mogelijk met verbeterde kankerdiagnose en behandelingskeuzes zonder extra hardware of invasieve procedures.

Bronvermelding: Sheibani-Asl, N., Osapoetra, L.O., Czarnota, G.J. et al. AI-enabled RF data synthesis for breast ultrasound: efficacy in quantitative ultrasound tissue characterization. Sci Rep 16, 12544 (2026). https://doi.org/10.1038/s41598-026-43319-9

Trefwoorden: borstechografie, kunstmatige intelligentie, kwantitatieve echografie, medische beeldsynthese, kankerdiagnose