Clear Sky Science · sv

En omfattande utvärdering av lätta djupinlärningsmodeller för klassificering av tomatsjukdomar i edge computing-miljöer

Smartare ögon för tomatplantor

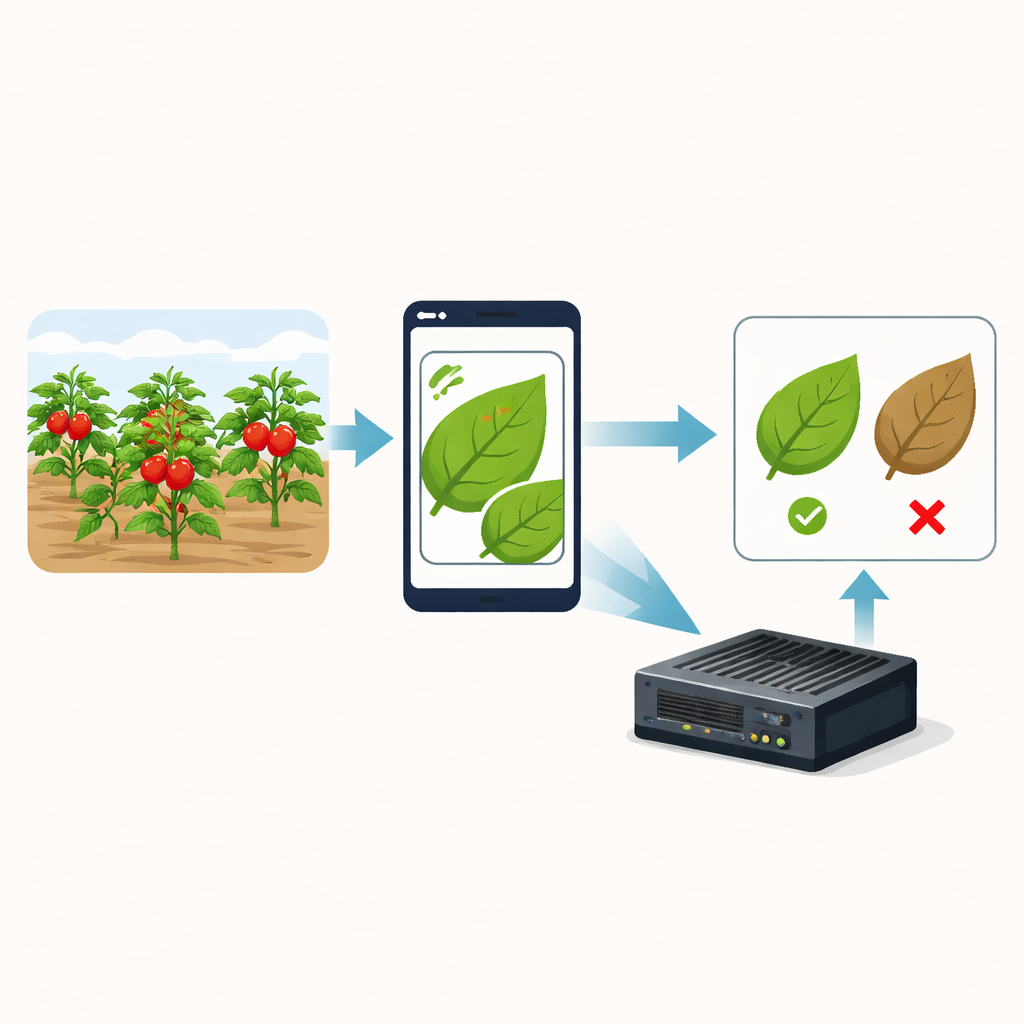

Tomatgrödor världen över förlorar en stor andel av sin potentiella skörd på grund av bladsjukdomar. I dag kan odlare ta bilder av blad med en telefon eller fältkamera och låta artificiell intelligens (AI) upptäcka problem tidigt. Men det finns en hake: många av de mest precisa AI-modellerna är för tunga för att köras på lågkostnadsenheter i fält och växthus. Denna studie ställer en praktisk fråga: vilka kompakta AI-modeller kan både känna igen tomatsjukdomar noggrant och köras snabbt på liten, billig hårdvara nära själva plantorna?

Varför foton av tomatblad är viktiga

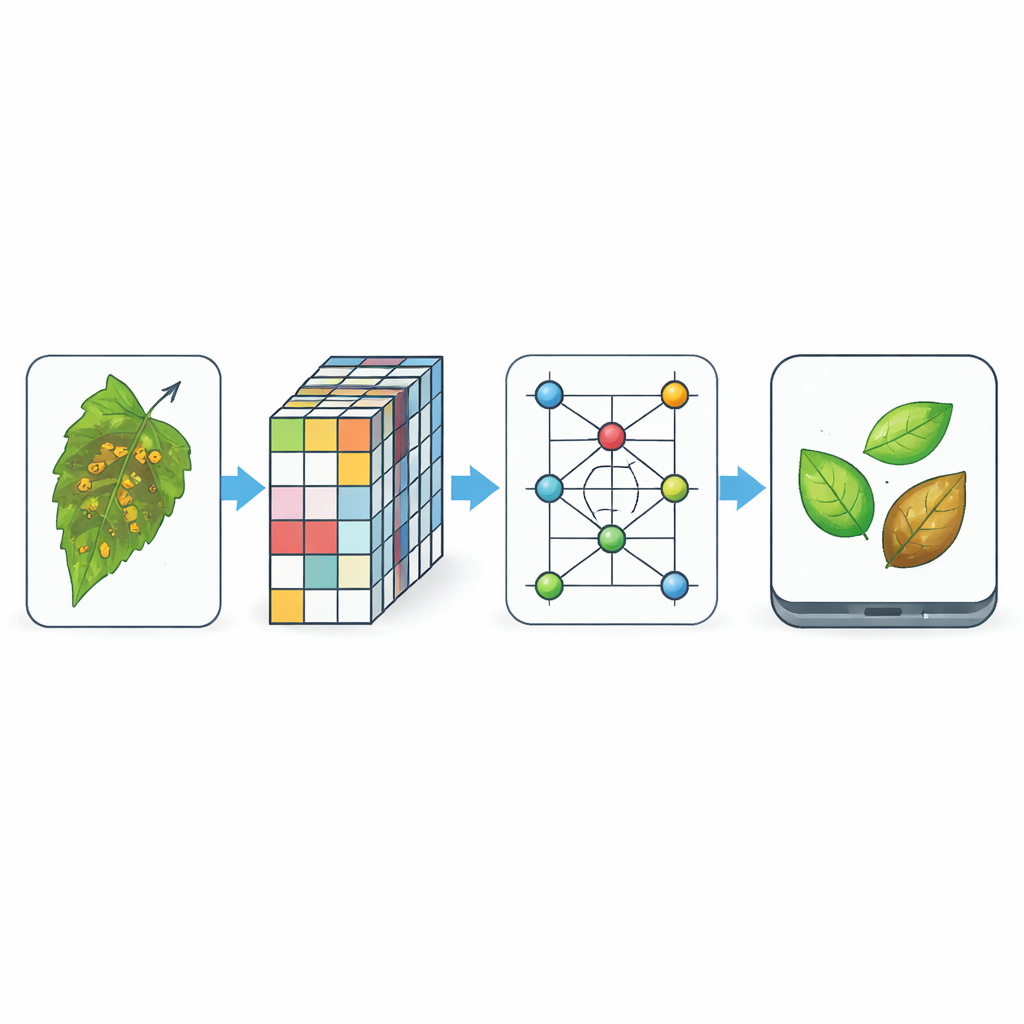

Tomatsjukdomar visar sig ofta först som fläckar, mögel eller missfärgningar på bladen, och att upptäcka dem tidigt kan förhindra allvarliga skördeförluster. Författarna bygger vidare på en välkänd offentlig bildsamling kallad PlantVillage, med fokus på över 18 000 foton av tomatblad som täcker nio sjukdomar samt friska plantor. Alla bilder standardiseras och modifieras lätt under träning för att efterlikna verkliga variationer som ljusförhållanden, zoom och små förskjutningar i position. Detta låter forskarna testa hur väl olika AI-modeller lär sig att känna igen visuella mönster som skiljer till exempel tidig blåsplint från sen blåsplint, eller ett friskt blad från ett infekterat av ett virus.

Jämförelse av många små hjärninspirerade modeller

I stället för att ta fram ännu en ny modell på egen hand genomför teamet en rättvis tävling mellan sju kompakta djupinlärningsarkitekturer. Några är klassiska bildigenkänningsnätverk som framgångsrikt använts i många uppgifter, såsom VGG16, ResNet50 och DenseNet121. Andra är nyare konstruktioner skapade specifikt för att fungera bra på telefoner och inbäddade enheter, som MobileNetV3-Small, ShuffleNetV2 och SqueezeNet. Den sista utmanaren, MobilePlantViT, är en hybrid som kombinerar två idéer: traditionella konvolutionella lager som fångar fina detaljer i små regioner av en bild, och transformer-liknande attention som kopplar ihop avlägsna delar av ett blad för att förstå det övergripande sjukdomsmönstret.

Se inuti AIs beslut

För att bönder och agronomer ska kunna lita på dessa modeller räcker det inte att de är precisa—de måste också vara begripliga. Författarna använder därför tre populära "förklarbara AI"-tekniker som skapar värmekartor över varje bladbild och visar vilka regioner som mest påverkade beslutet. Dessa är Grad-CAM, LIME och SHAP. För att gå bortom att bara bedöma dessa färgrika kartor med blotta ögat introducerar teamet en ny poäng kallad Perturbation Stability Score. Genom att lägga till lite brus i en bild många gånger och jämföra hur mycket förklaringskartorna förändras kan de mäta hur stabil och pålitlig varje förklaringsmetod är. Över modellerna tenderar SHAP att ge de mest stabila förklaringarna, medan Grad-CAM erbjuder klara, högupplösta markeringar av angripna områden som stämmer väl överens med mänskliga förväntningar.

Hastighet och energiförbrukning på riktiga enheter

Där verktyg i jordbruket ofta förlitar sig på lågkostnadsprocessorer utan grafikchip mäter forskarna hur snabbt varje modell körs på standardstationära CPU:er och på en Raspberry Pi 5, en liten, prisvärd dator jämförbar med hårdvara som används i smarta kameror. De kartlägger modellstorlek, antalet grundläggande matematiska operationer per bild och tiden att bearbeta ett enda foto under olika trådinställningar. Standardnätverk som VGG16 levererar utmärkt noggrannhet men är stora och långsamma, medan små modeller som SqueezeNet körs snabbt men tappar viss precision, särskilt under mer utmanande, brusiga bilder och fältförhållanden. MobilePlantViT utmärker sig: den når över 99 % noggrannhet på rena bilder och förblir konkurrenskraftig i mer realistiska tester, samtidigt som den använder en bråkdel av minnet och beräkningen och uppnår nära realtidsprestanda även på begränsad hårdvara.

Vad detta innebär för framtidens smarta jordbruk

Sammanfattningsvis visar studien att noggrant utformade lätta modeller kan ta högpresterande bildigenkänning ut till fältets kant, där uppkoppling och ström är begränsade. Bland alla testade arkitekturer erbjuder MobilePlantViT den bästa kombinationen av skarp diagnos, effektiv användning av datorkapacitet och tydliga visuella förklaringar av vad modellen "tittar på" när den förutsäger en sjukdom. För odlare och teknikutvecklare pekar detta mot en framtid där små, billiga enheter monterade på telefoner, drönare eller växthusskenor kontinuerligt kan skanna tomatplantor, markera misstänkta blad och motivera sina varningar på sätt som agronomer kan verifiera och lita på.

Citering: Hoang, TM., Bui, VH., Nguyen, VS. et al. A comprehensive evaluation of lightweight deep learning models for tomato disease classification on edge computing environments. Sci Rep 16, 12320 (2026). https://doi.org/10.1038/s41598-026-42439-6

Nyckelord: upptäckt av tomatsjukdomar, edge AI, lättviktig djupinlärning, vision transformer, förklarbar AI