Clear Sky Science · fr

Une évaluation complète de modèles profonds allégés pour la classification des maladies de la tomate dans des environnements d’informatique en périphérie

Des yeux plus intelligents pour les plants de tomate

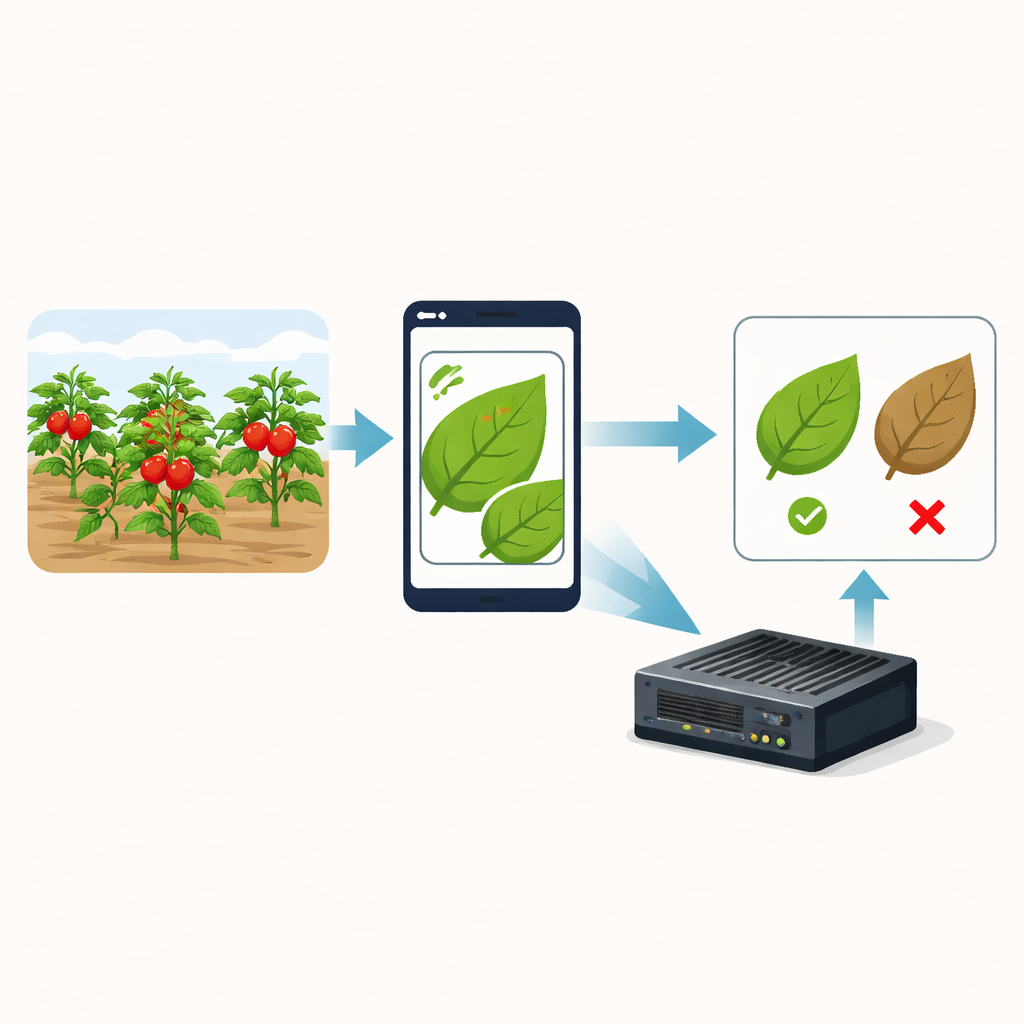

Les cultures de tomates perdent dans le monde une grande partie de leur rendement potentiel à cause des maladies foliaires. Aujourd’hui, les agriculteurs peuvent photographier des feuilles avec un téléphone ou une caméra de terrain, permettant à l’intelligence artificielle (IA) de signaler les problèmes précocement. Mais il y a un hic : beaucoup des modèles d’IA les plus précis sont trop lourds pour fonctionner sur des appareils peu coûteux en serre ou sur le terrain. Cette étude pose une question pratique : quels modèles d’IA compacts peuvent à la fois détecter les maladies de la tomate avec précision et s’exécuter rapidement sur du matériel petit et bon marché situé près des plantes ?

Pourquoi les photos de feuilles de tomate sont importantes

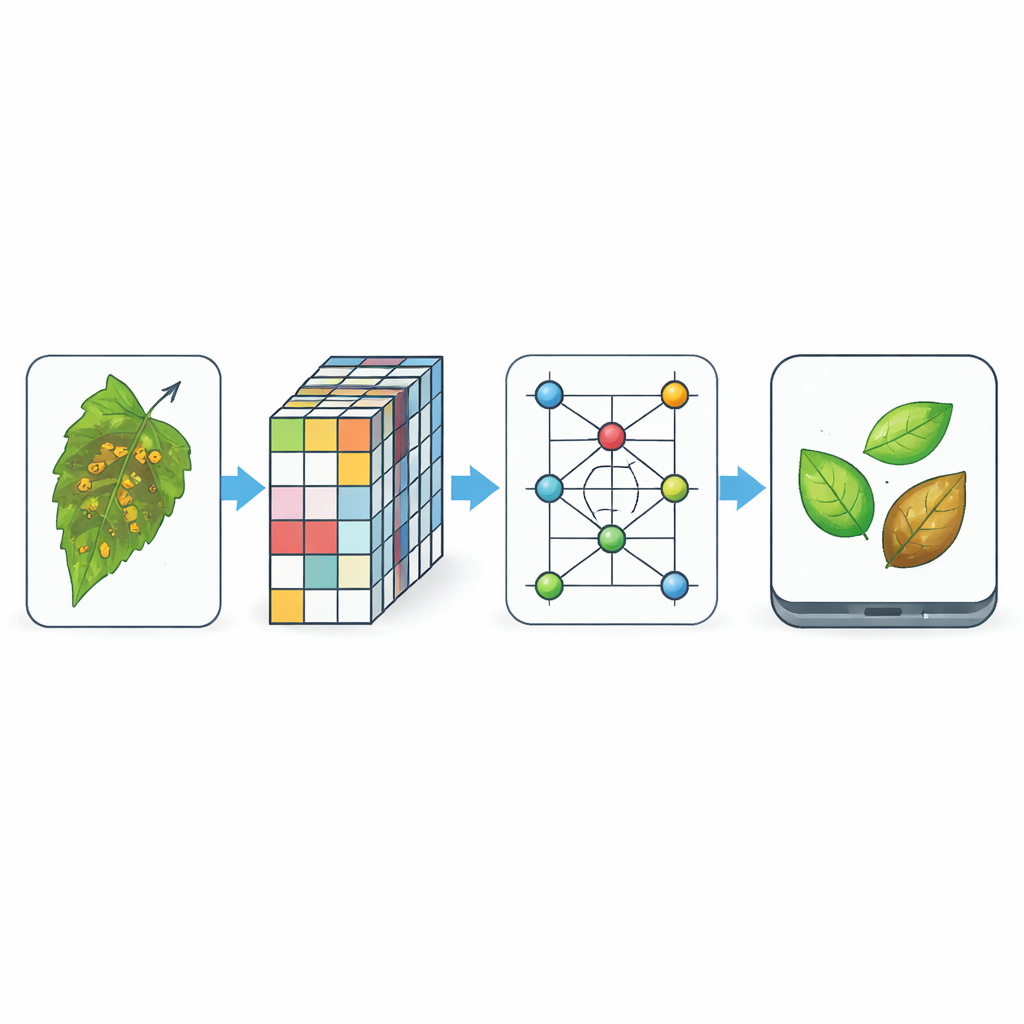

Les maladies de la tomate se manifestent souvent d’abord par des taches, des moisissures ou des décolorations sur les feuilles, et les détecter tôt peut éviter des pertes de rendement importantes. Les auteurs s’appuient sur une collection publique renommée appelée PlantVillage, en se concentrant sur plus de 18 000 photos de feuilles de tomate couvrant neuf maladies plus des plants sains. Toutes les images sont standardisées et légèrement altérées durant l’entraînement pour reproduire des variations réelles comme l’éclairage, le zoom et de petits décalages de position. Cela permet aux chercheurs d’évaluer dans quelle mesure différents modèles d’IA apprennent à reconnaître les motifs visuels qui distinguent, par exemple, la brûlure précoce de la brûlure tardive, ou une feuille saine d’une feuille infectée par un virus.

Comparer plusieurs petits modèles inspirés du cerveau

Plutôt que de concevoir un nouveau modèle isolément, l’équipe organise une comparaison équitable entre sept architectures profondes compactes. Certaines sont des réseaux classiques de reconnaissance d’images qui ont fait leurs preuves dans de nombreuses tâches, comme VGG16, ResNet50 et DenseNet121. D’autres sont des conceptions plus récentes créées spécifiquement pour bien fonctionner sur téléphones et appareils embarqués, comme MobileNetV3-Small, ShuffleNetV2 et SqueezeNet. Le dernier concurrent, MobilePlantViT, est un hybride combinant deux idées : des couches convolutionnelles traditionnelles qui capturent les détails fins dans de petites régions d’une image, et une attention de type transformer qui relie des parties éloignées d’une feuille pour comprendre le motif global de la maladie.

Comprendre les décisions de l’IA

Pour que les agriculteurs et les agronomes fassent confiance à ces modèles, il ne suffit pas qu’ils soient précis — ils doivent aussi être compréhensibles. Les auteurs utilisent donc trois techniques populaires d’« IA explicable » qui créent des cartes de chaleur sur chaque image de feuille, montrant quelles régions ont le plus influencé la décision. Il s’agit de Grad-CAM, LIME et SHAP. Pour aller au-delà d’une simple inspection visuelle de ces cartes colorées, l’équipe introduit un nouveau score appelé Perturbation Stability Score. En ajoutant un peu de bruit à une image plusieurs fois et en comparant dans quelle mesure les cartes d’explication changent, ils mesurent la stabilité et la fiabilité de chaque méthode d’explication. Dans l’ensemble, SHAP a tendance à fournir les explications les plus stables, tandis que Grad-CAM offre des surlignages nets et de haute résolution des zones malades qui correspondent bien aux attentes humaines.

Vitesse et consommation sur des appareils réels

Parce que les outils agricoles reposent souvent sur des processeurs peu coûteux sans puces graphiques, les chercheurs mesurent la rapidité d’exécution de chaque modèle sur des processeurs de bureau standard et sur un Raspberry Pi 5, un petit ordinateur abordable comparable au matériel utilisé dans les caméras intelligentes. Ils suivent la taille du modèle, le nombre d’opérations arithmétiques de base par image et le temps de traitement d’une photo selon différents réglages de threads. Les réseaux standards comme VGG16 offrent une excellente précision mais sont volumineux et lents, tandis que des modèles très petits comme SqueezeNet s’exécutent rapidement mais perdent en précision, en particulier sur des images plus difficiles ou en conditions de terrain bruyantes. MobilePlantViT se distingue : il atteint une précision supérieure à 99 % sur des images propres et reste compétitif sur des tests plus réalistes, tout en utilisant une fraction de la mémoire et du calcul, atteignant des performances quasi temps réel même sur du matériel contraint.

Ce que cela signifie pour les fermes intelligentes de demain

Globalement, l’étude montre que des modèles légers conçus avec soin peuvent apporter une reconnaissance d’images de haut niveau au plus près des cultures, là où la connectivité et l’alimentation sont limitées. Parmi toutes les architectures testées, MobilePlantViT offre la meilleure combinaison de diagnostic précis, d’utilisation efficace des ressources informatiques et d’explications visuelles claires sur ce que le modèle « regarde » lorsqu’il prédit une maladie. Pour les cultivateurs et les développeurs de technologies, cela ouvre la voie à un avenir où de petits appareils bon marché montés sur des téléphones, des drones ou des rails de serre peuvent scanner en continu les plants de tomate, signaler les feuilles suspectes et justifier leurs alertes de manière vérifiable et fiable pour les agronomes.

Citation: Hoang, TM., Bui, VH., Nguyen, VS. et al. A comprehensive evaluation of lightweight deep learning models for tomato disease classification on edge computing environments. Sci Rep 16, 12320 (2026). https://doi.org/10.1038/s41598-026-42439-6

Mots-clés: détection des maladies de la tomate, IA en périphérie, apprentissage profond léger, vision transformer, IA explicable