Clear Sky Science · it

Una valutazione completa di modelli di deep learning leggeri per la classificazione delle malattie del pomodoro in ambienti di edge computing

Occhi più intelligenti per le piante di pomodoro

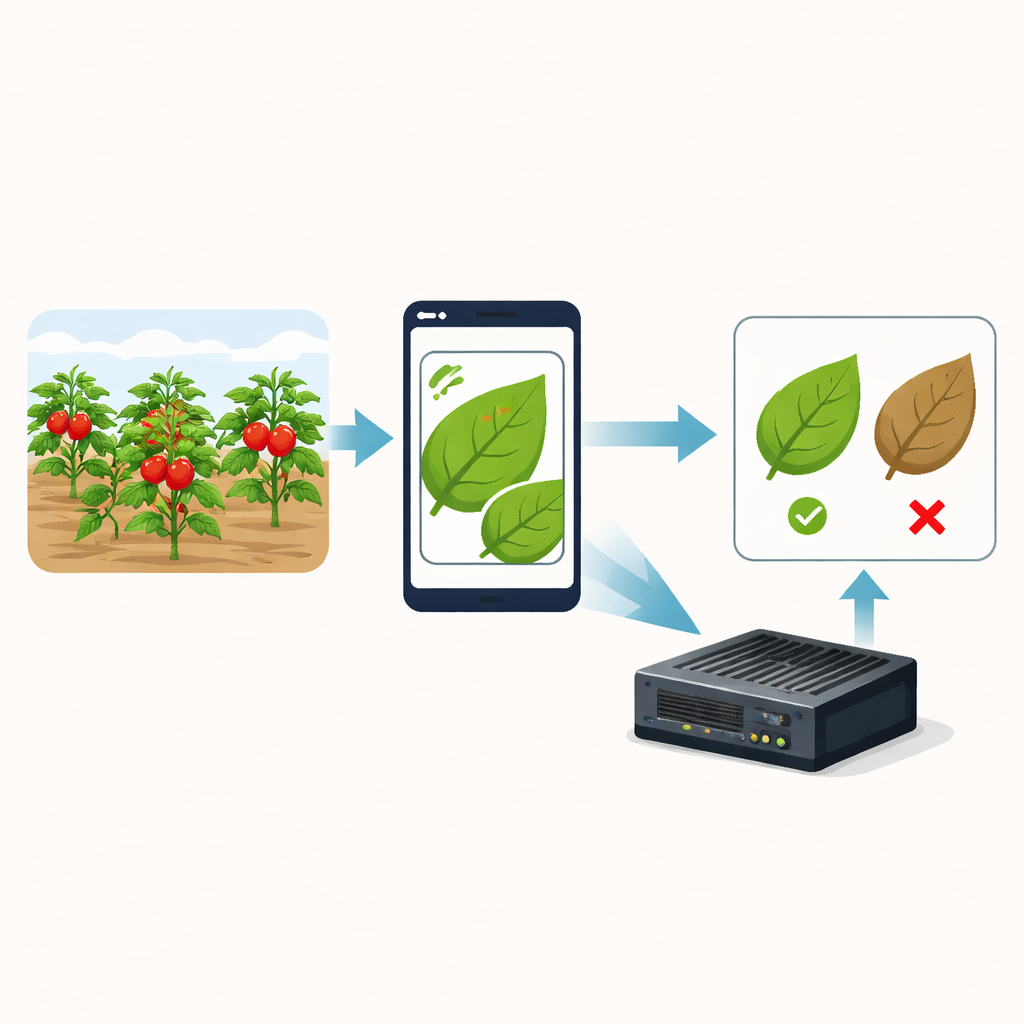

Coltivazioni di pomodoro in tutto il mondo perdono una grande parte del loro potenziale raccolto a causa di malattie fogliari. Oggi gli agricoltori possono scattare foto delle foglie con un telefono o una fotocamera da campo, permettendo all’intelligenza artificiale (AI) di segnalare problemi in fase precoce. Ma c’è un problema: molti dei modelli AI più accurati sono troppo pesanti per funzionare su dispositivi a basso costo presenti nei campi e nelle serre. Questo studio pone una domanda pratica: quali modelli AI compatti possono sia individuare con precisione le malattie del pomodoro sia girare velocemente su hardware piccolo ed economico vicino alle piante?

Perché le foto delle foglie di pomodoro sono importanti

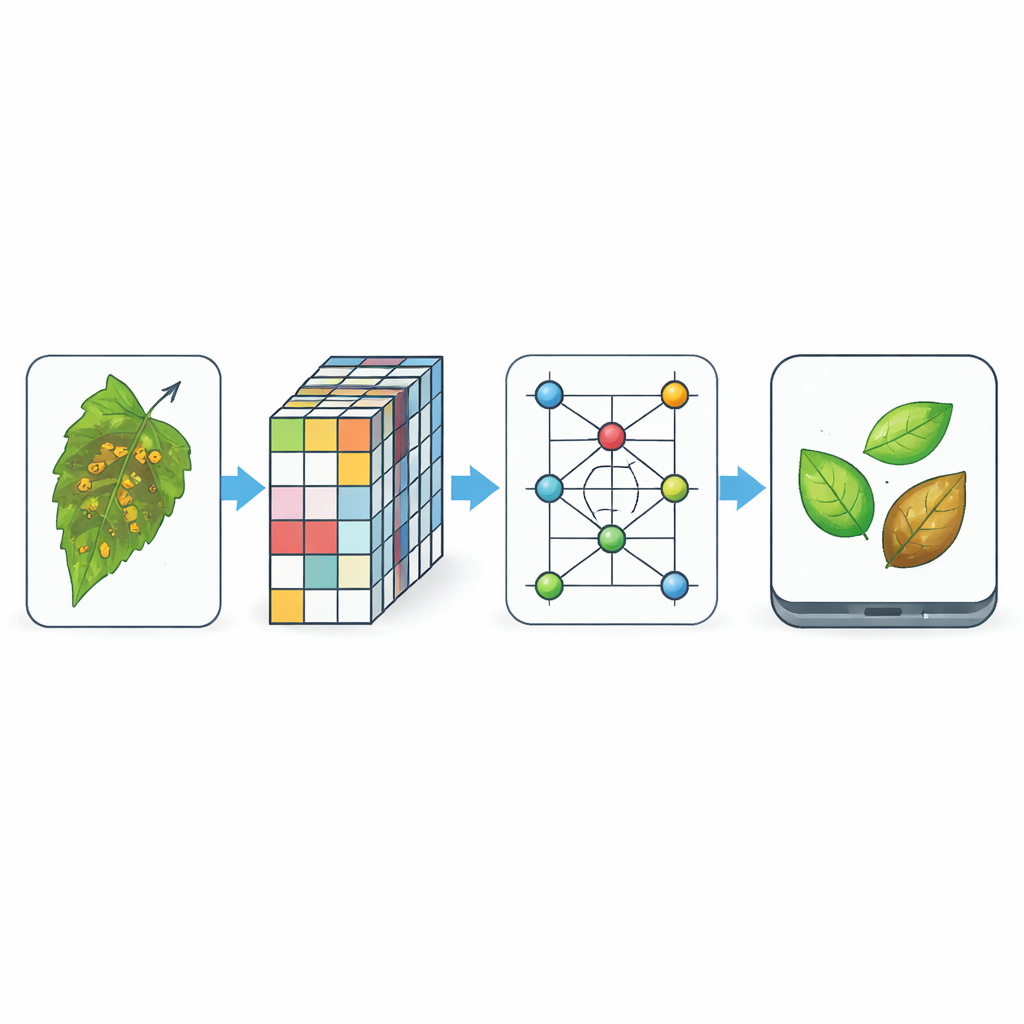

Le malattie del pomodoro spesso si manifestano per prime come macchie, muffe o scolorimenti sulle foglie, e individuarle precocemente può prevenire gravi perdite di resa. Gli autori si basano su una popolare raccolta pubblica di immagini chiamata PlantVillage, concentrandosi su oltre 18.000 foto di foglie di pomodoro che coprono nove malattie più piante sane. Tutte le immagini sono standardizzate e leggermente alterate durante l’addestramento per imitare cambiamenti del mondo reale come illuminazione, zoom e piccoli spostamenti di posizione. Questo permette ai ricercatori di testare quanto bene diversi modelli AI apprendono a riconoscere pattern visivi che distinguono, per esempio, la ruggine precoce dalla ruggine tardiva, o una foglia sana da una infettata da un virus.

Confronto tra molti modelli ispirati al cervello ma compatti

Invece di progettare un altro nuovo modello da soli, il team organizza una gara equa tra sette architetture di deep learning compatte. Alcune sono reti classiche di riconoscimento delle immagini che hanno avuto successo in molti compiti, come VGG16, ResNet50 e DenseNet121. Altre sono progetti più recenti creati specificamente per funzionare bene su telefoni e dispositivi embedded, come MobileNetV3-Small, ShuffleNetV2 e SqueezeNet. L’ultimo concorrente, MobilePlantViT, è un ibrido che combina due idee: strati convoluzionali tradizionali che catturano dettagli fini in piccole regioni dell’immagine, e attenzione in stile transformer che collega parti distanti della foglia per comprendere il pattern generale della malattia.

Guardare dentro le decisioni dell’AI

Perché agricoltori e agronomi si fidino di questi modelli, non basta che siano accurati: devono anche essere comprensibili. Gli autori quindi usano tre tecniche popolari di “explainable AI” che generano mappe di calore su ciascuna immagine della foglia, mostrando quali regioni hanno influenzato maggiormente la decisione. Queste sono Grad-CAM, LIME e SHAP. Per andare oltre la semplice ispezione visiva di queste mappe colorate, il team introduce un nuovo punteggio chiamato Perturbation Stability Score. Aggiungendo un po’ di rumore a un’immagine molte volte e confrontando quanto cambiano le mappe di spiegazione, possono misurare quanto siano stabili e affidabili i vari metodi di spiegazione. Tra i modelli, SHAP tende a fornire le spiegazioni più stabili, mentre Grad-CAM offre evidenziazioni nitide e ad alta risoluzione delle aree malate che si allineano bene con le aspettative umane.

Velocità e consumo energetico su dispositivi reali

Poiché gli strumenti agricoli spesso si basano su processori a basso costo senza chip grafici, i ricercatori misurano quanto velocemente gira ciascun modello su CPU desktop standard e su un Raspberry Pi 5, un piccolo computer economico confrontabile con l’hardware usato nelle telecamere intelligenti. Monitorano la dimensione del modello, il numero di operazioni matematiche di base per immagine e il tempo per elaborare una singola foto sotto diverse impostazioni di threading. Reti standard come VGG16 offrono un’eccellente accuratezza ma sono enormi e lente, mentre modelli minuscoli come SqueezeNet girano rapidamente ma perdono un po’ di precisione, specialmente con immagini più difficili, rumorose o in condizioni di campo. MobilePlantViT si distingue: raggiunge accuratezza superiore al 99% su immagini pulite e rimane competitivo nei test più realistici, pur utilizzando una frazione della memoria e del calcolo, ottenendo prestazioni quasi in tempo reale anche su hardware limitato.

Cosa significa questo per le future fattorie intelligenti

Complessivamente, lo studio mostra che modelli leggeri progettati con cura possono portare il riconoscimento delle immagini di alto livello ai margini del campo, dove connettività ed energia sono limitate. Tra tutte le architetture testate, MobilePlantViT offre la migliore combinazione di diagnosi precisa, uso efficiente delle risorse di calcolo e spiegazioni visive chiare di ciò che il modello “guarda” quando predice una malattia. Per coltivatori e sviluppatori di tecnologia, questo indica un futuro in cui dispositivi piccoli ed economici montati su telefoni, droni o guide in serra possono scansionare continuamente le piante di pomodoro, evidenziare le foglie sospette e giustificare i loro avvisi in modi che gli agronomi possono verificare e ritenere affidabili.

Citazione: Hoang, TM., Bui, VH., Nguyen, VS. et al. A comprehensive evaluation of lightweight deep learning models for tomato disease classification on edge computing environments. Sci Rep 16, 12320 (2026). https://doi.org/10.1038/s41598-026-42439-6

Parole chiave: rilevamento delle malattie del pomodoro, edge AI, deep learning leggero, vision transformer, AI spiegabile