Clear Sky Science · es

Una evaluación exhaustiva de modelos ligeros de aprendizaje profundo para la clasificación de enfermedades del tomate en entornos de computación en el borde

Ojos más inteligentes para las plantas de tomate

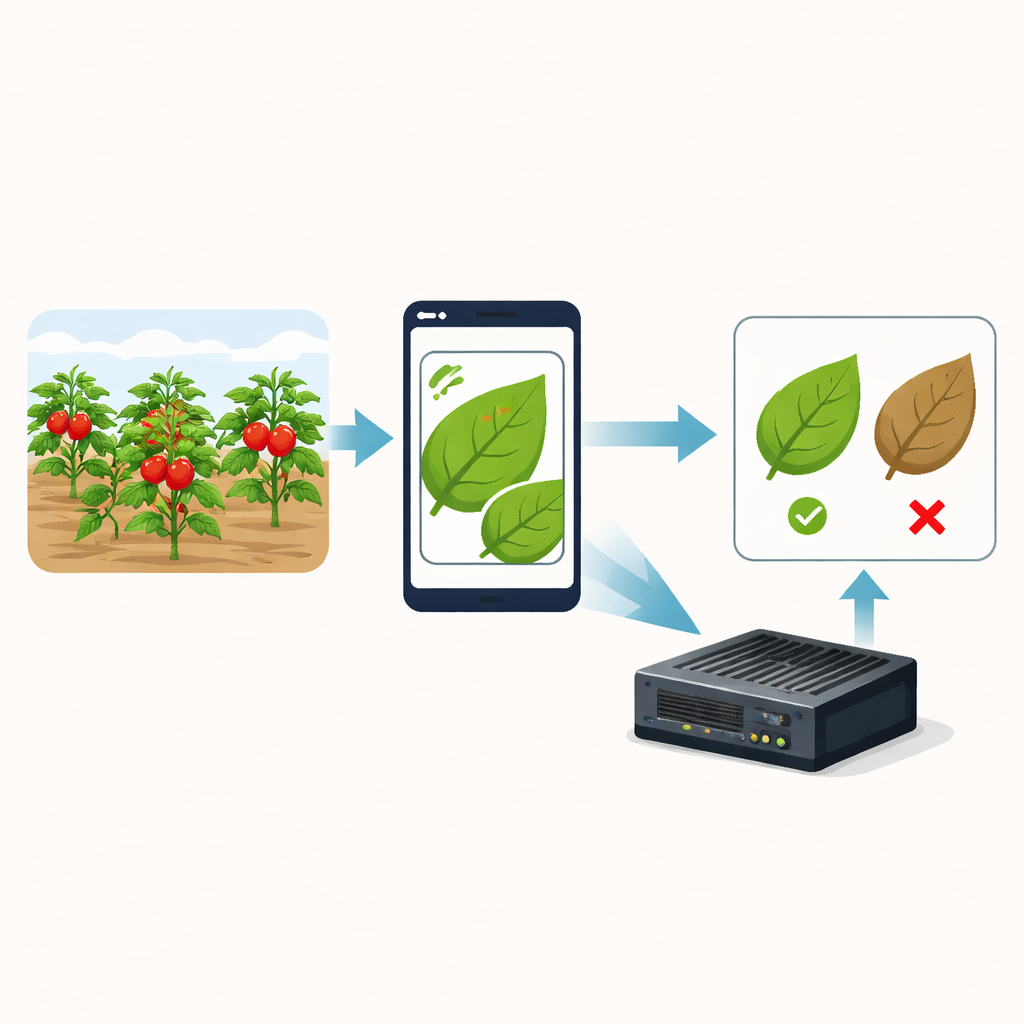

Los cultivos de tomate en todo el mundo pierden una gran parte de su cosecha potencial por enfermedades foliares. Hoy en día, los agricultores pueden tomar fotos de las hojas con un teléfono o una cámara de campo, permitiendo que la inteligencia artificial (IA) detecte problemas de forma temprana. Pero hay un inconveniente: muchos de los modelos de IA más precisos son demasiado pesados para ejecutarse en dispositivos de bajo coste en campos e invernaderos. Este estudio plantea una pregunta práctica: ¿qué modelos de IA compactos pueden tanto detectar enfermedades del tomate con precisión como ejecutarse con rapidez en hardware pequeño y económico cerca de las propias plantas?

Por qué importan las fotos de las hojas de tomate

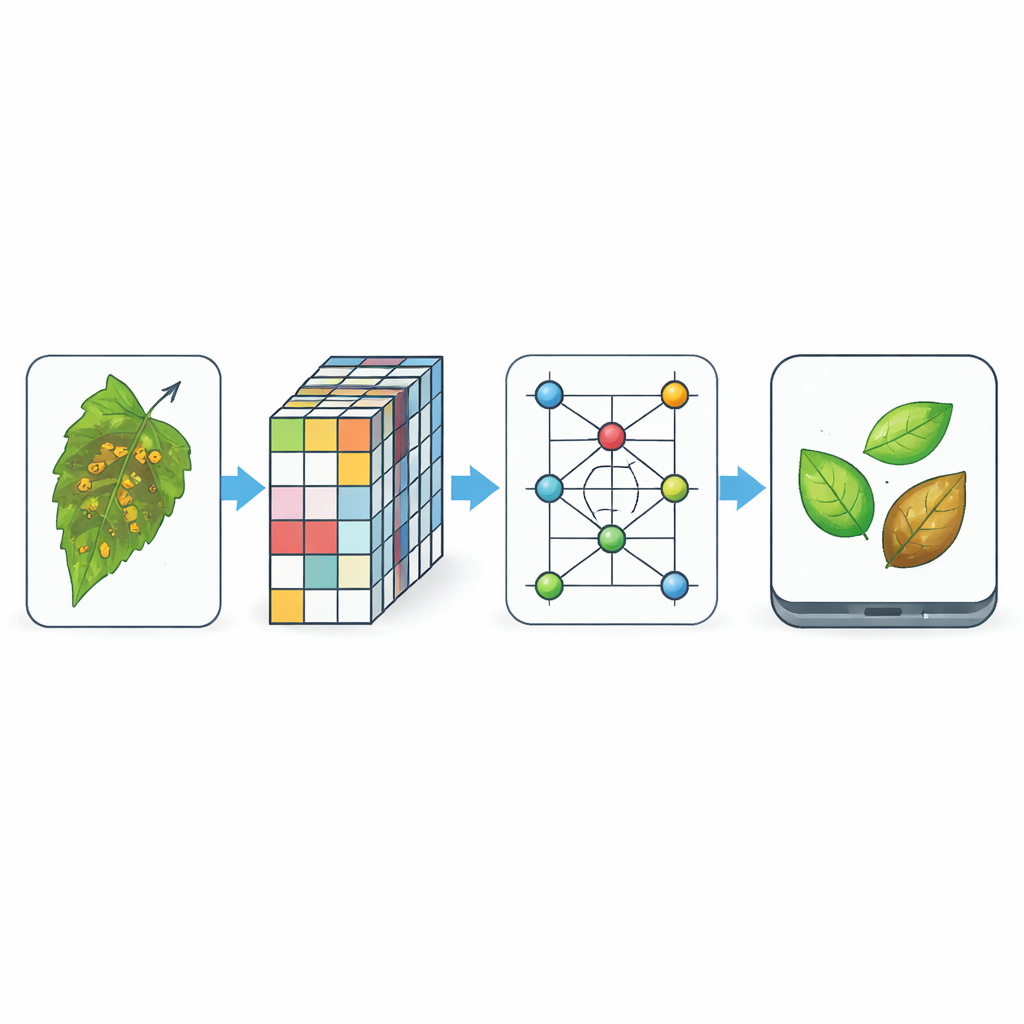

Las enfermedades del tomate suelen manifestarse primero como manchas, mohos o decoloraciones en las hojas, y detectarlas pronto puede prevenir pérdidas importantes de rendimiento. Los autores se basan en una colección pública de imágenes muy utilizada llamada PlantVillage, centrando el estudio en más de 18.000 fotos de hojas de tomate que cubren nueve enfermedades además de plantas sanas. Todas las imágenes se estandarizan y se alteran ligeramente durante el entrenamiento para imitar cambios del mundo real como la iluminación, el zoom y pequeños desplazamientos en la posición. Esto permite a los investigadores probar qué tan bien distintos modelos de IA aprenden a reconocer patrones visuales que distinguen, por ejemplo, tizón temprano de tizón tardío, o una hoja sana de una infectada por un virus.

Comparando muchos modelos inspirados en el cerebro pero pequeños

En lugar de diseñar un nuevo modelo por sí solos, el equipo organiza una competición justa entre siete arquitecturas compactas de aprendizaje profundo. Algunas son redes clásicas de reconocimiento de imágenes que han tenido éxito en muchas tareas, como VGG16, ResNet50 y DenseNet121. Otras son diseños más recientes creados específicamente para funcionar bien en teléfonos y dispositivos embebidos, como MobileNetV3-Small, ShuffleNetV2 y SqueezeNet. La última contendiente, MobilePlantViT, es un híbrido que combina dos ideas: capas de convolución tradicionales que capturan detalles finos en pequeñas regiones de la imagen, y atención al estilo transformador que vincula partes distantes de una hoja para entender el patrón general de la enfermedad.

Ver dentro de las decisiones de la IA

Para que los agricultores y agrónomos confíen en estos modelos, no basta con que sean precisos: también deben ser comprensibles. Por ello, los autores usan tres técnicas populares de “IA explicable” que crean mapas de calor sobre cada imagen de hoja, mostrando qué regiones influyeron más en la decisión. Estas son Grad-CAM, LIME y SHAP. Para ir más allá de la simple inspección visual de estos mapas coloridos, el equipo introduce una nueva puntuación llamada Perturbation Stability Score. Añadiendo un poco de ruido a una imagen muchas veces y comparando cuánto cambian los mapas explicativos, pueden medir cuán estables y fiables son cada uno de los métodos de explicación. Entre los modelos, SHAP tiende a proporcionar las explicaciones más estables, mientras que Grad-CAM ofrece resaltados claros y de alta resolución de las áreas enfermas que se alinean bien con las expectativas humanas.

Velocidad y consumo en dispositivos reales

Como las herramientas agrícolas a menudo dependen de procesadores de bajo coste sin chips gráficos, los investigadores miden la rapidez con la que se ejecuta cada modelo en CPUs de escritorio estándar y en una Raspberry Pi 5, un ordenador pequeño y asequible comparable al hardware usado en cámaras inteligentes. Registran el tamaño del modelo, el número de operaciones básicas por imagen y el tiempo para procesar una sola foto bajo diferentes configuraciones de subprocesos. Redes estándar como VGG16 ofrecen una excelente precisión pero son enormes y lentas, mientras que modelos diminutos como SqueezeNet se ejecutan rápidamente pero pierden algo de precisión, especialmente con imágenes más ruidosas y en condiciones de campo. MobilePlantViT destaca: alcanza una precisión por encima del 99% en imágenes limpias y se mantiene competitiva en pruebas más realistas, pero usa una fracción de la memoria y el cálculo, logrando un rendimiento casi en tiempo real incluso en hardware limitado.

Qué significa esto para las granjas inteligentes del futuro

En conjunto, el estudio muestra que modelos ligeros cuidadosamente diseñados pueden llevar reconocimiento de imágenes de alto nivel al borde del campo, donde la conectividad y la energía son limitadas. Entre todas las arquitecturas probadas, MobilePlantViT ofrece la mejor combinación de diagnóstico preciso, uso eficiente de los recursos informáticos y explicaciones visuales claras de aquello en lo que el modelo “fija la vista” cuando predice una enfermedad. Para los agricultores y los desarrolladores de tecnología, esto apunta a un futuro en el que dispositivos pequeños y económicos montados en teléfonos, drones o rieles de invernadero puedan escanear continuamente las plantas de tomate, resaltar hojas sospechosas y justificar sus alertas de maneras que los agrónomos puedan verificar y en las que puedan confiar.

Cita: Hoang, TM., Bui, VH., Nguyen, VS. et al. A comprehensive evaluation of lightweight deep learning models for tomato disease classification on edge computing environments. Sci Rep 16, 12320 (2026). https://doi.org/10.1038/s41598-026-42439-6

Palabras clave: detección de enfermedades del tomate, IA en el borde, aprendizaje profundo ligero, transformador de visión, IA explicable