Clear Sky Science · pl

Wszechstronna ocena lekkich modeli głębokiego uczenia do klasyfikacji chorób pomidorów w środowiskach obliczeń brzegowych

Mądrzejsze oko dla roślin pomidora

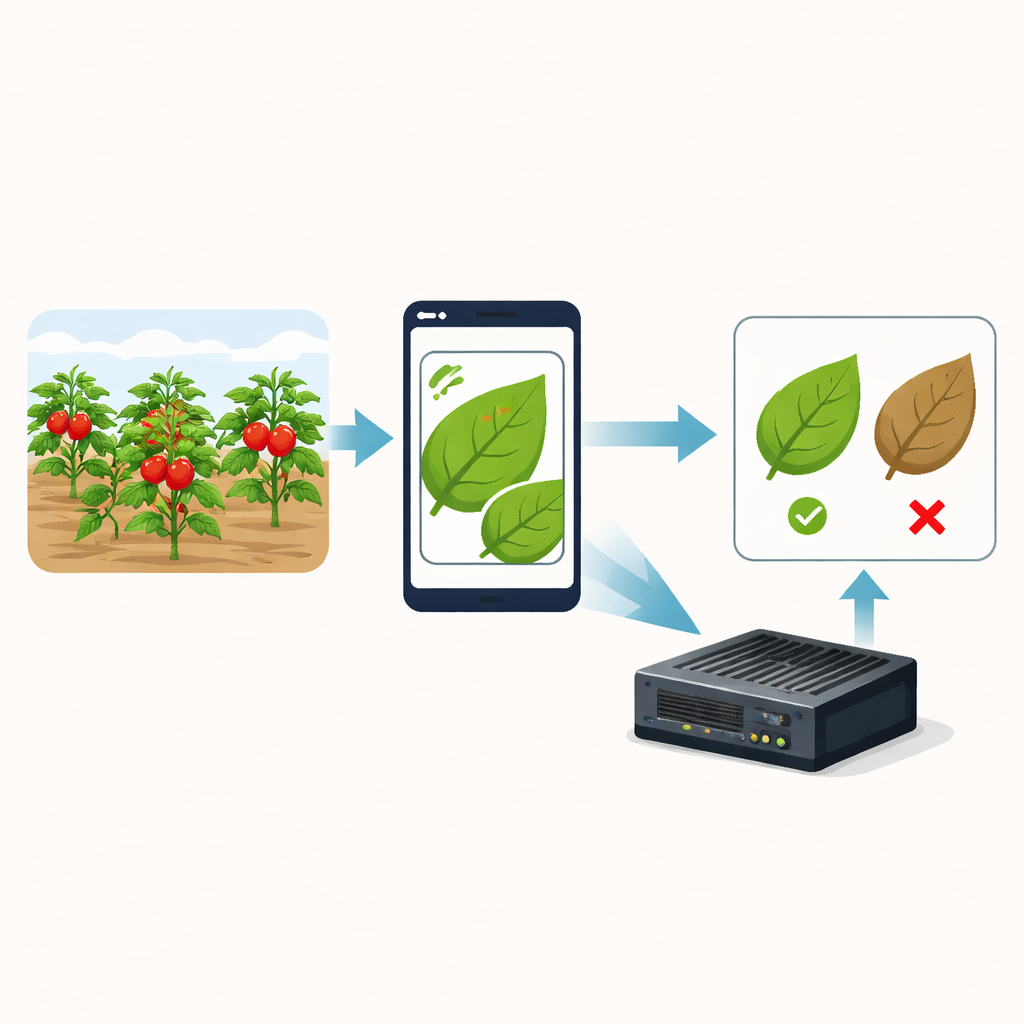

Uprawy pomidorów na całym świecie tracą znaczną część potencjalnego plonu z powodu chorób liści. Dziś rolnicy mogą wykonać zdjęcie liścia telefonem lub kamerą polową, pozwalając sztucznej inteligencji (AI) wczesne wykrywanie problemów. Jest jednak pewien haczyk: wiele z najdokładniejszych modeli AI jest zbyt zasobożernych, by działać na tanich urządzeniach w polu i w szklarniach. W tym badaniu postawiono praktyczne pytanie: które kompaktowe modele AI potrafią jednocześnie dokładnie rozpoznawać choroby pomidorów i działać szybko na małym, niedrogim sprzęcie blisko roślin?

Dlaczego zdjęcia liści pomidora są ważne

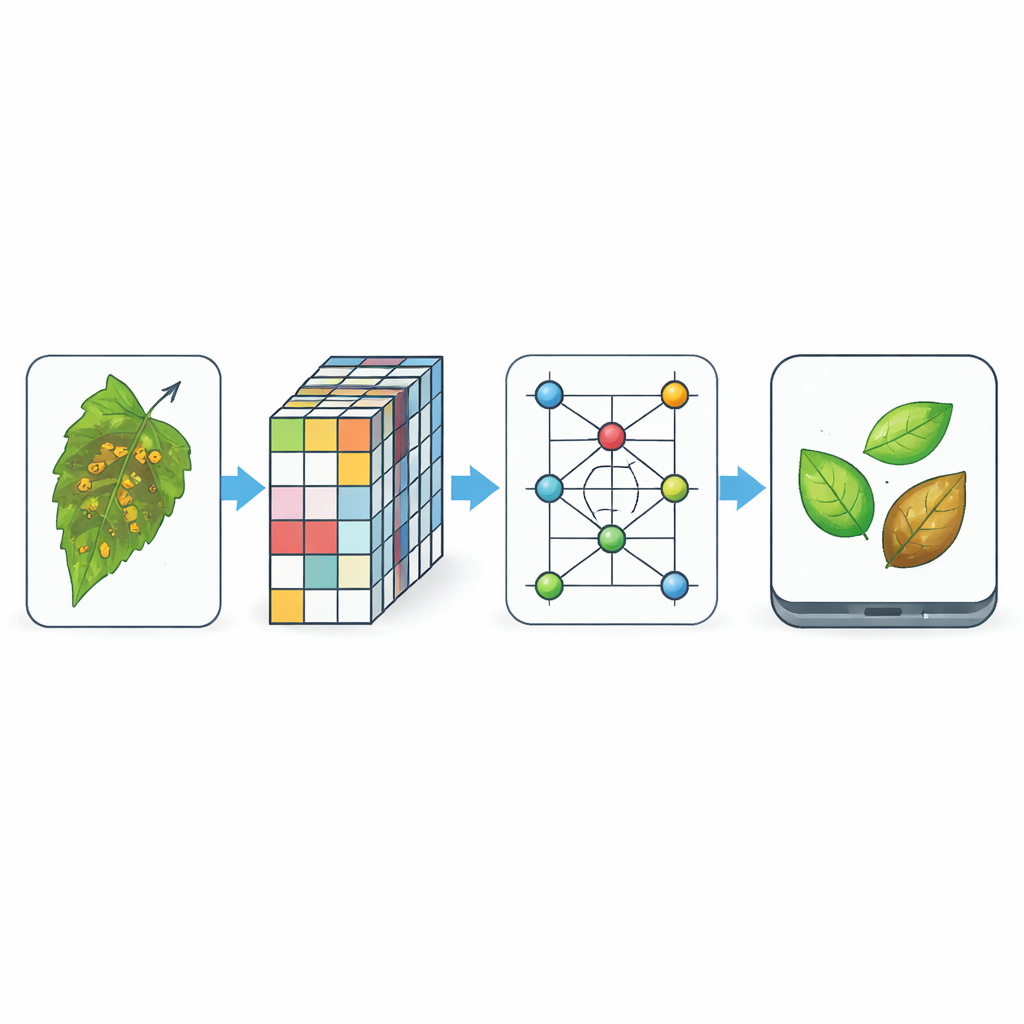

Choroby pomidorów często najpierw objawiają się jako plamy, pleśnie lub przebarwienia na liściach, a ich wczesne wykrycie może zapobiec poważnym stratom plonów. Autorzy opierają się na popularnym publicznym zbiorze obrazów PlantVillage, skupiając się na ponad 18 000 zdjęć liści pomidora obejmujących dziewięć chorób oraz rośliny zdrowe. Wszystkie obrazy są standaryzowane i nieznacznie modyfikowane podczas treningu, aby naśladować rzeczywiste zmiany, takie jak oświetlenie, przybliżenie czy niewielkie przesunięcia pozycji. Pozwala to badaczom sprawdzić, jak dobrze różne modele AI uczą się rozpoznawać wzorce wizualne, które odróżniają na przykład early blight od late blight lub zdrowy liść od zainfekowanego wirusem.

Porównanie wielu małych modeli inspirowanych mózgiem

Zamiast projektować kolejny nowy model od zera, zespół organizuje równe zawody między siedmioma kompaktowymi architekturami głębokiego uczenia. Niektóre to klasyczne sieci rozpoznawania obrazów, które odniosły sukces w wielu zadaniach, takie jak VGG16, ResNet50 i DenseNet121. Inne to nowsze konstrukcje stworzone specjalnie do wydajnej pracy na telefonach i urządzeniach wbudowanych, jak MobileNetV3-Small, ShuffleNetV2 i SqueezeNet. Ostatni uczestnik, MobilePlantViT, to hybryda łącząca dwie koncepcje: tradycyjne warstwy splotowe, które uchwytują drobne szczegóły w małych regionach obrazu, oraz mechanizm uwagi w stylu transformera, łączący odległe części liścia, by zrozumieć ogólny wzorzec choroby.

Wgląd w decyzje AI

Aby rolnicy i agronomowie zaufali tym modelom, nie wystarczy, by były dokładne — muszą być też zrozumiałe. Autorzy zastosowali zatem trzy popularne techniki „wyjaśnialnej AI”, które tworzą mapy cieplne nakładane na każde zdjęcie liścia, pokazując, które regiony najbardziej wpływały na decyzję. Są to Grad-CAM, LIME i SHAP. Aby pójść dalej niż proste oglądanie tych kolorowych map, zespół wprowadza nowy wskaźnik zwany Perturbation Stability Score. Poprzez wielokrotne dodawanie niewielkiego szumu do obrazu i porównywanie, jak bardzo zmieniają się mapy wyjaśnień, można mierzyć stabilność i wiarygodność każdej metody wyjaśnień. Wśród modeli SHAP ma tendencję do dawania najbardziej stabilnych wyjaśnień, podczas gdy Grad-CAM oferuje wyraźne, wysokorozdzielcze wyróżnienia obszarów chorobowych, które dobrze zgadzają się z oczekiwaniami ludzkimi.

Szybkość i zużycie energii na prawdziwych urządzeniach

Ponieważ narzędzia rolnicze często opierają się na tanich procesorach bez układów graficznych, badacze mierzą, jak szybko każdy model działa na standardowych procesorach stacjonarnych i na Raspberry Pi 5 — małym, przystępnym komputerze porównywalnym ze sprzętem stosowanym w inteligentnych kamerach. Śledzą rozmiar modelu, liczbę podstawowych operacji matematycznych na obraz oraz czas przetwarzania pojedynczego zdjęcia przy różnych ustawieniach wątków. Standardowe sieci, takie jak VGG16, zapewniają znakomitą dokładność, ale są ogromne i wolne, podczas gdy malutkie modele, takie jak SqueezeNet, działają szybko, lecz tracą nieco precyzji, zwłaszcza w trudniejszych, zaszumionych warunkach polowych. MobilePlantViT wyróżnia się: osiąga dokładność ponad 99% na czystych obrazach i pozostaje konkurencyjny w bardziej realistycznych testach, wykorzystując przy tym ułamek pamięci i obliczeń, osiągając niemal pracę w czasie rzeczywistym nawet na ograniczonym sprzęcie.

Co to oznacza dla przyszłych inteligentnych gospodarstw

Podsumowując, badanie pokazuje, że starannie zaprojektowane lekkie modele mogą przenieść zaawansowane rozpoznawanie obrazów na krawędź pola, gdzie łączność i zasilanie są ograniczone. Spośród wszystkich testowanych architektur MobilePlantViT oferuje najlepsze połączenie precyzyjnej diagnozy, efektywnego wykorzystania zasobów obliczeniowych oraz czytelnych wizualnych wyjaśnień, na co model „patrzy” przewidując chorobę. Dla producentów i twórców technologii wskazuje to kierunek, w którym małe, tanie urządzenia montowane w telefonach, dronach czy na torach w szklarniach mogą ciągle skanować rośliny pomidora, wskazywać podejrzane liście i uzasadniać swoje ostrzeżenia w sposób, który agronomowie mogą zweryfikować i zaufać mu.

Cytowanie: Hoang, TM., Bui, VH., Nguyen, VS. et al. A comprehensive evaluation of lightweight deep learning models for tomato disease classification on edge computing environments. Sci Rep 16, 12320 (2026). https://doi.org/10.1038/s41598-026-42439-6

Słowa kluczowe: wykrywanie chorób pomidorów, edge AI, lekkie głębokie uczenie, vision transformer, wyjaśnialna sztuczna inteligencja